8 Möglichkeiten, wie Facebook gegen Gruppen vorgeht, die gegen die Regeln verstoßen

Sie waren wahrscheinlich schon einmal in einer dieser Facebook-Gruppen. Wo es so viel Hassreden und Fehlinformationen gibt und man sich manchmal fragen muss: "Was macht Facebook gegen all das?"

Die Social-Media-Site hat die Maßnahmen enthüllt, die sie ergreifen, um es Gruppen, die gegen ihre Community-Richtlinien verstoßen, zu erschweren, auf der Plattform zu arbeiten.

Hier sind einige der Möglichkeiten, wie Facebook gegen Gruppen vorgeht, die gegen die Regeln verstoßen …

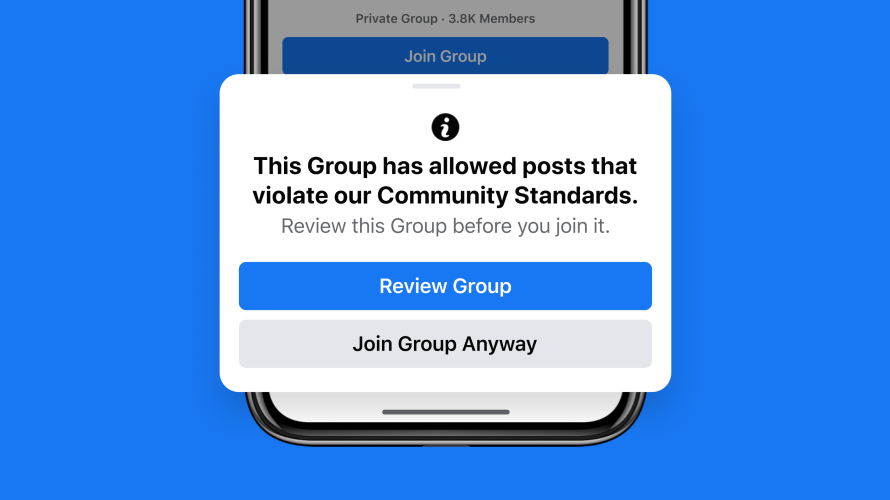

1. Benutzer benachrichtigen, wenn sie versuchen, einer Regelverstoßgruppe beizutreten

Facebook kündigte auf seinem Unternehmensblog im März 2021 an, dass es Benutzer benachrichtigen wird, wenn sie versuchen, einer Gruppe beizutreten, die wiederholt gegen ihre Community-Richtlinien verstoßen hat. Über die Benachrichtigungsaufforderung können Benutzer die Gruppe entweder überprüfen oder trotzdem beitreten.

Ziel dieser Funktion ist es, Benutzer davon abzuhalten, Gruppen beizutreten, die gegen die Community-Richtlinien verstoßen, und gleichzeitig sicherzustellen, dass Benutzer, die darauf bestehen, diesen Gruppen beizutreten, über die Verstöße informiert sind.

2. Beschränken von Einladungen für Gruppen mit Verstößen

Facebook gab außerdem bekannt, dass es die Anzahl der Einladungen begrenzen wird, die Mitglieder von Gruppen, die gegen Regeln verstoßen, senden können.

Dies bedeutet, dass Mitglieder der Gruppe nur eine begrenzte Anzahl ihrer Freunde zum Beitritt einladen können. Facebook geht davon aus, dass dies dazu beitragen wird, die Anzahl der Personen zu verringern, die diesen Gruppen voraussichtlich beitreten werden.

3. Reduzierung der Reichweite von Gruppen, die gegen Regeln verstoßen

Eine andere Strategie, mit der Facebook gegen Gruppen vorgeht, die gegen seine Regeln verstoßen, besteht darin, die Reichweite von Inhalten aus diesen Gruppen zu verringern.

Facebook tut dies, indem der Inhalt von Gruppen, die gegen Regeln verstoßen, im Newsfeed der Mitglieder niedriger angezeigt wird, wo er weniger wahrscheinlich gesehen wird.

4. Herabstufung von Gruppen, die gegen Regeln verstoßen, in Empfehlungen

In seinem Blog-Beitrag vom März gab Facebook außerdem bekannt, dass Gruppen mit Verstößen gegen den Community-Standard in der Liste der empfohlenen Gruppen, die den Benutzern angezeigt wird, herabgestuft werden. Diese Gruppen befinden sich weiter unten in der Liste der empfohlenen Gruppen, sodass weniger Personen sie sehen.

Das Ziel dieser Herabstufung, so Facebook, besteht darin, es den Benutzern zu erschweren, Gruppen zu entdecken und mit ihnen in Kontakt zu treten, die gegen ihre Regeln verstoßen.

5. Moderatoren müssen alle Beiträge genehmigen

Um die Verbreitung schädlicher Inhalte auf seiner Plattform zu kontrollieren, müssen Administratoren und Moderatoren vorübergehend alle Beiträge in Gruppen genehmigen, in denen eine erhebliche Anzahl von Personen gegen die Community-Richtlinien verstoßen hat.

Administratoren und Moderatoren von Gruppen mit vielen Ex-Mitgliedern einer gelöschten Gruppe werden ebenfalls aufgefordert, alle Beiträge vorübergehend zu genehmigen.

Facebook hofft, die Verbreitung von Hassreden und Fehlinformationen auf seiner Plattform zu kontrollieren, indem Administratoren und Moderatoren die Möglichkeit erhalten, in einer Gruppe geteilte Beiträge zu überprüfen.

Wenn ein Gruppenadministrator oder Moderator wiederholt Inhalte genehmigt, die gegen die Regeln verstoßen, sagt Facebook, dass die gesamte Gruppe heruntergefahren wird.

Facebook entfernte "Stop The Steal" , eine Gruppe mit über 300.000 Menschen, um ihre Mitglieder zu ermutigen, sich während der US-Präsidentschaftswahlen 2020 an gewalttätigen Aktivitäten zu beteiligen.

6. Blockieren von Benutzern, die gegen Regeln verstoßen, das Posten in einer beliebigen Gruppe

Eine weitere Maßnahme, mit der Facebook die Reichweite von Benutzern begrenzt, die versuchen, schädliche Inhalte auf seiner Plattform zu verbreiten, besteht darin, Benutzer, die wiederholt gegen die Community-Richtlinien verstoßen haben, vorübergehend daran zu hindern, 30 Tage lang in einer Gruppe zu posten oder zu kommentieren.

Der betroffene Benutzer kann auch keine neuen Gruppen erstellen oder Gruppeneinladungen an Freunde senden.

Das Ziel dieser Maßnahme ist laut Facebook, die Reichweite von Menschen zu verringern, die ihre Plattform nutzen möchten, um Hassreden und Fehlinformationen zu verbreiten.

7. Gruppenbeiträge, die gegen die Regeln verstoßen, automatisch entfernen

Facebook hat angekündigt, Gruppeninhalte, die gegen die Community-Richtlinien verstoßen, automatisch zu löschen. Mithilfe von KI und maschinellem Lernen erkennt Facebook schädliche Inhalte, die in Gruppen veröffentlicht wurden, noch bevor ein Benutzer dies meldet.

Von Facebook geschulte Prüfer überprüfen Inhalte, die von ihren Systemen gekennzeichnet oder von Benutzern gemeldet wurden, um Verstöße zu bestätigen. Dies hilft Facebook dabei, Beiträge mit schwerwiegenden Verstößen automatisch zu entfernen.

8. Verbot von gewalttätigen Bewegungen

Facebook geht auch gegen Organisationen und Bewegungen vor, die auf seiner Plattform ein „erhebliches Risiko für die öffentliche Sicherheit“ gezeigt haben.

Ein Beispiel dafür ist QAnon, eine in den USA ansässige Bewegung, die dafür bekannt ist, Gewalt- und Verschwörungstheorien zu fördern. Facebook hat die Bewegung auf seiner Plattform vollständig verboten und alle Inhalte gelöscht, die sie loben, unterstützen oder repräsentieren. Es wurden auch über 790 Gruppen entfernt, die sich auf die Bewegung beziehen.

Sind Facebook-Gruppen jetzt sicher?

Mit all diesen Maßnahmen, um gegen Gruppen vorzugehen, die gegen ihre Regeln verstoßen, scheint Facebook der Verbreitung unangemessener und irreführender Inhalte auf seiner Plattform ein Ende zu setzen.

Facebook räumte jedoch auch ein, dass noch mehr getan werden muss, um die Sicherheit von Gruppen zu gewährleisten.