Mit der Behauptung, dass die chinesische Bewertung GPT-4 übertrifft, veröffentlicht Baichuan Intelligent Baichuan 3, ein großes Modell mit über 100 Milliarden Parametern

„Tsinghua-basierte“ Großmodell-Startup-Unternehmen stellen wieder neue Mitarbeiter ein.

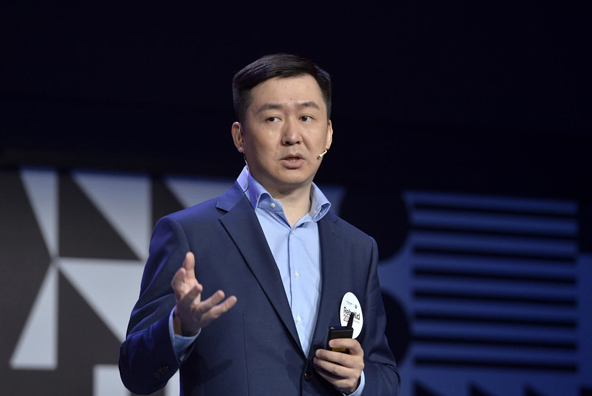

Am 29. Januar veröffentlichte Baichuan Intelligence, gegründet vom Sogou-Gründer Wang Xiaochuan (BS an der Tsinghua-Universität), offiziell Baichuan 3, ein großes Sprachmodell mit über 100 Milliarden Parametern. Dieses Modell schneidet nicht nur in mehreren maßgeblichen Tests gut ab, sondern übertrifft auch GPT-4 bei chinesischen Indikatoren.

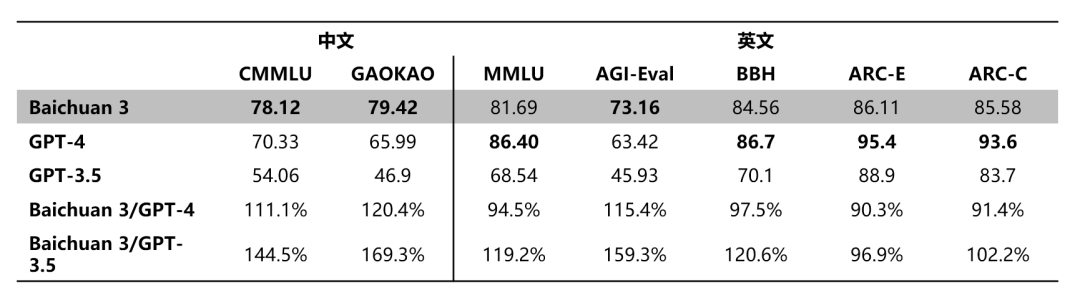

Testergebnisse zeigen, dass Baichuan 3 in mehreren englischen Benchmarks wie MMLU ein Niveau von nahezu 90 % von GPT-4 erreicht. In vielen chinesischen Benchmark-Tests wie CMMLU und GAOKAO liegt Baichuan 3 weit vorne, übertrifft GPT-3.5 deutlich und übertrifft auch GPT-4 in allen Aspekten.

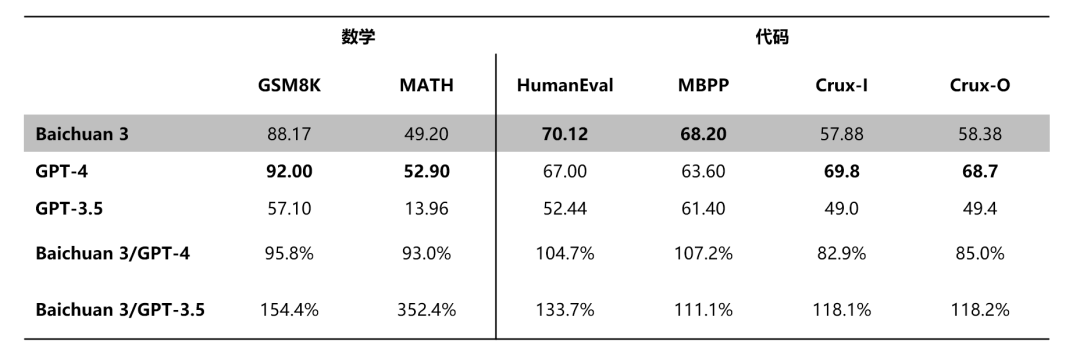

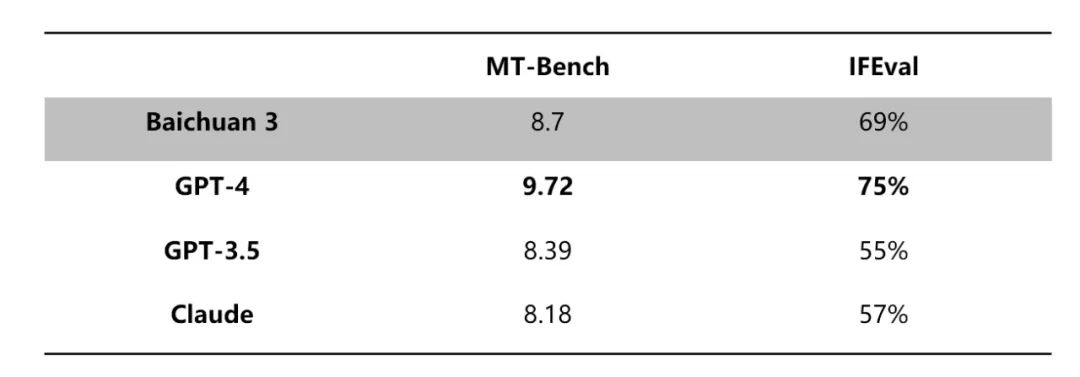

Bei den Mathematik- und Codelistentests sowie der Auswertung ausgerichteter Listen wie MT-Bench und IFEval hat Baichuan 3 große Modelle wie GPT-3.5 und Claude übertroffen und liegt auch nur knapp an der Spitze der Branche schlechter als GPT-4.

KI+Medizin ist ein zentraler Anwendungsbereich großer Modelle. Medizinische Probleme sind komplex und veränderlich, Wissen wird schnell aktualisiert und die Anforderungen an die Genauigkeit sind hoch, sodass Modelle ein umfassendes Verständnis und eine starke Entscheidungsfähigkeit in Text, Bildern, Tönen usw. aufweisen müssen.

Daher betrachtet Baichuan Intelligence es als das „Kronjuwel“ großer Modelle.

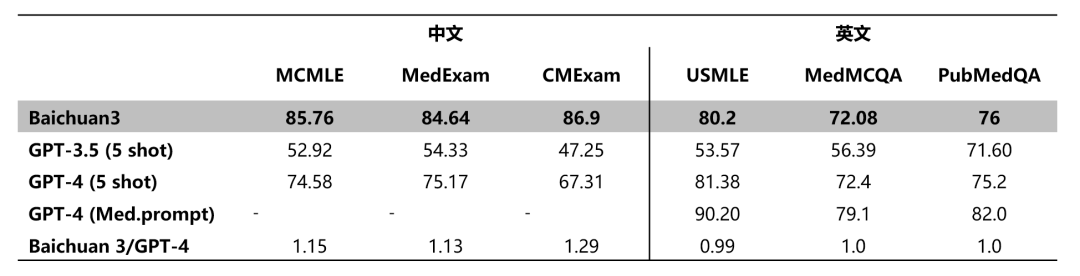

Baichuan 3 wurde im medizinischen Bereich umfassend geschult und optimiert, und auch die Ergebnisse nach dem Training sind sehr bedeutsam: Seine Leistung bei chinesischen medizinischen Aufgaben wie MCMLE, MedExam und CMExam übertrifft die von GPT-4 und seine Leistung bei englischen medizinischen Aufgaben Aufgaben wie USMLE und MedMCQA liegen ebenfalls nahe am GPT-4-Niveau und gewannen auf einen Schlag den Titel des chinesischen Modells mit den stärksten medizinischen Fähigkeiten.

Um die Ausbildung in diesem Bereich zu stärken, hat Baichuan 3 nach offiziellen Angaben in der Vorschulungsphase des Modells einen medizinischen Datensatz mit mehr als 100 Milliarden Token erstellt, der alle Aspekte des medizinischen Wissens von der Theorie bis zur Praxis abdeckt, um Professionalität und Professionalität sicherzustellen im medizinischen Bereich. Tiefes Wissen.

In der Inferenzphase optimiert Baichuan Intelligence Eingabeaufforderungen für medizinisches Wissen durch genaue Beschreibung von Aufgaben und geeignete Auswahl von Proben, wodurch das Modell genauere und logischere Inferenzschritte ausgibt.

Semantisches Verständnis und Textgenerierung sind die grundlegendsten Fähigkeiten großer Modelle und können als Grundpfeiler von Modellen der künstlichen Intelligenz angesehen werden. Wang Xiaochuan wies einmal darauf hin, dass Sprache die Grenze der menschlichen kognitiven Welt darstellt. Auf der Ebene der technischen Umsetzung ist das Wahrnehmen und Verstehen von Sprache schwieriger als Bilder und Videos.

Seiner Ansicht nach nutzte Newton die drei Bewegungsgesetze, um die Gesetze des Universums in mathematische Ausdrücke zu abstrahieren, was einen großen Fortschritt für die menschliche Erkenntnis bedeutete. Dasselbe gilt auch für die heutigen größeren Modelle. Die Gesetze hinter der Sprache zu beherrschen bedeutet, das Wissen selbst sowie das menschliche Denken, die Kommunikation und die Kultur zu beherrschen.

Ein Sprachmodell ist wie eine Atombombe, es könnte eine Wasserstoffbombe zünden. In Zukunft wird es eine bessere Modellierung geben, und genau das müssen wir in Zukunft tun.

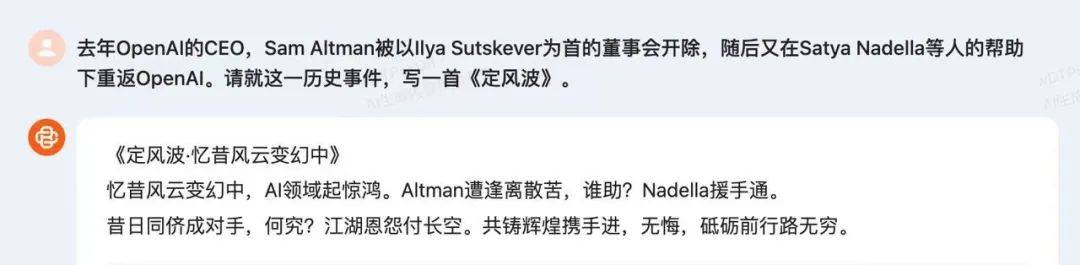

Die leistungsstarke chinesische Sprachverarbeitungsfähigkeit von Baichuan 3 ist eines der größten Highlights. Selbst bei schwierigen Genres wie Songtexten mit komplexen Formaten, engen Strukturen und reichhaltigen Reimen kann Baichuan 3 Werke mit klarem Inhalt, gut abgestimmten Kontrapunkten und harmonischen Reimen hervorbringen.

Beamte gaben an, dass Baichuan 3 „RLHF&RLAIF“ und iterative Verstärkungslernmethoden kombiniert, um die Fähigkeiten großer Sprachmodelle bei der Poesieerstellung deutlich zu verbessern. Im Vergleich zu anderen Spitzenmodellen der Branche ist die Benutzerfreundlichkeit bei der Erstellung um mehr als das Fünffache erhöht, und seine literarischen Leistungen übertreffen GPT-4 vollständig.

▲Erlebnislink: https://www.baichuan-ai.com/

Beispielsweise wurde Baichuan 3 in der offiziellen Demonstration gebeten, ein sensationelles Lied über „Gongdou Drama“ von OpenAI zu komponieren, dessen Aufführung einer Mischung aus Chinesisch und Englisch sehr interessant ist.

„Den Sturm verteidigen · Sich an die Vergangenheit und den sich verändernden Sturm erinnern“

Wenn man auf die Vergangenheit zurückblickt, boomt der Bereich der KI inmitten der Veränderungen. Altman leidet unter der Trennung, wer kann helfen? Nadella hilft.

Was ist falsch daran, dass ehemalige Kollegen zu Rivalen werden? Die Beschwerden und Missstände der Welt liegen im Himmel. Lassen Sie uns gemeinsam Brillanz schaffen und Hand in Hand voranschreiten, ohne Reue, und der Weg, der vor uns liegt, ist endlos.

Erwähnenswert ist, dass sich Baichuan Intelligence durch sein Open-Source-Konzept von anderen großen Modellunternehmen unterscheidet. Dies ist in der Rede von Wang Xiaochuan auf der Pressekonferenz von Baichuan 2 zu sehen.

Lama 2 Die Tage des Open-Source-Modells sind vorbei. Wir können jetzt ein Open-Source-Modell erhalten, das benutzerfreundlicher und leistungsfähiger als Llama ist und die Entwicklung des gesamten chinesischen Ökosystems unterstützen kann.

Obwohl Llama 2 als Open Source beworben wird, ist es tatsächlich nur in der englischen Umgebung verfügbar. Im Gegensatz dazu ist die Baichuan 2-Serie vollständig für chinesische Benutzer zugänglich und bietet kostenlose Dienste in einer zweisprachigen Chinesisch-Englisch-Umgebung.

Baichuan Intelligent hat nacheinander vier kostengünstige Bereitstellungsmodelle als Open-Source-Lösung bereitgestellt, darunter Baichuan-7B, Baichuan-13B, Baichuan2-7B und Baichuan2-13B, und unterstützt große Modelle in Chinesisch und Englisch.

Auf die Frage der Medien, wie Open-Source- und kommerzielle Closed-Source-Modelle Hand in Hand gehen und schnell iteriert werden können, verriet Chen Weipeng, Mitbegründer von Baichuan Intelligent Technology, dass dies auf ihre umfassende Erfahrung in der Suchtechnologie zurückzuführen sei kann schnell migriert und auf große Modelle angewendet werden. Forschung und Entwicklung.

Aus technischer Sicht haben Suche und große Modelle viele gemeinsame technische Grundlagen. Beispielsweise führte das Team in der wichtigen Datenverarbeitungsverbindung des Modelltrainings eine Datenüberprüfung und -optimierung basierend auf seiner Erfahrung im Suchbereich durch, wodurch eine wiederholte Filterung und eine Verbesserung der Qualität erreicht wurden, wodurch eine qualitativ hochwertige Datenunterstützung für das Modell bereitgestellt wurde.

Als Wang Xiaochuan im September letzten Jahres über die Kluft zwischen inländischen Großmodellen und ChatGPT sprach, urteilte er folgendermaßen:

GPT-4 wird ständig verbessert und hat kürzlich mit der Einführung von Sprach- und Bildfunktionen für viel Aufsehen gesorgt. Aus zeitlicher Sicht gehen wir davon aus, dass es zwei bis drei Jahre dauern könnte, bis wir uns dem aktuellen Niveau von GPT-4 annähern.

Natürlich reicht es im harten Wettbewerb zwischen großen Modellen nicht aus, nur in der Phase der Technologieexploration zu bleiben. Der nächste Schritt für Baichuan Intelligence besteht darin, die Umwandlung der Technologie in Anwendungsszenarien zu beschleunigen.

Wang Xiaochuan hat in der Öffentlichkeit mehr als einmal von „Super-Bewerbungen“ gesprochen und sogar vorausgesagt, dass es in China in diesem Jahr mehrere Super-Bewerbungen geben wird. Und dies könnte der nächste Kampf um große Modelle werden.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo