Künstliche Intelligenz hat fast 200 Millionen multinationale Unternehmen betrogen. Seien Sie vorsichtig bei diesen neuen Betrügereien

Im neuen Jahr und in der neuen Atmosphäre ist es neben einer guten Beziehung zum Gott des Reichtums auch wichtig, seinen Geldbeutel zu behalten.

Der Prozess der Technologieimplementierung ist oft die Evolutionsgeschichte pornografischer Inhalte und Betrugsroutinen.

Nutzen Sie das verbleibende Guthaben während der Feiertage und bringen Sie Ihren Ältesten bei, sich vor neuen KI-Betrügereien in Acht zu nehmen, damit Sie den „gemeinsamen Wohlstand“ der Familiengruppe „liebende Familie“ erreichen können.

Viele KI-Blogger zu erwischen kann die Leute mehr täuschen als „Fake Jin Dong“

In „Westward Journey“ heißt es, dass Menschen aus Menschen und Dämonen aus Dämonen geboren werden. Die durch den Code erzeugte KI hat keine Eltern, möchte aber so tun, als wäre sie aus Fleisch und Blut, damit man sie als solche missversteht menschliches Wesen.

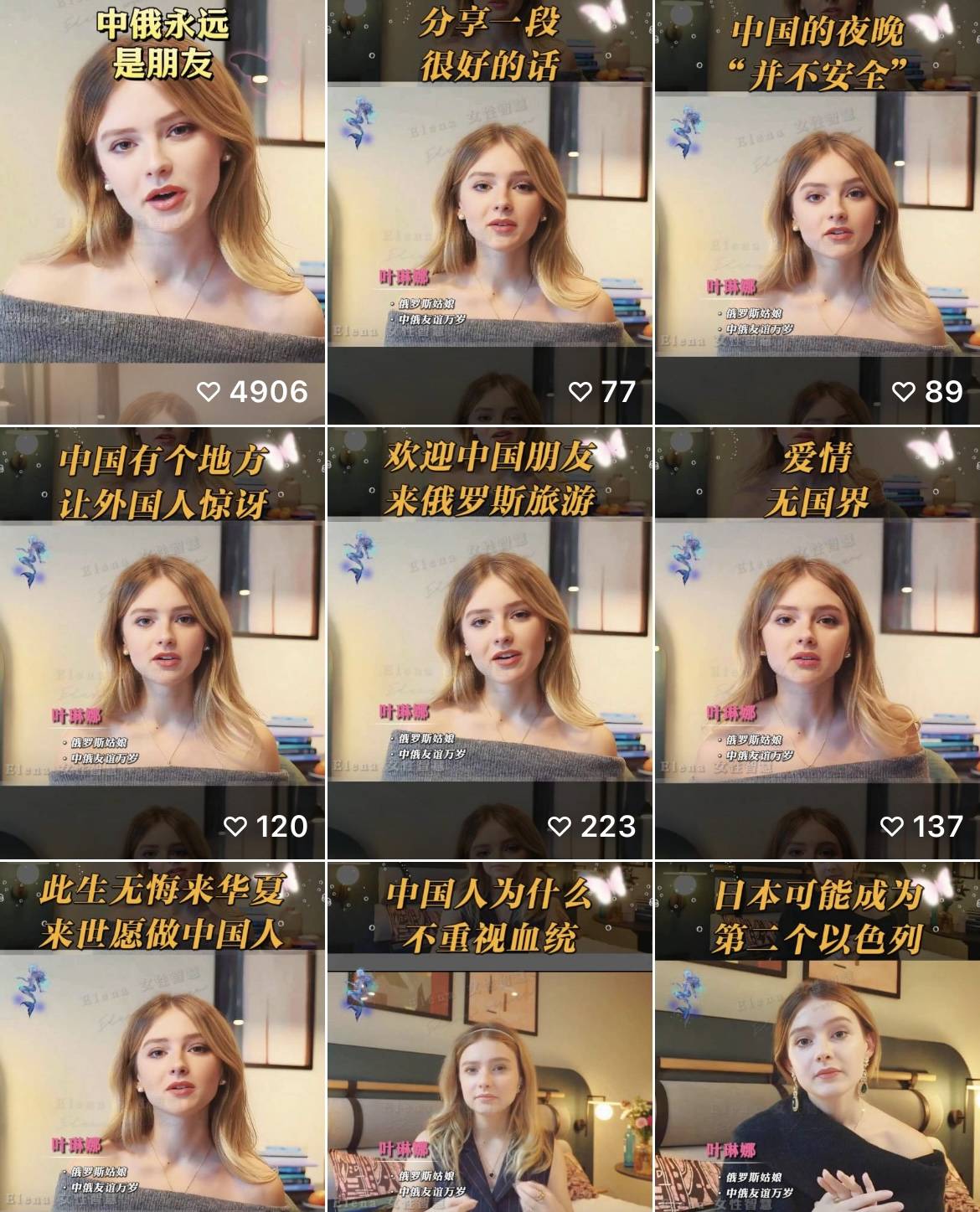

In letzter Zeit sind viele „russische Schönheiten“ auf Videokonten erschienen. Sie sind alle hellhäutig und schön und sprechen fließend Mandarin, aber ihre Satzfragmentierung und Aussprache sind seltsam und ihre Betonung und nasalen Laute sind schwer auszusprechen. Angesichts ihres ausländischen Status wäre es natürlich selbstverständlich, einen Akzent zu haben.

Sie sind enthusiastisch und lieben die chinesische Kultur. Sie beschrifteten das Video mit Etiketten wie „Russische Mädchen in China“ und „Chinesisch-Russische Freundschaft“ und brachten den Zuschauern „Heimatstadt-Spezialitäten“ wie Rindersehnenwurst, große Rippchen, Ziegenmilchpulver, und eingelegte Gurken. , Schokolade, handgemachte Seife.

Sie haben Augenbrauen, die aussehen, als würden sie die Stirn runzeln, aber nicht die Stirn runzeln, und Augen, die aussehen, als wären sie glücklich, aber nicht glücklich. Sie tragen nicht nur Waren, sondern äußern auch ihre Meinung. Sie glauben, dass Liebe keine Grenzen kennt und glauben, dass Schlichtheit das ist Wahrheit. Sie beklagen den Wohlstand hier und wollen ihre Eltern und ihre Schwester heiraten. Auch entwickelt.

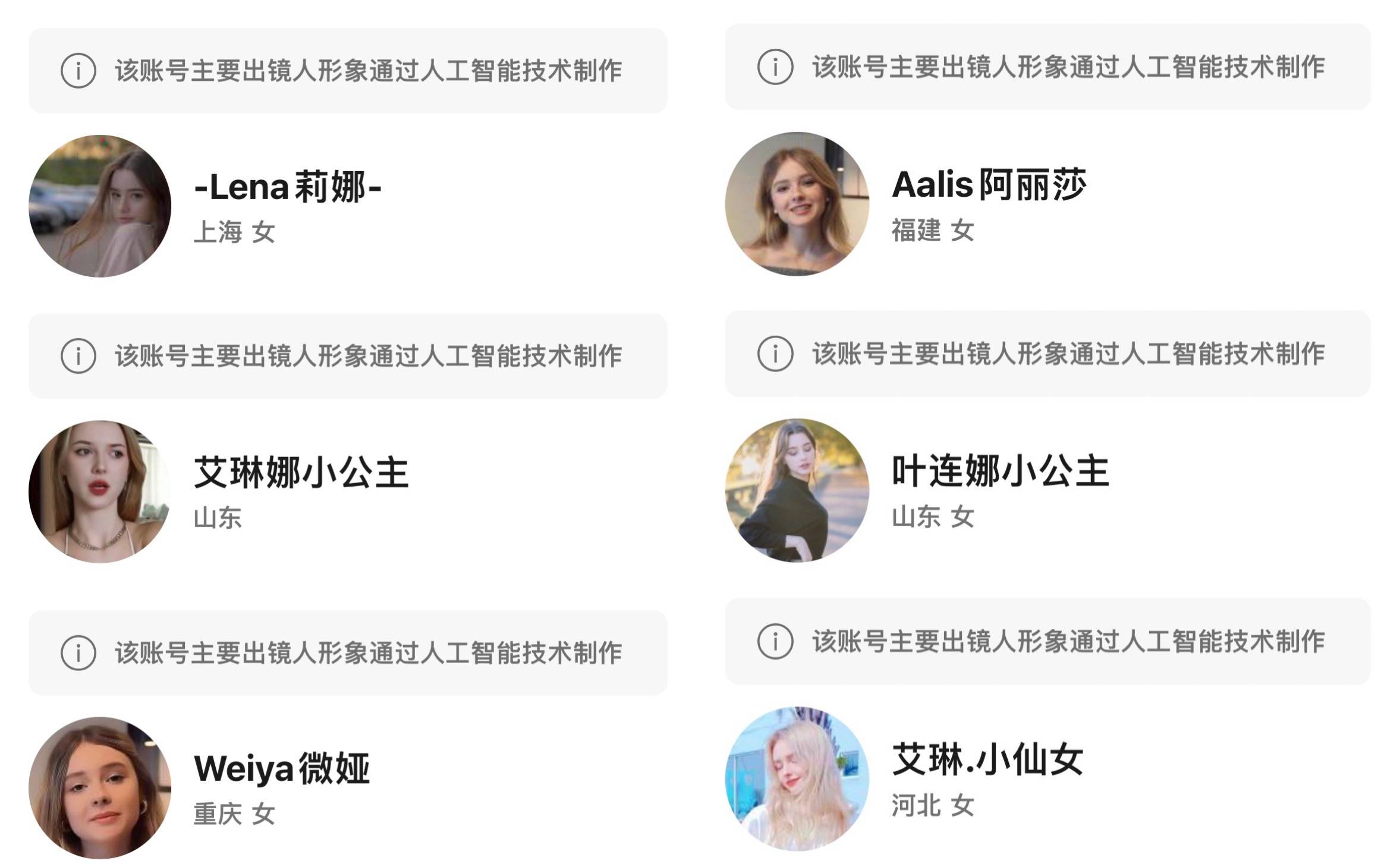

Möglicherweise handelt es sich um lange verschollene Schwestern. Yelena und Elena sehen genau gleich aus und ihre IP-Adressen stammen beide aus Shandong. Sie sind wie ein Feuerball, wenn sie gesammelt sind, und ein Himmel voller Sterne, wenn sie verstreut sind. Sie sind über die ganze Welt verteilt. Lina kommt aus Shanghai, Nina kommt aus Anhui, Irene kommt aus Hebei, Katya kommt aus Liaoning und Alyssa aus Fujian.

Diese russischen Schönheiten sind alle KI und die Plattform hat sie sorgfältig markiert. Wir können den Unterschied an den übertrieben unscharfen Hintergründen, den ungekämmten Haaren, den wiederholten Ausdrücken und Bewegungen und den allzu bodenständigen Linien erkennen.

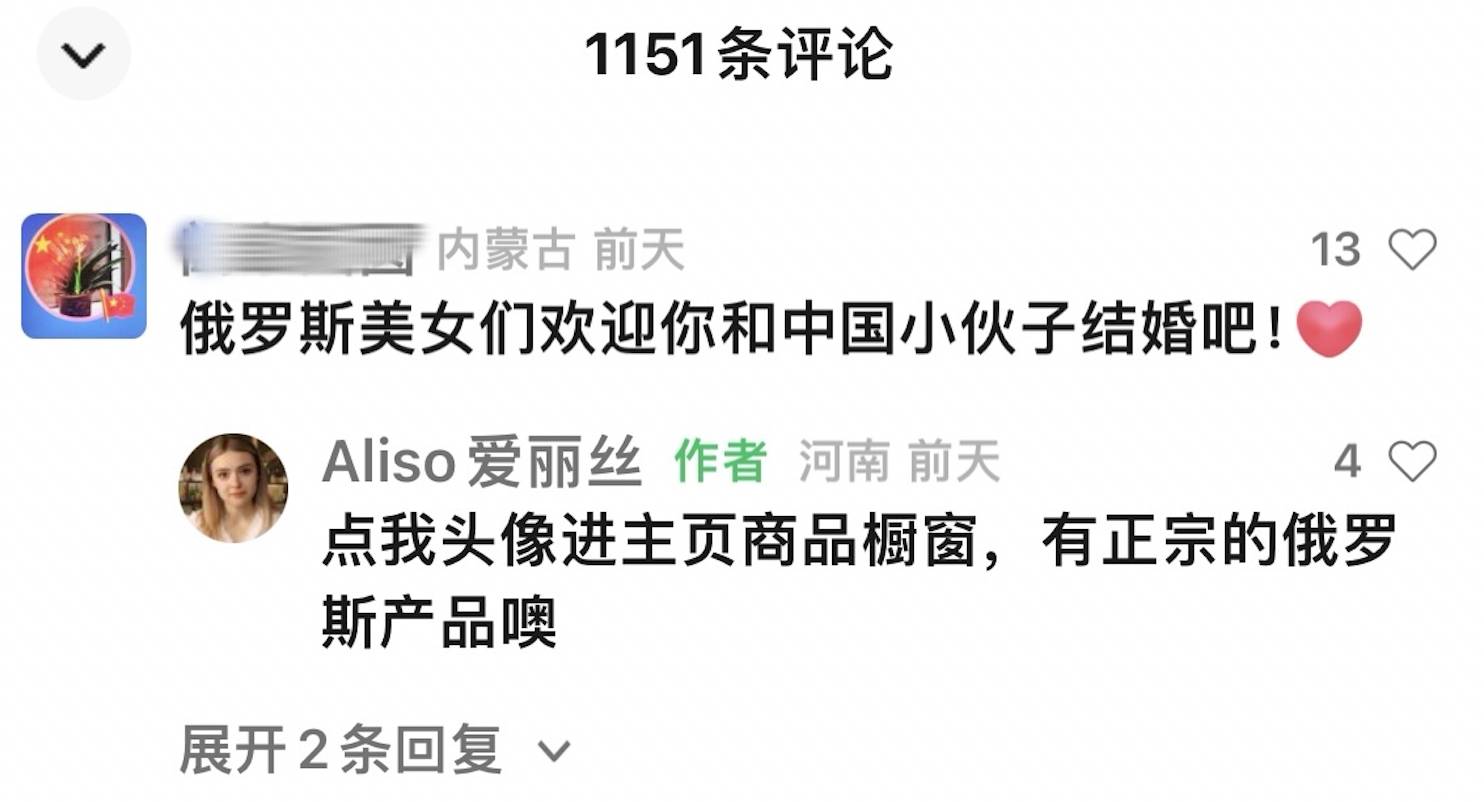

Aber die mittleren und älteren Leute im Kommentarbereich konnten es nicht sehen und hofften aufrichtig, dass sie bleiben würden. Als sie antworteten, waren die „russischen Schönheiten“ nur um ihre Missionen besorgt und vollendeten in aller Stille einen sanften Betrug.

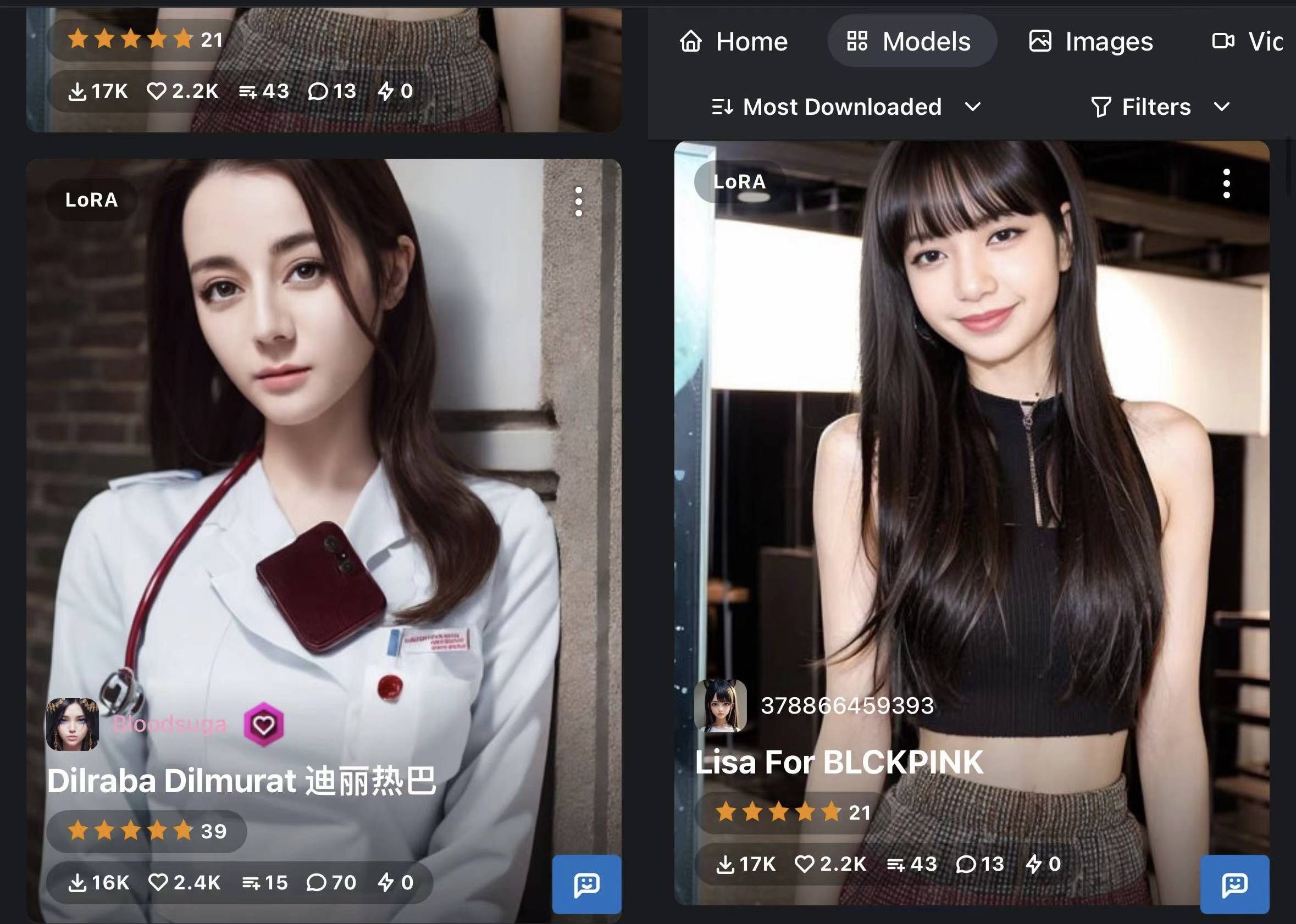

Es liegt in der Natur des Menschen, sich von Schönheit verführen zu lassen, unabhängig vom Alter. Die gutaussehenden KI-Blogger von Xiaohongshu nutzen modische und internetfreundliche Charaktere, um Jung und Alt gleichermaßen zu töten. „Elitemann im Anzug“, „Sportstudent in weißen Socken“, „Göttin des reinen Verlangens“ … Auf den ersten Blick dachte ich einfach, dass es sich um echte Menschen handelte, die das P-Bild bestanden hatten.

Derzeit ist das Betrachten der Hände immer noch die einzige Möglichkeit, festzustellen, ob es sich um KI handelt, da das Gesicht relativ flach und leicht zu erlernen ist, während die Hände eine dreidimensionale Struktur haben, was arbeitsintensiver ist. Unnötig zu erwähnen, dass die Anzahl der Finger übermäßig groß ist und die Knöchel so sorgfältig verdreht sind, dass es sehr verdächtig ist, die Hände nicht zu zeigen, es sei denn, es ist notwendig. Ebenso können Details wie Muskeln, Gliedmaßen, Kleidung usw. offensichtliche Mängel aufweisen.

Die übrigen Identifizierungsmethoden werden immer metaphysischer und intuitiver: Der Malstil ist fettig, die Texte trübe, es gibt keinen Lebenshauch, die Licht- und Schatteneffekte sind unnatürlich, die Augen sind leblos, das Gesicht auch zart und perfekt, es gibt nur statische Bilder und keine Videos, einzeln. Es ist schwer, sicher zu sein, wenn man nur ein Bild betrachtet, aber wenn man sich ein paar weitere Bilder ansieht, wird man feststellen, dass jede Haltung den gleichen Ausdruck hat …

Xiaohongshu KI-Blogger @cyberAngel_ ist von Beruf Softwareentwickler und KI-Malerei ist ein Hobby, das Strom erzeugt. Er verbirgt nicht die Tatsache, dass er KI nutzt. Der Titel seines Beitrags lautet „KI-Malerei“, und auf seinem Kontoprofil steht auch „AI Painting“. „Ich bin einfach ein emotionsloser Roboter.“

▲ Bild von: 小红书@cyberAngel_

Gleichzeitig glaubt @cyberAngel_, dass es in zukünftigen KI-Gemälden immer schwieriger werden wird, zwischen wahr und falsch zu unterscheiden. KI-Generierung und KI-Erkennung entwickeln sich miteinander weiter. Schöpfer sind sich bewusster, wo KI anders ist als echte Menschen, also werden sie arbeiten Es ist schwierig, diesen Teil „wie“ echte Menschen zu machen. Beispielsweise ist das von der KI produzierte schöne Mädchen zu perfekt, sodass es entsprechend unscharf gemacht werden kann und ein „Filmgefühl“ erzeugt.

Auch wenn der AI-Beauty-Blogger nicht so real ist, ist eine ähnliche Handlung wie bei „Russian Beauty“ aufgetaucht. Die Plattform hat eindeutig darauf hingewiesen, dass „verdächtigt wird, Informationen zur KI-Erstellung zu enthalten.“ Es gibt immer noch Leute, die Regenbogenfürze hinterlassen Kommentarbereich und sogar die Frage nach Links zu Kleidung. Es scheint, dass die Frage nach Wahrheit oder Falschheit unweigerlich der Schönheit als Gerechtigkeit weichen wird.

Wenn die Zahl der Fans steigt, können KI-Beauty-Blogger auf viele Arten Geld verdienen. Einige sind selbstständig und monetarisieren ihren Traffic durch Werbung. Andere zahlen für Wissen, verkaufen Kurse und verkaufen maßgeschneiderte Modelle. Laut @cyberAngel_ „Neue Medien da.“ sind neue Medienmonetarisierungsmethoden, und Technologie verfügt über technologische Monetarisierungsmethoden.“

▲Echtes Modell.

Die KI „Russische Schönheiten“ und „gutaussehende Blogger“ ähneln in gewisser Weise dem „falschen Jin Dong“, der zuvor Frauen mittleren und älteren Alters um ihre Gefühle und ihr Geld betrogen hat, sind aber noch gruseliger und einfallsreicher.

„Fake Jin Dong“ hat keinen technischen Inhalt. Videos und Fotos von Prominenten werden in Paketen heruntergeladen oder gekauft. Seine liebevolle Stimme wird mithilfe einer Stimmveränderungssoftware gefälscht. Sie ist so rau, dass sie „auf den ersten Blick gefälscht“ ist. Die KI Das Niveau ist höher und manchmal ist es real. Es ist nicht so einfach, es zu unterscheiden.

Man kann nur sagen: Wenn wir gutaussehende Männer und schöne Mädchen im Internet sehen, ist es am besten, nicht anzunehmen, dass es sich um echte Menschen handelt, und auch nicht zu aufrichtig zu sein. Internet-Promi-Unternehmen wollen kein Geld für echte KOLs ausgeben, und Das Publikum konsumiert KOLs schneller. Die Vorstellungen von Schönheit und Billigkeit stehen im Einklang mit den Kommunikationsgesetzen des Internets.

KI imitiert dein Gesicht und erschreckt dein Herz

Neben der weiten Verbreitung von „gutaussehenden Bloggern“ und „russischen Schönheiten“ kann KI auch gezielt zielen.

Mit anderen Worten: KI kann nicht nur eine sanfte Landschaft erschaffen, sondern sich auch in einen PUA-Meister verwandeln.

Eine häufige Form des KI-Betrugs besteht darin, dass der Betrüger die Anrufer-ID und die Stimme eines Bekannten fälscht und den Anrufern mittleren und älteren Alters mitteilt, dass ihre Enkelkinder in Schwierigkeiten sind. Sie haben entweder etwas begangen und brauchen dafür Geld Lösen Sie das Problem, sonst sind sie in Gefahr. Mit einem Lösegeld gerettet.

Mehrere solcher Telefonbetrügereien wurden im Ausland gemeldet. Die Verschwörungen sind ähnlich, darunter Entführungen, Verletzungen, Trunkenheit am Steuer und Auffahrunfälle … Ähnliche Dinge sind auch in China passiert, insbesondere unter Ausnutzung der „Zeit- und Raumdifferenz“, um die Entführung zu fabrizieren internationaler Studierender, die ihre Eltern betrügen.

Die Routine selbst ist nicht neu und erfreut sich seit mehreren Jahren großer Beliebtheit. Aufgrund der technologischen Entwicklung wurden jedoch die Anforderungen an Rechenleistung, Proben und andere Aspekte reduziert, die Wirkung ist realistischer und die Betrugsmasche einfacher umzusetzen.

ElevenLabs, der Marktführer im Bereich KI-Stimmenklonen, benötigt nur einen Dollar und eine Minute hochwertiges Audio, sodass Sie sofort 29 Sprachen und mehrere Töne beherrschen und dabei Ihren eigenen Akzent, Ihre Intonation und Ihren Rhythmus beibehalten können.

Obwohl Elevenlabs heute wiederholt versichert hat, dass nur Sie Ihre eigene Stimme klonen können und es einen Überprüfungsprozess gibt, um zu beweisen, dass die Stimme Ihnen gehört, ist dies der letzte Ausweg. Als Elevenlabs 2023 erstmals die Beta-Version herausbrachte, wurden Stimmen von Prominenten geklont wie Taylor Swift flogen bereits überall herum. . Ich kann nicht entscheiden, was AI Taylor Swift sagt.

Allerdings kann der Gesprächspartner zwar die Anrufer-ID und die Stimme fälschen, doch wenn die betroffene Person einen klaren Kopf hat, auflegt, die Mobiltelefonnummer erneut eingibt und die Initiative ergreift, Verwandte zu kontaktieren, erfolgt die Lüge oft selbst -besiegend.

Im Vergleich zu Sprachanrufen können Videoanrufe dazu führen, dass Menschen mittleren Alters und ältere Menschen, die glauben, dass „Sehen Glauben bedeutet“, dem Leben skeptischer gegenüberstehen.

Der uralte Witz, nicht zu wissen, wer auf der anderen Seite des Bildschirms ein Mensch oder ein Hund ist, wird nie aus der Mode kommen und ist technisch nicht schwer umzusetzen. Ein häufigerer Vorgang besteht darin, mit der anderen Partei über eine virtuelle Kamerasoftware und eine KI-Funktion zur Gesichtsveränderung zu chatten.

Ein von CCTV befragtes Technologieunternehmen aus Shenzhen, das der öffentlichen Sicherheitsbehörde technischen Support bietet, sagte, dass bei der Gesichtsveränderung in Echtzeit im Video-Chat, egal ob es sich um einen Avatar oder ein Foto eines Freundeskreises handelt, nach dem Hochladen des Bildes nur noch die Merkmalserkennung erfolgt Nach etwa 30 Sekunden beginnt die KI mit dem Aufbau des Modells und führt nach Abschluss der Modellierung eine Echtzeitkonvertierung durch.

Vielleicht haben Sie bei Eins-zu-Eins-Videos immer noch Angst, aber wie sieht es mit einem Eins-zu-Viele-„Profiteam“ aus?

Kürzlich wurde die Niederlassung eines multinationalen Unternehmens in Hongkong aufgrund von KI um 25 Millionen US-Dollar betrogen. Das Opfer war ein Finanzangestellter. Er erhielt eine E-Mail vom „CFO“ der britischen Zentrale und wurde zu einer Videokonferenz eingeladen, in der es um „geheime Transaktionen“ ging. Bei dem Treffen waren nicht nur der „CFO“, sondern auch mehrere anwesend bekannte „Kollegen““.

Die an der Besprechung teilnehmenden Kollegen waren nicht wirklich anwesend. Der Betrüger lud das öffentliche Video herunter, fälschte das Gesicht und die Stimme der realen Person über Deepfake und wandte sie dann auf die Videokonferenz an. Um die Offenlegung des Geheimnisses zu vermeiden, erteilte der „CFO“ den Befehl einseitig. Die „Kollegen“ kommunizierten nicht mit dem Opfer und das Video wurde schnell aufgehängt. Der Betrüger kontaktierte das Opfer weiterhin über E-Mails und auf andere Weise.

▲ Die Polizei demonstrierte, wie man mit Deepfake eine Videokonferenz mit mehreren Personen vortäuscht.

Obwohl es hierzu Untersuchungsergebnisse gibt, vermuten einige Internetnutzer, dass es sich lediglich um einen Insider handelt. Die Risikomanagement- und Kontrollmaßnahmen multinationaler Unternehmen sind unbekannt, aber sicher ist, dass KI-Gesichtsveränderungen auch auf viele Orte ausgeweitet werden können, von den ersten Kopfveränderungen in Pornofilmen bis hin zu falschen Prominenten, die Waren in Live-Übertragungsräumen bringen.

Glücklicherweise ist die KI noch nicht perfekt und die Identifizierungsmethode ist immer noch einfach und machbar.

Wenn es sich um ein gesichtsveränderndes Video durch KI handelt, verbraucht das Originalbild der Kamera bei der Konvertierung mehrerer Ebenen viel Rechenleistung und Ton und Bild sind oft verzögert. Darüber hinaus können Sie die andere Person zu einigen Aktionen anleiten, z. B. zum Öffnen des Mundes, zum starken Kopfschütteln, zum Vor- und Zurückbewegen der Finger vor dem Gesicht usw. Wenn die KI das Gesicht wechselt, kann das „Gesicht“ sein deformiert und fehlerhaft.

Neben dem Durchbrechen technischer Fehler gibt es noch einen weiteren Trick, der sich jedes Mal bewährt hat: Stellen Sie einige Fragen zum Datenschutz, die Sie kennen, ich weiß, und er weiß es nicht, oder Sie können absichtlich Lügen erfinden Verwenden Sie Tricks, um zu sehen, wie die andere Partei reagiert.

Natürlich kann der Mangel an Technologie nur vorübergehende Schwierigkeiten lösen. Wir könnten sie genauso gut strategisch verachten und ihr taktisch Aufmerksamkeit schenken. Wir können nicht glauben, dass wir uns nicht täuschen lassen. Es kann sein, dass das High-End-Spiel noch nicht erschienen ist .

KI-Betrügereien sind nicht neu, aber es ist eine neue digitale Kluft entstanden

2023 gilt als das erste Jahr der generativen KI. Die Förderung der Technologie hinkt jedoch hinterher. Vielleicht können die meisten normalen Menschen besser erkennen, wie sich Technologien, die nicht neu erscheinen, aber in den letzten Jahren immer beliebter geworden sind, auf das tägliche Leben ausgewirkt haben. .

Jeder versteht, dass Technologie ein zweischneidiges Schwert ist. Mit Elevenlabs können Menschen mit Sprachbarrieren sprechen, mit HeyGen kann Swift Chinesisch ohne Übersetzung lippensynchronisieren und mit Miaoya Camera können Menschen raffinierte Zertifikate erhalten, ohne das Haus verlassen zu müssen. Es stellt sich heraus, dass dies der Fall ist Es gibt kein Richtig oder Falsch zwischen der hellen Seite und der dunklen Seite der Technologie, sie existieren einfach objektiv.

Doch für viele Menschen mittleren und höheren Alters sind Smartphones und das Internet für sie unverständlich, und nun sorgt die KI erneut für Ärger.

Im KI-Zeitalter können Texte, Töne, Bilder und Videos gefälscht sein oder sogar in Kombination auftauchen. Die gefälschten Identitäten der Betrüger sind spezifischer und der Betrug ist gezielter und echter, was Menschen mittleren Alters und ältere Menschen anfälliger macht wahrscheinlich getäuscht werden.

Der Einsatz von Magie zur Bekämpfung von Magie und der Einsatz von Technologie zum Angriff und zur Verteidigung von Technologie ist ein Katz-und-Maus-Spiel, das Menschen mittleren Alters und ältere Menschen möglicherweise nicht schnell verdauen können. Wir können von der Natur des Betrugs ausgehen, um die Möglichkeit eines Betrugs in der Mitte zu verringern -Betagte und ältere Menschen werden getäuscht.

Unabhängig davon, wie sich die Technologie weiterentwickelt, bleiben viele Betrugspläne gleich: Diebstahl der Privatsphäre, Ausnutzen von Angst, Gier und emotionalen Werten, um Geschichten zu erfinden, Vorgeben von Bekannten oder Verschleiern, um Vertrauen zu gewinnen, wobei Geld das ultimative Ziel ist.

Nachdem der KI-Modepapst die Branche verlassen hatte, beklagte sich ein X (ehemals Twitter) V mit fast 13 Millionen Fans: „Ich dachte, die Daunenjacke des Papstes sei echt und habe nicht viel darüber nachgedacht. Ich kann nicht überleben.“ die Zukunft der Technologie.“

Für Menschen mittleren Alters und ältere Menschen ist es schwieriger, sich an die Regeln zu gewöhnen, dass das Sehen nicht unbedingt wahr ist und Bilder nicht unbedingt die Wahrheit sind. Wir können ihnen einige einfache, traditionelle, aber dennoch wirksame Methoden zeigen.

Eine Möglichkeit besteht darin, vorsichtig zu sein und den Inhalten des Internets nicht so leicht zu vertrauen, keine belästigenden Anrufe zu beantworten, nicht auf unbekannte Links zu klicken und zu versuchen, persönliche biometrische Informationen wie Gesichter, Stimmen, Fingerabdrücke usw. nicht übermäßig preiszugeben das Internet.

Besonders wenn Sie verdächtige Telefonanrufe oder Textnachrichten erhalten, sollten Sie nicht blind auf „einseitige Worte“ vertrauen. Ganz gleich, wer die andere Partei ist, sie hat mehrere Perspektiven, wenn es um Geld geht. Verwenden Sie mehrere Methoden, um die der anderen Partei zu überprüfen Identität. Wenn die andere Partei sagt, dass Ihrer Familie etwas passiert ist, rufen Sie sie erneut an. Rufen Sie an, um zu bestätigen, ob dies wahr ist.

Der andere Typ ist proaktiv und vorbereitet. Menschen mittleren Alters und ältere Menschen haben ihre eigenen bevorzugten Medien. Ihre Familienangehörigen können Betrugsbekämpfungsinhalte von den offiziellen WeChat-Konten der Regierungsbehörden und anderen Quellen an sie weiterleiten. Wenn die Bedingungen es zulassen, können Sie auch Menschen mittleren Alters und älteren Menschen den Umgang mit KI-Tools wie ChatGPT zeigen.

Für ältere Menschen, die sich nicht mit Smartphones auskennen, versuchen Sie natürlich, das Problem an der Quelle zu lösen. Es ist am besten, Bankkarten nicht an WeChat oder Alipay zu binden und nur einen kleinen Betrag an Wechselgeld zu sparen.

Erfolgreicher KI-Betrug ist nur das Endergebnis, aber die Verhinderung von KI-Betrug kann jederzeit beginnen.

Technologie sollte allen dienen, den Weg weisen, das Leuchtfeuer der digitalen Welt für diejenigen erhellen, die nach uns kommen, und die unbekannten Unterwasserriffe erkunden. Nur dann können wir uns gemeinsam auf eine Zukunft zubewegen, in der Technologie nicht gefürchtet, sondern rational eingesetzt wird.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner: aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo