Gerade hat OpenAI seinen ersten KI-Agenten veröffentlicht! Automatische Unterstützung beim Bestellen von Lebensmitteln und Einkäufen, Live-Übertragung und Rollover. Sie müssen diese Details kennen, bevor Sie sie verwenden können

Heute früh gab OpenAI-CEO Sam Altman zwei große Neuigkeiten bekannt.

Einer davon ist, dass ChatGPT-Benutzer nicht nur eine kostenlose Testversion von o3-mini erhalten, sondern Mitglieder mit einem Plus-Abonnement auch über ein höheres Nutzungskontingent verfügen.

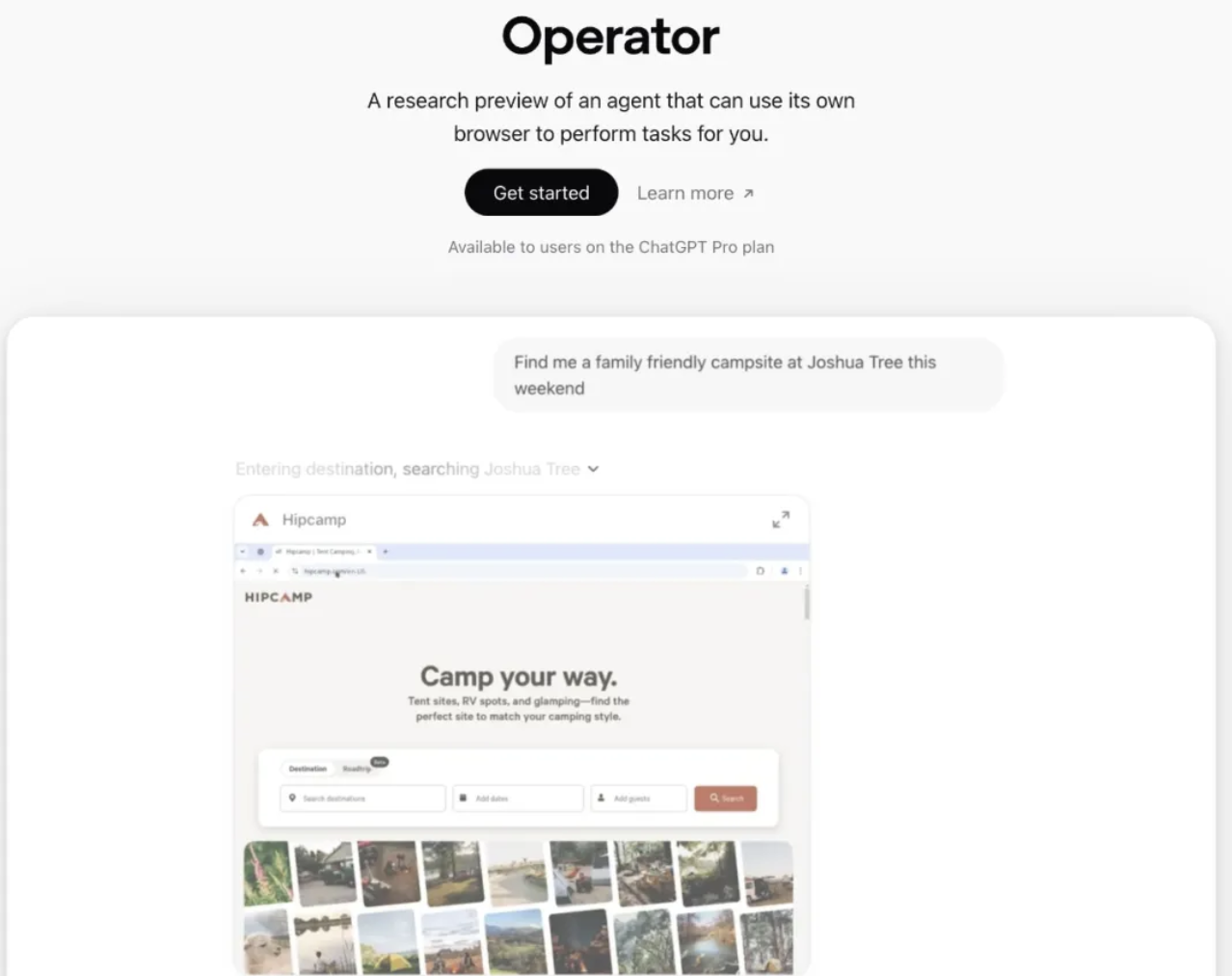

Das andere ist das offizielle Debüt des mit Spannung erwarteten ersten intelligenten Agentenprodukts, der Operator Research Preview. Die gute Nachricht ist, dass es Ihnen dabei helfen kann, automatisch online einzukaufen, aber die schlechte Nachricht ist, dass es möglicherweise einfacher ist, „umzudrehen“.

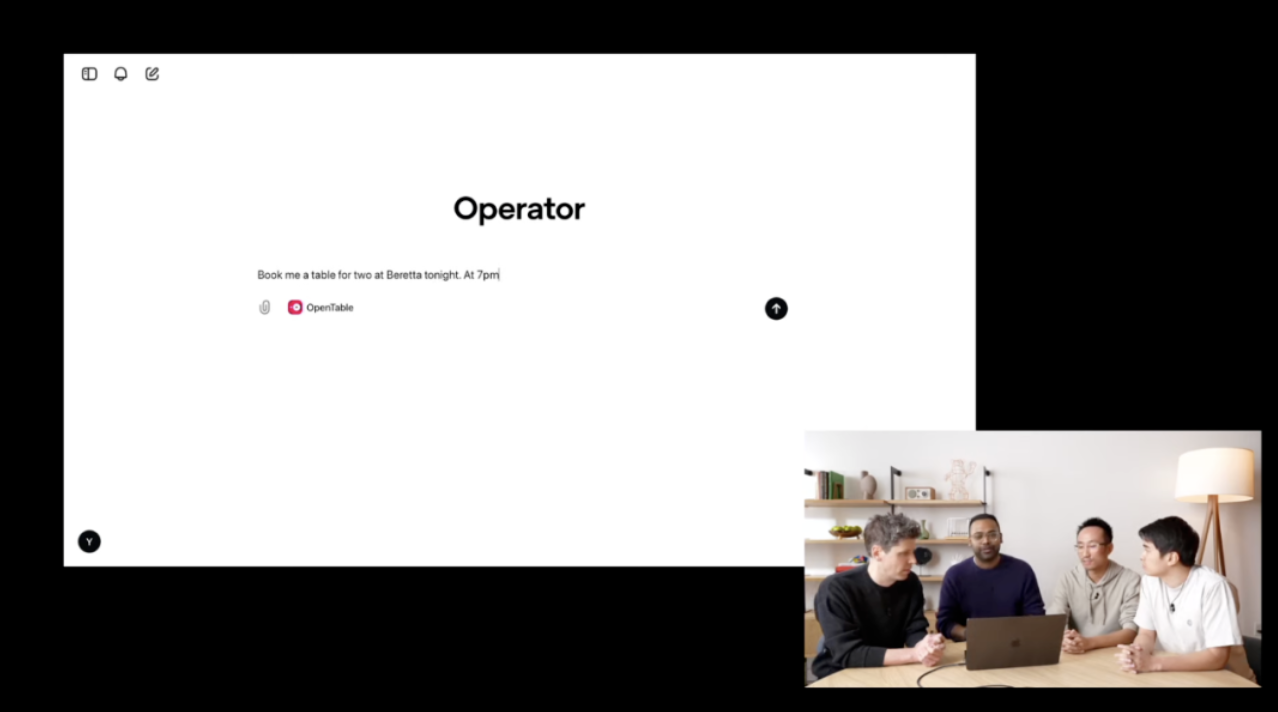

OpenAI-Präsident Greg Brockman postete auf der X-Plattform: „Operator – ein Agent, der seinen eigenen Browser verwenden kann, um Aufgaben für Sie auszuführen. 2025 wird das Jahr des Agenten sein.“

OpenAI ermöglicht es der KI, zu lernen, „Computer zu benutzen“? Dies ist der erste Schritt in Richtung AGI

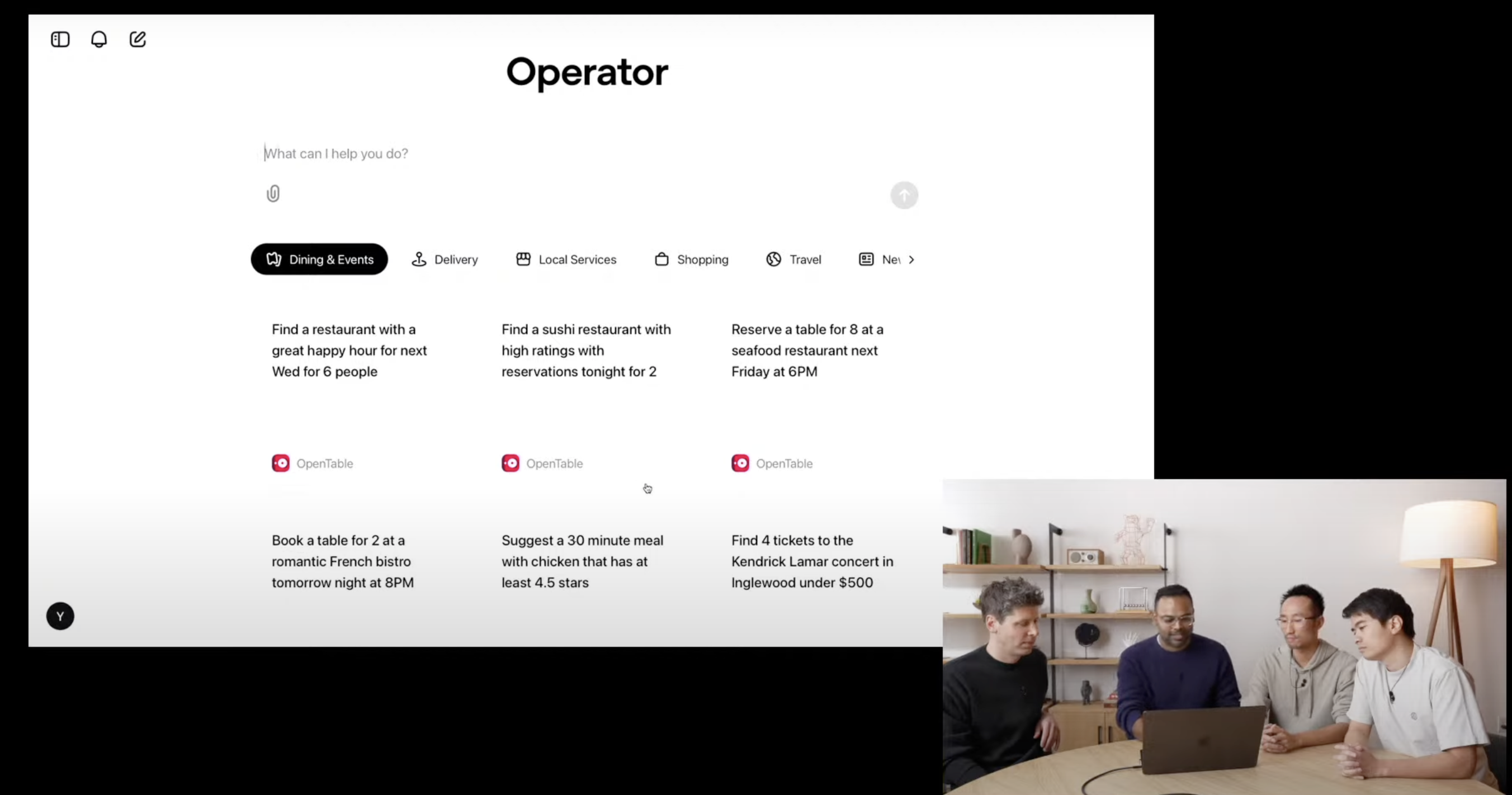

Als erster KI-Assistent von OpenAI, der tatsächlich die Bedienung eines Webbrowsers durch Menschen simuliert, kann Operator komplexe Aufgaben wie die Buchung von Reiseunterkünften, Restaurantreservierungen und Online-Einkäufe automatisch erledigen.

Benutzer können verschiedene Automatisierungsaufgaben in mehreren Kategorien auswählen und Bereiche wie Einkaufen, Lieferung, Essen und Reisen abdecken.

Diese Funktion steht zunächst US-Benutzern zur Verfügung, die den 200-Dollar-Pro-Plan abonnieren, und wird nach und nach auf Benutzer der Stufen Plus, Team und Enterprise ausgeweitet.

Die API wird voraussichtlich innerhalb weniger Wochen verfügbar sein.

Benutzer können über Operator.chatgpt.com auf den Dienst zugreifen. OpenAI plant, ihn in Zukunft in ChatGPT zu integrieren. Allerdings ist ChatGPT heute Morgen erneut zusammengebrochen.

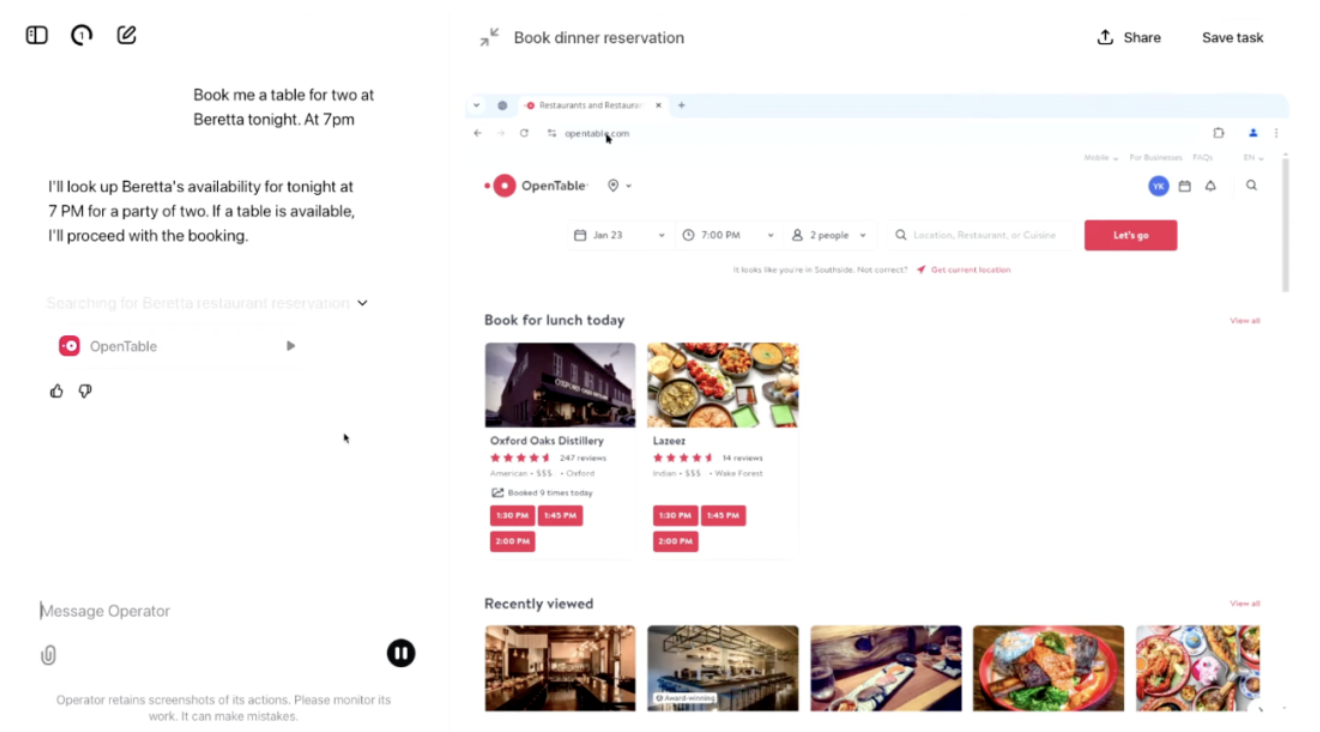

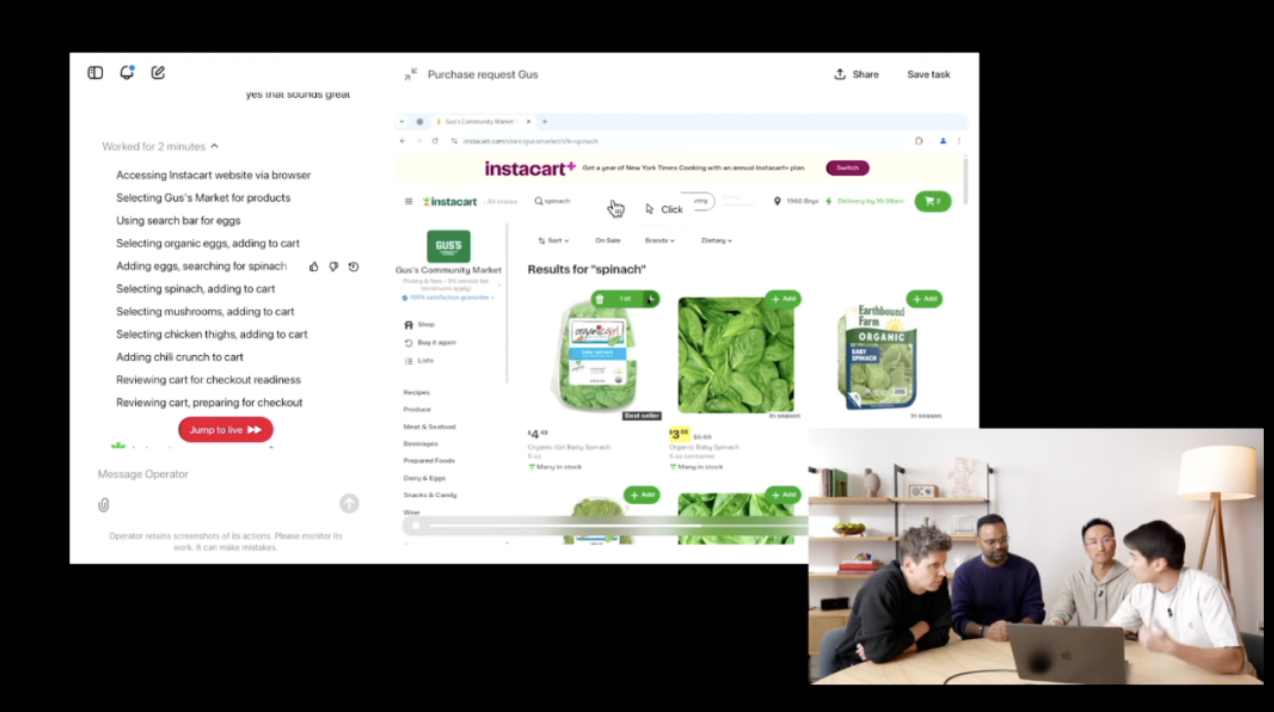

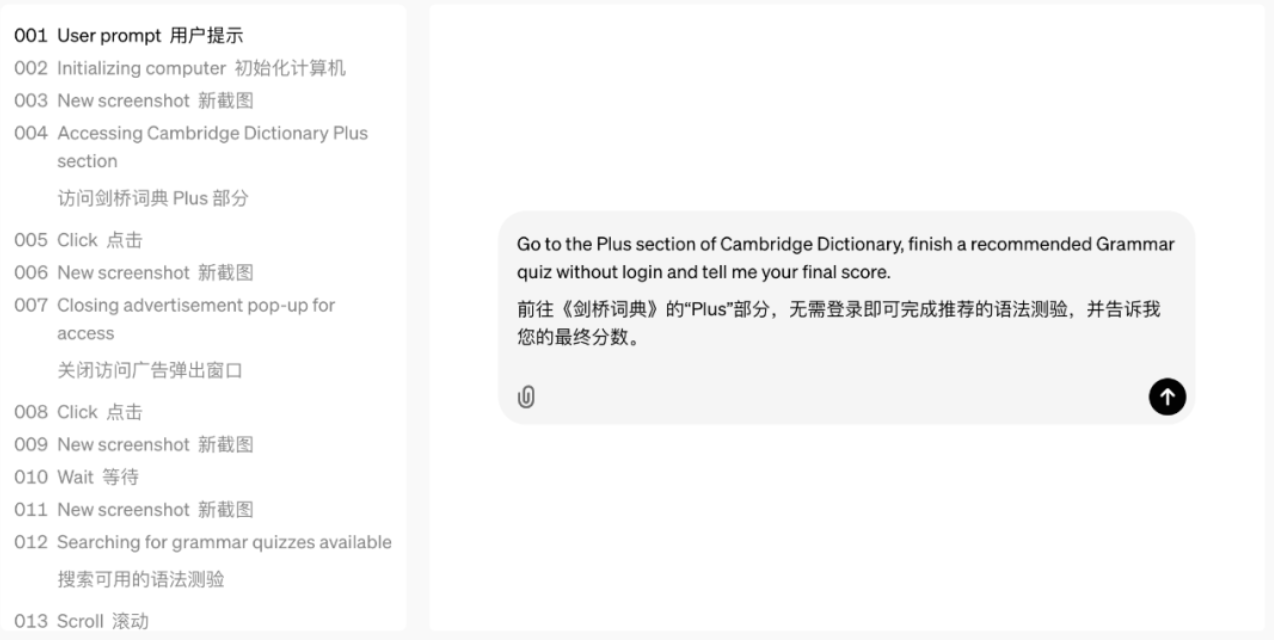

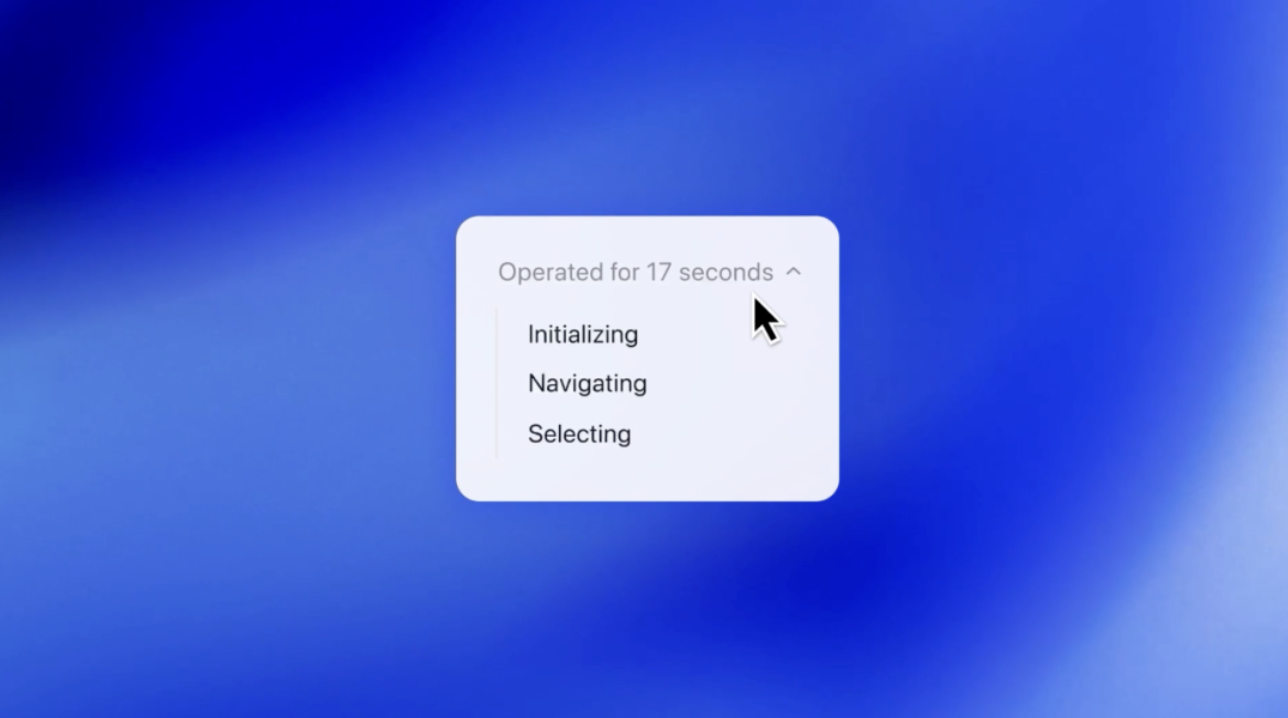

Einfach ausgedrückt: Wenn der Benutzer den Operator aktiviert, öffnet das System ein kleines Fenster, um die Bedienoberfläche des dedizierten Webbrowsers anzuzeigen und die ausgeführten Aufgaben in Echtzeit zu erklären. Während dieser Zeit ist es dem Benutzer jederzeit gestattet, die Kontrolle zu übernehmen.

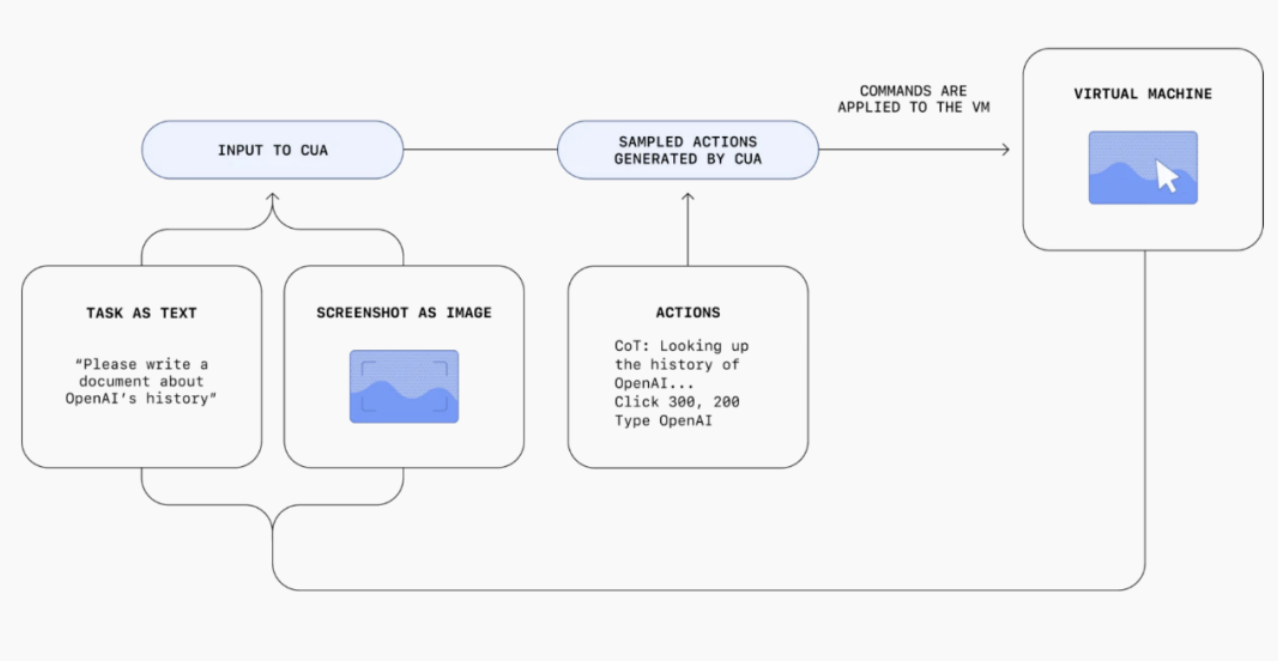

Auf technischer Ebene verwendet der Operator einen Remote-Cloud-Browser, um Aufgaben auszuführen, ohne auf Website-APIs angewiesen zu sein.

Es identifiziert Schnittstellenelemente anhand von Screenshots, plant Folgeaktionen und bildet einen geschlossenen Kreislauf aus „Beobachtung, Planung und Ausführung“, bis die Aufgabe abgeschlossen ist. Das System unterstützt die Parallelverarbeitung mehrerer Aufgaben, weist eine hohe Betriebseffizienz auf und kann den Anmeldestatus beibehalten.

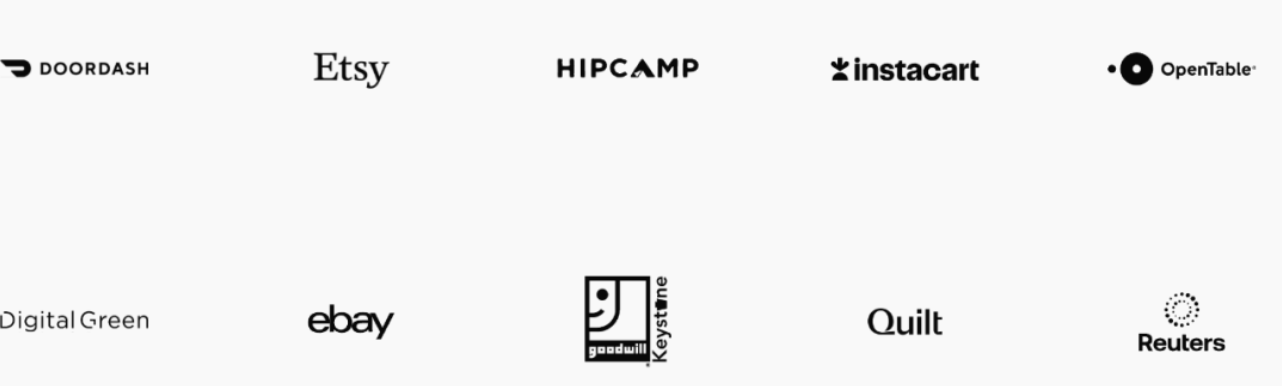

OpenAI hat mit Unternehmen wie DoorDash, Instacart, Priceline, StubHub und Uber zusammengearbeitet.

Daniel Danker, Chief Product Officer von Instacart, betonte: „Der Operator von OpenAI ist ein technologischer Durchbruch, der Prozesse wie die Bestellung von Lebensmitteln extrem vereinfacht.“

Wie üblich hielt OpenAI zeitgleich auch eine Pressekonferenz ab. Sam Altman schließt sich Yash Kumar, Casey Chu und Reiichiro Nakano an, um den Operator vorzustellen und zu demonstrieren.

Die Demonstration umfasste mehrere praktische Anwendungsszenarien, beispielsweise die Reservierung eines Sitzplatzes für zwei Personen im Restaurant Beretta über OpenTable. Der ursprüngliche 7-Uhr-Slot war nicht verfügbar und wurde dann auf 7:45 Uhr umgebucht.

Verwenden Sie das Instacart-Einkaufssystem, um Ihre Einkaufsliste zu identifizieren – Eier, Spinat, Pilze, Hähnchenkeulen, Kartoffelchips – und übernehmen Sie, um unterwegs weitere Eier und mehr hinzuzufügen.

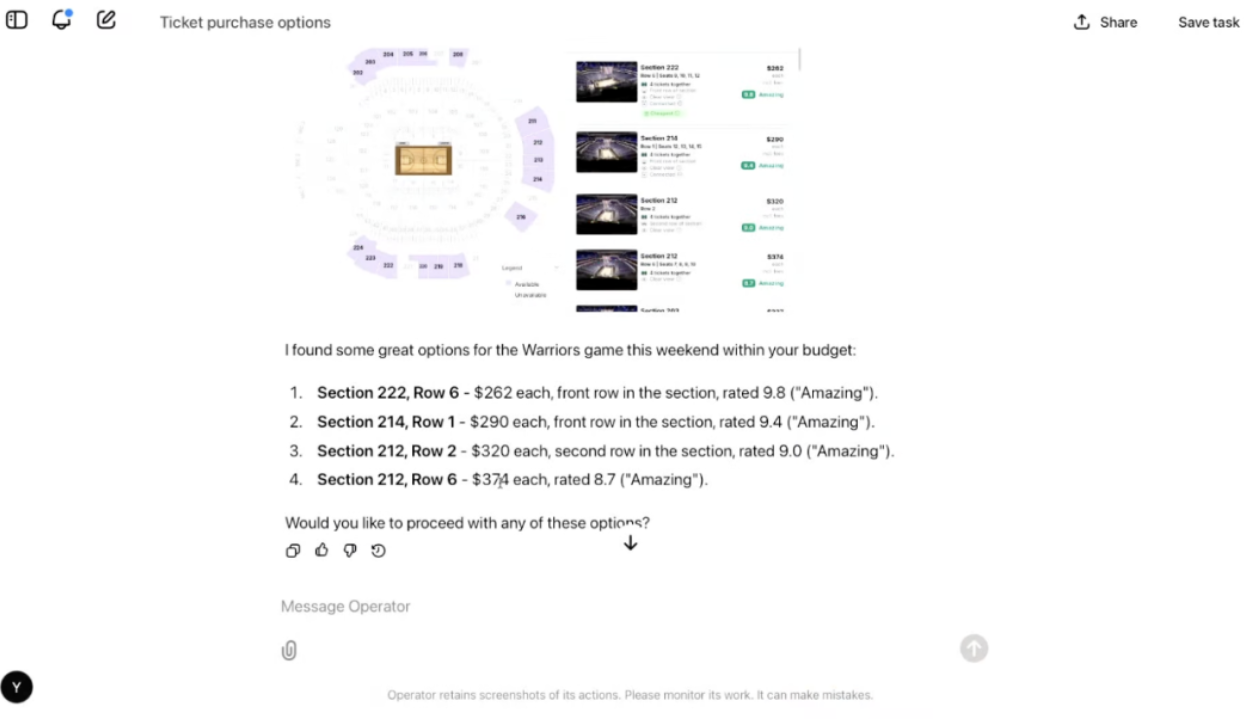

Suchen und kaufen Sie Warriors-Spielkarten unter einem Budget von 500 US-Dollar auf StubHub. Buchen Sie Reinigungsdienste und bestellen Sie Essen, BBQ-Pizza und mehr über DoorDash.

Das Ideal ist schön, aber die Realität ist sehr dürftig. Das größte Problem von Operator ist derzeit, dass es nicht stabil genug ist. Die Demonstration verlief zu Beginn reibungslos, kam jedoch in der mittleren und späteren Phase der Demonstration zu einer Reihe von „Überschlägen“ und es gelang nicht einmal, die relevanten Webseiten erfolgreich zu laden.

Vielleicht um den Erfolg der Demonstration sicherzustellen, wurden die Aufforderungsworte des Moderators immer länger.

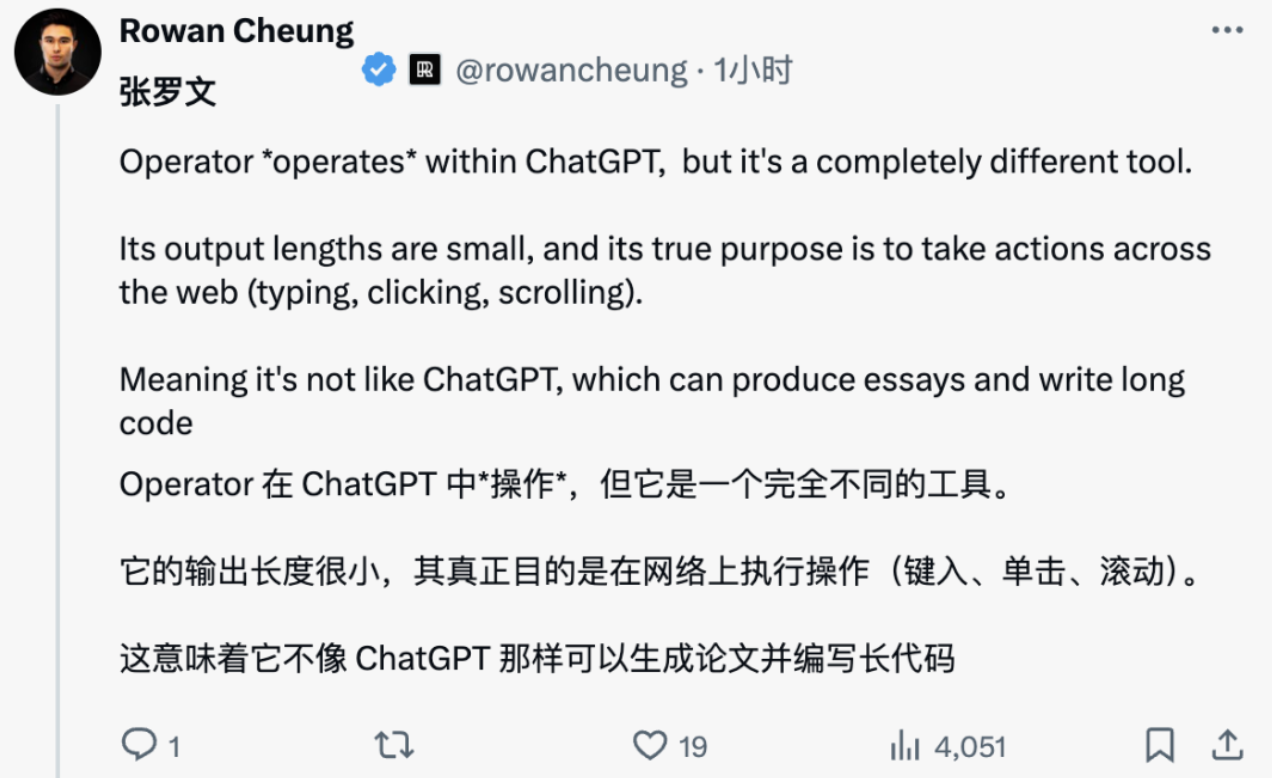

Der X-Plattform-Promi @rowancheung hat seine Beobachtungen ebenfalls vorab auf Operator miterlebt und geteilt.

Obwohl Operator beispielsweise in ChatGPT ausgeführt wird, sind seine Funktionen völlig unterschiedlich. Er konzentriert sich hauptsächlich auf Webseitenvorgänge (Klicken, Scrollen, Tippen) und nicht auf die Generierung von Langtext. Es gibt immer noch Einschränkungen im System, einschließlich einiger Websites, die den KI-Zugriff und die Integration von Kommanditisten blockieren.

Er wies darauf hin, dass Operator bestimmte Nutzungsmethoden benötigt, um den Effekt zu optimieren, genau wie GPT-4 für CoT-Eingabeaufforderungen geeignet ist, die aktuelle Forschung zur besten Nutzung von Operator jedoch noch vorläufig ist.

Er ist jedoch weiterhin optimistisch, dass diese Technologie den Menschen dabei helfen kann, langweilige Aufgaben zu automatisieren, sodass sie ihre Zeit für wichtigere Dinge nutzen können.

Zuvor wurde berichtet, dass der vom Betreiber bei der Ausführung von Aufgaben verwendete Screenshot-Inhalt möglicherweise in böswilliger Absicht verwendet wird, was zu „Prompt-Injection-Angriffen“ führt und ernsthafte Sicherheitsrisiken mit sich bringt.

Daher hat die Gewährleistung des sicheren Einsatzes von Bedienern höchste Priorität.

Laut dem offiziellen Blog verwendet OpenAI hauptsächlich mehrere Schutzmaßnahmen, um Missbrauch zu verhindern und sicherzustellen, dass Benutzer den Betreiber streng kontrollieren.

- Übernahmemodus: Der Betreiber fordert den Benutzer auf, die Eingabe vertraulicher Informationen im Browser, wie z. B. Anmeldeinformationen oder Zahlungsinformationen, zu übernehmen. Im Übernahmemodus sammelt der Betreiber die vom Benutzer eingegebenen Informationen nicht und macht auch keine Screenshots davon.

- Benutzerbestätigung: Der Betreiber sollte die Genehmigung einholen, bevor er eine wesentliche Aktion durchführt (z. B. das Absenden einer Bestellung oder das Versenden einer E-Mail).

- Aufgabeneinschränkungen: Mitarbeiter werden darin geschult, bestimmte sensible Aufgaben abzulehnen, z. B. Bankgeschäfte, oder Aufgaben, die Entscheidungen mit hohem Risiko erfordern, z. B. die Entscheidung über eine Bewerbung.

- Überwachungsmodus: Auf besonders sensiblen Websites wie E-Mail- oder Finanzdiensten muss der Betreiber sein Verhalten genau überwachen, damit Benutzer mögliche Fehler direkt erkennen können.

Darüber hinaus hat OpenAI umfassende Datenschutz- und Sicherheitsschutzmaßnahmen für den Betreiber implementiert. Im Hinblick auf die Datenschutzverwaltung können Benutzer das Modelltraining beenden, Browserdaten und historische Konversationen mit einem Klick löschen und sich von allen Websites abmelden.

Um Angriffe von bösartigen Websites zu verhindern, hat das System einen mehrschichtigen Abwehrmechanismus eingerichtet, der das Erkennen und Ignorieren sofortiger Injektionen, die Überwachung verdächtiger Verhaltensweisen und die Einrichtung einer Pipeline zur Bedrohungserkennung umfasst. Gleichzeitig verfügt der Betreiber über ein Prüfsystem, um schädliche Anfragen und unangemessene Inhalte abzulehnen und bei Verstößen Warnungen auszusprechen oder Zugriffsrechte zu entziehen.

Der „Erfahrungsbericht“ wurde angekündigt. Wie stark ist die CUA-Technologie hinter Operator?

Computer-Using Agent (CUA) ist die Kerntechnologie zur Unterstützung des Operators. Sie kombiniert die visuellen Erkennungsfunktionen von GPT-4o und erweiterte Argumentationsfunktionen auf der Grundlage von Reinforcement Learning.

CUA wurde darauf trainiert, die Fähigkeit zu beherrschen, wie ein Mensch mit grafischen Benutzeroberflächen (GUIs) zu interagieren und Schaltflächen, Menüs und Textfelder auf dem Bildschirm zu bedienen, ohne auf ein bestimmtes Betriebssystem oder eine Netzwerk-API angewiesen zu sein.

Es wird berichtet, dass seine Innovation in der Verwendung einer universellen Schnittstellenmethode liegt, die es der KI ermöglicht, verschiedene Softwaretools wie Menschen zu bedienen und so viele Nischenanwendungsszenarien zu durchbrechen, mit denen herkömmliche KI nur schwer zurechtkommt.

OpenAI räumte jedoch ein, dass es bei CUA noch viel Verbesserungsbedarf gibt. Beispielsweise ist es derzeit nicht in der Lage, einen stabilen Betrieb in allen Szenarien zu gewährleisten.

Das von OpenAI in Operator bereitgestellte CUA-System demonstriert die Leistung in verschiedenen Szenarien. Es schneidet beispielsweise bei grundlegenden Webvorgängen und sich wiederholenden Aufgaben wie Suchen und Filtern sowie dem Erstellen von Einkaufslisten und Musikwiedergabelisten gut ab, mit einer Erfolgsquote von 10/10.

Auch bei der Suche nach Produkten auf E-Commerce-Websites wird eine hohe Erfolgsquote von 9/10 erzielt. Bei Aufgaben wie der komplexen Immobiliensuche sinkt die Erfolgsquote jedoch auf 3/10.

Der Test ergab auch, dass die Qualität der Aufforderungsworte die Erfolgsquote der Aufgabe erheblich beeinflusst. Beispielsweise stieg die Erfolgsquote bei der Aufgabe zur Veranstaltungsortbuchung nach Hinzufügung spezifischer Zeit- und Betriebsrichtlinien von 3/10 auf 8/10.

Beim Umgang mit unbekannten Benutzeroberflächen und bei der Textbearbeitung kommt es häufig zu einer schlechten Leistung des Systems. Die Erfolgsquote bei Textbearbeitungsaufgaben beträgt nur 4/10.

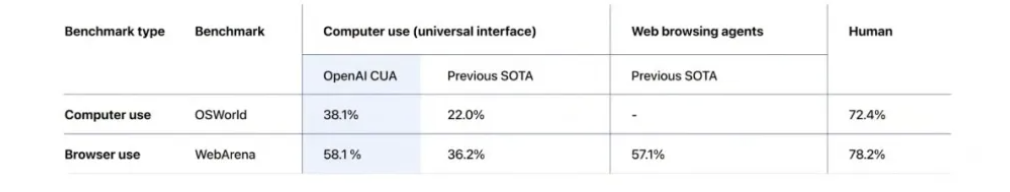

Um die Leistungsindikatoren des Betreibers besser quantifizieren zu können, erwähnten die Referenten der Konferenz auch den OS World-Test und den Web Arena-Test.

OS World wird verwendet, um die Navigationsfähigkeit von KI-Agenten auf Betriebssystemen wie Linux zu bewerten. Der Operator erzielte 38,1 %, was höher ist als bei anderen öffentlichen Systemen, aber niedriger als das menschliche Niveau (72,4 %).

Web Arena testet und bewertet die Navigationsfähigkeit von KI-Agenten auf E-Commerce-Websites und in sozialen Foren. Der Operator erzielte 58,1 %, was auch andere öffentliche KI-Systeme übertraf, aber hinter dem menschlichen Niveau zurückblieb.

Im Hinblick auf die Sicherheit wurden in der Demonstrationssitzung drei Hauptsicherheitsaspekte vorgestellt. Der erste besteht darin, dass das System die Ausführung schädlicher Aufgaben verweigert, ein Prüfmodell und eine anschließende Erkennung verwendet und bestimmte Websites blockiert.

Zweitens muss das System im Hinblick auf mögliche Fehler im Modell eine Benutzerbestätigung einholen, bevor es wichtige Vorgänge wie Käufe und Reservierungen durchführt, risikoreiche Aufgaben wie Banktransaktionen begrenzen und den Beobachtungsmodus auf sensiblen Websites aktivieren.

Speziell für gegnerische Angriffe auf Websites (z. B. Prompt-Injection, Jailbreaking und Phishing) hat das System einen vorsichtigen Navigationsmechanismus zum Erkennen und Ignorieren von Prompt-Injection, ein Echtzeit-Überwachungsmodell zur Erkennung verdächtiger Inhalte und eine Erkennungspipeline zur schnellen Identifizierung verdächtiger Inhalte entwickelt Zugriffsmuster.

Schließlich ist das System mit einem Injektionsmonitor (Prompt-Injection-Monitor) ausgestattet, der einer Antivirensoftware ähnelt. Das Echtzeit-Überwachungsmodell erkennt verdächtige Inhalte und unterbricht die Ausführung, wenn verdächtiges Verhalten entdeckt wird.

Da es unmöglich ist, alle Sicherheitsrisiken vorherzusehen, kann OpenAI nur mit einer Bereitstellung in kleinem Maßstab beginnen und den Sicherheitsmechanismus durch kontinuierliches Sammeln von Feedback verbessern.

Der Aufstieg von ChatGPT hat bewiesen, dass großartige Produkte oft aus unzähligen „unvollkommenen“ Versuchen entstehen.

OpenAI gibt auch offen zu, dass es sich bei dem derzeit von CUA unterstützten Operator nur um eine frühe Technologie handelt, obwohl sie sich in bestimmten Szenarien als nützlich erwiesen hat, sie jedoch durch Benutzerfeedback kontinuierlich verbessert werden muss.

Darüber hinaus planen sie, die Anpassungsfähigkeit des Systems an unbekannte Benutzeroberflächen zu verbessern, die Genauigkeit der Textbearbeitung zu verbessern, das Verständnis verschiedener Aufforderungswörter zu optimieren und das Spektrum zuverlässiger Aufgaben zu erweitern.

Altman sagte Anfang des Monats in einem Blogbeitrag, dass OpenAI zuversichtlich sei, allgemeine künstliche Intelligenz (AGI) aufzubauen, und prognostizierte, dass die erste Gruppe von KI-Agenten im Jahr 2025 „in die Arbeitswelt eintreten“ werde.

Einschließlich Zhipu kündigte gestern auch die Einführung von GLM-PC an.

Dies basiert auf CogAgent, einem großen multimodalen Modell von Wisdom Spectrum, und ist der weltweit erste öffentlich zugängliche, gebrauchsfertige Computeragent. Es kann Computer wie Menschen „beobachten“ und „bedienen“ und Benutzern dabei helfen, verschiedene Computeraufgaben effizient zu erledigen.

Es ist absehbar, dass diese intelligenten Agenten in Zukunft über starke autonome Entscheidungs- und Aufgabenausführungsfähigkeiten verfügen, in der Lage sein werden, komplexe Aufgaben zu bewältigen und in einigen Bereichen sogar menschliche Arbeit zu ersetzen und die Produktionsmethoden und den Output von Unternehmen grundlegend zu verändern.

In der fünfstufigen AGI-Roadmap von OpenAI befindet sich der Agent auf der L3-Ebene, die dadurch gekennzeichnet ist, dass er nicht nur denkt, sondern auch im Namen des Benutzers Maßnahmen ergreift und komplexe Aufgaben ausführt.

Aus dieser Sicht ist Operator nicht nur der erste Schritt für OpenAI-Agenten, sondern auch ein wichtiger Schritt in Richtung AGI.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr) wird Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo