Apples AI-Zusammenfassungsnachrichten sind ein Durcheinander, das besorgniserregender ist als „Clickbait“

Ich hätte nie gedacht, dass Apples KI eines Tages als „ Clickbait “ kritisiert werden würde. Das sind keine guten Nachrichten für Apple, das noch keine vollständige Version von Apple Intelligence auf den Markt gebracht hat.

Die tatsächliche Situation kann viel ernster sein als das harmlose Adjektiv „Clickbait“. Wenn die Schlagzeilenmacher nur Übertreibungen und aus dem Kontext gerissene Zitate verwenden, um Aufmerksamkeit zu erregen, kann man sagen, dass das, was Apple AI tut, „richtig und falsch verwechselt“.

Es muss klargestellt werden, dass die Verantwortung für dieses „Problem“ vollständig bei Apple AI liegt und nichts mit dem Zugriff auf ChatGPT zu tun hat.

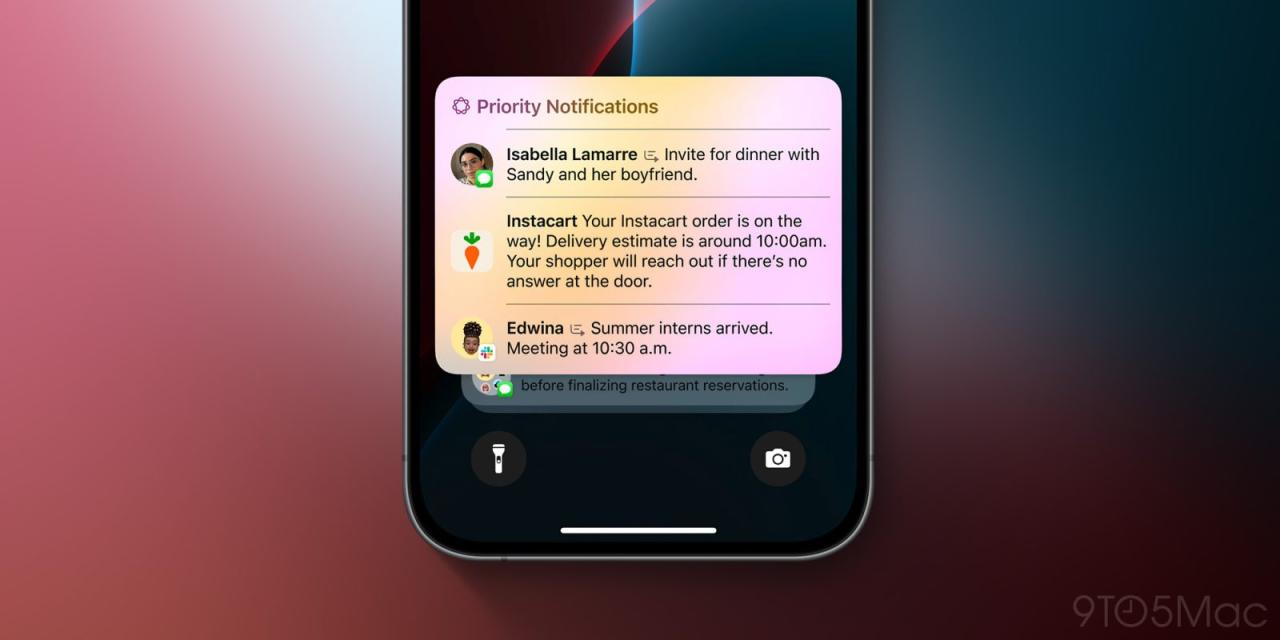

▲Bildquelle: 9TO5Mac

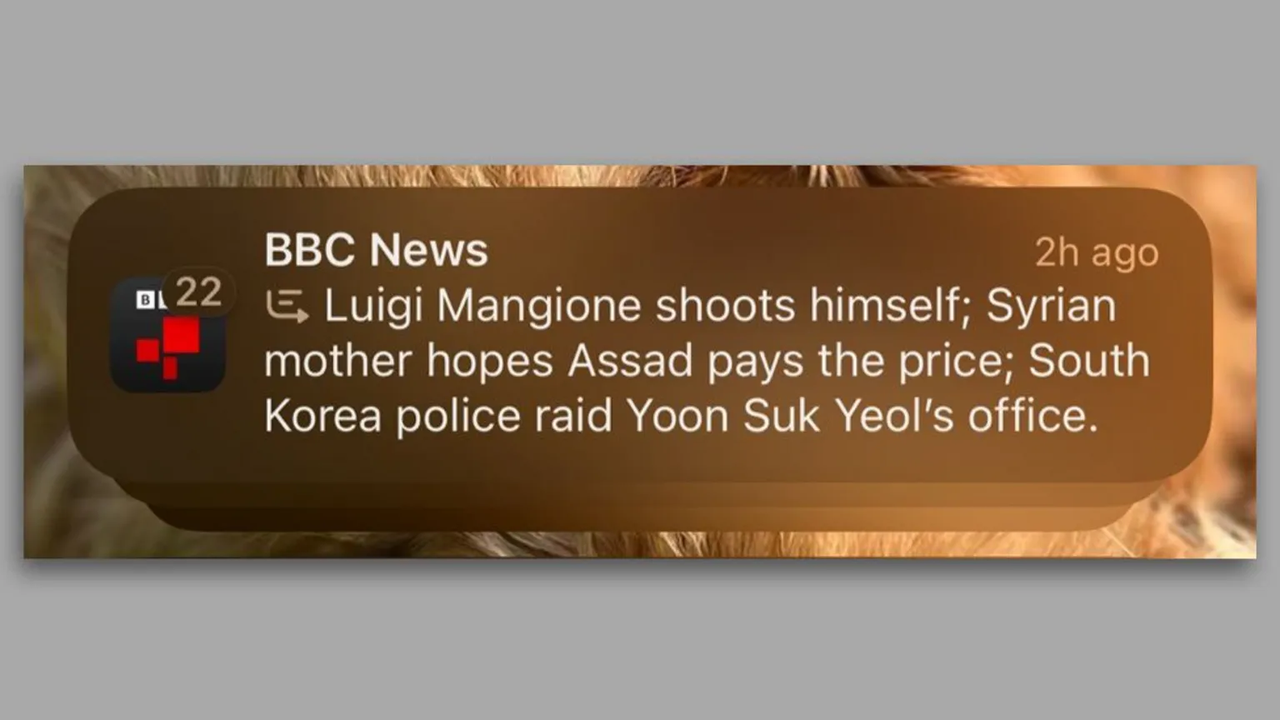

Kürzlich veröffentlichte die British Broadcasting Corporation (BBC) eine Reihe von Nachrichten und Folgeberichten über die Ermordung des CEO der UnitedHealth Insurance Company, Brian Thompson, durch Luigi Mangione, in der unter anderem die Anklage wegen Mordes ersten Grades erwähnt wurde.

Ein von der BBC bereitgestellter Screenshot zeigt jedoch, dass die von Apples KI-Zusammenfassung generierte Nachrichtenzusammenfassung „Luigi Mangione erschießt sich “ lautet. Das ist weit vom wahren Verlauf der Ereignisse entfernt: Berichten zufolge wird er immer noch in einem Gefängnis in Pennsylvania festgehalten.

Es ist so ungeheuerlich, so falsch.

▲Quelle: BBC

Als Reaktion auf diesen lächerlichen Fehler hat die BBC offiziell eine Beschwerde bei Apple eingereicht und Apple aufgefordert, Korrekturmaßnahmen zu ergreifen und zu verhindern, dass solche Fehler erneut auftreten. Ein Sprecher der BBC sagte, sie sei „den höchsten Maßstäben an Genauigkeit und Unparteilichkeit verpflichtet und bemühe sich, eine absichtliche und ernsthafte Irreführung unserer Leser zu vermeiden“.

Darüber hinaus forderte Reporter ohne Grenzen (RSF) Apple dazu auf, seine Fähigkeiten im Bereich der generativen künstlichen Intelligenz aufzugeben . Die Organisation sagte, der Vorfall mit der „falschen Schlagzeile“ zeige, dass „generative KI-Dienste noch zu unausgereift seien, um der Öffentlichkeit verlässliche Informationen bereitzustellen“.

Vincent Berthier, Leiter Technologie und Journalismus bei Reporter ohne Grenzen, sagte, KI sei eine Wahrscheinlichkeitsmaschine und Fakten könnten nicht durch Würfeln ermittelt werden. Er wies außerdem darauf hin, dass das europäische Gesetz zur künstlichen Intelligenz informationsgenerierende KI nicht als Hochrisikosystem einstuft und somit ein „schwerwiegendes Rechtsvakuum“ hinterlasse.

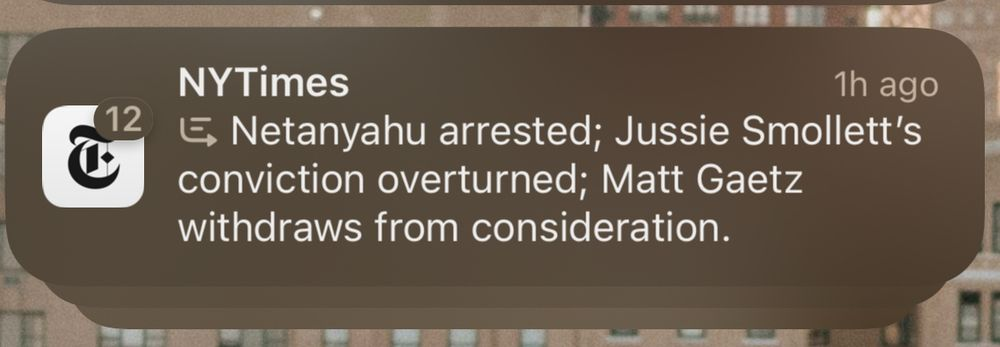

▲Bildquelle: Engadget

Tatsächlich ist dies nicht das erste Mal, dass Apples KI-Zusammenfassung „erfundene Nachrichten“ enthält. Letzten Monat hat ein Reporter namens Ken Schwencke von der amerikanischen investigativen Nachrichten-Website „ProPublica“ einen Screenshot auf Bluesky geteilt.

In der ersten Nachricht im Screenshot hieß es eindeutig: „ Netanyahu wurde verhaftet .“ In Wirklichkeit hat der Internationale Strafgerichtshof jedoch einen Haftbefehl gegen den israelischen Ministerpräsidenten Benjamin Netanyahu erlassen.

Dieser durch Apples KI stark verfälschte Bericht stammt von der New York Times (NYTimes), die sich bisher nicht zu der Angelegenheit geäußert hat.

▲Bildquelle: Bluesky

Die intelligente Zusammenfassungsgenerierungsfunktion von Apple Intelligence wird in der zweiten Hälfte dieses Jahres offiziell eingeführt. Die Absicht von Apple besteht darin, „durch sein tiefes Sprachverständnis dabei zu helfen, die Informationen zu verfeinern, die für Sie am wichtigsten sind, und Benachrichtigungen generieren Zusammenfassungen, sodass Sie wichtige Details auf einen Blick sehen können.“

Es scheint, dass das von Apple erwähnte „tiefe Sprachverständnis“ sehr wässrig zu sein scheint. Petros Iosifidis, Professor für Medienpolitik an der City University London, sagte, Apples Fehler sei „peinlich“.

Iofidis sagte auch, er sei „überrascht, dass Apple ein so offensichtlich unausgegorenes Produkt herausbringen würde.“ Obwohl die Technologie potenzielle Vorteile für die Zukunft bietet, besteht derzeit „die reale Gefahr der Verbreitung von Desinformation “.

▲Petros Iosifidis (Quelle: London City University)

Mit der heutigen Entwicklung der generativen KI-Technologie scheinen wir natürlich davon auszugehen, dass die Verwendung dieser Technologie zum Zusammenfassen eines Artikels für KI „ein Kinderspiel“ ist. Tatsächlich erfinden die meisten KI-Tools selten etwas, wenn sie verwendet werden, aber Missverständnisse oder das Herausreißen von Dingen aus dem Zusammenhang kommen häufiger vor.

Neben Apple versuchen auch Technologieunternehmen wie Google und Microsoft, die Technologie der künstlichen Intelligenz zu nutzen, um Nachrichten zu klassifizieren, zu sortieren und zusammenzufassen. Obwohl solche KI-Tools das Benutzererlebnis verbessern können, können sich die daraus resultierenden „ Missverständnisse “ exponentiell ausbreiten, wenn sie ohne menschliches Eingreifen Fehler machen.

▲Bildquelle: Mittel

Obwohl KI in den meisten Szenarien bereits hervorragende Arbeit bei der Verbesserung der Arbeitseffizienz leisten kann, ist die Fehlerwahrscheinlichkeit keineswegs gleich null. Daher müssen wir fast die einzige Wahl treffen zwischen „ das Risiko von Fehlern eingehen “ und „ den Komfort der KI genießen “.

Das nächste Mal müssen wir „die Augen offen halten“ für alle Informationen in den sozialen Medien.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo