Auf einem Laptop laufen zig Milliarden Modelle? Kein Problem hier bei AMD

Auf dem Weg zum KI-PC hat jedes Chip- und Ausrüstungsunternehmen Angst, ins Hintertreffen zu geraten.

In diesem Wettbewerb liegt das Apple-Ökosystem derzeit mit großem Abstand an der Spitze. In der Mac Studio-Bewertung von letzter Woche hat Ai Faner die quantitativen Versionen 671B und 70B von DeepSeek Q4 erfolgreich lokal bereitgestellt und ausgeführt.

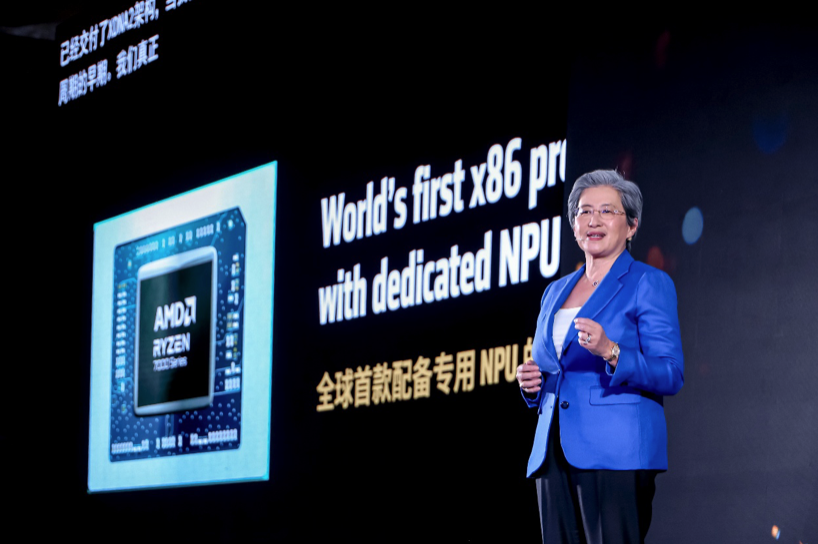

Auf der Seite des x86-Lagers versucht AMD, das derzeit wettbewerbsfähigste „Team“, das Überholen zu beschleunigen.

Auf dem AMD AI PC Innovation Summit am 18. März demonstrierte Jack Huynh, Senior Vice President und General Manager für Computer und Grafik des Unternehmens, die Fähigkeit, große DeepSeek-Modelle auf AMD-basierten Laptops auszuführen.

Laut der Vor-Ort-Demonstration lief auf einem Laptop mit AMD Ryzen AI Max+ 395-Prozessor das große Modell DeepSeek-Tongyi Qianwen Fusion 7B erfolgreich. Die Token-Geschwindigkeit pro Sekunde wurde nicht veröffentlicht, aber basierend auf den Ergebnissen von Beobachtungen vor Ort mit bloßem Auge und unseren bisherigen Erfahrungen mit Tests an verschiedenen Modellen sollte die Geschwindigkeit vor Ort mindestens 15 Token/s betragen.

Es ist zu beachten, dass diese Bereitstellungs- und Betriebsergebnisse laut dem Demobereich vor Ort auf der AMD StrixHalo LLM-Software basieren, einer von AMD entwickelten großen Modellbetriebsumgebung. Nach unserem Verständnis besteht die Logik dahinter einfach darin, dass AMD die unterstützten großen Modelle intern optimiert, um die Kosten für die Aktivierungsparameter des Einheits-Tokens deutlich zu reduzieren, und dann die Supportfunktionen auf dem lokalen Gerät des Benutzers implementiert.

Die Ryzen AI Max-Prozessorfamilie selbst unterstützt auch höhere Grafikspeicherzuweisungsfunktionen. Wir haben vor Ort gesehen, dass AI Max bis zu 96 GB Videospeicherzuweisung unterstützt, sodass die prozessorintegrierte Grafik die Leistung erhalten kann, die nur von unabhängigen High-End-Grafikkarten erreicht werden kann. Diese Leistung kann für KI-Training und Inferenzberechnungen sowie für Spiele verwendet werden.

Nach der Optimierung besteht kein Grund zur Sorge, egal wie groß die Anzahl der Parameter ist. Im Beispiel im Demobereich sehen wir, dass der gleiche oben erwähnte Chip bis zum großen Sprachmodell Llama 3.1 70B laufen kann, das von Meta auf dem ASUS ROG Magic X 2025-Laptop entwickelt wurde.

Obwohl die Anzahl der Parameter enorm ist, waren die Hardwareanforderungen in der Vergangenheit extrem hoch und übertrafen die kognitive Obergrenze der bisherigen Industrie für die lokalen Argumentationsfähigkeiten mobiler Computergeräte bei weitem – Laptops können jetzt problemlos und problemlos große Modelle mit Dutzenden Milliarden Parametern ausführen.

Ziel von AMD ist es, sicherzustellen, dass auf großen Modellen basierende Unternehmensanwendungen und wissenschaftliche Forschungsfunktionen auf x86-Notebooks und noch leichtere mobile Computergeräte ausgeweitet werden können. Derzeit unterstützt die AMD AI PC-Umgebung große Modelle der Mainstream-Modelle wie DeepSeek 1.5B und 7B.

Wenn das Notebook nicht ausreicht, stellt AMD echten Hochleistungsanwendern auch eine Serverlösung zur Verfügung, auf der das DeepSeek R1-Vollparameter-Großmodell ausgeführt werden kann, was Nvidia einen Schritt voraus ist (Letzteres wird möglicherweise morgen früh sein modulares AI-Computing-Cluster-Produkt aktualisieren).

Vor Ort wurden zwei verschiedene Lösungen vorgeführt. Eine davon ist AMDs eigene Lösung, die auf dem vllm-Framework basiert und 8 x W7900/78000-Grafikkarten verwendet, die vollständig offline und lokal eingesetzt werden können, um die unternehmensinterne Forschung und Entwicklung sowie die geistigen Eigentumsrechte zu schützen.

Die zweite Lösung ist die von AMD und Phison Electronics gemeinsam entwickelte aiDAPTIV+-Lösung. Die allgemeine Logik besteht darin, der Grafikkarte die Erweiterung ihres Speichers durch NAND-Flash-Speicher zu ermöglichen und so den Videospeicherengpass einer einzelnen Karte zu beseitigen. Mit vorhandenen AMD-Grafikkarten können die vollständigen Trainingsmöglichkeiten des DeepSeek 671B auf Parameterebene auch in einer eigenständigen Form realisiert werden.

Natürlich sind die meisten Menschen nur reine KI-Anwendungsnutzer und keine Entwickler. Daher arbeitete AMD auf diesem Gipfel auch mit OEM-Partnern zusammen, um verschiedene Mainstream-Formen von KI-Anwendungen für Verbraucher zu demonstrieren.

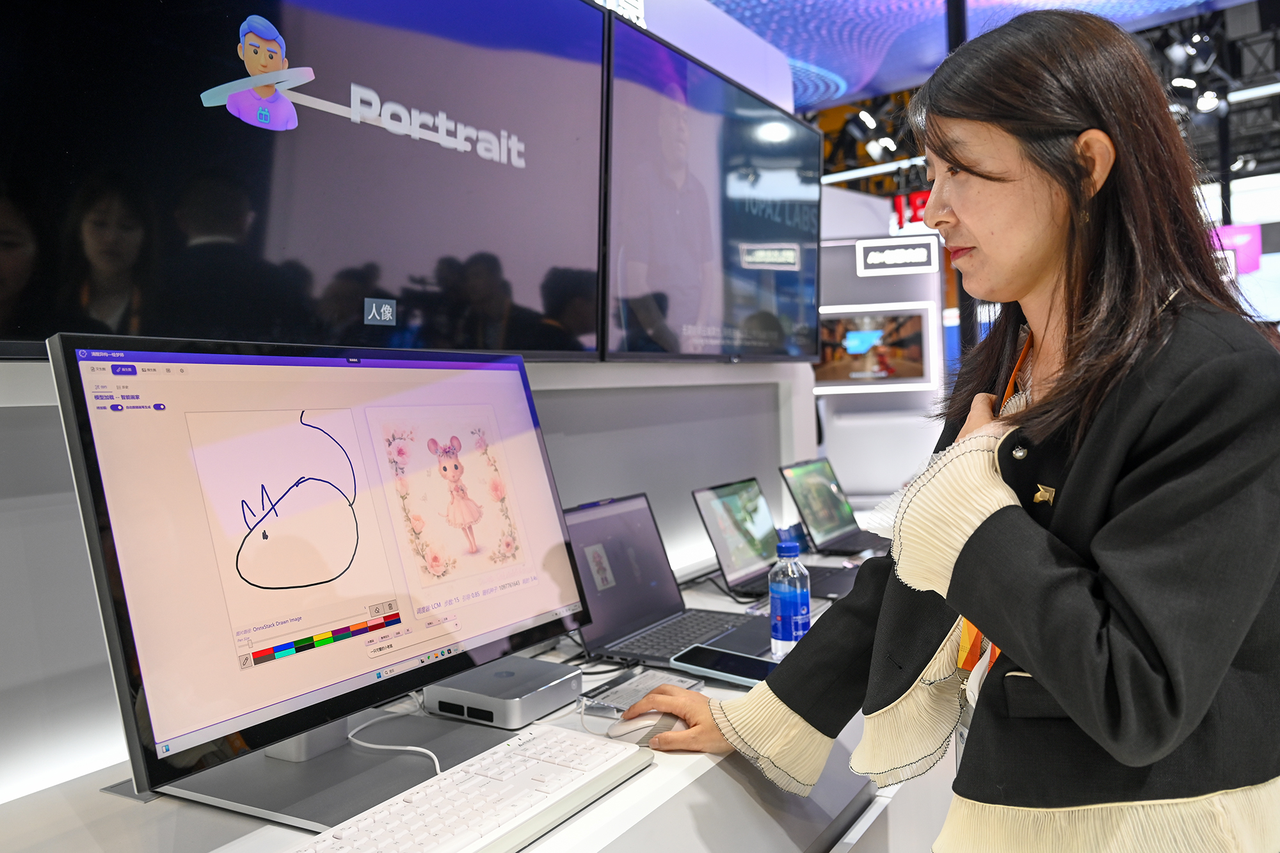

Sehr interessant ist eine der Demos vor Ort, bei der es sich um ein großes Modellbild-Generierungstool „Dream Painter“ handelt, das von Lucid Heterogeneous entwickelt wurde und auf der AMD Ryzen AI-Plattform basiert. Es unterstützt die Generierungsmodi von Zeichnungen, Zeichnungen und Zeichnungen und kann lokal ausgeführt werden, ohne dass eine Internetverbindung erforderlich ist.

Ein weiteres Beispiel ist die von Lenovo angezeigte persönliche Intelligenz „Xiaotian“, die als KI-Portal für den PC dient. Das große Modell dahinter kann auf der Grundlage persönlicher Daten trainiert und optimiert werden und verfügt über die Fähigkeiten der Aufgabenzerlegung und -planung, der natürlichen Interaktion, des Langzeitgedächtnisses und des Tool-Aufrufs am Frontend.

Im vergangenen Jahr hat sich die KI-Technologie extrem rasant weiterentwickelt, die Obergrenze der Fähigkeiten wurde kontinuierlich erhöht und auch die Möglichkeiten für große Modelle sind von Tag zu Tag gewachsen. Allerdings steht die PC-Branche aufgrund der lokalen Rechenfähigkeiten des Geräts auch vor großen Herausforderungen.

Angesichts der Tatsache, dass sein größter Konkurrent derzeit mit nichttechnischen Schwierigkeiten konfrontiert ist, ist AMD als weiterer führender Hersteller der zugrunde liegenden Computertechnologie im x86-Lager davon überzeugt, dass es seiner Verantwortung gerecht werden, Herausforderungen meistern und Veränderungen anführen muss, damit KI über KI-PCs wirklich in Tausende von Haushalten und Branchen Einzug halten kann.

Auf dem Gipfel bot AMD OEM-Partnern eine großartige Gelegenheit, sich zu präsentieren. Ökologische Partner wie Microsoft, Lenovo, Asus, Acer, HP und andere haben neue PC-Produkte auf Basis der neuesten AMD Ryzen AI-Prozessorfamilie vorgestellt.

Die große Auswahl an KI-PC-Marken und -Modellen, die Rechenfähigkeiten des KI-PC-Produkts selbst für große Modelle und die Fülle an Anwendungen in verschiedenen Verbraucherszenarien sind für PC-Marken und Chiphersteller besonders wichtig, um ihren Marktanteil im KI-Zeitalter zu behaupten.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr) wird Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo