Ausführliche Interpretation von Vision Pro: 18 Details, die Apple auf der Pressekonferenz nicht gesagt hat

Stellen Sie sich vor, in welcher Körperhaltung werden Sie diesen Artikel in weiteren 5 Jahren lesen?

An einem Computertisch sitzen und mit der Maus durch Seiten scrollen? Wischen Sie mit dem Finger über den Bildschirm, während Sie in der U-Bahn stehen?

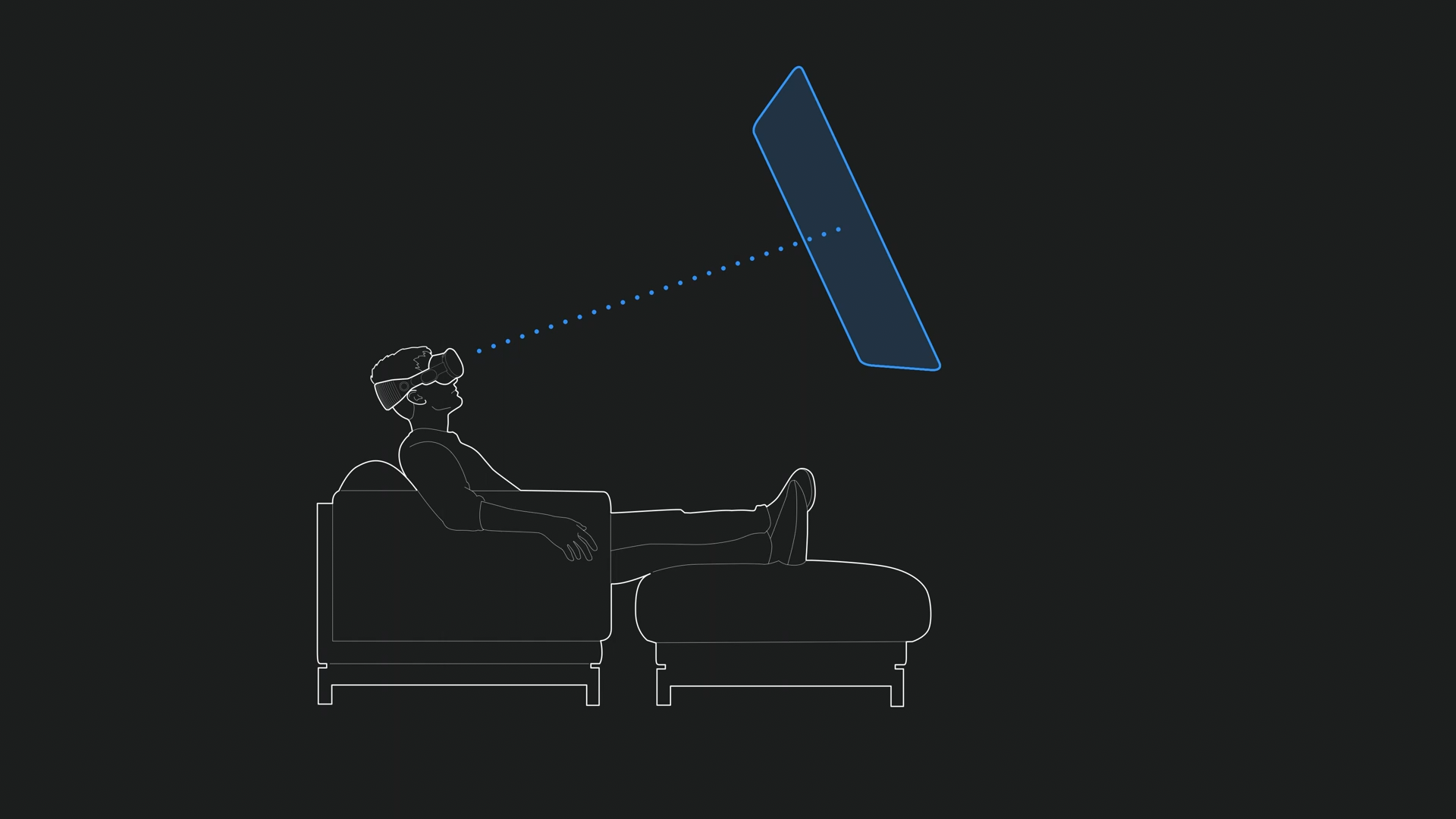

Sie tragen immer noch ein Headset und liegen bequem auf dem Sofa. Ein virtueller 100-Zoll-Großbildschirm hängt vor Ihnen, Ihre Hände liegen lässig auf Ihrem Schoß und die Webseite scrollt mit einer Fingerbewegung.

Das Aufkommen von Apple Vision Pro hat diese Szene von einer Science-Fiction-Phantasie in eine absehbare zukünftige Realität verwandelt, und wir stehen an einem Wendepunkt von der Ära des mobilen Computings zur Ära des Weltraum-Computings.

Der hohe Preis von Vision Pro ist nicht dazu gedacht, ein Produkt für die Öffentlichkeit zu sein, was auch bedeutet, dass es für uns schwierig ist, das audiovisuelle Erlebnis der nächsten Ära persönlich zu erleben.

Wir können jedoch einige Details zum Systemdesign im offiziellen Entwicklungsleitfadenkurs von Apple finden, die uns helfen können, den Unterschied zwischen „Spatial Computing“ und der von uns gewohnten Mobiltelefon- und Computererfahrung zu verstehen.

Bevor wir beginnen, wollen wir kurz verstehen, was für ein Gerät Vision Pro ist:

Vision Pro verfügt über 12 externe Kameras und 5 Sensoren, die den realen Raum vor Ihnen erfassen, die Tiefeninformationen aufzeichnen und in ein räumliches Bild umwandeln können.

Dann können Sie über den integrierten ultrahochauflösenden Micro-OLED-Bildschirm (23 Millionen Pixel für beide Augen) Bilder sehen, die der realen Welt nahe kommen.

Vision Pro ist weder AR noch reine VR. Es vermischt Virtualität und Realität. Alle realen Bilder werden in Echtzeit gesammelt und gerendert, sodass Sie problemlos zwischen virtuellen und realen Bildern wechseln können. Aus diesem Grund definiert Apple es als räumliches Rechengerät – Ihr Raum, Ihr gesamter Raum ist die Schnittstelle.

Nachdem wir diesen Punkt geklärt haben, können wir die Logik von Apple beim Entwurf des Systems relativ einfach verstehen.

Beginnen wir mit der ersten Schnittstelle, die Sie sehen, wenn Sie Vision Pro aufsetzen.

Weltraumschnittstelle

Vom Flugzeug umgestaltetes Fensterdesign

Auf den ersten Blick sieht die Vision OS-Oberfläche nicht so Science-Fiction aus wie die gesamte Bedienoberfläche in „Iron Man“ und anderen Filmen. Es ist ein sehr einfaches Fenster.

Dabei handelt es sich um ein bewusstes Design von Apple, das als „Vertrautheit“ bezeichnet wird. Dies liegt daran, dass die Fensteroberfläche eine interaktive Oberfläche ist, die die meisten Menschen sofort verstehen und schnell loslegen können. Sie klicken instinktiv auf das Suchfeld, um zu suchen, und finden das Kategorieverzeichnis in der Spalte, und es fallen fast keine Lernkosten an.

Dies ist besonders wichtig für eine brandneue Schnittstelle.

Drei grundlegende Operationen des Fensters

Das Fenster sprang aus dem Bildschirm und kam in Ihr Zimmer, und es gab einige Änderungen in der Interaktion.

Apple hat die Schaltfläche „Schließen“, die Ziehleiste und die Zoom-Schaltfläche neu gestaltet, wobei die Schaltfläche „Schließen“ und die Ziehleiste unten in der Mitte des Fensters angeordnet sind.

Behalten Sie die Ziehleiste im Auge (mit Eye-Tracking im Inneren), und mit einer Prise können Sie das Fenster an die gewünschte Stelle ziehen.

Zoom-Schaltflächen befinden sich in den Ecken der Fenster und werden angezeigt, wenn Sie darauf blicken, die gleichen Finger, die die Fenstergröße ändern.

Fenster, das sich mit dem Inhalt ändert

Wenn Sie sich von den Zwängen des Bildschirms lösen, kann das Fenster unendlich groß werden, bis es den gesamten Raum in 360 Grad ausfüllt, und es kann auch klein genug werden, um auf Ihrer Handfläche zu schweben.

Zu diesem Zeitpunkt sollte die Größe des Fensters durch den angezeigten Inhalt bestimmt werden. Wenn Sie beispielsweise Safari zum Surfen im Internet verwenden, sollte das Fenster schlanker sein, wodurch Keynote voluminöser wird, und wenn Sie Keynote anzeigen oder Videos ansehen, sollte dies der Fall sein etwas größer sein.

Kurz gesagt, im Weltraum sind Fenster sehr flexibel und veränderbar, was den größten Unterschied zur Ebeneninteraktion darstellt.

Neu gestaltete Fensteroberfläche

Da die Aufmerksamkeit des Benutzers eher auf den Raum abgelenkt wird, hat Apple die Fensteroberfläche neu gestaltet und beispielsweise die Inhaltsleiste und die Betriebsleiste getrennt, damit sich Benutzer auf den Inhalt konzentrieren können.

Beim Ansehen eines Films oder beim Anzeigen von Keynote ist die Steuerleiste ebenfalls getrennt und befindet sich näher am Benutzer als die Wiedergabeoberfläche, sodass der Benutzer die Benutzeroberfläche einfacher bedienen kann.

Fenster, die sich mit Ihnen bewegen

Das Head-Mounted-Display ist ein äußerst mobiles Gerät. Nutzer können in verschiedenen Haltungen und Winkeln surfen, etwa im Stehen, Sitzen und Liegen. Daher sollte sich das Fenster an die Blickrichtung des Nutzers anpassen.

Im Allgemeinen wird das Fenster direkt vor der Sichtlinie des Benutzers angezeigt. Wenn Sie auf dem Rücken liegen, schwebt das Fenster in der Luft und neigt sich zu Ihnen hin.

Der „Home-Button“ am Headset

Benutzer tragen weiterhin das Headset, um sich umzusehen oder herumzulaufen. Sollte das Fenster zu diesem Zeitpunkt immer in der Mitte der Sichtlinie des Benutzers bleiben?

Der Rat von Apple lautet: Niemals, denn dadurch könnte der Benutzer glauben, er stecke fest.

Das Fenster sollte wie ein physisches Objekt an einer bestimmten Position im Raum fixiert sein, die sich mit der Blickrichtung des Benutzers nicht verändert.

Wenn der Benutzer zum Inhalt des Fensters zurückkehren muss, drückt er die digitale Krone am Vision Pro. Das Fenster wird dann wieder an der Vorderseite der aktuellen Sichtlinie fixiert, was der Home-Taste auf dem Mobiltelefon entspricht Telefon.

Schaffen Sie ein Gefühl des Eintauchens

Um Benutzern das Eintauchen in virtuelle Inhalte aus der realen Welt zu ermöglichen, hat Apple einen Effekt namens „Dimming“ vorgeschlagen – das Dimmen der Helligkeit außerhalb des Fensters, sodass sich Benutzer mehr auf den Inhalt auf dem Fenster konzentrieren können.

Wenn Sie beispielsweise durch Fotos blättern oder Videos ansehen, wird die Helligkeit der Umgebung automatisch reduziert, was Ihnen ein stärkeres Gefühl des Eintauchens vermittelt.

räumliche Kartierung

Das Erzeugen eines Gefühls des Eintauchens besteht im Wesentlichen darin, das Gehirn des Benutzers davon zu überzeugen, dass das, was er sieht, real ist. Der Ansatz von Apple besteht darin, virtuellen Objekten eine realistische Abbildung zu geben.

Wenn Sie beispielsweise das Fenster auf den Tisch legen, erscheint ein schwacher Schatten auf dem Tisch. Wenn Sie einen Film in einer Panoramaumgebung ansehen, wird die obere und untere Ebene des Fensters leicht reflektiert, wie Sie es normalerweise tun Schalten Sie zum Anschauen das Licht aus. Genauso wie beim Fernsehen.

Unterschätzen Sie diese Details nicht. Es sind diese Details, die Sie vielleicht nicht bemerken, aber für selbstverständlich halten, die die „Lücke“ füllen, die entsteht, wenn das Virtuelle und die Realität zusammentreffen, und es Ihnen ermöglichen, in sie einzutauchen.

Raum gut nutzen

Wir haben über viele Prinzipien und Designdetails gesprochen. Lassen Sie uns das langweilige Gefühl durch eine praktische Anwendung verwässern.

Wie oben erwähnt, sollte die Größe des Fensters im Raum dynamisch an den Inhalt angepasst werden.

Wenn Sie eine Keynote erstellen, ist die Fenstergröße moderat, was für Sie praktisch ist. Wenn Sie eine Vorschau der Keynote anzeigen, wird das Fenster größer und vermittelt den Eindruck eines Rundums, und die Umgebungshelligkeit wird verringert, damit Sie in das Fenster eintauchen können .

Und wenn Sie eine Rede halten oder proben möchten, betritt Keynote eine vollständig virtuelle Bühnenoberfläche, Sie stehen in der Mitte der Bühne und spüren das Gefühl, eine Rede in alle Richtungen zu halten.

Zu diesem Zeitpunkt können auch andere Benutzer Ihren „gemeinsamen Raum“ betreten und Ihrer Rede zuhören. Dies ist, was Apple als „ein Erlebnis, das nur Weltraumgeräte bieten können“ definiert.

Weniger ist mehr (Mit weniger mehr erreichen)

Wie schafft man ein Gefühl für Kino? Ein paar rote Sitze, einen Projektor in der Mitte und ein paar Sicherheitsausgänge auf beiden Seiten?

Apple ist davon überzeugt, dass subtile Lichtreflexionen auf Böden und Decken das Gefühl eines echten Raums vermitteln können, ohne dass alle Details skizziert werden müssen, was ein wichtiges Designprinzip ist.

Bei einer guten Raumgestaltung sollte darüber nachgedacht werden, wie die Anwendung wertvoll und ansprechend gestaltet werden kann und Benutzer dazu bereit sind, die Anwendung in ihren Raum zu „platzieren“.

räumliche Interaktion

Was du siehst ist was du kriegst

Im vorherigen Artikel haben wir kurz erwähnt, wie man mit der Schnittstelle des Raums interagiert: Fühlt es sich so an, als sei alles natürlich und angemessen, sodass wir die Existenz von Technologie oder Hardware nicht spüren können?

In der Vergangenheit mussten wir die Maschine über Tasten und Joysticks bedienen, aber in Vision Pro müssen Sie nur Ihre Augen, Hände und Ihren Mund verwenden, um direkt mit der Maschine zu interagieren.

Lassen Sie uns zuerst über die Augen sprechen.

Bei Vision Pro ist Ihre Sichtlinie Ihre Maus. Wenn Ihr Blick über das Fenster schweift, verändern die Symbole die Hervorhebung und geben Ihnen Echtzeit-Feedback.

Diese Highlight-Veränderungen sind wie magnetische Feldlinien, die die Flugbahn Ihrer Augen darstellen und Sie immer daran erinnern, was Sie gerade betrachten.

Da die Augeninteraktion einen sehr hohen Stellenwert hat, besteht die erste Aufgabe aller visionOS-Designs darin, das Auge zu erfreuen. Alle Schaltflächen und Fenster, die Sie hier sehen, werden abgerundet und alle Kanten und Ecken werden gelöscht.

die Magie des Zuschauens

Der Blick ist eine interessante Interaktion – wenn Sie etwas betrachten, bedeutet das, dass Sie daran interessiert sind.

Wenn Sie also ein Element betrachten, weiß das System, dass Sie damit interagieren möchten, und löst so eine kleine Funktionalität aus.

Detaillierte Anweisungen erscheinen beispielsweise beim Blick ins Telefonbuch und Siri-Eingaben werden beim Blick ins Mikrofon ausgelöst.

Es ist wie bei 3D Touch: Wenn Sie fest auf den iPhone-Bildschirm drücken, wird ein sekundäres Menü angezeigt.

Der Unterschied besteht darin, dass es natürlicher und einfacher mit den Augen zu bedienen ist.

Handmagie

Im Jahr 2007 brachte Jobs die Multi-Touch-Interaktion auf die Welt, indem er mit zwei Fingern auf dem iPhone in Fotos hinein- und herauszoomte.

Auch heute noch ist die Magie Ihrer Finger ungebrochen.

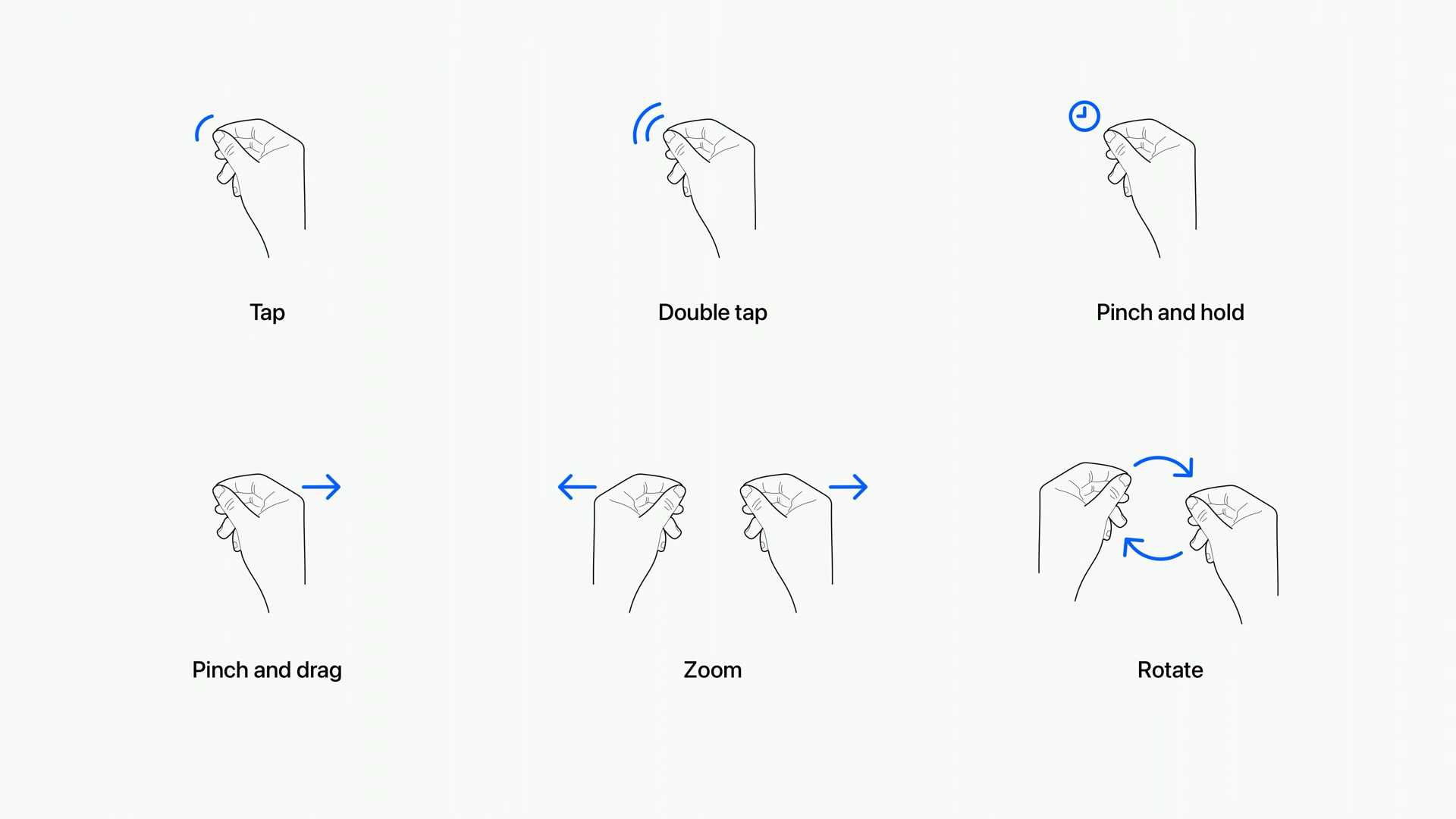

Apple bietet 6 grundlegende Gesten, nämlich Zeigen, Doppeltippen, Auf- und Zuziehen, Ziehen, Vergrößern und Verkleinern sowie Drehen.

In Kombination mit Eye-Tracking wird die gesamte Interaktion sehr natürlich.

Wenn Sie beispielsweise eine bestimmte Stelle im Foto vergrößern möchten, müssen Sie nur darauf starren und dann Ihre Hände herausziehen.

Wenn Sie im Raum zeichnen möchten, kneifen Sie einfach Ihre Finger zusammen, starren Sie auf die Leinwand und zeichnen Sie, wo immer Sie sehen. Dies ist viel einfacher als die Griffbedienung herkömmlicher VR.

Entitätszuordnung

Die Interaktion mit den Händen ist bequem, der Nachteil ist jedoch, dass Benutzer kein taktiles Feedback spüren können.

Um dieses Problem zu lösen, hat Apple eine entsprechende physische Abbildung im visuellen und akustischen Sinne erstellt und so den Benutzern ein Realitätsgefühl vermittelt, als ob sie mit physischen Objekten interagieren würden.

Nehmen Sie als Beispiel die Tastatur mit einer sehr hohen Betriebsfrequenz. Wenn Ihr Finger über die Tastatur gleitet, erzeugt die Tastatur einen Tracking-Highlight-Effekt. Das Klickgeräusch einer iPhone-Tastatur.

Es gibt auch ein sehr futuristisches Detail an der Tastatur: Wenn Sie das Magic Keyboard mit Bluetooth verbinden, erscheint über der Tastatur ein virtuelles Erinnerungs-Popup-Fenster, sodass Sie die Kombination aus echter virtueller Realität spüren können.

räumliches Audio

Dem Audio Direktionalität verleihen

Wir haben schon oft über räumliches Audio gesprochen, und jetzt ist die räumliche Audiotechnologie endlich auf der Bühne angekommen – einem echten Raum.

Mithilfe der räumlichen Audiotechnologie kann Apple das „ursprüngliche Erscheinungsbild“ des Tons wiederherstellen: Der Ton sollte gerichtet sein, und wo der Ton ist, kommt der Ton von dort.

Wenn Sie beispielsweise in die Aussicht auf den See eintauchen, ertönt das Geräusch des fließenden Wassers aus dem See, das Geräusch von Insekten aus dem Gras und von Zeit zu Zeit das Geräusch von Vögeln aus dem fernen Wald.

Alle Geräusche sollten der realen Welt ähneln, was die größte Bedeutung von räumlichem Audio darstellt.

Geben Sie Feedback mit Ton

Der Ton ist auch ein wichtiger Teil des interaktiven Feedbacks, das sich auch in anderen Apple-Produkten widerspiegelt. Wie oben erwähnt, ertönt beim Betätigen der Tastatur ein Klopfgeräusch und beim Verschieben des Fotos ein leichtes Klicken. Piep.

Bezüglich des Feedback-Sounds betont Apple insbesondere, dass es sich dabei um einen Sound handelt, den Nutzer oft hören, und dass der Designer gleichgültig sein muss, sonst kommt es leicht zu Langeweile.

Machen Sie ein Bild mit Ton

Apple hat auf der Pressekonferenz die Funktion der immersiven Benutzeroberfläche hervorgehoben: Sie können eine real aufgenommene virtuelle Umgebung betreten und ein Gefühl der Ruhe spüren.

Wie entsteht also diese immersive Landschaft? Die Sounddesigner von Apple gingen vor Ort, um eine große Anzahl von Geräuschen aufzunehmen, um sicherzustellen, dass sie die Klangveränderungen des Ortes von morgens bis abends aufzeichnen konnten.

Wenn jedoch der live aufgenommene Ton direkt verwendet wird, kommt es zu vielen unerwünschten Geräuschen, weshalb die Designer Richtmikrofone verwenden, um den gewünschten Ton vom Lärm zu trennen und ihn neu zu mischen.

Der gesamte Prozess gleicht einem Gemälde: Der Designer platziert die benötigten Klänge an den entsprechenden räumlichen Positionen und synthetisiert schließlich eine friedliche Synchronisation, die die Landschaft schön und malerisch machen kann.

der Anfang der Zukunft

Anhand dieser Details ist es nicht schwer zu erkennen, dass Vision Pro oder visionOS bereits ein hochentwickeltes Produkt ist und dass „Spatial Computing“ keine illusorische Science-Fiction-Vermutung ist, sondern eine Zukunft, die kurz vor der Landung steht.

Vision Pro ist wie ein „Teleskop“ auf dem Weg der technologischen Entwicklung und ermöglicht uns einen Blick auf einen Winkel des zukünftigen Lebens.

Bitte beachten Sie jedoch, dass es sich nicht um eine „Rakete“ in die Zukunft handelt und Sie in „Ready Player One“ nicht sofort in das Metaversum entführen kann. Apple hat gerade das anständigste Regal gebaut und benötigt mehr Inhalt als Füllung.

Wir können genauso gut gespannt sein, welche Veränderungen Apples Aufruf an VR-Produkten und -Inhalten mit sich bringt und wie das Leben, an das wir gewöhnt sind, durch „Spatial Computing“ untergraben wird.

#Willkommen, dem offiziellen öffentlichen WeChat-Konto von Aifaner zu folgen: Aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich präsentiert.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo