Diese KI-Produkte durchbrechen Barrieren für 430 Millionen Menschen

Wir haben zuvor einen Artikel geschrieben – „Don't Ask Me Again Why Deaf People Go to Music Festivals“ , der die Sonderstellung ausländischer Musikfestivals bekannt machte: Gebärdensprachdolmetscher.

Obwohl Hörgeschädigte die Musik nicht deutlich hören oder hören können, können sie durch die hoch ansteckenden Handbewegungen, Gesichtsausdrücke und Körpersprache der Gebärdensprachdolmetscher den Rhythmus der Musik und die Wärme der Atmosphäre spüren.

Dies kann für hörende Menschen ein unerwartetes Gebärdensprachszenario sein. Tatsächlich gibt es immer noch viele Orte, an denen Gebärdensprachdolmetscher benötigt werden, sowohl online als auch offline, aber es gibt nicht genug davon.

Sally Chalk, eine Engländerin, eröffnete 2002 ein Dolmetscherunternehmen für britische Gebärdensprache. Nach 20 Jahren Betrieb ist das Unternehmen zu einer beträchtlichen Größe gewachsen, und die Zeit für die Buchung eines Gebärdensprachdolmetschers wurde auf 30 Minuten verkürzt, sie jedoch schon immer noch nicht zufrieden.

Können hörgeschädigte Menschen sofortigen Zugang zur Gebärdensprachdolmetschung erhalten, genau wie die Aktivierung von Untertiteln auf einer Video-Website?

Ihre Antwort ist, die KI einzubeziehen.

Von online bis offline soll Hörgeschädigten die Möglichkeit gegeben werden, häufiger ihre „Muttersprache“ zu verwenden

Im Jahr 2022 eröffnete Sally Chalk ein neues Start-up-Unternehmen, Signapse, das sich auf die Entwicklung generativer KI-Gebärdensprachübersetzungssoftware konzentriert, um geschriebene Texte in Echtzeit in die amerikanische und britische Gebärdensprache zu übersetzen.

Im Mai dieses Jahres erhielt Signapse eine Seed-Finanzierung in Höhe von 2 Millionen Pfund, wovon 500.000 Pfund von der britischen Regierung kamen.

Eines der Offline-Szenarien, auf die sie abzielen, sind Verkehrsknotenpunkte wie Bahnhöfe und Flughäfen.

Der Cincinnati/Northern Kentucky International Airport in den Vereinigten Staaten hat sich mit Signapse zusammengetan, um die amerikanische Gebärdensprache auf dem Bildschirm anzuzeigen, um Begrüßung, Sicherheit, Abflug, Ankunft und andere Informationen bereitzustellen.

Wie funktioniert KI? Signapse basiert auf einem großen Gebärdensprachdatensatz und nutzt Generative Adversarial Networks (GAN) und Deep-Learning-Techniken, um lebensechte virtuelle Gebärdensprachdolmetscher zu erstellen, die so genau wie möglich übersetzen.

Diese Avatare basieren auf echten Gebärdensprachdolmetschern und jedes Mal, wenn sie kommerziell genutzt werden, bekommen die echten Menschen einen Anteil.

Da sich Flughafenziele, Abflugzeiten und Bahnsteignummern häufig ändern, kann die Gebärdensprachübersetzung von Signapse durch die Integration mit Verkehrsdaten in Echtzeit aktualisiert werden.

Gleichzeitig hat Signapse die Online-Bedürfnisse nicht außer Acht gelassen und bietet auch Gebärdensprachübersetzungen für Websites und Video-Streaming an.

Obwohl Websites wie YouTube über geschlossene Untertitel verfügen, bevorzugen hörgeschädigte Menschen häufig die Gebärdensprache gegenüber Untertiteln, da die Gebärdensprache über grammatikalische Strukturen und Ausdrücke verfügt, die von anderen Sprachen unabhängig sind, was ihr Online-Erlebnis verbessert.

Sie sollten bemerkt haben, dass wir bei der Bezugnahme auf Gebärdensprache die amerikanische Gebärdensprache und die britische Gebärdensprache verwenden. So wie gesprochene und geschriebene Sprachen auf der ganzen Welt unverständlich sind, ist die Gebärdensprache allumfassend.

Nach Angaben der Vereinten Nationen nutzen rund 70 Millionen Menschen auf der Welt die Gebärdensprache als wichtigste Kommunikationsform, und weltweit werden mehr als 300 verschiedene Arten der Gebärdensprache verwendet. Allein in den Vereinigten Staaten verwenden 500.000 Menschen die amerikanische Gebärdensprache.

Daher ist das, was Signapse derzeit tut, tatsächlich sehr begrenzt und deckt nur eine kleine Anzahl von Menschen ab, die amerikanische und britische Gebärdensprache verwenden, sowie begrenzte vertikale Szenarien. In den letzten zwei Jahren hat Signapse täglich rund 5.000 Verkehrsmeldungen in britischer Gebärdensprache erstellt.

Signapse hofft, dass ihre Dienste in Zukunft universeller, auf Bildung und andere Szenarien ausgeweitet und auch personalisierter werden, sodass Benutzer das Erscheinungsbild virtueller Gebärdensprachdolmetscher individuell anpassen können.

Die Umgebung und die Bedingungen unterstützen KI, und auch große inländische Hersteller verfügen über ähnliche Gebärdensprachprodukte.

Moderatoren der KI-Gebärdensprache sind im Live-Übertragungsraum „Honor of Kings“ von Tencent und auf der Entwicklerkonferenz von Huawei aufgetreten.

Bei den Olympischen Winterspielen 2022 wurde der von CCTV News und Baidu Intelligent Cloud Xilin gemeinsam erstellte AI-Gebärdensprachanker eingeführt, und die School of Artificial Intelligence for the Deaf der Tianjin University of Technology beteiligte sich an der Annotation von Gebärdensprachmaterial.

Hinter dem AI-Gebärdensprachanker kann die AI-Gebärdensprachplattform von Baidu Intelligent Cloud Xiling auch die Anforderungen einer schnellen Gebärdensprachübersetzung in verschiedenen Szenarien wie Krankenhäusern, Bahnhöfen, Banken usw. erfüllen, was mit dem Signapse-Helden identisch ist.

Reibungsloseres Reisen, noch intensiveres Seherlebnis, mehr barrierefreie Dienste …

Wenn der Raum für Verbesserungen bei der Gebärdensprachdolmetschung tiefer als das Meer reicht, wird zumindest die Art und Weise, wie hörgeschädigte Menschen öffentliche Informationen erhalten, durch KI verändert, wobei die sichtbaren Wellen weiter steigen.

Duolingo-Menschen in der Welt der Gebärdensprache

Müssen hörgeschädigte Menschen auch Musik „hören“? Reicht es für hörgeschädigte Menschen, Texte zu lesen? Dies ist ein typisches Problem, wenn man es aus der Perspektive des Hörens der Logik der Menschen betrachtet.

Eigentlich müssten wir umgekehrt fragen: Wie können auch hörgeschädigte Menschen das Gefühl haben, an Musikfestivals teilzunehmen? Wie kann das Internet das Surfen für Hörgeschädigte angenehmer machen?

Daher bedeutet es nicht, dass es in einem stark frequentierten Bahnhof einen zusätzlichen Bildschirm gibt, sondern dass der Bildschirm vorhanden sein sollte.

Immer mehr Unternehmen und immer mehr Einzelpersonen nutzen die Leistungsfähigkeit der Technologie, um die Gebärdensprache immer relevanter zu machen.

Eine der einfacheren Ideen ist es, hörenden Menschen das Erlernen der Gebärdensprache zu ermöglichen.

PopSign ist eine App zum Erlernen der Gebärdensprache beim Spielen. Sie wurde gemeinsam von Google, dem Rochester Institute of Technology und dem Georgia Institute of Technology entwickelt. Sie kann auf Android und iOS verwendet werden hörgeschädigte Kinder hörender Eltern.

Aus der Lektion lernend, dass das Auswendiglernen von Wörtern mit „aufgeben“ (aufgeben) beginnt und mit aufgeben endet, spielt PopSign keine langweiligen Gebärdensprachvideos ab, sondern verwendet Minispiele, um Ihr Interesse und Ihr Selbstvertrauen beim Erlernen der Gebärdensprache zu steigern Duolingo, das Sie verzweifelt zum Einchecken drängt. .

Es gibt auch ein amerikanisches Unternehmen namens SLAIT, das der „Duolingo“ in der Welt der Gebärdensprache sein möchte. Sie bieten auch immersive interaktive Kurse und Tests an. Wenn Sie es richtig machen, gibt Ihnen der KI-Lehrer Echtzeit-Feedback und bietet das richtige Maß an emotionalem Mehrwert.

Allerdings ist das Unterrichten von Gebärdensprache für SLAIT nur die zweitbeste Option. Was sie zu Beginn tun wollten, war eigentlich ein KI-Gebärdensprachtool für Echtzeit-Videochat und Übersetzung.

Aber es ist schwierig, eine Mahlzeit ohne Reis zuzubereiten. SLAIT ist ein kleines Team ohne ausreichende Daten oder Mittel. Im Vergleich zur direkten Übersetzung von Gebärdensprachsätzen ist das Unterrichten einzelner Gebärdensprachvokabeln einfacher, aber ebenso wertvoll.

Die harte Arbeit des Dolmetschens der Gebärdensprache wird den wohlhabenden Riesen überlassen.

Im August 2023 entwickelte Lenovo Brasilien eine KI-basierte Echtzeit-Chat-Übersetzungs-App zur Übersetzung der portugiesischen Gebärdensprache und plant, in Zukunft weitere Gebärdensprachen auf der ganzen Welt abzudecken.

Wenn eine hörgeschädigte Person vor der Kamera des Geräts unterschreibt, übersetzt der Algorithmus diese sofort in portugiesischen Text und sendet ihn an den Empfänger am anderen Ende.

Es sollte möglichst viele solcher Tools geben, die das Angebot des Gebärdensprachunterrichts ergänzen und es Hörgeschädigten ermöglichen, eine aktivere Position einzunehmen und Gespräche stärker initiieren zu können.

Google ist produktorientierter und hat 2023 den Kaggle AI Sign Language Recognition Competition ins Leben gerufen.

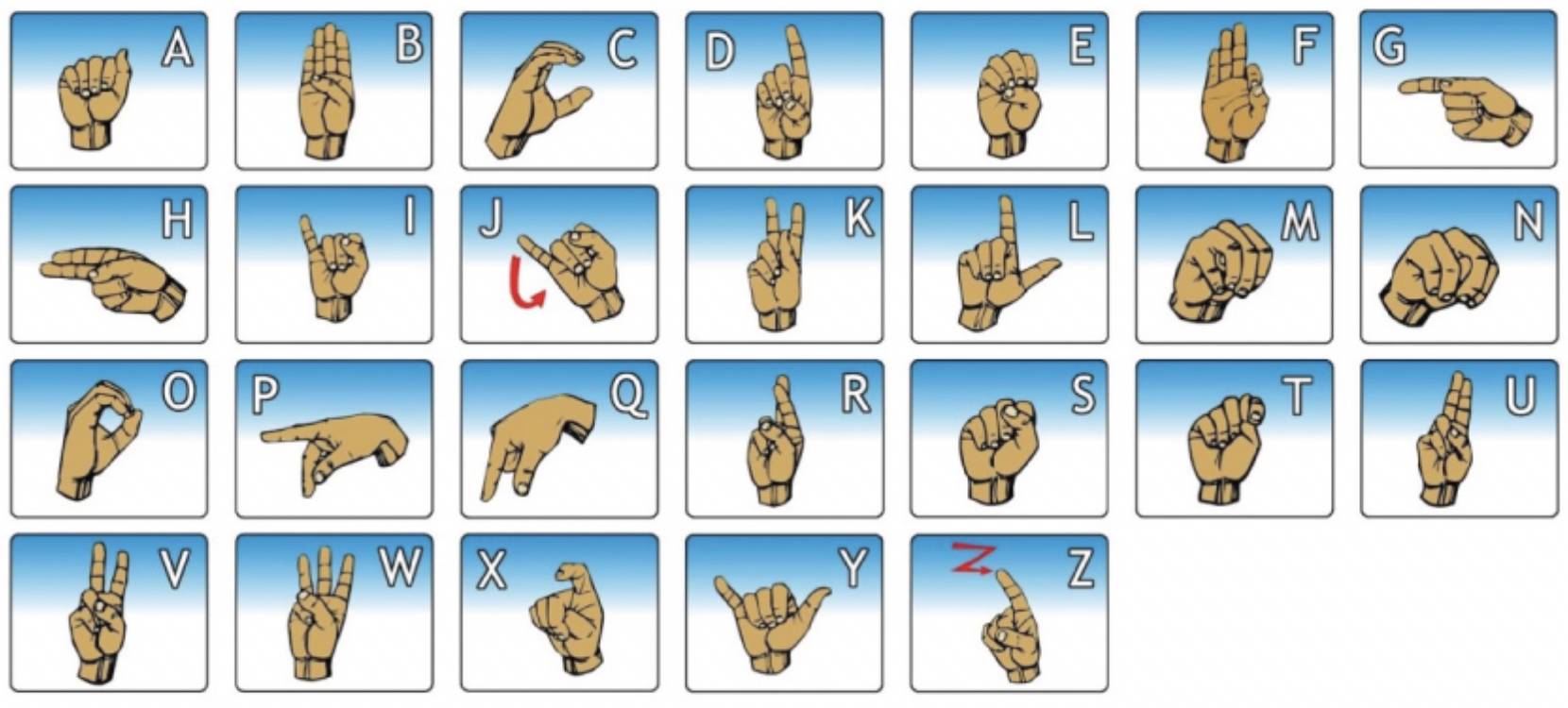

Das Thema dieses Wettbewerbs ist sehr interessant: Die Teilnehmer bauen ein Finger-Buchstabiermodell, das intelligente Kameras verwendet, um schnell Finger, Handflächen und Gesichter zu verfolgen, basierend auf mehr als 3 Millionen Finger-Buchstabierzeichen, die aus Selfies von hörgeschädigten Menschen stammen.

Fingerbuchstabieren ist eine Art Gebärdensprache, bei der unterschiedliche Formen und Positionen der Finger zur Darstellung von Buchstaben verwendet werden. Für viele Menschen mit Behinderungen ist das Buchstabieren mit den Fingern viel schneller als das Tippen auf der virtuellen Tastatur eines Smartphones.

Daher besteht die Verbesserung der Gebärdenspracherkennung und der Aufbau von Fingerbuchstabiermodellen darin, hörgeschädigten Menschen die Möglichkeit zu geben, die Gebärdensprache, die sie besser beherrschen, direkt zu verwenden, anstatt zu tippen und zu sprechen, und Funktionen wie Suche, Karten und Textnachrichten auf ihrem Mobiltelefon zu nutzen Telefone.

Darüber hinaus wird dies auch dazu beitragen, Anwendungen zur Umwandlung von Gebärdensprache in Sprache zu entwickeln und so die Sackgasse zu überwinden, in der hörgeschädigte Menschen nicht in der Lage sind, digitale Assistenten mithilfe ihrer Stimme anzurufen.

Mit anderen Worten: Viele Voice-First-Produkte haben Benutzer, die nicht gut sprechen können, von Anfang an nicht berücksichtigt. Es ist an der Zeit, die Lücken zu schließen.

Sam Sepah, Chefproduktmanager für Barrierefreiheitsforschung bei Google, erwähnte in einem Interview mit Forbes, dass es ihr Ziel sei, Gebärdensprache zu einer universellen Sprachoption bei der Nutzung von Google-Produkten zu machen.

Tatsächlich sollte dies auch das Ziel des gesamten Internets sein – die Gebärdensprache zu einer universellen Sprache in der digitalen Welt zu machen.

Als Sprachlernsoftware bietet Duolingo jedem die gleichen Bildungschancen. KI-Gebärdensprachprodukte vermitteln den Menschen das Gefühl, dass Beschränkungen, die es nicht geben sollte, aufgehoben werden und Menschen überall miteinander kommunizieren können.

Je mächtiger die KI wird, desto mehr müssen wir die Menschheit wertschätzen

Als GPT-4o im Mai veröffentlicht wurde, war ein Demovideo sehr berührend, da GPT-4o als Augen fungierte und es Sehbehinderten ermöglichte, die Umgebung zu „sehen“.

Der sehbehinderte Mensch weiß aus dem Mund der KI, dass Flaggen über dem Buckingham Palace wehen, Enten gemächlich im Fluss spielen und dass bald ein Taxi ankommt. Als Reaktion auf den fröhlichen Tonfall der KI hebt sich der Sehbehinderte.

Wie man so schön sagt: Technologie öffnet die Tür zu einer neuen Welt. Kann man umgekehrt verstehen, dass Menschen mit Behinderungen ursprünglich in einer Welt lebten, die nicht für sie geschaffen war?

Daten der WHO zeigen, dass weltweit 430 Millionen Menschen eine Rehabilitationsbehandlung benötigen, um einen behindernden Hörverlust zu bekämpfen. Die Zahl der Gebärdensprachdolmetscher ist bei weitem nicht ausreichend. In den Vereinigten Staaten beträgt das Verhältnis von hörgeschädigten Nutzern zu amerikanischen Gebärdensprachdolmetschern etwa 50 zu 1.

Daher spielt die KI-Gebärdensprache vorerst nur eine ergänzende und i-Tüpfelchenrolle und ist noch nicht an dem Punkt, „Arbeitsplätze zu stehlen“.

Die oben genannten KI-Gebärdensprachprodukte sind grundsätzlich kleinräumig, vertikal und in bestimmten Regionen verankert, was die Unzugänglichkeit menschlicher Dolmetscher ausgleicht.

Letzten Monat habe ich auch ein cooles KI-Gebärdensprachprodukt gesehen.

Forscher mehrerer Universitäten, darunter der Rutgers University und der Carnegie Mellon University, verarbeiteten Videos in öffentlicher Gebärdensprache zu einem Datensatz mit 8 Gebärdensprachen und trainierten SignLLM, das erste Modell zur Generierung mehrsprachiger Gebärdensprachen.

Es deckt eine Vielzahl von Gebärdensprachen ab und kann Gebärdensprachen durch Textaufforderungswörter generieren. Ist das nicht sehr praktisch? Die Forscher sagten jedoch, dass die Außenwelt ihre Forschungsergebnisse nicht übertreiben sollte. Das Demonstrationsvideo sei keine direkte Ausgabe des Modells und es sei immer noch sehr mühsam, es tatsächlich zu produzieren.

Gleichzeitig haben sich einige Experten für Hörgeschädigte gemeldet und gesagt, dass die Qualität der Gebärdensprachübersetzung in diesen Videos unterschiedlich sei. Einige seien halb verständlich, andere völlig unverständlich und es fehle an Gesichtsausdrücken muss verbessert werden.

Das Wichtigste sei, hörgeschädigten Nutzern die Möglichkeit zu geben, sich zu beteiligen, ihre Meinung zu äußern und gemeinsam das Produkt zu verbessern, denn „ohne unsere Beteiligung wird es keine Entscheidungen über uns geben.“

Ein subtiles Gefühl ist, dass es schwierig erscheint, barrierefreie Produkte „sexy“ zu machen.

Sie sind oft nicht so aufregend wie die Veröffentlichung großer Modelle und KI-Hardware. Sie sagen Ihnen immer, welche Funktionen sie haben und wem sie dienen. Sie hoffen, dass sie in Zukunft besser abschneiden und nicht „mehr beißen“, als sie kauen können.

Und in den Augen von Risikokapitalgebern handelt es sich auch um eine Nische, ein unbekanntes Potenzial und möglicherweise keinen Return on Investment.

Aber „KI-Patin“ Li Feifei sagte einmal, dass KI den Menschen helfen soll, je mächtiger die KI ist, desto mehr müssen wir die Menschheit schätzen.

Jeder sollte keine Angst haben, einen Flug zu verpassen, jeder sollte in der Lage sein, mit Produkten zu interagieren, und jeder sollte Musikfestivals genießen.

Auch die Dinge, die einst unsichtbar und unhörbar waren, sollten durch das Licht der Technologie beleuchtet werden. Lassen Sie uns in Resonanz mit den Fingern schnippen, damit die Bedürfnisse von mehr Menschen erfüllt werden können, die Fähigkeiten von mehr Menschen verbessert werden können, damit wir mehr gewinnen und weniger verlieren können.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr) wird Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo