Dieser winzige Sensor wird Ihre Handykamera für immer verändern

„Wir glauben, dass es eine echte Chance gibt, einen Spektral-Imager in einem Smartphone zu entwickeln und einzusetzen. Trotz aller Fortschritte, die mit verschiedenen Kameras und der Rechenleistung eines Smartphones gemacht wurden, kann niemand die wahre Farbe eines Bildes wirklich erkennen.“

So beschrieb Spectricity- CEO Vincent Mouret kürzlich in einem Interview die Mission des Unternehmens für Digital Trends sowie den Grund, warum es einen miniaturisierten Spektralbildsensor herstellt, der für den Einsatz in einem Smartphone bereit ist. Aber was genau ist ein Spektralsensor und wie funktioniert er? Es stellt sich heraus, dass es viel mehr kann, als nur schöne Farben einzufangen.

Hast du diese Farbe schon einmal gesehen?

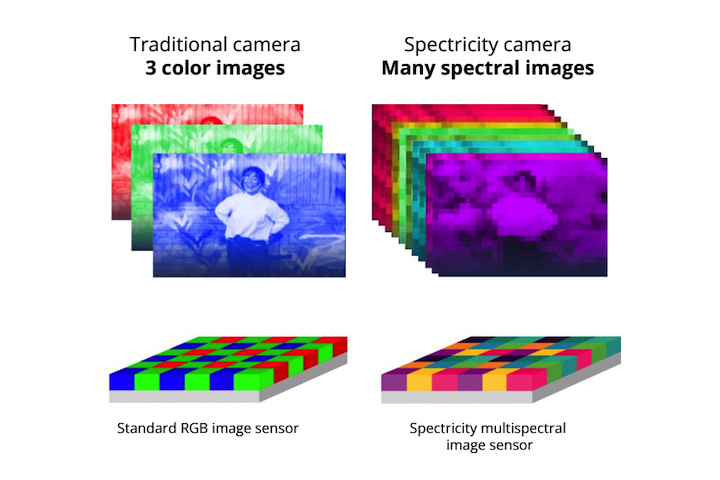

Bevor wir zu all dem kommen, lassen Sie uns darüber sprechen, was der multispektrale Bildsensor S1 von Spectricity für Kameras leistet. Die meisten Telefonkameras verwenden dreifarbige RGB-Sensoren (Rot, Grün und Blau), aber der Spectricity S1-Sensor blickt weiter in den Bereich des sichtbaren Lichts und des nahen Infrarots, um natürlichere, konsistentere Farben zusammen mit einem erheblich verbesserten Weißabgleich zu reproduzieren.

„Eine Standardkamera, die in ein Smartphone integriert ist, hat einen RGB-Sensor, der Rot, Grün und Blau sieht“, sagte Mouret. „Wir fügen Filter hinzu, um bis zu 16 verschiedene Bilder mit unterschiedlichen Farben, unterschiedlichen Lichtwellenlängen, Licht aus verschiedenen Quellen und dem reflektierten Licht, das vom Objekt der Szene kommt, zu erstellen. Dank dieser unterschiedlichen Bilder im Vergleich zu einem Standard-RGB können Sie viele verschiedene Eigenschaften erkennen.“

Das bedeutet, dass die von einem Telefon mit dem S1-Sensor aufgenommenen Bilder unabhängig von den Lichtverhältnissen durchgehend konsistentere Farben aufweisen, wie Sie im Beispielbild unten sehen können. Während unseres Gesprächs sah ich eine Live-Demonstration, die die im Beispiel gezeigte Farbwiedergabe und -konsistenz reproduzierte, aber es ist erwähnenswert, dass der Sensor von einem PC und nicht von einem Smartphone betrieben wurde.

„Bei Xiaomi-, Samsung-, Apple- und Huawei-Kameras werden die Farben bei unterschiedlichen Lichtverhältnissen sehr unterschiedlich sein. In derselben Szene, die mit unserem Spectral Imager aufgenommen wurde, gibt es geringfügige Unterschiede, aber geringfügige. Die Farben aus Bildern sind die Farben, die unser bloßes Auge sieht. Sie können sehen, dass alle Smartphones sehr unterschiedliche Farben erzeugen.“

Diese Farbgenauigkeit wird auch die Fähigkeit von Smartphone-Kameras verbessern, verschiedene Hauttöne besser wiederzugeben. In einem anderen Beispielbild zeigte der S1-Sensor auch hier deutliche Verbesserungen.

„Man kann sehen, dass die Hauttöne je nach Lichtverhältnissen völlig unterschiedlich sind“, betonte Mouret. „Die Lösung besteht darin, einen Spektral-Imager zu verwenden, um die Lichtverhältnisse zu analysieren, um wirklich den richtigen Ton zu geben. Das ist der einzige Weg. Man kann viel KI dahinter stecken, aber das reicht nicht. Sie benötigen zusätzliche Hardware.“

Leider hatte Mouret kein Google Pixel -Telefon zur Hand, um den S1-Sensor mit Googles Real Tone-Rechentechnologie zu vergleichen, die etwas Ähnliches verspricht, nur durch die Verwendung von Softwareverbesserungen .

Ist es ein Sensor oder eine Kamera?

Die Vorteile eines spektralen Bildsensors wie dem S1 scheinen klar zu sein, und wer möchte nicht einen effektiveren Weißabgleich und natürliche, konsistente Farben in seinen Fotos? Aber die Art und Weise, wie Mouret die Fähigkeiten der S1 beschrieb, ließ sie eher wie eine Kamera als wie einen Sensor klingen. Welches ist es? Passt es wirklich in ein Smartphone? Wenn ja, welche Modifikationen sind erforderlich?

Der Anwendungstechniker von Spectricity, Michael Jacobs, der die von mir gesehene Demo durchführte, erklärte, was der S1 eigentlich ist.

„Es ist wirklich ein begleitender Sensor, sehr ähnlich einem Tiefensensor oder einem 3D-Sensor, der mit einer RGB-Kamera verwendet wird“, bestätigte er.

Technisch gesehen macht es jedoch Fotos, nur keine, die Sie einzeln verwenden möchten, wie Mouret erklärte:

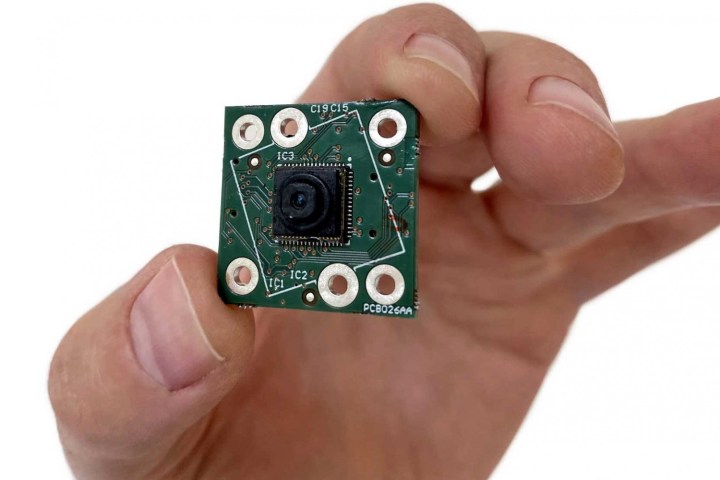

„Unser Bildsensor hat eine VGA-Auflösung, 800 x 600 Pixel. Sie müssen dieses kleinere Spektralbild mit einem RGB-Bild kombinieren. Das Modul selbst ist wirklich sehr klein. Es wurde entwickelt, um in ein Smartphone integriert zu werden. Es sind also 5 mm mal 5 mm mal 6 mm“, sagte Mouret mir, bevor er mehr darüber sagte, wie der Sensor aufgebaut ist. „Es ist nicht einfach, aber es ist nicht sehr anspruchsvoll, würde ich sagen“, erklärte er und sagte, dass das Modul mit den gleichen Methoden wie normale CMOS-Sensoren gebaut werde. „In Bezug auf die Gesamtkosten wird das komplette Modul die gleichen Kosten wie eine Standardkamera für hohe Stückzahlen haben.“

Derzeit wird der Sensor in einen standardmäßigen Bildsignalprozessor (ISP) integriert, der von Smartphone-Prozessoren von Qualcomm und MediaTek verwendet wird, für den Betrieb ist jedoch zusätzliche Software erforderlich.

Der multispektrale Bildsensor S1 ist kein One-Trick-Pony und hat tatsächlich eine faszinierende zweite Funktion, indem er Haut-Biomarker erkennen und analysieren kann. Das bedeutet, dass es erkennen kann, ob es eine echte Person „sieht“, was für Sicherheitsanwendungen verwendet werden könnte – zum Beispiel, wenn es weiß, ob jemand eine Maske trägt, um seine Identität zu verbergen –, Hautpflege und sogar in Gesundheitsanwendungen, wann kombiniert mit KI und anderer Software. Es könnte auch verwendet werden, um Fotos im Hochformat zu verbessern.

Wann wird es in einem Telefon verwendet?

Die Hersteller arbeiten seit einiger Zeit daran, die Farbwiedergabe auf Telefonen zu verbessern, und gehen zurück auf das LG G5 im Jahr 2016, das neben seinem Laser-Autofokus-Sensor einen speziellen Farbspektrumsensor verwendete, um die Farbleistung zu verbessern. Huawei hat einen anderen Ansatz gewählt und einen RGB-Sensor auf dem P30 Pro zugunsten eines RYYB-Sensors aufgegeben, um Farben besser wiederzugeben und die Leistung bei schlechten Lichtverhältnissen zu verbessern. Olympus und Imec haben auch mit Nahinfrarot-RGB-Sensoren für verschiedene Anwendungen experimentiert.

Der Spectricity S1 Sensor ist eine Weltneuheit und geht in eine andere Richtung als diese Beispiele. Basierend auf der Demo und den Beispielbildern ist es sehr vielversprechend – aber wann sollten wir damit rechnen, es auf einem Telefon zu sehen?

„Am Anfang wird es auf High-End-Telefonen eingeführt“, sagte Mouret. „2024 wird es ein kleines Volumen sein, 2025 ein größeres Volumen, und ab 2026 wird es weiter verbreitet sein.“

Mouret erwartet zudem, dass die ersten Beispiele von chinesischen Smartphone-Herstellern kommen und nicht von Unternehmen wie Samsung und Apple. Mouret erwartet jedoch, dass sich dies in Zukunft ändern wird, und in der Pressemitteilung der CES 2023 für den S1-Sensor hielt er sich nicht zurück und sagte:

„Wir erwarten, dass die ersten Smartphone-Modelle mit dem S1 im Jahr 2024 auf den Markt kommen, und wir erwarten, dass alle Smartphones unsere Technologie in den kommenden Jahren enthalten werden.“

Ja, alle Smartphones . Es ist ein großes Ziel, aber wenn die Leistung, die wir in der Demo gesehen haben, die ist, die wir letztendlich von einer Telefonkamera mit dem S1 daneben sehen werden, werden nur wenige Hersteller zurückgelassen werden wollen.