Fordern Sie Sora heraus! Adobe führt KI-Videoartefakt ein, ein P-Video mit einem Satz

Der Bereich KI-Video war in letzter Zeit äußerst lebhaft, und Adobe hat sich gerade dem Gedränge angeschlossen.

Auf der diesjährigen Adobe Max-Konferenz stellte Adobe offiziell sein eigenes KI-Videomodell vor – das Firefly-Videomodell – und betrat damit den Bereich der generativen künstlichen Intelligenz.

Meagan Keane, Chief Product Marketing Manager bei Adobe, sagte, dass die Einführung des Firefly-Videomodells darauf abzielt, die Videoerstellung zu vereinfachen und zu beschleunigen und die Storytelling-Fähigkeiten von Videos zu verbessern. Zusammenfassend enthält dieses Modell drei interessante und praktische Funktionen:

- Generative Erweiterung

- Text-zu-Video (Wensheng-Video)

- Bild-zu-Video (图生视频)

Unter anderem wurde Generative Extend in Premiere Pro integriert, eine von Adobe entwickelte professionelle Videobearbeitungssoftware, die gerade Beta-Versionen in der Firefly-Web-App veröffentlicht hat.

Wie der Name schon sagt: Wenn der von Ihnen aufgenommene Videoclip zu kurz ist oder einige Teile fehlen, kann Ihnen Generative Extend dabei helfen, eine „generative Erweiterung“ am Anfang oder Ende des Videoclips durchzuführen.

Das heißt, wenn die erforderliche Aufnahme nicht verfügbar ist oder eine Aufnahme zu früh oder zu spät geschnitten wird, muss der Editor nur den Anfang oder das Ende des Videoclips ziehen, und Generative Extend kann den generativen Inhalt automatisch ausfüllen, um ihn zu behalten Video kohärent und flüssig.

▲Demonstration der generativen Videoerweiterungsfunktion von Generative Extend (Bildquelle: Adobe)

Dies bedeutet, dass der Videoersteller, wenn er während des Aufnahmevorgangs eine „Verschwendung“ erhält, möglicherweise nicht mehr zum ursprünglichen Ort zurückkehren muss, um erneut zu drehen, sondern Generative Extend verwenden muss, um den Originalclip direkt zu erweitern und zu reparieren.

Dies trägt in gewissem Maße dazu bei, die Effizienz der Videoerstellung zu verbessern – natürlich, wenn die Qualität der mit Generative Extend erweiterten Clips hervorragend ist.

Leider ist die Funktion derzeit auf eine maximale Auflösung von 1080p beschränkt und Clips können nur um maximal zwei Sekunden verlängert werden.

Daher eignet sich Generative Extend nur für geringfügige Anpassungen an Videoclips, das heißt, es kann Benutzern nur dabei helfen, bestimmte Details zu reparieren, aber es kann die Ersteller selbst nicht bei groß angelegten Kreationen ersetzen.

Generative Extend kann Benutzern auch dabei helfen, Anpassungen während der Aufnahme vorzunehmen und Blickwinkelveränderungen oder andere unerwartete Bewegungen während der Aufnahme zu korrigieren.

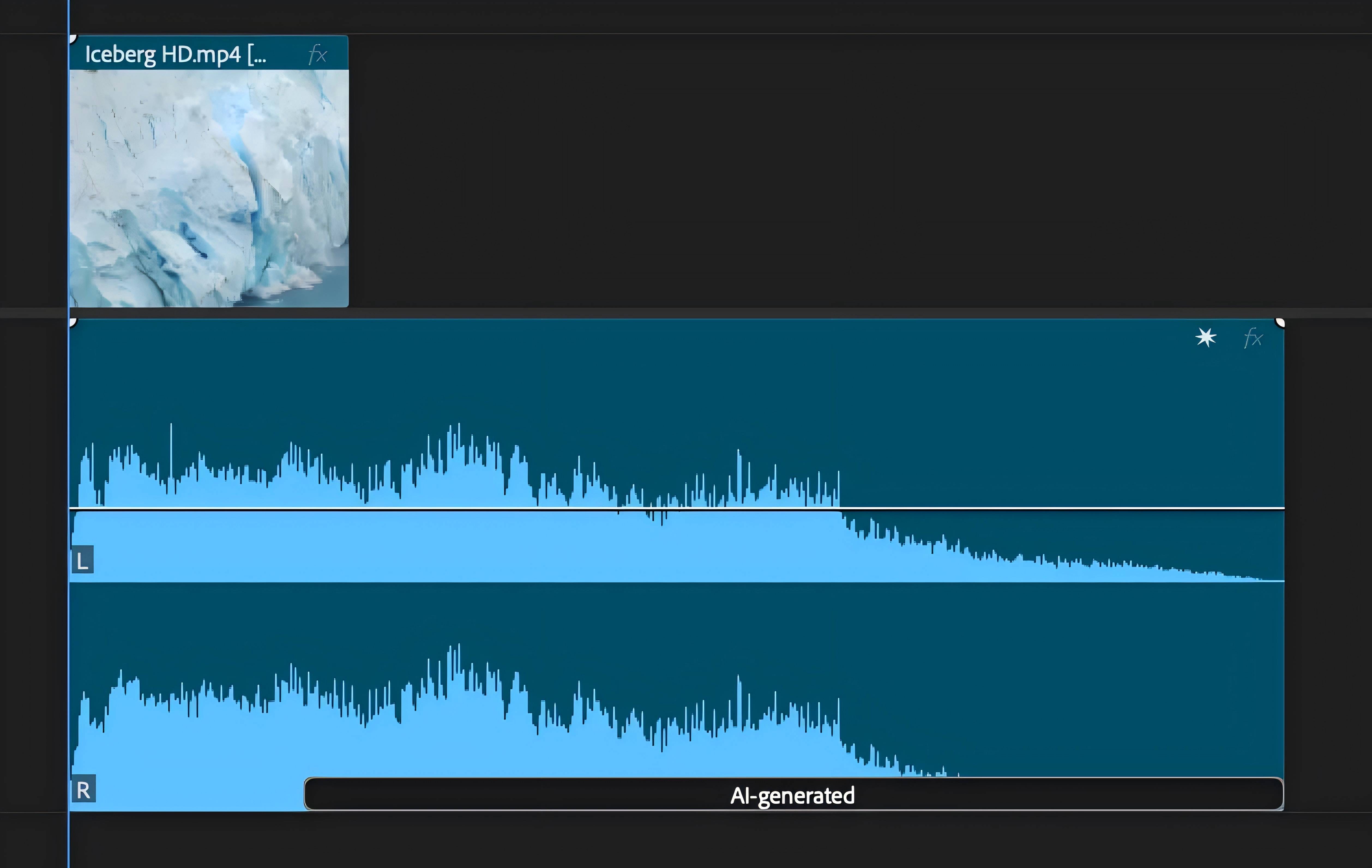

Neben Video kann Generative Extend auch für die reibungslose Bearbeitung von Audio verwendet werden. Es kann Hintergrundgeräusche in einem Video um bis zu zehn Sekunden verlängern, Dialoge oder Musik jedoch nicht.

▲Darstellung der Audio-Erweiterungsfunktion von Generative Extend (Bildquelle: Adobe)

Wenn Sie bei der Videoerstellung etwas Aufwand sparen möchten, können Sie die Text-to-Video-Funktion nutzen, um das Video direkt zu generieren. Wie bei seinen „alten Vorgängern“ Runway und Sora von OpenAI müssen Benutzer nur eine Textbeschreibung des Videos eingeben, das sie generieren möchten, und es kann verschiedene Stile wie „echter Film“, „3D-Animation“ und „Stop-Motion-Animation“ simulieren. Generieren Sie entsprechende Videoclips.

Hier sind einige Videoclips, die mit der Text-to-Video-Funktion erstellt wurden, um Ihnen ein Gefühl zu vermitteln:

▲Tipptext: Die Filmdrohne fliegt über die weite rote Marslandschaft, während sie unter uns fliegt, und der Horizont ist rot, wenn die Sonne aufgeht. Am Ende der Aufnahme geht die Sonne über dem Horizont auf. (Bildquelle: Adobe)

▲Eingabetext: Nahaufnahme des Films und Details eines Porträts eines alten Mannes mitten auf der Straße bei Nacht. Die Lichtatmosphäre ist langweilig und dramatisch. Der Farbgrad besteht aus blauen Schatten und orangefarbenen Glanzlichtern. Der Mann hat äußerst realistisch detaillierte Hauttexturen und sichtbare Poren. Die Bewegungen sind subtil und sanft. Die Kamera bewegt sich nicht. Filmkörnung. Alte anamorphotische Linse. (Bildquelle: Adobe)

▲Tipptext: Eine perspektivische Aufnahme in einer wunderschönen, pastellfarbenen Terrasse in Mexiko. Das Wasser ist klar und blau und glitzert in der Abendsonne. Die Farben sind warm und magisch in einem zauberhaften Stil. Hochwertiges, filmisches Gefühl. (Bildquelle: Adobe)

Neben realistischen, filmähnlichen visuellen Bildern unterstützt Text-to-Video auch die Generierung einiger „abstrakter“ Bilder. Beispielsweise können damit Videos erstellt werden, die Elemente wie Feuer, Wasser, Lichtlecks und Rauch enthalten, und diese über vorhandene Videos gelegt werden, um den vorhandenen Inhalten visuelle Tiefe und Interesse zu verleihen.

▲Tipptext: Filmlichtleck auf schwarzem Hintergrund, organische Textur, realistisch. (Bildquelle: Adobe)

▲Videoclips, die durch Kombination des obigen Videos mit vorhandenen Videos erstellt wurden (Bildquelle: Adobe)

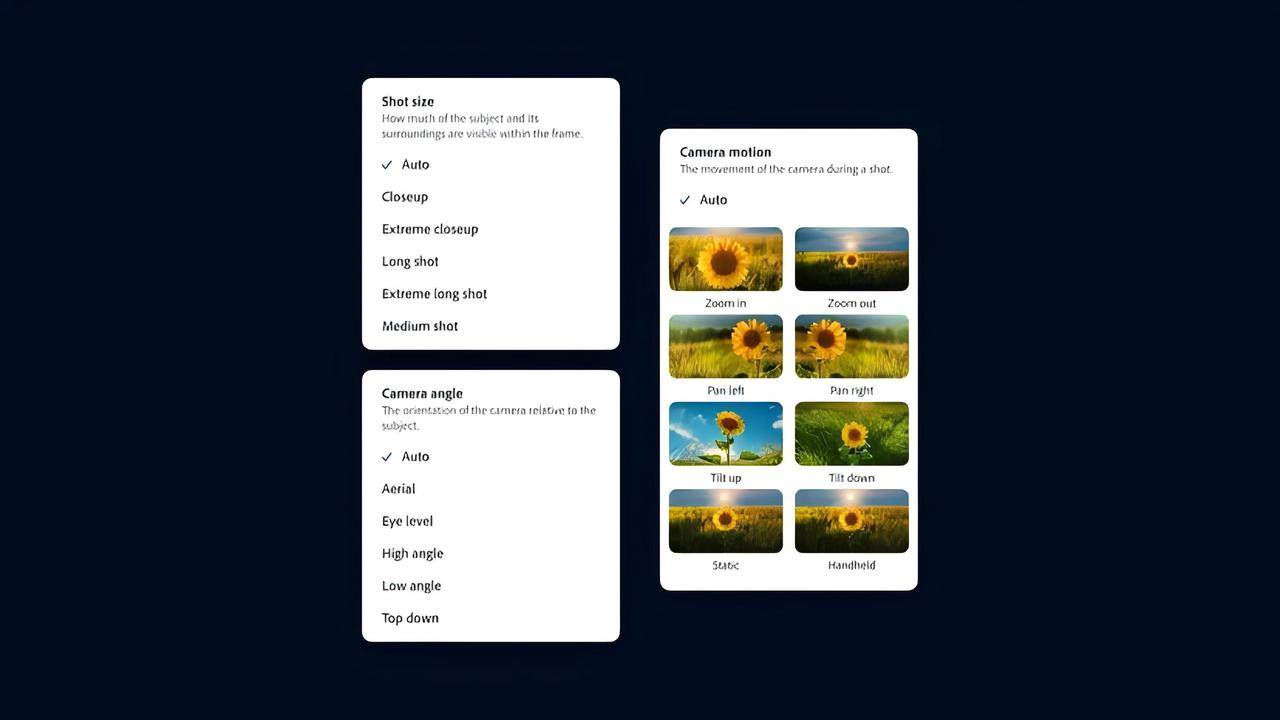

Erwähnenswert ist, dass mit Text-to-Video erstellte Videoclips auch mithilfe einer Reihe von „Kamerasteuerungen“ weiter verfeinert werden können, mit denen reale Kamerawinkel, Bewegungen, Aufnahmeentfernungen usw. simuliert werden können.

▲Kamerasteuerungsoptionen (Bildquelle: Adobe)

Die Image-to-Video-Funktion geht noch einen Schritt weiter und ermöglicht es Benutzern, während des Videoerstellungsprozesses „Referenzbilder“ hinzuzufügen, um Videos zu erstellen, die der Vorstellungskraft des Benutzers näher kommen.

Videoersteller können von einem Bild und Foto ausgehen und mithilfe der Image-to-Video-Funktion direkt eine „B-Rolle“ erstellen (ein Film- und Videoproduktionsbegriff, der sich auf das Hilfsvideo zusätzlich zum Hauptaufnahmeinhalt bezieht (A- Rollenmaterial).

Benutzer können auch komplette Nahaufnahmen erstellen, indem sie einzelne Videobilder hochladen und Image-to-Video die fehlenden Bilder automatisch ausfüllen lässt.

▲Eingabetext: Blumen wiegten sich im Wind und ein wunderschöner Schmetterling landete auf einer der Blumen. (Bildquelle: Adobe)

„Wie wir alle wissen, können Videos nicht kopiert werden, sie müssen also wahr sein.“

Durch die „Cyber-Remake“-Funktion von Image-to-Video gehört dieser Satz jedoch direkt der Vergangenheit an. Es ist wie eine „Hand Gottes“, die es Benutzern ermöglicht, Videoinhalte (Charakterbewegungen im Video usw.) direkt zu bedienen und zu ändern. Betrachten Sie das folgende Beispiel:

▲ Original-Videoclip (Bildquelle: Adobe)

▲Geänderter Videoclip, Aufforderungstext: Die Hand eines behandschuhten Astronauten dringt in den Rahmen ein und zieht eines der gelben Kabel ab, was ein filmisches Gefühl vermittelt. (Bildquelle: Adobe)

Derzeit generieren die Funktionen Text-to-Video und Image-to-Video Videoclips mit einer maximalen Länge von nur fünf Sekunden und einer Qualität von bis zu 720p und 24 Bildern pro Sekunde. Die Videoerstellungszeit beträgt etwa 90 Sekunden und Adobe entwickelt den „Turbo-Modus“, um diese Zeit zu verkürzen.

Die mangelnde Qualität der Videogenerierung zeigt, dass Benutzer das Firefly-Videomodell noch nicht zum Generieren eines vollständigen Films verwenden können und es vorerst nur als kreatives Hilfswerkzeug verwendet werden kann.

Adobe betont, dass das Firefly-Videomodell das Modell nur auf lizenzierten Inhalten (wie Adobe Stock) und gemeinfreien Inhalten trainiert, nicht auf vom Kunden bereitgestellten Inhalten.

Darüber hinaus können mit dem Firefly-Videomodell erstellte oder bearbeitete Videos Inhaltszertifikate einbetten, die den Urhebern und Inhaltsquellen einen Nachweis der Namensnennung liefern und dabei helfen sollen, KI-Nutzungs- und Eigentumsrechte zu deklarieren, um „kommerzielle Sicherheit“ zu gewährleisten.

Interessierte Leser können sich unter folgendem Link in die Warteliste für Adobe Firefly Video Model Experience eintragen:

https://www.adobe.com/products/firefly/features/ai-video-generator.html

# Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr) wird Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo