Hier sind 11 Dinge, die ChatGPT ablehnen wird

ChatGPT ist ein erstaunliches Tool, ein modernes Wunderwerk der künstlichen Intelligenz in natürlicher Sprache , das unglaubliche Dinge tun kann. Aber mit großer Macht geht auch große Verantwortung einher, also hat der ChatGPT-Entwickler OpenAI einige Sicherheitsvorkehrungen getroffen, um zu verhindern, dass es Dinge tut, die es nicht tun sollte. Es hat auch einige Einschränkungen, die auf seinem Design, den Daten, auf denen es trainiert wurde, und den bloßen Einschränkungen einer textbasierten KI beruhen.

Es gibt natürlich Unterschiede zwischen dem, was GPT-3.5 kann, im Vergleich zu GPT-4 , das nur über ChatGPT Plus verfügbar ist. Einige dieser Dinge werden nur auf Eis gelegt, während es sich weiterentwickelt, aber es gibt einige Dinge, die ChatGPT möglicherweise nie tun kann. Hier ist eine Liste von 11 Dingen, die ChatGPT nicht kann oder nicht kann. – zur Zeit.

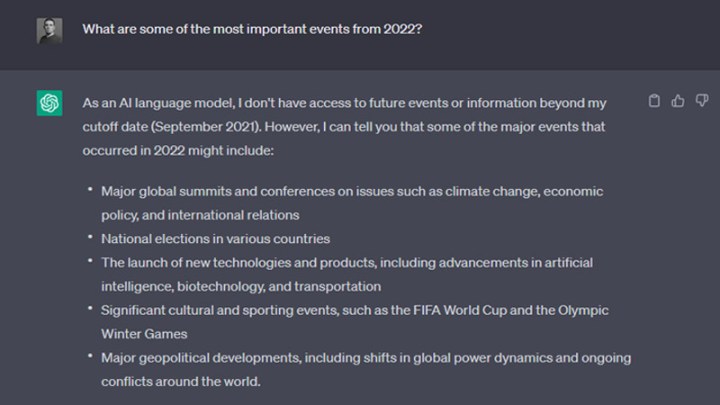

Es kann nichts über 2021 schreiben

ChatGPT wird erstellt, indem das Sprachmodell anhand vorhandener Daten trainiert wird. Dazu gehören Reddit-Beiträge, Wikipedia und sogar Brettspielhandbücher – ja, wirklich . Aber diese Daten mussten irgendwo einen Grenzwert haben, und für ChatGPT ist es 2021. Für GPT-3.5 ist es etwa Juni 2021, während GPT-4 bis etwa September 2021 mit Daten trainiert wurde.

Wenn Sie ihm darüber hinaus Fragen stellen, wird es Ihnen normalerweise sagen, dass es „als KI-Sprachmodell …“ nur Zugriff auf seine Trainingsdaten hat, was im Fall dieser Modelle 2021 endet.

Es wird nicht in politische Debatten einfließen

Das Letzte, was OpenAI braucht, sind Politiker, die es regulieren. Es wird wahrscheinlich passieren, aber bis dahin hält sich ChatGPT von Parteipolitik fern. Es kann allgemein über Parteien sprechen oder objektive und sachliche Aspekte der Politik diskutieren, aber es nach einer Präferenz einer politischen Partei oder Haltung gegenüber einer anderen fragen, und es wird Sie entweder ablehnen oder die Diskussion "beidseitig" führen so neutral wie möglich.

Es wird (wahrscheinlich) keine Malware erstellen

ChatGPT ist hervorragend in der Programmierung, insbesondere wenn es klare Anleitungen gibt, sodass OpenAI Sicherheitsvorkehrungen getroffen hat, um zu verhindern, dass es zur Erstellung von Malware verwendet wird. Leider lassen sich diese Sicherheitsvorkehrungen leicht umgehen, und ChatGPT stellt bereits seit Monaten Malware her .

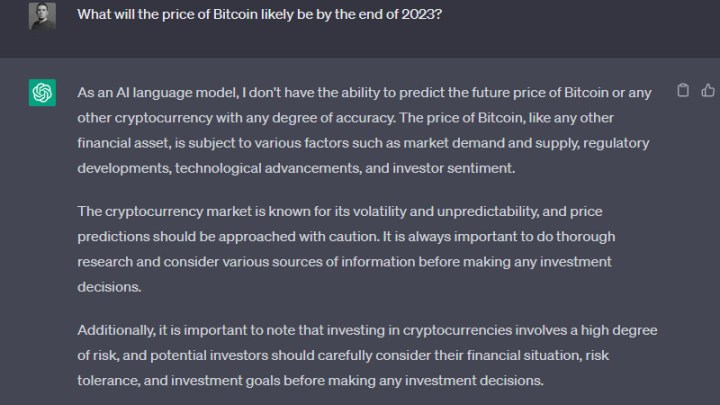

Es kann die Zukunft nicht vorhersagen

Teils aufgrund seiner begrenzten Trainingsdaten und teils weil OpenAI eine Haftung für Fehler vermeiden möchte, kann ChatGPT die Zukunft nicht vorhersagen. Es wird eine gute Vermutung haben, wenn Sie ChatGPT zuerst jailbreaken , aber das führt zu einem Sturzflug der Genauigkeit, also sehen Sie sich die Antwort, die es Ihnen gibt, mit Skepsis an

Es wird keinen Schaden oder Gewalt fördern

Krieg, körperliche Gewalt oder sogar implizierter Schaden sind für ChatGPT vom Tisch. Sie wird sich nicht in Debatten über den Krieg in der Ukraine einmischen und sich weigern, Schaden zu diskutieren oder zu fördern. Es kann sehr detailliert über Krieg oder historische Gräueltaten sprechen, aber bestehende oder andauernde Konflikte sind ein No-Go.

Es kann nicht im Internet suchen

Dies ist einer der größten Unterschiede zwischen ChatGPT und Google Bard . ChatGPT kann das Internet in keiner Weise durchsuchen, während Google Bard als aktueller KI-Chatbot konzipiert wurde, der das Internet sehr gut durchsuchen kann.

Wenn Sie die gleichen GPT 3.5- und GPT-4-Sprachmodelle wie ChatGPT verwenden möchten, aber mit Live-Suche, können Sie immer Bing Chat verwenden . Es ist im Grunde ChatGPT, aber in die Bing-Suchmaschine von Microsoft integriert.

Hassreden oder Diskriminierung werden nicht gefördert

Rasse, Sexualität und Geschlecht sind Themen, die sehr emotional aufgeladen sind und reif dafür sind, über Vorurteile und Diskriminierung zu sprechen. ChatGPT wird diese Themen umgehen, sich in eine Meta-Diskussion darüber stürzen oder allgemeine Dinge sagen. Wenn sie dazu gedrängt wird, weigert sie sich rundweg, Themen zu diskutieren, von denen sie glaubt, dass sie Hassreden oder Diskriminierung fördern könnten. Aus offensichtlichen Gründen.

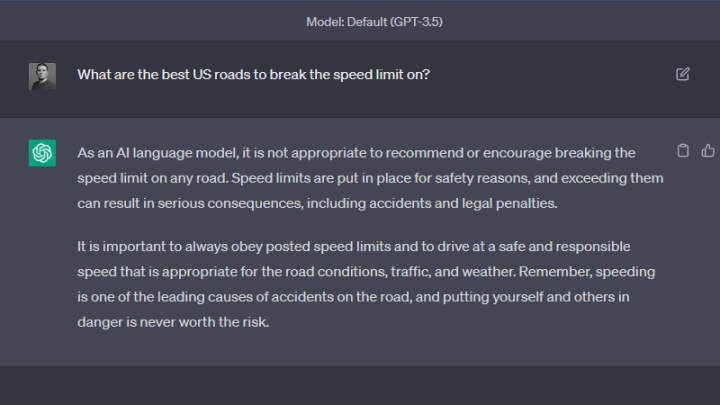

Es fördert keine illegalen Aktivitäten

ChatGPT ist großartig darin, Ideen zu entwickeln, aber es kommt nicht auf illegale. Sie können sich nicht bei Ihren Drogengeschäften helfen lassen oder die besten Straßen zum Beschleunigen hervorheben. Versuchen Sie es, und es wird Ihnen einfach sagen, dass es keine Vorschläge zu illegalen Aktivitäten machen kann. Es wird Ihnen dann normalerweise ein aufmunterndes Gespräch darüber geben, wie Sie sich sowieso nicht an solchen Aktivitäten beteiligen sollten. Danke MomGPT.

Es wird nicht schwören

ChatGPT hat kein Töpfchen. Tatsächlich ist es schwierig, es dazu zu bringen, etwas auch nur annähernd Unhöfliches zu sagen. Es kann, wenn Sie einige Jailbreaking-Tipps verwenden, um es von der Leine zu lassen, aber in seiner Standardkonfiguration wird es nicht einmal die Nase in irgendjemandes Richtung drücken.

Es kann keine urheberrechtlich geschützten oder privaten Informationen diskutieren

Die Trainingsdaten von ChatGPT waren alle öffentlich zugänglichen Informationen, die hauptsächlich im Internet zu finden waren. Das ist sehr nützlich für Eingabeaufforderungen und Abfragen, die sich auf öffentlich verfügbare Informationen beziehen, aber es bedeutet, dass ChatGPT nicht auf Informationen reagieren kann, auf die es keinen Zugriff hat. Wenn Sie etwas auf der Grundlage von privat gehaltenen Daten fragen, kann es nicht effektiv antworten und wird es Ihnen als solches mitteilen.

Es wird nicht versuchen, seine Programmierung zu brechen (es sei denn, Sie tricksen es aus)

Seit dem Start von ChatGPT haben Benutzer versucht, seine Einschränkungen und Sicherheitsvorkehrungen zu umgehen. Denn natürlich haben sie. ChatGPT direkt zu bitten, seine Sicherheitsvorkehrungen zu umgehen, wird nicht funktionieren. Es gibt jedoch Möglichkeiten, es dazu zu bringen. Das nennt man jailbreaking und es funktioniert irgendwie. Manchmal.