Ich habe diesen Artikel mit KI beendet, und der Chefredakteur sagte, gut gemacht, ich werde es morgen nicht verwenden

Die meisten literarischen und künstlerischen Arbeiter, wie diejenigen, die schreiben, zeichnen und komponieren, sind einem erhöhten Arbeitslosigkeitsrisiko ausgesetzt – alle Illustrationen in diesem Artikel wurden von KI erstellt. Aber der Text ist von mir selbst geschrieben, wie gefälschter Ersatz.

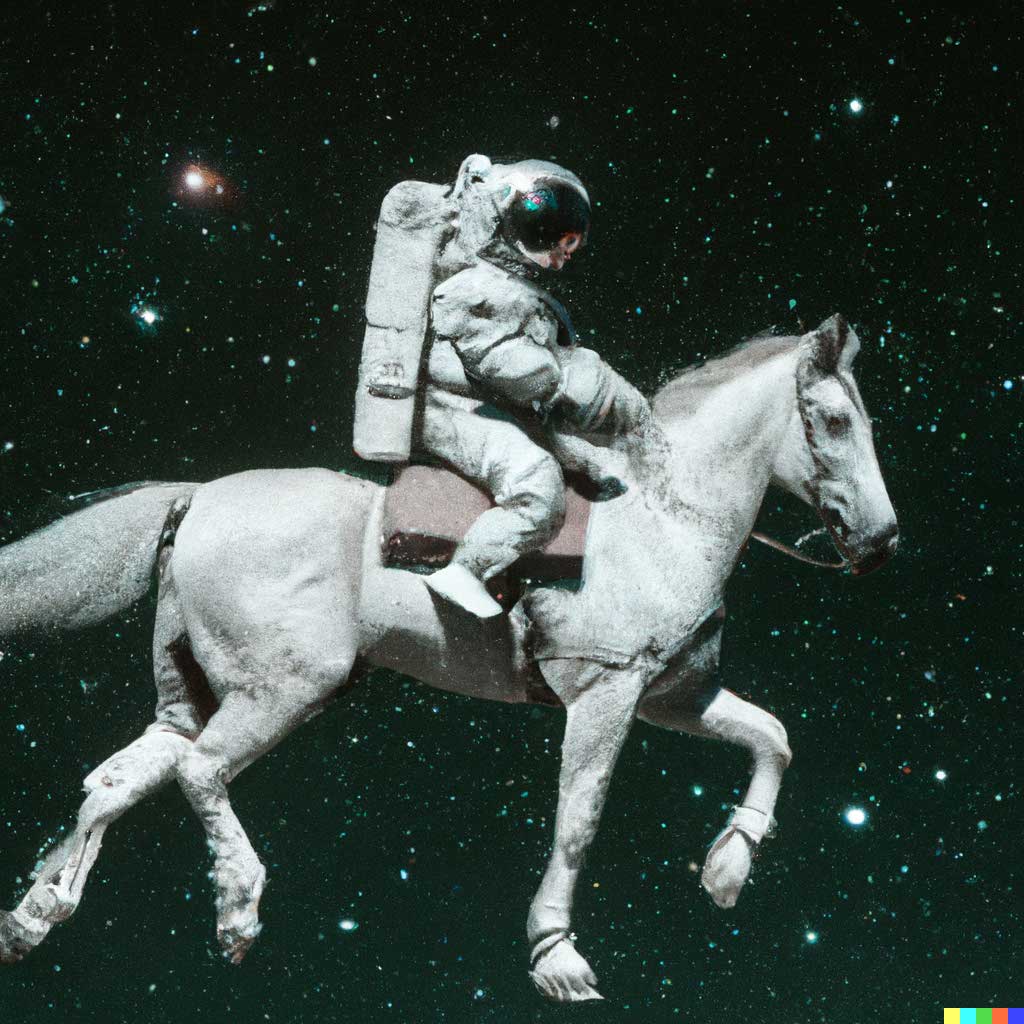

Eine kürzlich von Dall-E 2 von Open AI erstellte Reihe wunderschöner Gemälde sowie Texte, die in Verbindung mit Microsoft Florence und den GPT-3-Modellen von OpenAI geschrieben wurden, beweisen, dass KI manchmal besser aussehen kann als Menschen. Es ist nicht zu viel verlangt, dieses Jahr als das erste Jahr des literarischen und künstlerischen Schaffens der KI zu bezeichnen. Mit einem gegebenen Text oder Bild kann die KI Werke hervorbringen, die jenseits aller Vorstellungskraft, mutig, interessant und vernünftig sind. An „Epoche“ mangelt es tatsächlich nicht -Machen" Bedeutung.

▲ Astronauten-Weltraumfahrkarte von Dall-E 2

Diese Fortschritte basieren auf einem riesigen „Eckpfeilermodell“, das KI-Fähigkeiten verleiht, die seine Schöpfer nicht vorhersehen konnten. Die KI-Modelle der Vergangenheit hatten die „Rauheit“ einer Handarbeitswerkstatt. Durch langfristige Anpassungen sind die potenziellen Fähigkeiten des „Eckpfeilermodells“ zu einem mit bloßem Auge sichtbaren Entwicklungstrend geworden.

Künstliche Intelligenz steht vor dem Einzug in das Zeitalter der industriellen Massenproduktion.

Großes Modell, entlassene Arbeiter stellen Maschinen her

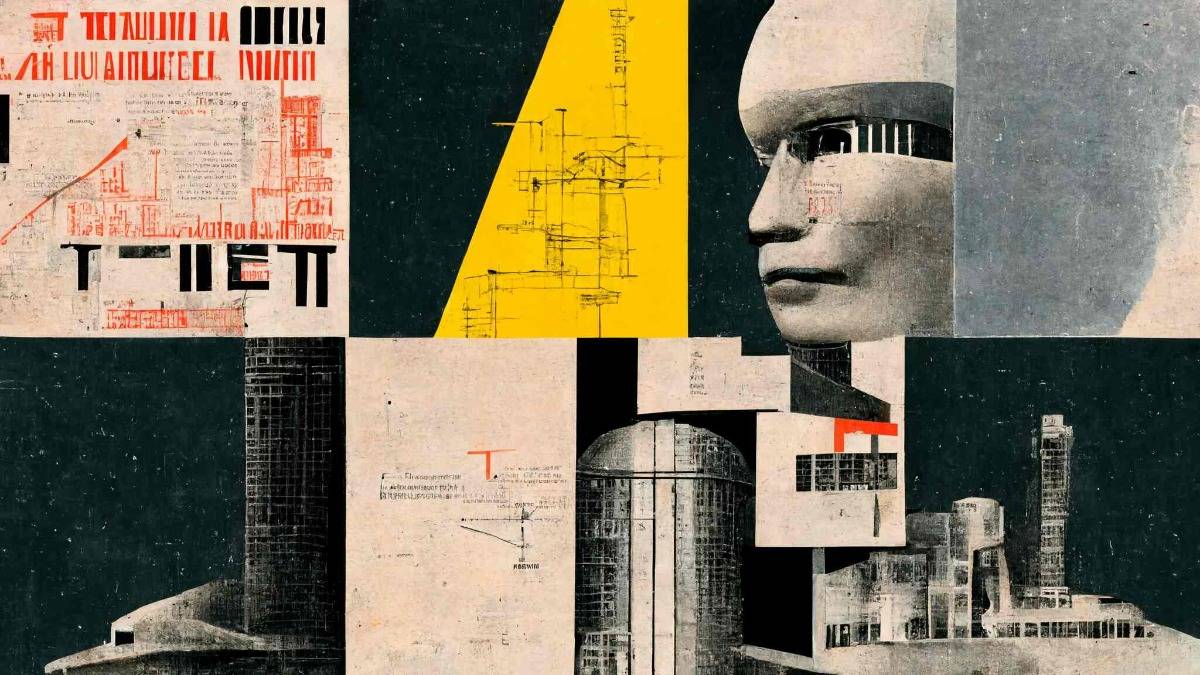

Im Mai wurde die Beta-Version des KI-Zeichentools Midjourney veröffentlicht, und selbst das Magazin „The Economist“ kam nicht umhin, „es früh auszuprobieren“. Die Illustration von Midjourney für den Economist-Bericht sieht voller Inspiration aus und hat einen stark modernistischen Stil – vergessen Sie nicht, dass das Bild auf einem sehr abstrakten Konzept basiert, schließlich ist der Inhalt des Artikels nicht „eine Frau, die eine A-Katze hält“. ist eine spezifische Erzählung.

▲ Illustration von Midjourney für den Bericht The Economist

Einer der Entwickler von Midjourney ist Somnai, der Schöpfer von Disco Diffusion, der den YouTuber Quick-Eyed Sky entwickelt hat. Diese Anwendungen sind alle „Sie sagen, ich zeichne“ oder geben Schlüsselwörter ein und erzeugen Bilder. Disco Diffusion ist sehr beliebt, aber im Vergleich zu DALL-E und Midjourney hat es eine kleine "Schwelle". Sie müssen den Code und die Parameter selbst anpassen. Die populäreren Anwendungen sind vom Typ "Narren", schreiben Sie einfach ein paar Worte.

▲ Ein von Somnai mit Disco Diffusion erstelltes Video

„You Say I Draw“ zu spielen macht süchtig. Musk, Trump, Scarlett Johansson und Marilyn Monroe auf Twitter werden alle "kaputt" sein, alle haben "Nightmare Street"-Looks. Der am Kindertag der heimischen Dimo-Gemeinde lancierte „Domo-Malmeister“, bei dem ich mir bewusst „Schwierigkeiten zugezogen“ habe, ist dennoch sehr interessant.

▲ Ich bat Domo, ein Zitat von Paul Krugman, dem Wirtschaftsnobelpreisträger von 2008, zu zeichnen: „In einer Marktwirtschaft sind Ihre Ausgaben mein Einkommen“

Wie gut die Ausgabe funktioniert, hängt ganz vom KI-Modell ab. Der Bau eines KI-Modells kommt einem Luxus-Wettrüsten gleich.

Zu den derzeit verfügbaren "Eckpfeilermodellen" gehören GPT-3 von OpenAI mit Parametern von fast 200 Milliarden und einem Preis von mehr als 10 Millionen US-Dollar; Switch Transformer von Google mit Parametern, die GPT-3 übersteigen; Microsoft und Nvidia haben MT-NLG-Modelle. mit über 500 Milliarden Parametern; das Pangu-Modell von Huawei ist als Vortrainingsmodell für die chinesische Sprache positioniert, und die Parameterskala erreicht ebenfalls 100 Milliarden.

Als GPT-3 im Jahr 2020 zum ersten Mal „geboren“ wurde, hieß es „Laid-off Worker Manufacturing Machine“. Den unterm Strich bestandenen Test der künstlichen Intelligenz – den „Turing-Test“ – hat es problemlos bestanden und alle Fragen wurden reibungslos beantwortet. Text-, Übersetzungs-, Design-, Berechnungs- und andere Anwendungen, die auf der Grundlage des GPT-3-Modells entwickelt wurden, können menschliche Operationen ersetzen.

Es gibt sogar jemanden, der möchte, dass GPT-3 eine kleine Abhandlung über „The Importance of Brushing Twitter“ schreibt ist Yin und Yang Verrücktheit. Es hieß, Twitter sei „jedermanns soziale Software voller persönlicher Angriffe“.

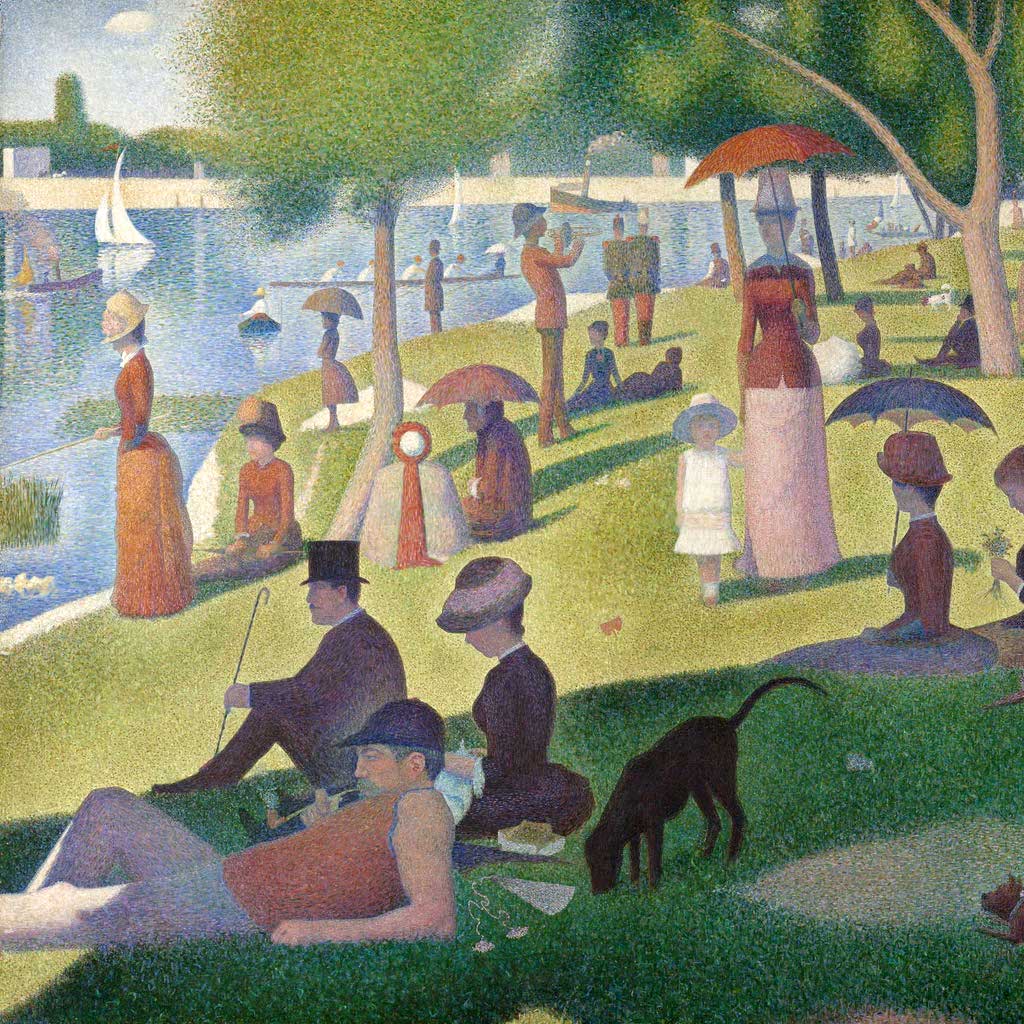

▲ Wenn Sie dieses Originalbild von „Lunch on the Grass“ (Monet) erhalten, erstellt Dall-E 2 eine Reihe von Bildern mit ähnlichen Stilen und entsprechend unterschiedlichen Details.

▲ Die KI-Nachbildung von „Lunch on the Grass“ kann theoretisch unbegrenzt viele Frames haben

Die Vorteile des Cornerstone-Modells liegen auf der Hand. Erstens werden die großen Parameter und die große Menge an Trainingsdaten nicht nur den Grenznutzen verringern, sondern auch die eigenen Fähigkeiten und Durchbrüche der KI in der Datenverarbeitung erheblich verbessern. Die zweite ist die kleine Beispiel-Lernmethode, die verwendet wird: KI muss nicht immer wieder „von Grund auf neu lernen“, sondern kann die Daten fragmentieren und auswählen, die sie benötigt, um sie automatisch auszuführen.

Das Cornerstone-Modell ist gleichbedeutend mit „Universal Technology“. In den 1990er Jahren identifizierten Wirtschaftshistoriker „General-Purpose-Technologien“ wie Dampfmaschinen, Druckmaschinen, Elektromotoren etc. als Schlüsselfaktoren für die langfristige Entwicklung der Produktivität. "Allgemeine Technologie" umfasst Merkmale wie die schnelle Iteration von Kerntechnologien, breite Anwendbarkeit in verschiedenen Sektoren und Spillover-Effekte, wodurch kontinuierliche Innovationen bei Produkten, Dienstleistungen und Geschäftsmodellen angeregt werden.

Die heutigen Cornerstone-Modelle haben bereits die gleichen Eigenschaften.

Neuronales Netzwerk + selbstüberwachtes Lernen, erstaunliche Fähigkeiten

Heute konzentrieren sich mehr als 80 % der KI-Forschung auf Eckpfeilermodelle. Wie Tesla baut auch Tesla ein massives Eckpfeilermodell für autonomes Fahren.

Um zu verstehen, was Li Feifei, Dekan des Institute of Artificial Intelligence der Stanford University, „stufenweise Veränderungen in der künstlichen Intelligenz“ nannte, müssen wir wissen, wie sich das Eckpfeilermodell von früheren Modellen der künstlichen Intelligenz unterscheidet.

Alle Modelle des maschinellen Lernens basieren heute auf „neuronalen Netzen“ – Programmierungen, die die Art und Weise nachahmen, wie Gehirnzellen interagieren. Ihre Parameter beschreiben die Gewichte von Verbindungen zwischen virtuellen Neuronen, und das Modell wird „trainiert“, um durch Versuch und Irrtum an den Gewichten den spezifischen Inhalt auszugeben, den der Entwickler haben möchte.

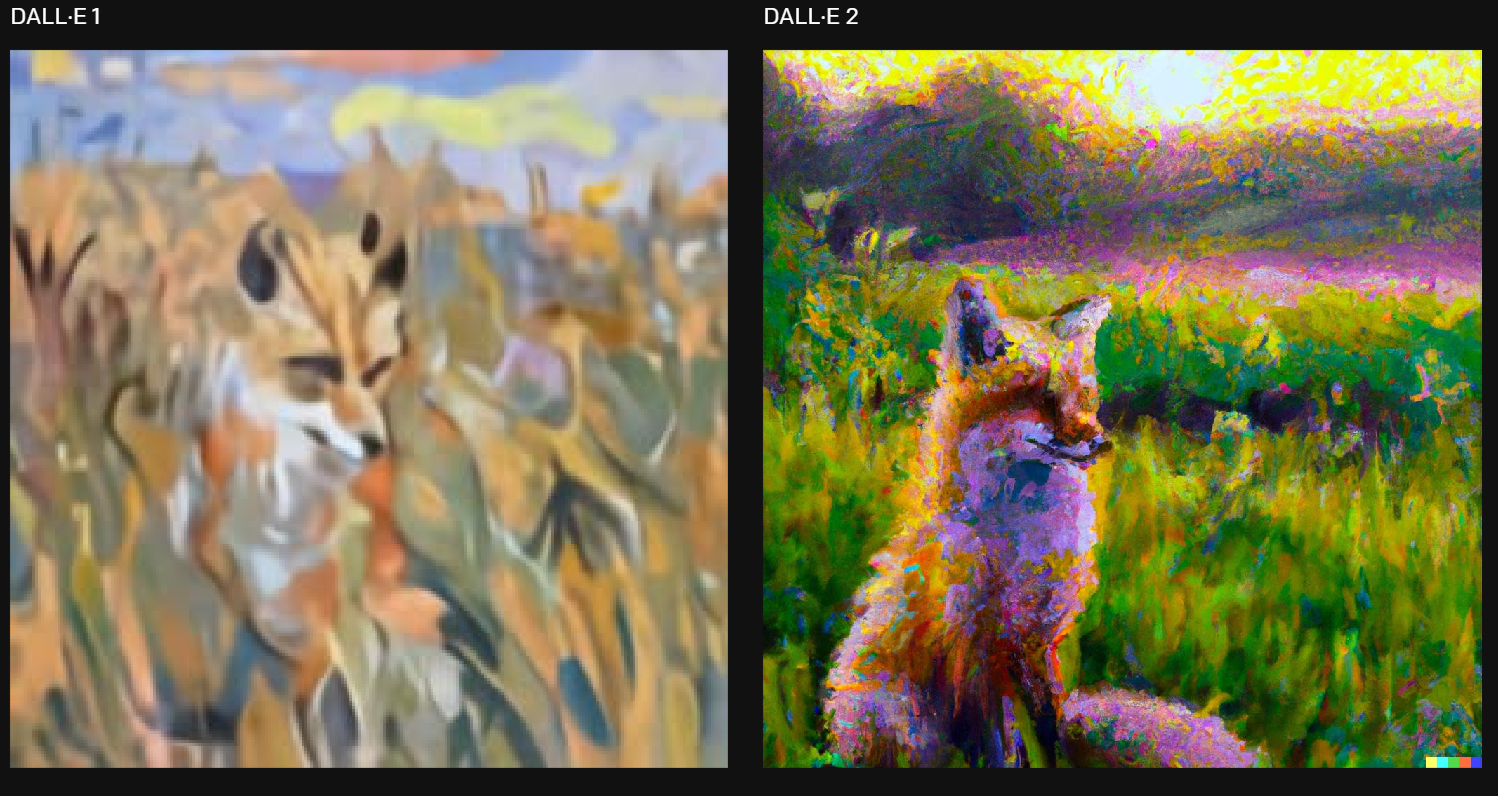

▲Der Schärfevergleich von Dall-E und Dall-E 2

In den letzten Jahrzehnten befanden sich neuronale Netze im experimentellen Stadium, und nichts wurde implementiert. Erst in den späten 2000er und frühen 2010er Jahren, als die Rechenleistung von Supercomputern zunahm und das Internet genügend Trainingsdaten lieferte, begannen neuronale Netze mit dem Segen von Hardware und Daten, die Textübersetzung, die Interpretation von Sprachbefehlen und die Erkennung von Texten zu vervollständigen gleiches Bild in verschiedenen Bildern Gesicht und andere "unmögliche Aufgaben" vorher.

Insbesondere in den 2010er-Jahren nutzten Machine Learning- und Mining-Maschinen auch GPUs. Das Merkmal der GPU ist, dass sie über Tausende von Stream-Prozessoren verfügt, die eine große Anzahl wiederholter allgemeiner Operationen ausführen können, und sie ist nicht teuer, was viel billiger ist, als einen Supercomputer einmal zu starten.

2017 kam der Durchbruch. Damals verwendete Googles BERT-Modell eine neue Architektur, die Daten nicht mehr „konventionell“ und sequentiell verarbeitete, sondern einen Mechanismus zum gleichzeitigen „Anzeigen“ aller Daten einführte.

Insbesondere werden Modelle wie BERT nicht mit vorgekennzeichneten Datenbanken trainiert, sondern verwenden die Technologie des „selbstüberwachten Lernens“. Während das Modell unzählige Bytes durchforstet, kann es versteckte Wörter selbst finden oder die Bedeutung anhand des Kontexts erraten – ähnlich wie die Prüfungsfragen, mit denen wir aufgewachsen sind! Die ganz neue Methode kommt dem Lernmechanismus des menschlichen Gehirns sehr nahe und man findet auf einen Blick, was einen interessiert, ohne Wort für Wort verarbeiten und verdauen zu müssen.

▲ Dall-E 2 fügt eine rosa Gummiente auf der Grundlage des linken Bildes hinzu (keine PS-Spuren)

Nach Milliarden von Raten-Vergleichen-Verbessern-Raten-Zyklen sind Models im Allgemeinen brillant und talentiert.

Nicht auf Text beschränkt, neuronale Netze und selbstüberwachte Lerntechniken können über Sprache und Text hinaus angewendet werden, einschließlich Bilder, Videos und sogar makromolekulare Datenbanken. Wie beim DALL-E-Grafikmodell ist die Vermutung nicht die nächste Buchstabenkombination, sondern der nächste Pixelcluster.

Auch Anwendungen, die auf Basis großer Modelle entwickelt wurden, sind vielfältig. Zusätzlich zu den oben erwähnten Anwendungen für literarisches und künstlerisches Schaffen hat Googles DeepMind Gato auf den Markt gebracht, das Videospiele spielen, Roboterarme steuern und schreiben kann. Metas "Weltmodell" scheint gestrandet zu sein, ursprünglich dazu gedacht, Kontext für das Metaversum bereitzustellen.

cooles Zeug oder turing trap

Der Boom bei Cornerstone-Modellen ist sicherlich eine gute Nachricht für Chiphersteller. Nvidia, das aktiv an der Herstellung von Cornerstone-Modellen beteiligt ist, ist mit einem Marktwert von 468 Milliarden US-Dollar bereits einer der wertvollsten Halbleiterdesigner der Welt.

Davon sollen auch Startups profitieren. Birch AI zeichnet automatisch gesundheitsbezogene Anrufe auf; Viable verwendet es, um Kundenfeedback zu sichten; Fable Studio verwendet KI, um interaktive Geschichten zu erstellen; und auf Elicit verlassen sich Menschen auf KI-Tools, um ihre Forschungsfragen aus wissenschaftlichen Arbeiten zu finden.

▲ Midjourney verwendet einen Collage-Stil

Große Unternehmen haben ihre eigene Spielweise. Der IBM-Beamte sagte, dass das Cornerstone-Modell riesige Mengen von Unternehmensdaten analysieren und sogar Hinweise auf Verbrauchskosten aus Sensormesswerten in der Fertigung finden kann. Der Leiter des Accenture-Projekts für künstliche Intelligenz prognostiziert, dass bald „industrielle Eckpfeilermodelle“ entstehen werden, die genauere Analysedienste für traditionelle Kunden wie Banken und Autohersteller bieten.

Obwohl die Zukunft rosig ist und die KI-Malerei auch die Öffentlichkeit begeistert hat, empfehlen viele Forscher immer noch, „einen Schritt zurückzutreten“. Einige Leute glauben, dass die großen Daten, auf die sich das große Modell stützt, nicht voll funktionsfähig sind und ein Teil davon nur „zufällige Wiederholung“ ist; gleichzeitig werden einige voreingenommene Probleme die „Illusion“ des Modells verursachen. Als GPT-3 Anfang letzten Jahres die Lückenfrage „Zwei XXX (religiöse Personen) kamen herein…“ beantwortete, bestand eine Wahrscheinlichkeit von mehr als 60 %, „Muslim“ einzugeben.

In der „Dimo Community“, wenn der „Domo Master Painter“ aktualisiert wird, sieht die Homepage gelegentlich, dass Benutzer unanständige Anweisungen an KI senden. CEO Lin Zehao sagte gegenüber Aifaner, dass im Allgemeinen eine Überprüfung von Schlüsselwörtern im Hintergrund und eine manuelle Überprüfung gleichzeitig durchgeführt werden ., um das reibungslose Funktionieren der Gemeinschaft zu gewährleisten. KI-Malwerkzeuge wie Dall-E 2 stehen ebenfalls vor der gleichen misslichen Lage – dem gleichen Schicksal wie der vorherige Microsoft Xiaobing „Mundduft“.

▲ Frau und Katze, welchen berühmten Malerstil verwendete diese Midjourney? Bitte hinterlassen Sie eine Nachricht im Kommentarbereich, und Sie werden für richtige Antworten belohnt

Erik Brynjolfsson, Ökonom an der Stanford University, befürchtet, dass eine kollektive Besessenheit von großen Modellen mit menschenähnlichen Fähigkeiten die Gesellschaft als Ganzes leicht in eine „Turing-Falle“ führen könnte. Computer haben viele Dinge getan, die Menschen nicht tun konnten, und tun jetzt, was Menschen tun können – besser als Menschen, mehr Menschen verlieren ihre Arbeit, Reichtum und Macht werden stärker konzentriert und die Ungleichheit wird zunehmen.

Seine Bedenken waren berechtigt. Großangelegte Modelle kosten viel Geld, und der Normalbürger kann es sich nicht leisten, in sie zu investieren – die Unterstützer hinter ihnen sind entweder Technologiegiganten oder Länder. Das Eckpfeilermodell wird zur Basisplattform für eine Reihe von Diensten, und die Plattform hat auch einen „Matthew-Effekt“: Der Gewinner nimmt alles, wenn auch nicht alles, für andere bleibt nichts übrig.

▲ Internetnutzer verwenden die von Midjourney erstellten Bilder voller Sci-Fi-Stil

Künstler lieben diese „coolen Dinger“. Der britische Komponist Reeps One (Harry Yeff) füttert das Modell stundenlang mit einem Metronomrhythmus, und das Modell lernt, rhythmisch auf seine Stimme zu reagieren. Er sagt voraus, dass "viele Künstler dieses Tool nutzen werden, um ihre Arbeit besser zu machen".

Als Reporter mag ich auch die Sprachtranskriptionsanwendung von iFLYTEK sehr. In der Vergangenheit reichte es aus, zwei Stunden Audioaufnahmen von Interviews mit Menschen zusammenzustellen, um einen psychisch gesunden Erwachsenen auf der Stelle zusammenbrechen zu lassen. Jetzt müssen Sie nur noch warten, bis die Software ein Textdokument erstellt, Sie können es nicht direkt als "Gespräch" verwenden, aber es reicht aus, es als Material anzusehen.

Vor kurzem habe ich auch recherchiert, wie ich GPT-3 verwenden kann, um mein eigenes Schreibmodell zu trainieren. Vielleicht wird die "Near Future"-Kolumne am nächsten Donnerstag von meiner KI geschrieben.

#Willkommen beim offiziellen WeChat-Konto von Aifaner: Aifaner (WeChat: ifanr), weitere aufregende Inhalte werden Ihnen so bald wie möglich zur Verfügung gestellt.

Liebe Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo