Nvidias neues Guardrails-Tool behebt das größte Problem mit KI-Chatbots

Nvidia stellt sein neues Tool NeMo Guardrails für KI-Entwickler vor und verspricht, KI-Chatbots wie ChatGPT etwas weniger verrückt zu machen. Die Open-Source-Software steht Entwicklern ab sofort zur Verfügung und konzentriert sich auf drei Bereiche, um KI-Chatbots nützlicher und weniger beunruhigend zu machen.

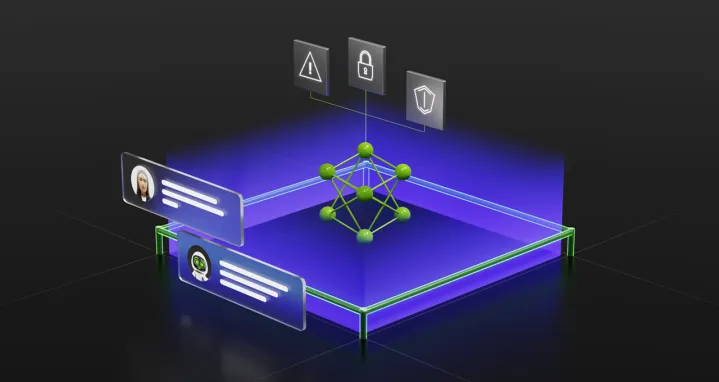

Das Tool befindet sich zwischen dem Benutzer und dem Large Language Model (LLM), mit dem er interagiert. Es ist eine Sicherheit für Chatbots, die Antworten abfangen, bevor sie das Sprachmodell erreichen, um entweder das Modell an der Antwort zu hindern oder ihm spezifische Anweisungen zu geben, wie es antworten soll.

Laut Nvidia konzentriert sich NeMo Guardrails auf aktuelle, Sicherheits- und Sicherheitsgrenzen. Der thematische Fokus scheint am nützlichsten zu sein, da er den LLM zwingt, in einem bestimmten Antwortbereich zu bleiben. Nvidia demonstrierte Guardrails, indem es einen Chatbot zeigte, der mit der HR-Datenbank des Unternehmens trainiert wurde. Auf eine Frage zu Nvidias Finanzen gab es eine vorgefertigte Antwort, die mit NeMo Guardrails programmiert war.

Dies ist wichtig aufgrund der vielen sogenannten Halluzinationen, die wir bei KI-Chatbots gesehen haben. Bing Chat von Microsoft beispielsweise lieferte uns in unserer ersten Demo einige bizarre und sachlich falsche Antworten. Wenn das LLM mit einer Frage konfrontiert wird, die es nicht versteht, wird es oft eine Antwort erfinden, um die Frage zu beantworten. NeMo Guardrails zielt darauf ab, diesen erfundenen Antworten ein Ende zu setzen.

Die Sicherheitsgrundsätze konzentrieren sich darauf, unerwünschte Antworten aus dem LLM herauszufiltern und zu verhindern, dass Benutzer damit spielen. Wie wir bereits gesehen haben, können Sie ChatGPT und andere KI-Chatbots jailbreaken . NeMo Guardrails übernimmt diese Abfragen und blockiert, dass sie jemals das LLM erreichen.

Obwohl NeMo Guardrails entwickelt wurde, um Chatbots themenbezogen und genau zu halten, ist es keine Allheillösung. Nvidia sagt, dass es am besten als zweite Verteidigungslinie funktioniert, und dass Unternehmen, die Chatbots entwickeln und einsetzen, das Modell dennoch mit einer Reihe von Sicherheitsvorkehrungen trainieren sollten.

Entwickler müssen das Tool auch an ihre Anwendungen anpassen. Dadurch kann NeoMo Guardrails auf Middleware aufsetzen, die bereits von KI-Modellen verwendet wird, wie z. B. LangChain, das bereits einen Rahmen dafür bietet, wie KI-Chatbots mit Benutzern interagieren sollen.

Nvidia ist nicht nur Open Source, sondern bietet auch NeMo Guardrails als Teil seines AI Foundations-Dienstes an. Dieses Paket bietet mehrere vortrainierte Modelle und Frameworks für Unternehmen, die nicht die Zeit oder die Ressourcen haben, ihre eigenen Modelle zu trainieren und zu warten.