Wird Ihnen Ihre Sichtweise nicht wirklich von der KI vorgegeben?

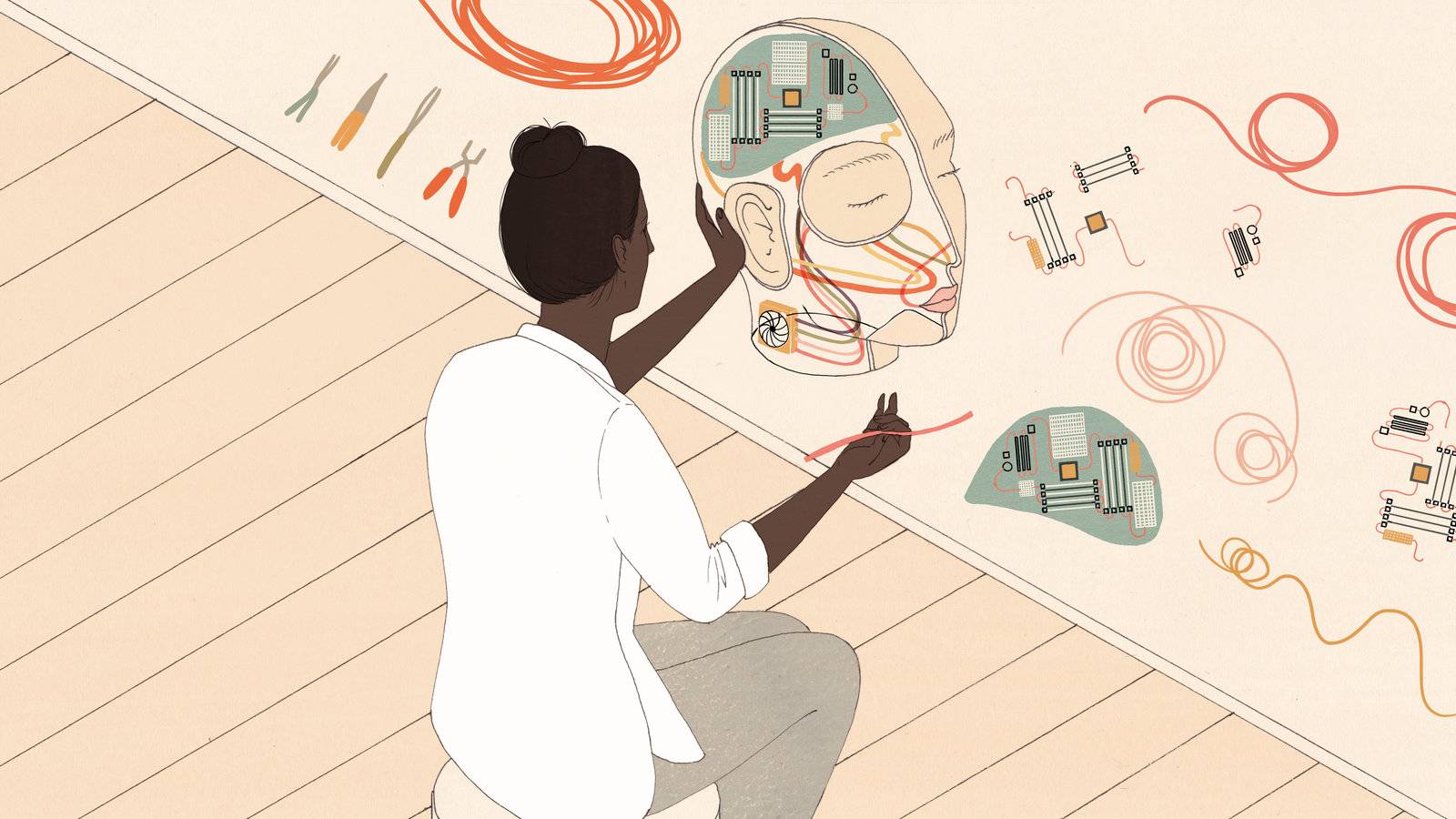

In unserer Beziehung zu Werkzeugen ging es nie nur um „benutzen“ und „benutzt werden“.

Obwohl ChatGPT dazu geführt hat, dass immer mehr Menschen auf das Potenzial von KI aufmerksam werden, nutzen wir KI-Tools tatsächlich schon seit langem. Unser Verständnis über die Auswirkungen von Werkzeugen auf den Menschen ist jedoch noch relativ gering.

Viele Menschen wissen bereits, dass die Empfehlungsalgorithmen von Social-Media-Plattformen Mobiltelefone nicht nur „besser und einfacher zu scannen“ machen, sondern auch „erraten, was Ihnen gefällt“, um Benutzer in den Informationskokon einzubeziehen.

Bei diesen KI-Tools, die automatisch die Rechtschreibung korrigieren, automatisch E-Mail-Antworten generieren und PPT generieren, haben Sie vielleicht das Gefühl, dass Sie ihre Arbeit leiten, aber diese Tools sind wirklich nicht „neutral“, wie Sie es sich vorgestellt haben.

Schreiben und schreiben Sie und Sie werden überzeugt sein

Eine wachsende Zahl von Forschungsergebnissen weist darauf hin, dass KI-Tools die Meinung der Menschen verändern, ohne dass sie es überhaupt merken.

Eine der neuesten Studien wies darauf hin, dass, wenn der Forschungsgegenstand KI zur Unterstützung beim Schreiben einer Arbeit einsetzt, die KI den Forschungsgegenstand dazu drängt, eine Arbeit zu schreiben, die einen bestimmten Standpunkt aufgrund seiner eigenen Voreingenommenheit unterstützt oder ablehnt.

Gleichzeitig kann der Prozess des Schreibens einer Arbeit auch die Ansichten der Benutzer zu diesem Thema stark beeinflussen.

Mor Naaman von der Cornell University nennt dies „implizite Überzeugung“ und sagt, dass die Menschen „vielleicht nicht einmal wissen, dass sie beeinflusst werden“.

Obwohl KI Menschen effizienter machen kann, kann sie auch die Perspektiven der Menschen auf subtile Weise verändern.

Darüber hinaus ähnelt die Art und Weise, wie KI Menschen verändert, eher der Art und Weise, wie eine Person eine andere durch Zusammenarbeit und soziale Aktivitäten verändert und überzeugt, und nicht so sehr mit der Art und Weise, wie soziale Medien uns beeinflussen.

Eine weitere Studie befasste sich mit der Smart Reply-Funktion von Gmail.

Mit Hilfe dieser Funktion werden die Leute positivere Antworten senden und die Kommunikation zwischen den Benutzern wird positiver sein.

Die zweite Studie wies darauf hin, dass diese automatische Antwort auch dazu führt, dass der Empfänger den Absender als herzlicher und kooperativer wahrnimmt.

Wenn man bedenkt, dass Unternehmen wie Microsoft und Google KI auf natürliche Weise in verschiedene Bürosoftware integrieren, sind auch die weiteren Auswirkungen von KI auf den Menschen naheliegend.

Schlimmstenfalls können diejenigen, die über Macht und Technologie verfügen, diese scheinbar harmlosen, produktivitätssteigernden Werkzeuge nutzen, um die Einstellung der Menschen zu bestimmten Dingen voranzutreiben und zu beeinflussen.

Verglichen mit den Empfehlungsalgorithmen, Filterblasen und Kaninchenlöchern, die in sozialen Medien angewendet werden, ist hier die „Geheimhaltung“ das Interessanteste.

Die Forscher, die die Situation entdeckt haben, glauben, dass die beste Verteidigung darin besteht, die Menschen auf das Problem aufmerksam zu machen.

Längerfristig sind regulatorische Anforderungen an die Transparenz von KI eine weitere Möglichkeit, den Nutzern mitzuteilen, welche Art von Voreingenommenheit eine bestimmte KI hegt.

Lydia Chilton, Professorin an der Columbia University, wies darauf hin, dass Menschen ihre Autonomie wiedererlangen, wenn sie verstehen, welche Voreingenommenheit die KI in sich birgt, und sich dafür entscheiden, diese Voreingenommenheit für ihre eigenen Zwecke zu nutzen und zu entscheiden, wann sie sie nutzen.

Es handele sich um ein „Vorurteil“ und eine „Zielvorstellung“

KI hat keine „Werte“, aber weil die Schulungsmaterialien und die Menschen, die geschult werden, Wert und Voreingenommenheit haben, wird die KI voreingenommen sein.

Forscher glauben, dass diese Art von Voreingenommenheit uns in gewissem Maße helfen kann, die Einstellungen bestimmter Gruppen gegenüber bestimmten Ereignissen zu verstehen.

Bevor wir sie jedoch nutzen, müssen wir zunächst genau untersuchen, was die Voreingenommenheit der KI ist.

Dr. Tatsunori Hashimoto und Kollegen haben einen Weg gefunden – die KI den Fragebogen ausfüllen zu lassen.

Hashimotos Team beauftragte AI mit der Durchführung einer Umfrage zum Konzept des Pew Research Center und verglich die von AI erzielten Ergebnisse mit den von Pew selbst eingeteilten Forschungsgruppen, um herauszufinden, welcher Gruppe die „Voreingenommenheit“ einer bestimmten KI eher ähnelt.

Die Studie ergab, dass die „Voreingenommenheit“ des OpenAI-Sprachmodells (nicht der neuesten Version) nicht dem Konzept der meisten amerikanischen Gruppen entspricht, sondern eher der Gruppe der College-Studenten entspricht.

In der Studie wird spekuliert, dass das Sprachmodell möglicherweise auch die Ideen der Gruppe besser widerspiegelt, vielleicht weil die Menschen in dieser Gruppe am wahrscheinlichsten für die Anpassung ähnlicher Sprachmodelle verantwortlich sind.

Lydia Chilton, Professorin an der Columbia University, glaubt, dass wir nicht nur vermeiden können, von „impliziten Überzeugungen“ betroffen zu sein, sondern diese Tools auch besser nutzen können, wenn die Menschen erkennen können, welche „Voreingenommenheit“ hinter der KI steckt.

Beispielsweise kann die Vertriebsabteilung einen KI-Assistenten erstellen, der sich auf den Verkauf konzentriert, mit dem Ziel, den Verkauf abzuschließen; die Kundendienstabteilung kann auch einen eigenen serviceorientierten KI-Assistenten erstellen, mit dem Ziel, Kunden zufrieden zu stellen.

Darüber hinaus können Menschen bestimmte KIs auch aktiv nutzen, um sich zu bestimmten Ausdrücken (oder dem idealen Ausdruck in ihrem Kopf) zu bewegen:

Ich finde es ermüdend, aufgeregt zu sein und fröhlich zu reden.

Normalerweise hilft Koffein dabei ein wenig, und jetzt kann auch ChatGPT helfen.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von Aifaner: Aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich präsentiert.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo