KI-generierte Gesichter erobern das Internet

Die Times stellte im März ein Profil einer 18-jährigen Ukrainerin namens „Luba Dovzhenko“ vor, um das Leben unter Belagerung zu veranschaulichen. Sie, so behauptete der Artikel, habe Journalismus studiert, spreche „schlechtes Englisch“ und fing an, nach der russischen Invasion eine Waffe zu tragen.

Das Problem war jedoch, dass Dovhenko im wirklichen Leben nicht existiert und die Geschichte kurz nach ihrer Veröffentlichung entfernt wurde.

Luba Dovhenko war eine gefälschte Online-Persona, die entwickelt wurde, um vom wachsenden Interesse an Kriegsgeschichten zwischen der Ukraine und Russland auf Twitter zu profitieren und eine große Fangemeinde zu gewinnen. Das Konto hat vor März nicht nur nie getwittert, sondern hatte auch einen anderen Benutzernamen, und die Updates, die es getwittert hatte, was möglicherweise die Aufmerksamkeit der Times auf sich zog, waren von anderen echten Profilen abgerissen worden. Der vernichtendste Beweis für ihren Betrug war ihr jedoch direkt ins Gesicht geschrieben.

Auf Dovhenkos Profilbild lösten sich einige ihrer Haarsträhnen vom Rest ihres Kopfes, ein paar Wimpern fehlten und vor allem waren ihre Augen auffallend zentriert. Sie alle waren verräterische Anzeichen eines künstlichen Gesichts, das von einem KI-Algorithmus ausgespuckt wurde.

Die Positionierung der Gesichtszüge ist nicht die einzige Anomalie auf dem Profilbild von @lubadovzhenko1 ; nicht die abgelösten Haare im unteren rechten Teil des Bildes und die teilweise fehlenden Wimpern (unter anderem). pic.twitter.com/UPuvAQh4LZ

– Verschwörer Norteño (@conspirator0) 31. März 2022

Dovhenkos Gesicht wurde von der Technologie hinter Deepfakes fabriziert , einer zunehmend populären Technik, die es jedem ermöglicht, das Gesicht einer anderen Person in einem Video zu überlagern, und die für alles eingesetzt wird, von Rachepornos bis hin zur Manipulation von Reden von Weltführern. Und indem solche Algorithmen mit Millionen von Bildern echter Menschen gefüttert werden, können sie umfunktioniert werden, um lebensechte Gesichter wie das von Dovhenko aus dem Nichts zu erschaffen. Es ist ein wachsendes Problem, das den Kampf gegen Fehlinformationen noch schwieriger macht.

Eine Armee von KI-generierten falschen Gesichtern

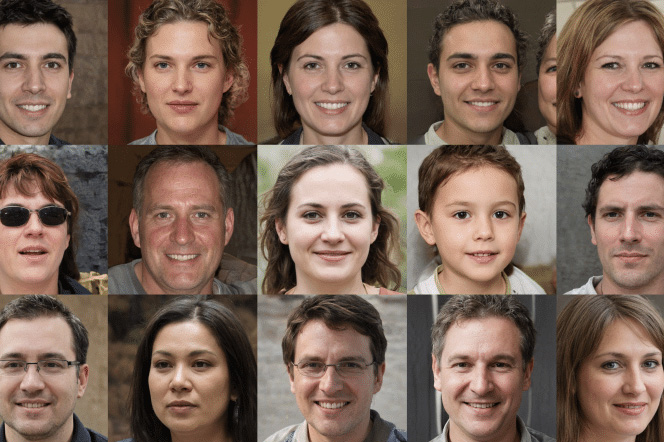

In den letzten Jahren, als soziale Netzwerke gegen gesichtslose, anonyme Trolle vorgingen, hat KI böswillige Akteure und Bots mit einer unschätzbaren Waffe bewaffnet: der Fähigkeit, erschreckend authentisch zu wirken. Anders als früher, als Trolle einfach echte Gesichter aus dem Internet rissen und jeder sie entlarven konnte, indem er sein Profilbild umkehrte, ist es für jemanden praktisch unmöglich, dasselbe für KI-generierte Fotos zu tun, weil sie frisch und einzigartig sind. Und selbst bei näherer Betrachtung können die meisten Menschen keinen Unterschied erkennen.

Dr. Sophie Nightingale, Psychologieprofessorin an der Lancaster University in Großbritannien, fand heraus, dass Menschen nur eine 50-prozentige Chance haben, ein KI-synthetisiertes Gesicht zu erkennen, und viele hielten es sogar für vertrauenswürdiger als echte. Die Möglichkeit für jedermann, auf „synthetische Inhalte ohne Spezialkenntnisse in Photoshop oder CGI zuzugreifen“, sagte sie gegenüber Digital Trends, „stellt eine erheblich größere Bedrohung für schändliche Verwendungen dar als frühere Technologien.“

Was diese Gesichter so schwer fassbar und höchst realistisch macht, sagt Yassine Mekdad, eine Cybersicherheitsforscherin an der University of Florida, deren Modell zur Erkennung von KI-generierten Bildern eine Genauigkeit von 95,2 % hat, ist, dass ihre Programmierung (bekannt als Generative Adversarial Network) verwendet wird zwei gegensätzliche neuronale Netze, die gegeneinander arbeiten, um ein Bild zu verbessern. Einer (G, Generator) hat die Aufgabe, die gefälschten Bilder zu erzeugen und den anderen in die Irre zu führen, während der zweite (D, Diskriminator) lernt, die Ergebnisse des ersten von echten Gesichtern zu unterscheiden. Dieses „Nullsummenspiel“ zwischen den beiden ermöglicht es dem Generator, „nicht unterscheidbare Bilder“ zu erzeugen.

Und KI-generierte Gesichter haben das Internet tatsächlich in rasender Geschwindigkeit erobert. Abgesehen von Konten wie dem von Dovhenko, die synthetisierte Personas verwenden, um eine Fangemeinde aufzubauen, hat diese Technologie in letzter Zeit viel alarmierendere Kampagnen vorangetrieben.

Als Google im Jahr 2020 einen KI-Ethikforscher, Timnit Gebru, wegen der Veröffentlichung eines Artikels entließ, in dem Voreingenommenheit in den Algorithmen des Unternehmens hervorgehoben wurde, tauchte ein Netzwerk von Bots mit KI-generierten Gesichtern auf, die behaupteten, früher in der KI-Forschungsabteilung von Google gearbeitet zu haben soziale Netzwerke und überfiel jeden, der sich für Gebru aussprach. Ähnliche Aktivitäten von Ländern wie China wurden festgestellt, die Narrative der Regierung fördern.

Bei einer oberflächlichen Twitter-Rezension brauchte ich nicht lange, um mehrere Impfgegner , Pro-Russen und mehr zu finden – alle versteckten sich hinter einem computergenerierten Gesicht, um ihre Pläne voranzutreiben und jeden anzugreifen, der ihnen im Weg stand. Obwohl Twitter und Facebook regelmäßig solche Botnets ausschalten, haben sie keinen Rahmen, um gegen einzelne Trolle mit einem synthetischen Gesicht vorzugehen, obwohl die irreführende und täuschende Identitätspolitik des ersteren „den Identitätswechsel von Einzelpersonen, Gruppen oder Organisationen verbietet, um irrezuführen, zu verwirren oder zu verwirren andere täuschen oder eine gefälschte Identität in einer Weise verwenden, die die Erfahrung anderer stört.“ Aus diesem Grund wurde mir, als ich die Profile, denen ich begegnete, meldete, mitgeteilt, dass sie keine Richtlinien verletzen.

Sensity, ein Unternehmen für KI-basierte Betrugslösungen, schätzt, dass etwa 0,2 % bis 0,7 % der Menschen in beliebten sozialen Netzwerken computergenerierte Fotos verwenden. Das scheint an sich nicht viel zu sein, aber für Facebook (2,9 Milliarden Nutzer), Instagram (1,4 Milliarden Nutzer) und Twitter (300 Millionen Nutzer) bedeutet es Millionen von Bots und Akteuren, die potenziell Teil von Desinformationskampagnen sein könnten .

Der Übereinstimmungsprozentsatz einer KI-generierten Gesichtserkennungs- Chrome-Erweiterung von V7 Labs bestätigte die Zahlen von Sensity. Sein CEO, Alberto Rizzoli, behauptet, dass durchschnittlich 1 % der hochgeladenen Fotos als gefälscht gekennzeichnet sind.

Der Marktplatz für gefälschte Gesichter

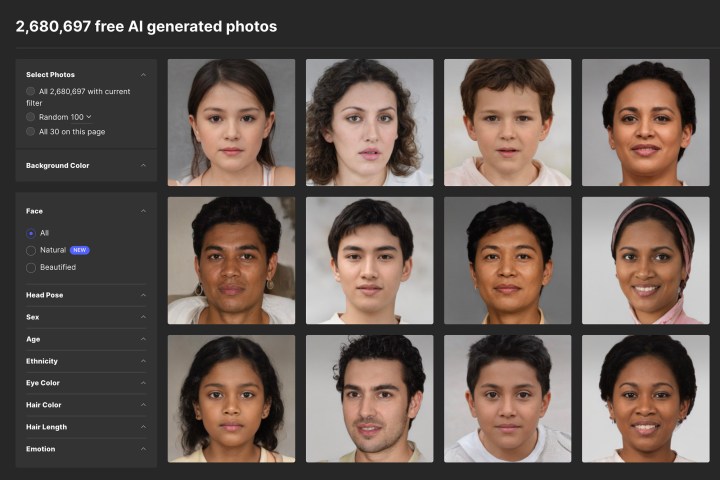

Einer der Gründe, warum sich KI-generierte Fotos so schnell verbreitet haben, ist, wie einfach es ist, sie zu bekommen. Auf Plattformen wie Generated Photos kann jeder hunderttausende gefälschte Gesichter in hoher Auflösung für ein paar Dollar erwerben, und für Leute, die ein paar für einmalige Zwecke wie persönliche Schmutzkampagnen benötigen, können sie sie von Websites wie thispersondoesnotexist herunterladen .com , das jedes Mal, wenn Sie es neu laden, automatisch ein neues synthetisches Gesicht generiert.

Diese Websites haben Menschen wie Benjamin Strick, dem Untersuchungsleiter des britischen Centre for Information Resilience, das Leben besonders schwer gemacht, dessen Team täglich Stunden damit verbringt, betrügerische Online-Inhalte zu verfolgen und zu analysieren.

„Wenn Sie [autogenerative Technologien] in ein Paket mit gefälschten Profilen packen und in einem gefälschten Startup arbeiten (über thisstartupdoesnotexist.com)“, sagte Strick gegenüber Digital Trends, „gibt es ein Rezept für Social Engineering und eine Basis für sehr irreführend Praktiken, die innerhalb weniger Minuten eingerichtet werden können.“

Ivan Braun, der Gründer von Generated Photos, argumentiert jedoch, dass nicht alles schlecht ist. Er behauptet, dass GAN-Fotos viele positive Anwendungsfälle haben – wie die Anonymisierung von Gesichtern in der Straßenansicht von Google Maps und die Simulation virtueller Welten in Spielen – und genau das fördert die Plattform. Wenn jemand im Geschäft ist, Menschen zu täuschen, hofft Braun, dass die Betrugsbekämpfung seiner Plattform in der Lage sein wird, die schädlichen Aktivitäten zu erkennen, und dass soziale Netzwerke schließlich in der Lage sein werden, generierte Fotos von authentischen herauszufiltern.

Aber auch die Regulierung von KI-basierter generativer Technologie ist schwierig, da sie auch unzählige wertvolle Dienste unterstützt, einschließlich des neuesten Filters für Snapchat und der intelligenten Beleuchtungsfunktionen von Zoom. Giorgio Patrini, CEO von Sensity, stimmt zu, dass das Verbot von Diensten wie Generated Photos unpraktisch ist, um den Aufstieg von KI-generierten Gesichtern einzudämmen. Stattdessen besteht ein dringender Bedarf an proaktiveren Ansätzen von Plattformen.

Bis dahin wird die Einführung synthetischer Medien das Vertrauen in öffentliche Institutionen wie Regierungen und Journalismus weiter untergraben, sagt Tyler Williams, Untersuchungsleiter bei Graphika, einem Analyseunternehmen für soziale Netzwerke, das einige der umfangreichsten Kampagnen mit gefälschten Personas aufgedeckt hat . Und ein entscheidendes Element im Kampf gegen den Missbrauch solcher Technologien, fügt Williams hinzu, ist „ein Lehrplan für Medienkompetenz, der schon in jungen Jahren beginnt, und ein Training zur Überprüfung der Quellen“.

Wie erkennt man ein KI-generiertes Gesicht?

Glücklicherweise gibt es ein paar todsichere Methoden, um festzustellen, ob ein Gesicht künstlich erstellt wurde. Die Sache, an die man sich hier erinnern sollte, ist, dass diese Gesichter einfach durch das Mischen von Tonnen von Fotos heraufbeschworen werden. Obwohl das tatsächliche Gesicht echt aussehen wird, finden Sie viele Hinweise an den Rändern: Die Ohrformen oder die Ohrringe passen möglicherweise nicht zusammen, Haarsträhnen fliegen möglicherweise überall herum und der Brillenrand kann seltsam sein – die Liste geht weiter. Das häufigste Werbegeschenk ist, dass, wenn Sie durch ein paar falsche Gesichter blättern, sich alle ihre Augen in genau derselben Position befinden: in der Mitte des Bildschirms. Und Sie können mit dem Hack „ Gefaltetes Zugticket “ testen, wie hier von Strick demonstriert.

Nightingale glaubt, dass die größte Bedrohung, die von KI-generierten Fotos ausgeht, die „Lügnerdividende“ anheizt – ihre bloße Existenz ermöglicht es, jedes Medium als Fälschung abzutun. „Wenn wir nicht über grundlegende Tatsachen der Welt um uns herum nachdenken können“, argumentiert sie, „dann setzt dies unsere Gesellschaften und Demokratien einem erheblichen Risiko aus.“