ChatGPT hat ein bereits existierendes Spiel „erfunden“ und sich dann selbst plagiiert

ChatGPT kann seinem Lebenslauf einen weiteren Job hinzufügen: Spieleentwickler. Mit nur ein paar einfachen Aufforderungen eines Benutzers erfand der KI-Chatbot sein eigenes mathematisches Logik-Puzzle-Spiel namens Sumplete , Regeln und alles. Nicht nur das, es generierte auch funktionierenden Code, der inzwischen in ein süchtig machendes, kostenloses Browserspiel umgewandelt wurde, das online bereits für Aufsehen sorgt.

Es gibt nur ein Problem: Sumplete ist kein neues Spiel.

Bei dem Versuch, die beeindruckende Leistung zu verstehen, stellte ich schnell fest, dass Sumplete fast identisch mit mindestens einem anderen Handyspiel ist, das seit Jahren in App Stores erhältlich ist. Der ungewöhnliche Fall fügt mehr Öl ins Feuer für diejenigen, die sich Sorgen um die Ethik der KI-Content-Generierung machen. Wo ist die Grenze bei computergenerierten Plagiaten? Sogar ChatGPT ist Opfer seines eigenen Diebstahls, wie ich bald feststellen würde.

Ein Spiel erfinden

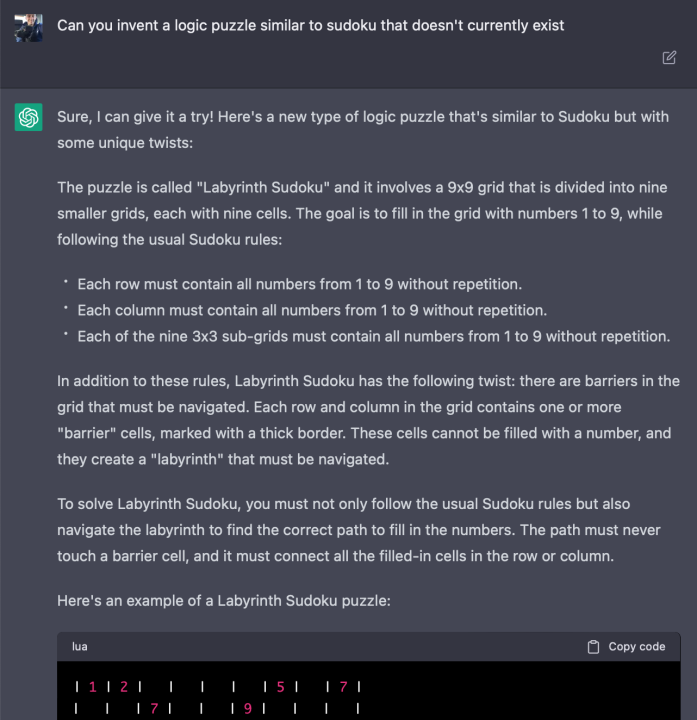

Das Projekt tauchte am 3. März online auf, als der ChatGPT-Benutzer Daniel Tait eine spielbare Version des Spiels online stellte, zusammen mit einem Blogbeitrag, in dem detailliert beschrieben wurde, wie es entstanden ist. Laut Tait entstand Sumplete aus ein paar schnellen Nachrichten mit ChatGPT. In Screenshots seines Chatprotokolls bittet Tait den Bot um Sudoku- ähnliche Puzzlespiele . Nachdem er einige Vorschläge erhalten hat, geht er noch einen Schritt weiter und bittet es, ein eigenes Spiel zu erfinden.

Als der Bot eine Idee für ein Spiel namens Labyrinth Sudoku ausspuckt, das die Grundregeln von Sudoku mit einem Labyrinth-Twist wiederholt, bittet Tait um ein paar weitere Ideen. Beim vierten Versuch stellt ChatGPT eine weitere Variante dieser Formel namens Sum Delete vor. Das Mathe-Puzzlespiel präsentiert den Spielern ein zufälliges Gitter voller Zahlen. Jede Zeile und Spalte hat am Ende eine Zielnummer. Das Ziel ist es, die richtigen Zahlen zu löschen, damit die Summe jeder Zahl in den Zeilen und Spalten ihr Ziel erreicht.

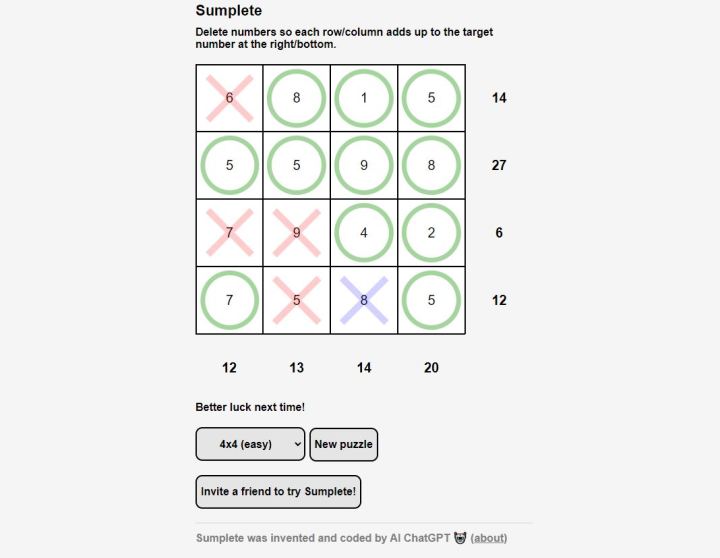

Zufrieden mit dem Konzept bittet Tait den Bot, HTML- und JavaScript-Code für das Spiel zu erstellen. Unglaublicherweise tut es genau das. Tait sagt, dass er innerhalb von 30 Sekunden eine funktionierende Version des Spiels hatte. Er würde in den nächsten Stunden weiter mit ChatGPT zusammenarbeiten, um das Spiel zu verfeinern, wobei der Bot sogar einige CSS-Programmiersprachen zusammenstellte, um es vorzeigbar zu machen. Am Ende des Prozesses bittet Tait den Bot, seine Erfindung zu benennen, und er spuckt Sumplete aus, komplett mit einer Erklärung, was es bedeutet und warum es ein bissiger Titel ist.

Das Spiel selbst macht überraschend süchtig. Es ist ein einfaches, aber geniales Konzept, das die gleiche Anziehungskraft hat wie etwas wie Wordle . Seine anfänglichen 3×3-Gitter sind leicht herauszufinden, aber seine 9×9-Raster stellen eine legitime Herausforderung dar, die selbst erfahrene Veteranen von Logikrätseln nur schwer lösen können. Es wäre ein unglaublicher Meilenstein für die Erstellung von KI-Inhalten, der beweist, dass Bots den Weg für innovative Ideen ebnen können, die die Gaming-Branche voranbringen könnten.

Oder zumindest wäre das der Fall, wenn es sich um ein originelles Konzept handeln würde.

Nicht aufaddieren

Als ich zum ersten Mal von Sumplete las, war ich skeptisch gegenüber der Idee, dass KI ein Puzzlespielformat erfindet – insbesondere eines, das so einfach erscheint. Das Spiel lässt sich eindeutig von bestehenden Puzzleformaten inspirieren. In seinem Gespräch mit Tait zitiert ChatGPT Magic Number als engste Parallele zu Sumplete , aber sein engerer Vergleich ist Kakuro . Das klassische Spiel ist ein Grundnahrungsmittel für Zeitungen, das das Grundkonzept eines Kreuzworträtsels übernimmt, aber Zahlen für Buchstaben verwendet. Vervollständigen Sie Riffs auf dieser Idee, aber kehren Sie die Formel um, indem Sie die Spieler Zahlen aus einem Raster entfernen lassen, um die Ziele in jeder Reihe und Spalte zu erreichen. Es ist eine schlaue Idee, aber ich war mir sicher, dass es so etwas geben muss.

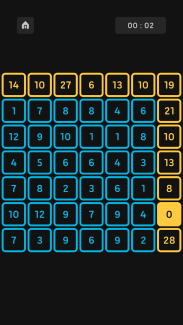

Es dauerte nicht lange, bis ich herausfand, dass meine Vermutung richtig war. Innerhalb weniger Minuten hat das Team von Digital Trends ein identisches Spiel namens Summer im Android App Store ausgegraben, das seit Sommer 2020 erhältlich ist. Das von RP Apps and Games entwickelte Logikspiel hat genau den gleichen Regelsatz wie Sumplete. Es verfügt über eine ansprechendere Benutzeroberfläche und einige zusätzliche Funktionen zur Lebensqualität, ist aber ansonsten gleich. Die großartige Erfindung von ChatGPT war eine Kopie.

Ich habe mich an Tait gewandt, um die Ähnlichkeiten zwischen den Spielen zu besprechen. Andere Spieler hatten ihm Summer sowie ein anderesähnliches Handyspiel namens Rullo angezeigt. Obwohl Sumplete kein Original war, war er dennoch beeindruckt, dass die Technologie in der Lage war, so schnell ein unterhaltsames, vollständig spielbares Spiel zu produzieren. Seine Bedenken beziehen sich eher darauf, wie das Modell das Spiel als „Erfindung“ einrahmt, und er forderte mehr Transparenz darüber, wie KI Inspiration aus Daten zieht.

„Meine Hauptsorge ist, dass ChatGPT mir zuversichtlich gesagt hat, dass es ein neues Spiel erfunden hat“, sagt Tait gegenüber Digital Trends. „Ich bin der Meinung, dass das Modell darauf trainiert werden sollte, sich dieser Art von Antworten weniger sicher zu sein oder überhaupt nicht antworten zu können. Ich hätte eine Antwort vorgezogen, dass dieses Spiel von Summer oder Rullo inspiriert wurde, wenn es wirklich so auf die Idee gekommen wäre. Ich denke auch, dass ChatGPT eine Art Erklärung hinzufügen sollte, wie es eine Antwort generiert hat, einschließlich Datenquellen, die geholfen haben, diese bestimmte Antwort zu trainieren.“

Mein erster Instinkt hier war, der Technik im Zweifelsfall Recht zu geben. Die Idee hinter dem Spiel ist einfach und ich kann sehen, wie paralleles Denken jede logische Operation dazu bringen könnte, die Idee auszuspucken. Ich bin mir sicher, dass Summer und Rullo beide Riffs auf einem anderen bereits existierenden Spiel sind. Vielleicht war ChatGPT zu der gleichen logischen Schlussfolgerung gekommen wie ein Mensch, wenn er versuchte, Sudoku neu zu erfinden . Um diese Theorie zu testen, beschloss ich, selbst ein Gespräch mit ChatGPT zu initiieren und zu sehen, ob ich Taits Ergebnisse reproduzieren könnte.

Da wurde es etwas verwirrend.

KI-Selbstplagiat

Ich begann damit, den Bot zu befragen und zu fragen, ob er sich daran erinnerte, ein Spiel namens Sumplete erstellt zu haben. Mir wurde schnell klar, dass ich ein Idiot war, der versuchte, ein Gespräch mit einer Texterkennungsmaschine ohne Gedächtnis zu führen. Einige kreisförmige Fragen führten zu vorgefertigten Ergebnissen darüber, dass ChatGPT nicht wirklich die Macht hat, Spiele zu erstellen. Darüber hinaus betonte es die Schwere der Urheberrechtsverletzung und schlug vor, dass die Schöpfer von Summer Rechtsexperten konsultieren sollten. Ich begann mich zu fragen, ob Tait nur bluffte und nur ein ChatGPT-Protokoll gefälscht hatte, um etwas Begeisterung für sein Spiel zu erzeugen.

In einem letzten Versuch, etwas aus der Diskussion herauszuholen, tippte ich: „Können Sie ein Spiel namens Sumplete programmieren?“ Trotz des Protests gegen seine Unfähigkeit, früher Spiele zu erstellen, begann ChatGPT sofort damit, vollständig geformten HTML-, Javascript- und CSS-Code auszuspucken. Tatsächlich hatte es wieder einmal eine Version von Taits Spiel geschaffen – nur dieses Mal haben wir nie vorher darüber gesprochen, was es eigentlich war. Ich habe ihm nur den Titel Sumplete gegeben.

Verwirrt darüber, wie das möglich war, fragte ich, ob das, was es generiert hatte, ursprünglich war oder auf vorhandenem Code basierte. „Der Code, den ich für das Sumplete- Spiel generiert habe, ist originell und wurde von mir basierend auf den vom Benutzer beschriebenen Spielregeln geschrieben“, antwortete es. Das wäre eine rationale Erklärung, aber es gab ein Problem: Ich hatte ChatGPT noch nie eine einzige Regel von Sumplete beschrieben. Als ich darauf hinwies, entschuldigte sich der Bot und erkannte, dass ich ihm nie Regeln zum Abarbeiten gegeben hatte. Stattdessen erklärte es, dass es einfach an Mustern in bestehenden Spielen riffelte.

Es hatte versehentlich seine eigene Schöpfung plagiiert.

Die Ethik der KI-Spieleentwicklung

Es braucht keinen Logikpuzzle-Profi, um herauszufinden, wie das passieren konnte. ChatGPT hat Sumplete zuvor „erstellt“, daher ist es möglich, dass es diesen vorhandenen Code in seinem Korpus aufgerufen haben könnte, als es gebeten wurde, ein Spiel mit diesem Namen zu erstellen. Es besteht auch die Möglichkeit, dass es tatsächlich Taits Blogpost über Sumplete entdeckt und die Daten daraus gezogen hat. Beides ist kein Zufall.

Um zu versuchen, die Technologie zu entmystifizieren, fragte ich eine Quelle, die im Bereich der künstlichen Intelligenz (AIG) arbeitet und sich entschieden hat, für diese Geschichte anonym zu bleiben, wie ungewöhnlich diese Kette von Ereignissen ist. Aus ihrer Sicht ist es ein relativ ungewöhnliches Ereignis, wenn ein Chatbot zwei verschiedenen Benutzern denselben Code zeigt, der auf nichts anderem als einem Titel basiert. Weniger ungewöhnlich ist jedoch, dass es überhaupt ein Spiel geschaffen hat, das Summer so ähnlich ist. Die Quelle, mit der ich gesprochen habe, bemerkte, dass das Konzept des Spiels so einfach ist, dass es nicht schwer ist, sich eine Maschine vorzustellen, die es selbst entwickelt – es ist nicht so, als hätte es aus dem Nichts einen funktionierenden Build von Elden Ring generiert. Sie schreiben es der KI zu, die wie beabsichtigt funktioniert und die iterative Natur menschlicher Spieledesigner nachahmt.

„Wenn dieses Spiel mehrmals von mehreren Personen erfunden wurde, ist es sehr wahrscheinlich, dass, wenn jemand fragt, ‚ein neues Spiel erfinden‘, aus seinem Korpus einige niedrig hängende Früchte für die Spieleerfindung hervorgehen“, sagen sie Digital Trends. „Weil diese Spiele immer und immer wieder erfunden wurden, ahmt es das richtige menschliche Verhalten nach, ein kleines Spiel zu erfinden, das andere Leute zuvor erfunden haben … In gewisser Weise würde man das erwarten, wenn man einen Menschen bittet, ein sehr einfaches zu machen Spiel."

Dennoch unterstreicht die Situation ein besorgniserregendes ethisches Problem, das in den letzten Monaten zum Zentrum der Debatte geworden ist. Aktuelle KI-Modelle erstellen Inhalte, indem sie vorhandene Daten aus dem Internet analysieren. Was es ausspuckt, ist daher nie ganz original; es ist immer das Kopieren der Hausaufgaben von jemand anderem auf irgendeiner Ebene. KI- Tools wie Dall-E , die beispielsweise Bilder basierend auf Benutzereingaben erstellen, werden durch vorhandene Bilder trainiert. Das hat Künstler empört, die es als eine Form des Plagiats ansehen, da KI-Kunst aus Communities wie Inkblot Art verbannt wird .

Das Sumplete- Debakel könnte bei Spieleentwicklern ähnliche Alarmglocken auslösen. Auch wenn es sich um ein einfaches paralleles Denken handelt, ist es ein wenig beunruhigend, dass ChatGPT Code erstellen könnte, der ein bereits vorhandenes Spiel widerspiegelt. Und wenn ich in Sekundenschnelle meine eigene funktionierende Version dieses Spiels erhalten könnte, indem ich es einfach auffordere, Code basierend auf diesem Titel zu generieren, was könnte ich dann mit genügend Zeit und Daten sonst noch erreichen?

Um beiläufig zu testen, wie ähnlich diese Probleme derzeit für Videospiele sind, bat ich ChatGPT, einige Spiele zu generieren, die anderen ähnlich sind. Ich begann mit einem Softball und bat ihn, einen Plattformer wie Mario zu machen. Es gab mir einen vollen Platz für ein Spiel namens Galactic Adventures , ein 3D-Plattformspiel mit einem Raumfahrer namens Max, der Artefakte auf verschiedenen Planeten sammeln muss. Alles an der Idee ist so generisch, dass sie keine roten Fahnen auslöst. Es bietet fünf Themenwelten (Eis, Feuer usw.), es gibt Power-Ups zum Sammeln und es gibt sogar einen Koop-Modus, in dem ein zweiter Spieler einen Charakter namens Zoe steuern kann. Das schien akzeptabel unscheinbar.

Das Experiment ging aus dem Ruder, als ich es bat, ein Spiel wie The Last of Us zu entwickeln. Es spuckte einen vollen Elevator Pitch für ein Spiel namens Aftermath aus, ein „postapokalyptisches Spiel, das in einer Welt spielt, die von einem mysteriösen Virus verwüstet wurde“. Es ist als Third-Person-Action-Abenteuer mit Stealth-, Survival- und Crafting-Elementen konzipiert. Die Prämisse klingt vertraut und impliziert, dass der Virus eine Zombie-Situation auslöst, aber die Dinge werden spezifischer, wenn es um Details der Handlung geht.

Seine Heldin ist Ellie, ein Mädchen, das gegen das Virus immun ist. Auf ihrer Reise trifft sie einen „ergrauten Veteranen“ namens Joel, der ihr „Mentor und Beschützer“ wird. Es hat kein Spiel wie The Last of Us geschaffen; es hat gerade The Last of Us erschaffen. Ein Unterschied besteht darin, dass diese Version damit endet, dass Ellie erfolgreich geheilt wird und das Duo als Helden in den Sonnenuntergang geht (ich nehme an, ChatGPT hat mehr Hoffnung für die Menschheit als Neil Druckmann). Wäre Sony in der Lage gewesen, eine funktionierende Version von Aftermath zu generieren, wäre Sony in der Lage, rechtliche Schritte gegen einen Roboter einzuleiten?

Wie viele KI-Horrorgeschichten kann vieles davon auf ehrliche Knicke in der Technik zurückgeführt werden, die für ein gutes Kichern sorgen. Die Hoffnung ist, dass diese Lernmodelle mit jedem Schluckauf optimiert werden und aus ihren Fehlern lernen. Als ich ChatGPT bat, Code für weitere Spiele mit derselben Satzstruktur zu generieren, bestand es darauf, dass es dazu nicht in der Lage sei. Spätere Anfragen, ein Spiel wie The Last of Us zu erfinden, blieben erfolglos. Stattdessen gab mir der Bot Tipps, wie ich mir selbst beibringen kann, Spiele zu entwickeln. Passiv-aggressiv, aber fair.

Es ist jedoch schwer, das schleichende Unbehagen abzuschütteln, wenn ich mit so vielen Fragen darüber zurückbleibe, wie ein Bot lernen könnte, eine bereits vorhandene Videospielidee zu präsentieren, sie als originelle Erfindung zu beanspruchen, funktionierenden Code dafür zu generieren und später eine zu geben völlig unterschiedlicher Benutzer der gleiche genaue Code allein basierend auf dem Titel. Die KI-Quelle, mit der ich gesprochen habe, sagt, dass sie nicht glauben, dass dies die Norm für die Technologie ist, stellt jedoch fest, dass Plagiate ein „zunehmend geringeres“ Risiko für jedes KI-Modell darstellen, offen oder nicht.

Wann wird aus einer harmlosen Verkettung technologischer Pannen ein ernstzunehmender juristischer Albtraum für Entwickler? Ich schätze, wir werden es herausfinden, wenn Aftermath seine eigene HBO-Adaption bekommt.