Die teuersten Talente in den USA sind derzeit chinesische KI-Talente: Die Tsinghua-Universität, die Peking-Universität und die Chinesische Akademie der Wissenschaften „dominieren“ den KI-Kreis im Silicon Valley

In den letzten zwei Wochen war nicht das Produkt, sondern die Menschen das Wichtigste in der KI-Branche. Oftmals, wenn ich aufwache, wird meine Social-Media-Timeline mit der gleichen alten Nachricht aktualisiert: Ein weiterer KI-Experte wurde abgeworben.

Top-KI-Talente werden zu den seltensten und markenwirksamsten Vermögenswerten im KI-Bereich.

Im Zentrum dieser Talent-Flow-Runde fanden wir ein besonders auffälliges Detail: Unter den Kernmitgliedern, die die Forschung und Entwicklung großer Modelle wie ChatGPT, Gemini und Claude leiteten, war der Anteil chinesischer Wissenschaftler überraschend hoch.

Dieser Wandel kam nicht plötzlich. Im Zuge der KI-Welle der letzten Jahre ist der Anteil chinesischer Top-KI-Talente in den USA kontinuierlich gestiegen. Laut dem von MacroPolo veröffentlichten Global Artificial Intelligence Talent Tracking Survey Report 2.0 stieg der Anteil der Top-KI-Forscher aus China zwischen 2019 und 2022 von 29 % auf 47 %.

Im „ChatGPT Team Background Research Report“ von Zhipu Research wurde festgestellt, dass von den 87 ChatGPT-Kernteammitgliedern neun Chinesen sind, was mehr als 10 % entspricht. Daher haben wir auch die Porträts chinesischer KI-Forscher, die in letzter Zeit in führenden Unternehmen des Silicon Valley für Aufsehen gesorgt haben, erneut untersucht und versucht, einige ihrer Merkmale zusammenzufassen:

1️⃣ Absolventen von Spitzenuniversitäten mit hervorragenden akademischen Fähigkeiten. Die meisten von ihnen haben Bachelor-Studiengänge an Spitzenuniversitäten wie der Tsinghua-Universität, der Peking-Universität, der University of Science and Technology of China und der Zhejiang-Universität absolviert und verfügen über einen Hintergrund in Informatik oder Mathematik. Für ihr Master-Studium besuchen sie in der Regel das MIT, Stanford, Berkeley, Princeton, die UIUC und andere renommierte Universitäten. Fast alle haben häufig zitierte Beiträge auf Top-Konferenzen (NeurIPS, ICLR, SIGGRAPH usw.).

2️⃣ Jung und produktiv. Die Ausbruchsphase konzentriert sich auf die Zeit nach 2020, und das Alter liegt meist bei 30–35 Jahren. Die Master- und Promotionsphase fällt mit dem weltweiten Ausbruch des Deep Learning zusammen und erfordert eine solide akademische Grundlage sowie Vertrautheit mit technischen Systemen und Teamarbeit. Die erste Station der Karriere vieler Menschen ist der Kontakt mit KI-Produkten oder -Plattformen großer Unternehmen oder die Betreuung großer Personengruppen, mit einem höheren Ausgangspunkt und einem schnelleren Tempo.

3️⃣ Starker multimodaler Hintergrund nach der Bewältigung des Modelltrainings. Ihre Forschungsrichtung konzentriert sich im Allgemeinen auf ein einheitliches Argumentationssystem über alle Modalitäten hinweg (Text, Sprache, Bild, Video, Aktion), einschließlich spezifischer Details wie RLHF, Destillation, Ausrichtung, Modellierung menschlicher Präferenzen und Bewertung der Sprachintonation.

4️⃣ Auch wenn es sich häufig bewegt, wird es grundsätzlich nicht aus dem Ökosystem herausfallen

Google, Meta, Microsoft, Nvidia, Anthropic, OpenAI … Ihre Mobilität erstreckt sich auf KI-Startups und -Giganten, aber ihre Forschungsthemen und ihre technologische Ansammlung bleiben tendenziell gleich und sie ändern grundsätzlich nicht ihre Richtung.

OpenAI → Meta

Shuchao Bi

Shuchao Bi schloss sein Studium an der Fakultät für Mathematik der Zhejiang-Universität ab und ging anschließend für weitere Studien an die University of California in Berkeley, wo er einen Master-Abschluss in Statistik erlangte und in Mathematik promovierte.

Von 2013 bis 2019 war er als technischer Direktor bei Google tätig, wo er unter anderem durch die Entwicklung eines mehrstufigen Deep-Learning-Empfehlungssystems dazu beitrug, die Werbeeinnahmen von Google deutlich zu steigern (in Milliardenhöhe).

Von 2019 bis 2024 war er Leiter von Shorts Exploration. In dieser Zeit war er Mitentwickler und Leiter des Shorts-Video-Empfehlungs- und -Entdeckungssystems und baute ein großes Team für maschinelles Lernen auf und erweiterte es, das Empfehlungssysteme, Bewertungsmodelle, interaktive Entdeckung, Vertrauen und Sicherheit sowie andere Bereiche abdeckte.

Nach seinem Eintritt bei OpenAI im Jahr 2024 leitete er hauptsächlich die multimodale Post-Training-Organisation und ist Mitentwickler des GPT-4o-Sprachmodells und des o4-mini

In dieser Zeit förderte er vor allem RLHF, Bild-/Sprach-/Video-/Text-Argumentation, multimodale Agenten, multimodale Sprach-zu-Sprache-Reaktion (VS2S), Vision-Language-Action-Basismodelle (VLA), modalübergreifende Bewertungssysteme usw. und befasste sich auch mit multimodaler Kettenargumentation, Bewertung der Sprachintonation/Natürlichkeit, multimodaler Destillation und selbstüberwachter Optimierung. Sein Hauptziel ist die Entwicklung eines allgemeineren multimodalen KI-Agenten durch Nachtraining.

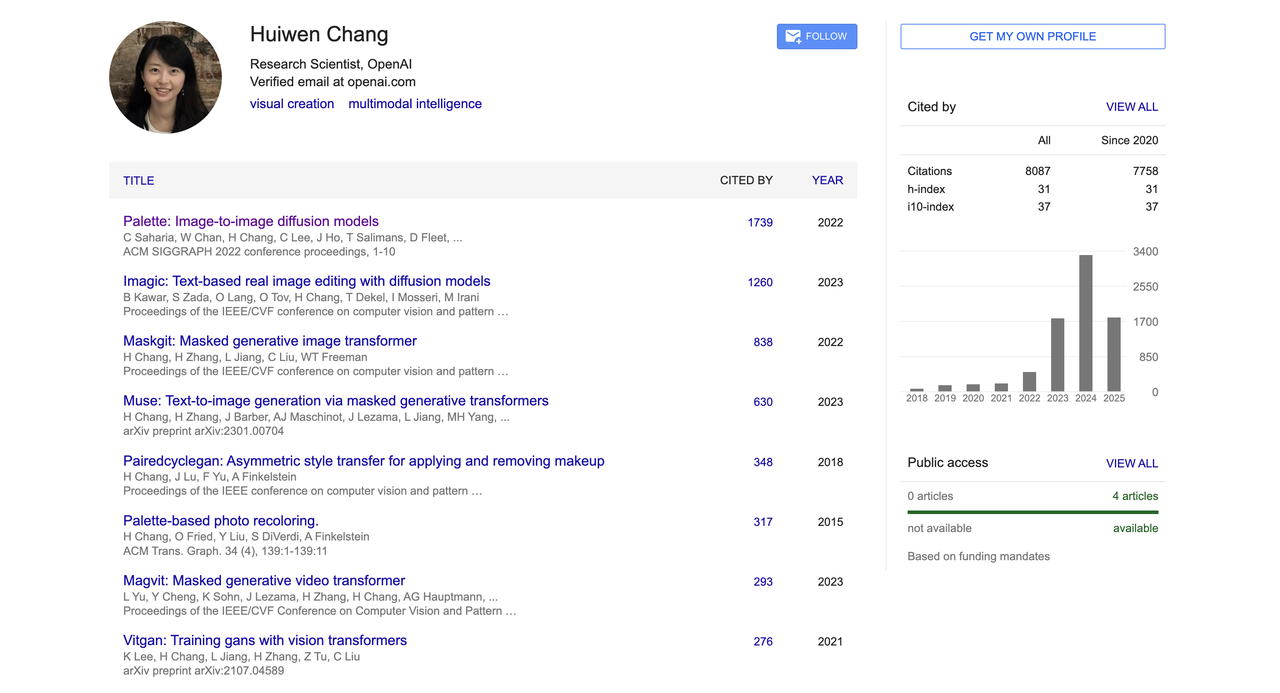

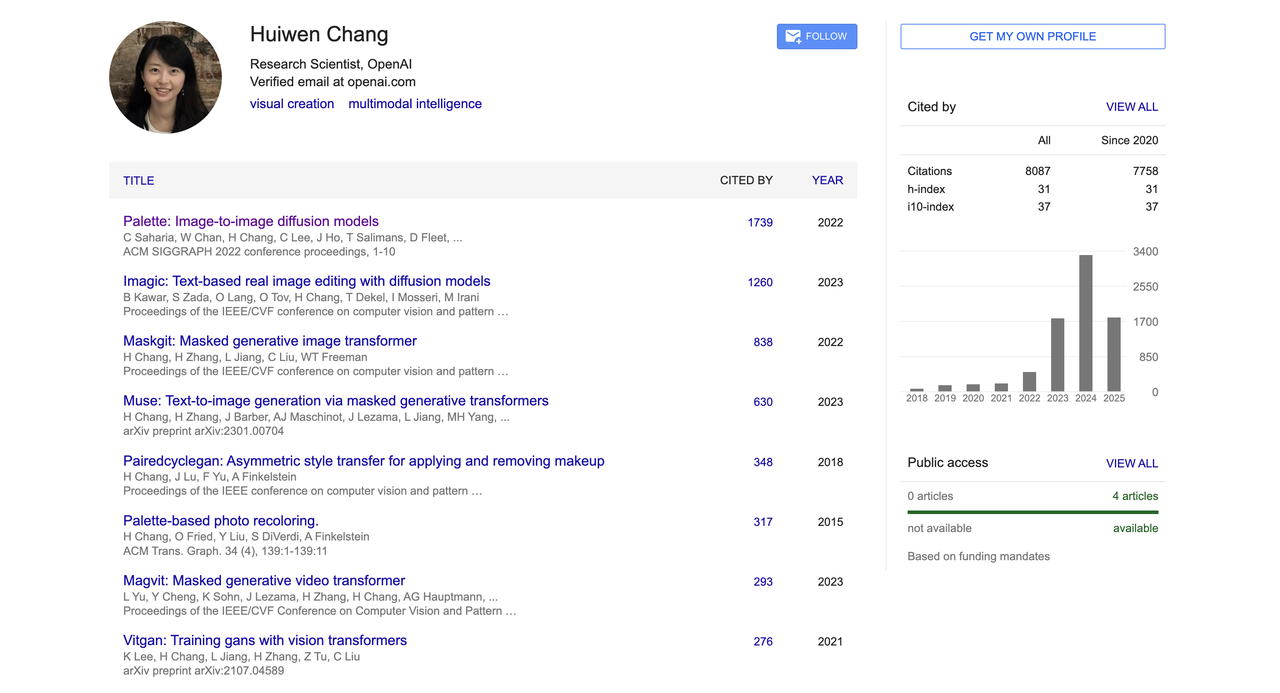

Huiwen Chang

Huiwen Chang schloss 2013 sein Informatikstudium (Yao-Klasse) an der Tsinghua-Universität ab und promovierte anschließend an der Princeton University in den USA in Informatik. Seine Forschungsschwerpunkte sind Bildstilübertragung, generative Modelle und Bildverarbeitung. Er erhielt ein Stipendium von Microsoft Research.

Bevor sie zu OpenAI kam, arbeitete sie mehr als sechs Jahre als leitende Wissenschaftlerin bei Google und beschäftigte sich lange Zeit mit generativer Modellierung und Computervision. Bei Google Research entwickelte sie die Text-zu-Bild-Architekturen MaskGIT und Muse.

Die frühe Text-zu-Bild-Generierung basierte hauptsächlich auf Diffusionsmodellen (wie DALL·E 2 und Imagen). Diese Modelle weisen zwar eine hohe Generierungsqualität auf, sind aber langsam inferentiell und kostenintensiv. MaskGIT und Muse hingegen nutzen den Ansatz „Diskretisierung + parallele Generierung“, der die Effizienz deutlich verbessert.

MaskGIT ist ein neuer Ausgangspunkt für die nicht-autoregressive Bilderzeugung, und Muse ist ein repräsentatives Werk, das diese Methode auf die Textbilderzeugung ausweitet. Sie sind nicht so bekannt wie Stable Diffusion, stellen aber sehr wichtige technische Eckpfeiler in akademischen und technischen Systemen dar.

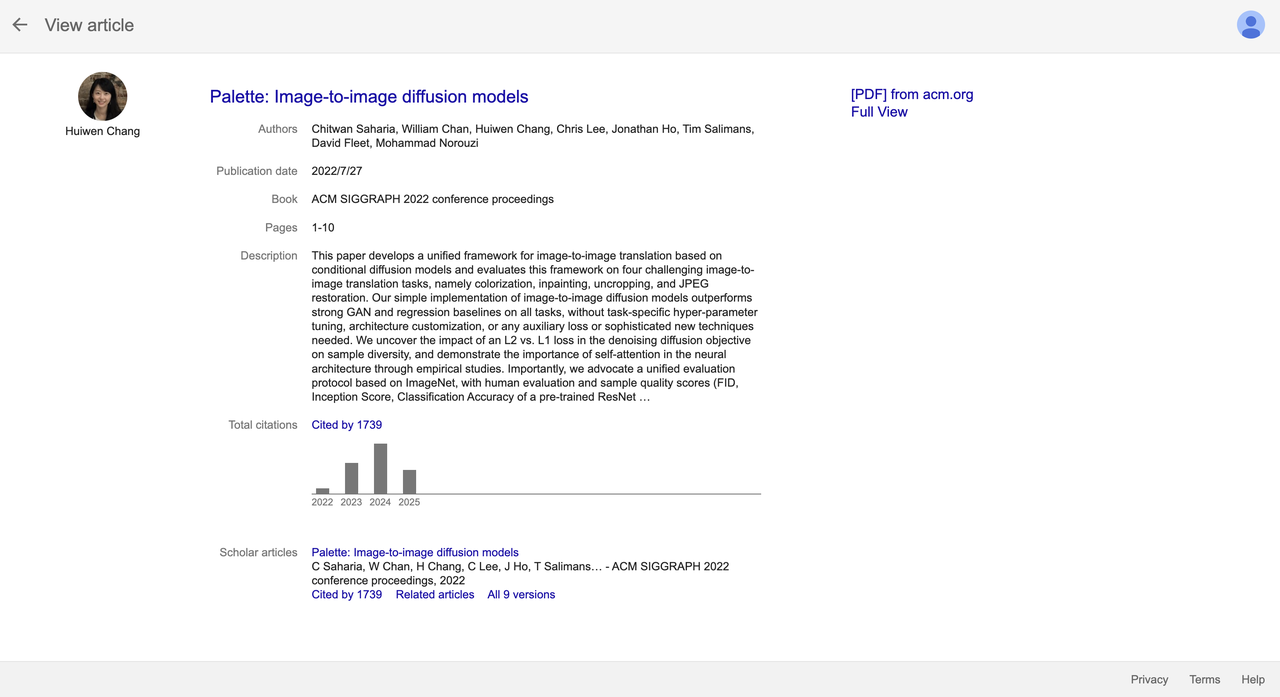

Darüber hinaus ist sie auch eine der Co-Autorinnen des Top-Diffusionsmodell-Papiers „Palette: Image-to-image diffusion models“.

Dieses Paper wurde auf der SIGGRAPH 2022 veröffentlicht. Es schlug ein einheitliches Framework für die Bild-zu-Bild-Übersetzung vor und übertraf GAN- und Regressionsgrundlagen in mehreren Aufgaben wie Bildwiederherstellung, -kolorierung und -vervollständigung. Es wurde bisher über 1.700 Mal zitiert und gilt als eine der bedeutendsten Errungenschaften auf diesem Gebiet.

Seit Juni 2023 ist sie Mitglied des multimodalen Teams von OpenAI und hat die Bildgenerierungsfunktion von GPT-4o mitentwickelt. Sie treibt weiterhin Forschung und Implementierung in zukunftsweisenden Bereichen wie der Bildgenerierung und multimodalen Modellierung voran.

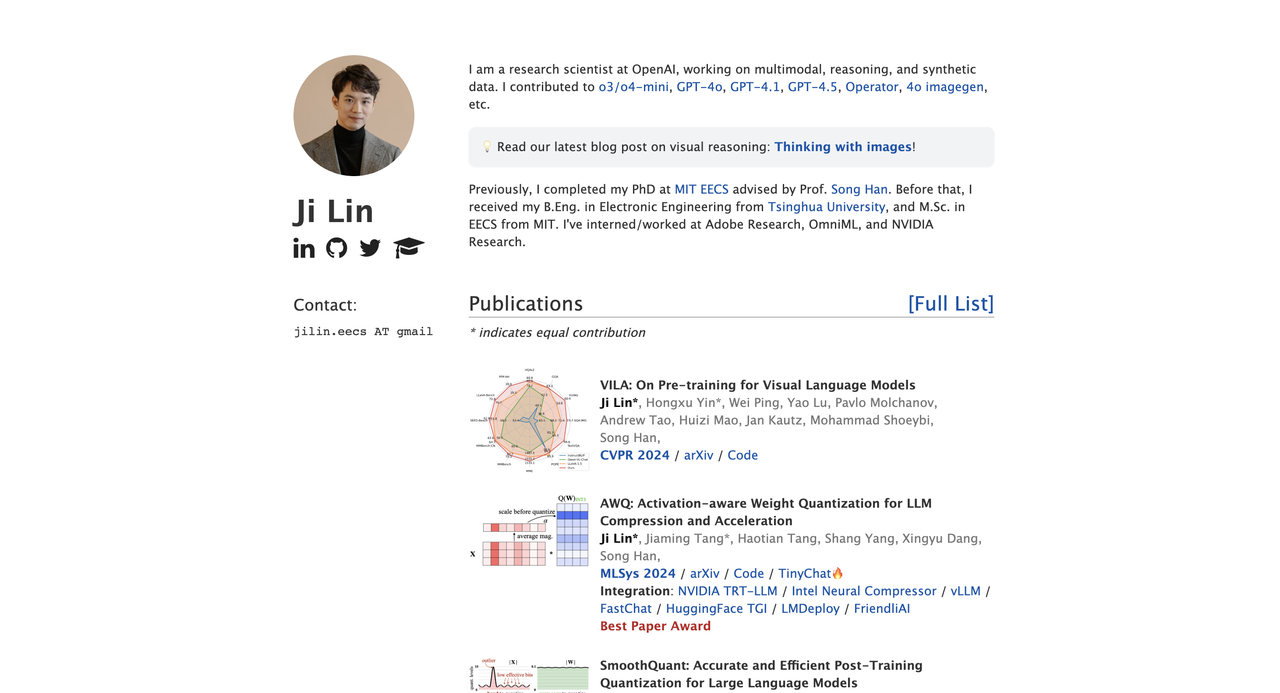

Ji Lin

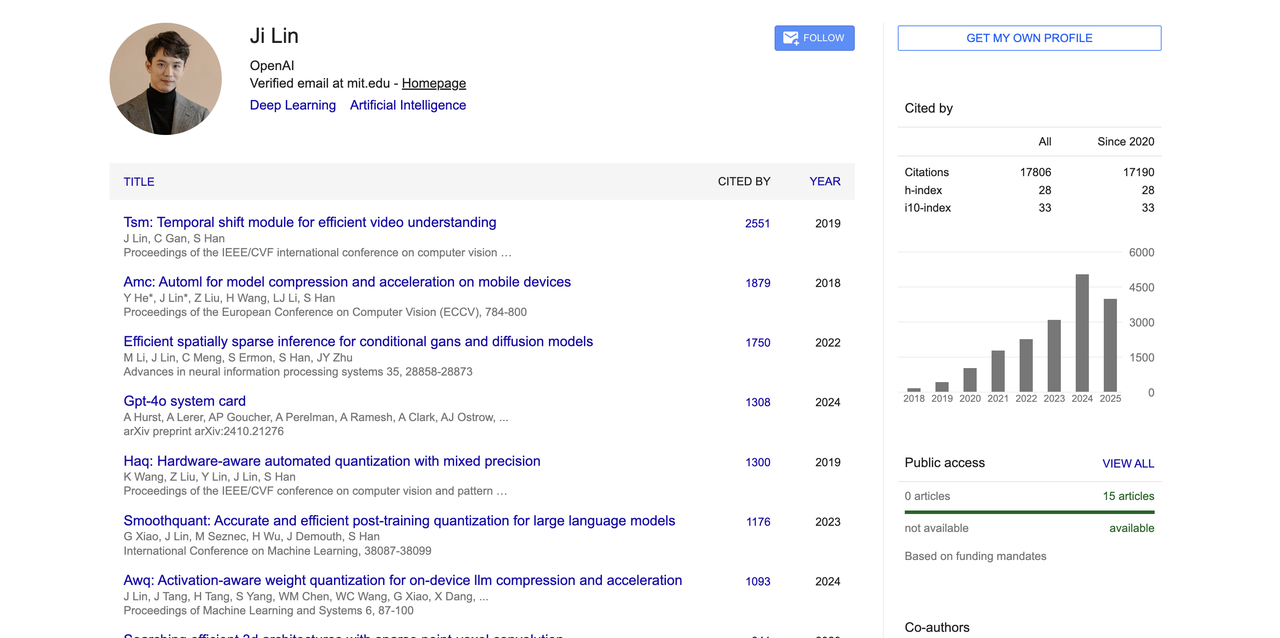

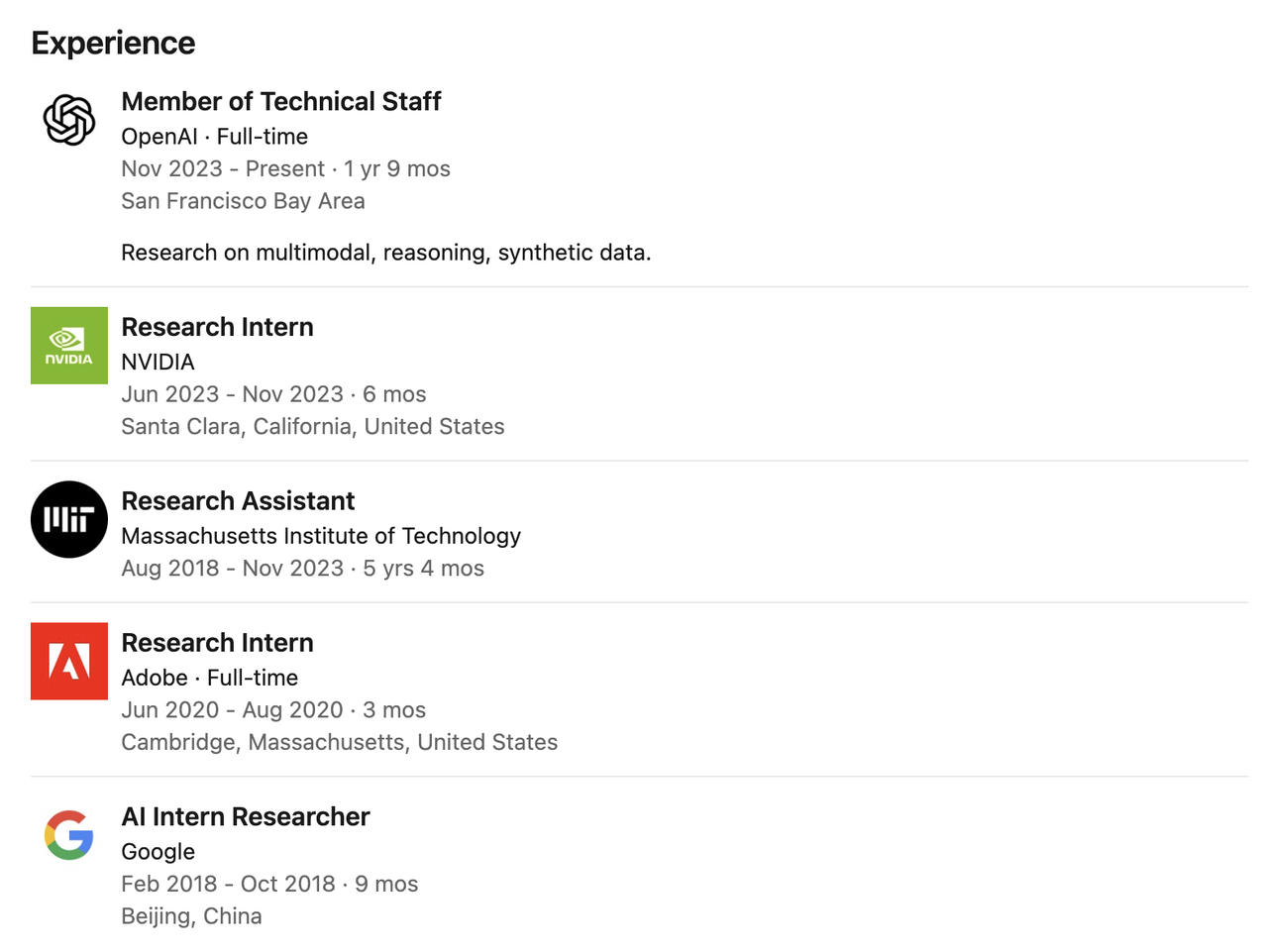

Ji Lin forscht hauptsächlich zu multimodalem Lernen, Schlussfolgerungssystemen und synthetischen Daten. Er ist an mehreren Kernmodellen beteiligt, darunter GPT-4o, GPT-4.1, GPT-4.5, o3/o4-mini, Operator und 4o-Bildgenerierungsmodell.

Er schloss sein Studium an der Tsinghua-Universität mit einem Bachelor in Elektrotechnik ab (2014–2018) und erhielt seinen Ph.D. in Elektrotechnik und Informatik vom MIT, wo er von dem renommierten Wissenschaftler Prof. Song Han betreut wurde.

Während seines Doktoratsstudiums konzentrierte sich seine Forschung auf Schlüsselbereiche wie Modellkomprimierung, Quantisierung, visuelle Sprachmodelle und Sparse Reasoning.

Bevor er 2023 zu OpenAI kam, arbeitete er als Praktikant bei NVIDIA, Adobe und Google und forschte lange Zeit am MIT zur Komprimierung neuronaler Netzwerke und zur Beschleunigung von Inferenzen, wodurch er sich ein tiefes theoretisches Fundament und praktische Erfahrung im Ingenieurwesen aneignete.

Im akademischen Bereich hat er zahlreiche hochkarätige Arbeiten in den Bereichen Modellkompression, Quantisierung und multimodales Vortraining veröffentlicht, die insgesamt über 17.800 Mal bei Google Scholar zitiert wurden. Zu seinen herausragenden Leistungen zählen das Videoverständnismodell TSM, die hardwarebasierte Quantisierungsmethode AWQ, SmoothQuant und das visuelle Sprachmodell VILA.

Er ist außerdem einer der Hauptautoren der technischen Dokumentation des GPT-4o-Systems (wie etwa der GPT-4o-Systemkarte) und gewann für sein AWQ-Papier den MLSys 2024 Best Paper Award.

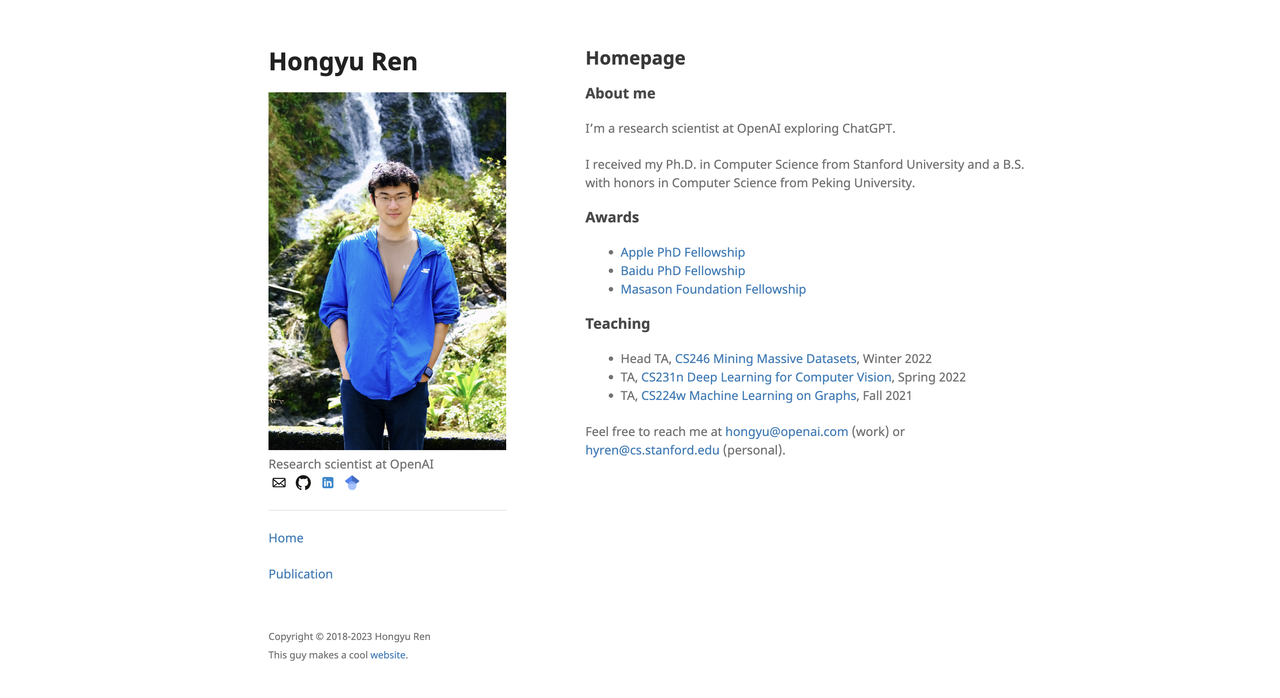

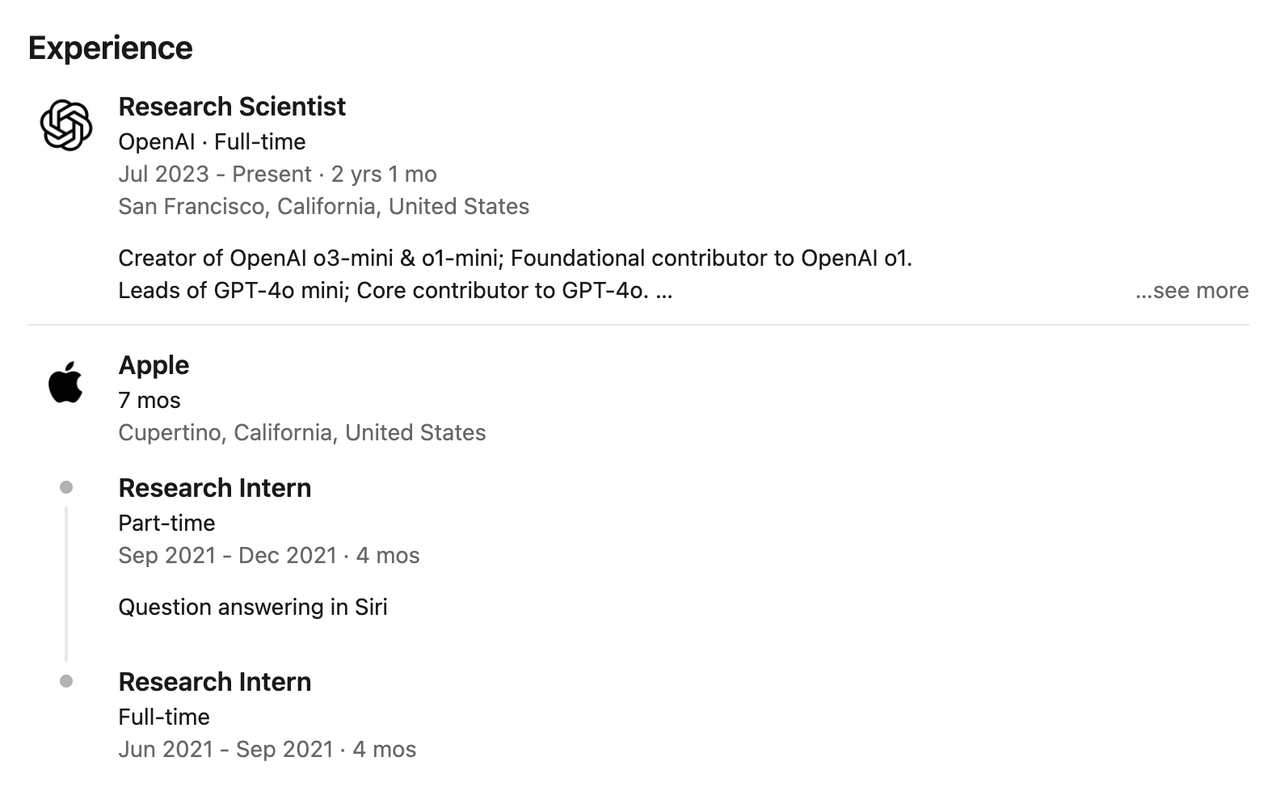

Hongyu Ren

Hongyu Ren erhielt seinen Bachelor-Abschluss in Informatik und Technologie von der Peking-Universität (2014–2018) und seinen Doktortitel in Informatik von der Stanford University (2018–2023).

Er erhielt mehrere Stipendien, darunter das PhD Fellowship von Apple, Baidu und der SoftBank Masason Foundation. Seine Forschung konzentriert sich auf große Sprachmodelle, Wissensgraphen-Reasoning, multimodale Intelligenz und grundlegende Modellbewertung.

Bevor er zu OpenAI kam, absolvierte er mehrere Praktika bei Google, Microsoft und NVIDIA. Während seiner Tätigkeit als wissenschaftlicher Praktikant bei Apple im Jahr 2021 war er beispielsweise an der Entwicklung des Frage-und-Antwort-Systems Siri beteiligt.

Nach seinem Eintritt bei OpenAI im Juli 2023 beteiligte sich Hongyu Ren am Aufbau mehrerer Kernmodelle wie GPT-4o, 4o-mini, o1-mini, o3-mini, o3 und o4-mini und leitete das Post-Training-Team.

In seinen Worten: „Ich bringe Models bei, schneller, intensiver und schärfer zu denken.“

Im akademischen Bereich wurde er insgesamt mehr als 17.742 Mal in Google Scholar zitiert. Zu seinen am häufigsten zitierten Arbeiten zählen: „On the Opportunities and Risks of Foundation Models“ (6.127 Mal zitiert); „Open Graph Benchmark“ (OGB)-Datensatz (3.524 Mal zitiert) usw.

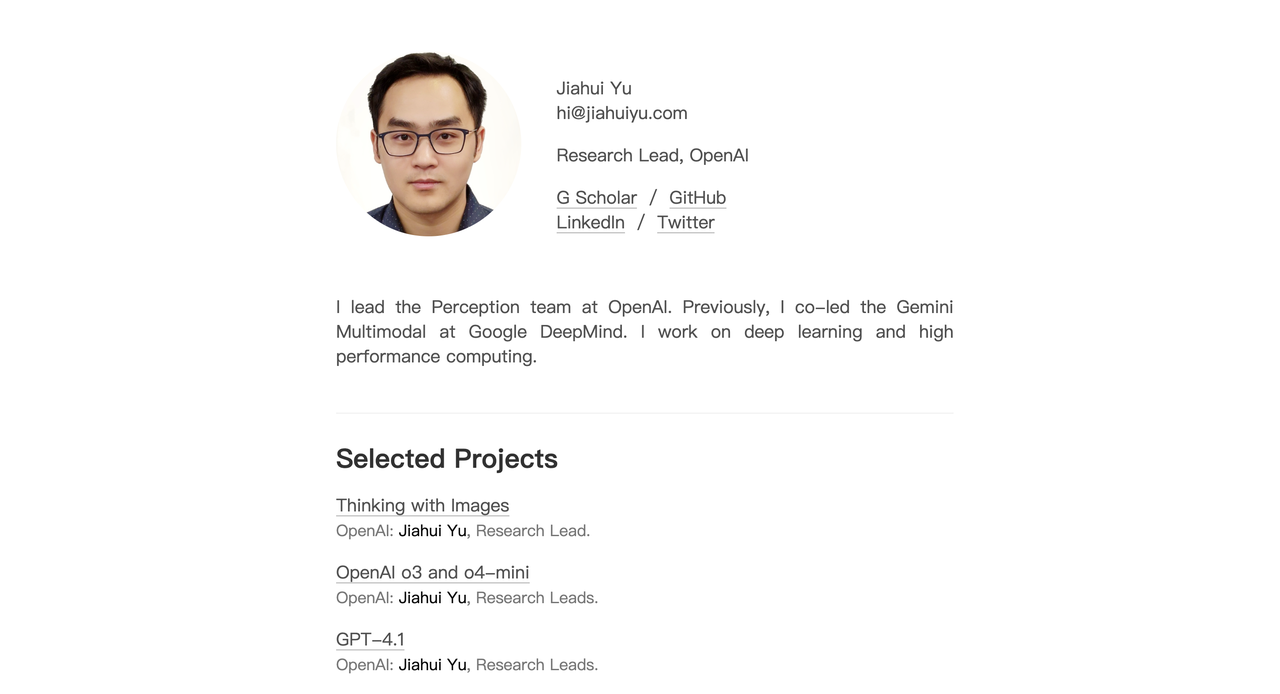

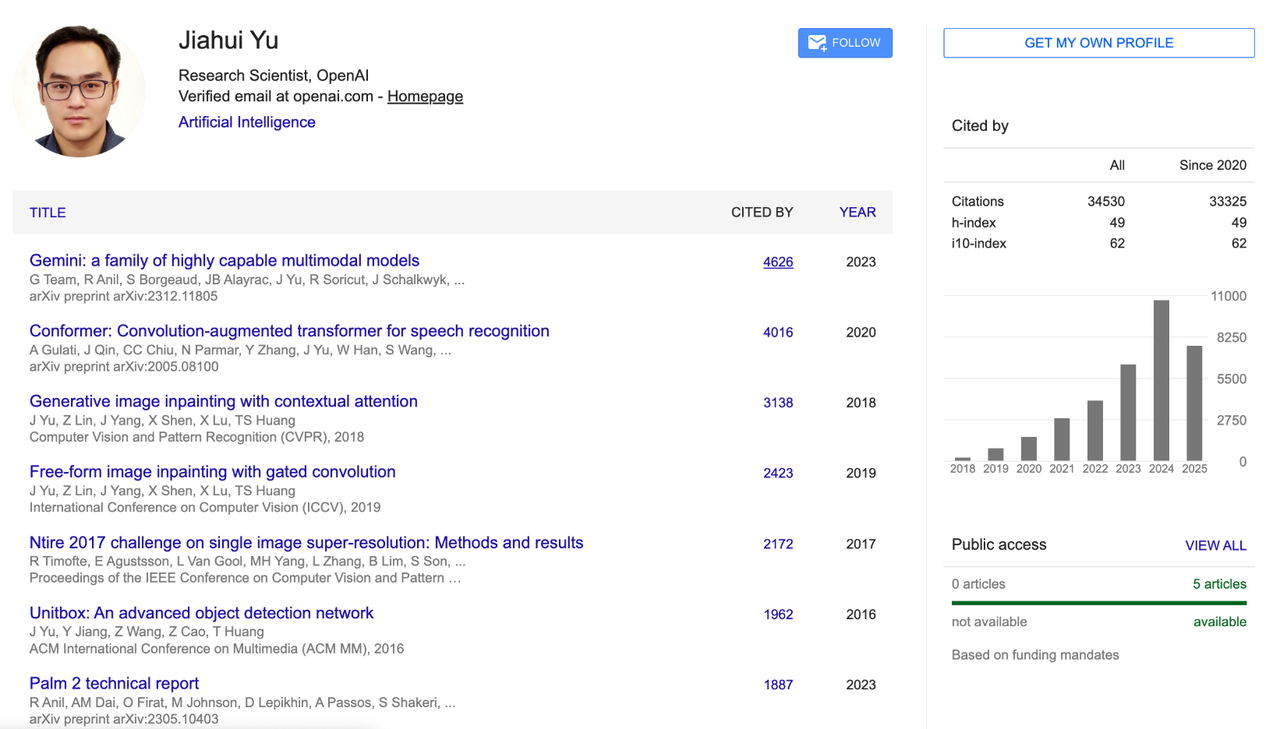

Jiahui Yu

Jiahui Yu schloss sein Studium an der University of Science and Technology of China mit einem Bachelor in Informatik ab und erhielt anschließend einen Doktortitel in Informatik von der University of Illinois at Urbana-Champaign (UIUC).

Zu seinen Forschungsschwerpunkten zählen Deep Learning, Bildgenerierung, große Modellarchitekturen, multimodales Denken und Hochleistungsrechnen.

Während seiner Tätigkeit bei OpenAI war Jiahui Yu Leiter des Wahrnehmungsteams und leitete die Entwicklung wichtiger Projekte wie das Bilderzeugungsmodul GPT-4o, GPT-4.1, o3/o4-mini und schlug das Wahrnehmungssystem „Denken mit Bildern“ vor und implementierte es.

Zuvor arbeitete er fast vier Jahre lang bei Google DeepMind, wo er maßgeblich an der Architektur und Modellierung von PaLM-2 mitwirkte und die Entwicklung des multimodalen Gemini-Modells mitleitete. Er ist eines der wichtigsten technischen Rückgrate der multimodalen Strategie von Google.

Er verfügt außerdem über Praktikumserfahrung bei zahlreichen Institutionen, darunter NVIDIA, Adobe, Baidu, Snap, Megvii und Microsoft Research Asia. Seine Forschung umfasst GAN, Objekterkennung, autonomes Fahren, Modellkomprimierung, Bildwiederherstellung und groß angelegte Deep-Learning-Trainingssysteme.

Jiahui wurde bei Google Scholar über 34.500 Mal zitiert und hat einen h-Index von 49. Zu seinen repräsentativen Forschungsergebnissen zählen das Basismodell CoCa zur Bild-Text-Ausrichtung, das Text-zu-Bild-Generierungsmodell Parti, das skalierbare neuronale Netzwerkdesign BigNAS und die Bildwiederherstellungstechnologie DeepFill v1 und v2, die in Adobe Photoshop weit verbreitet sind.

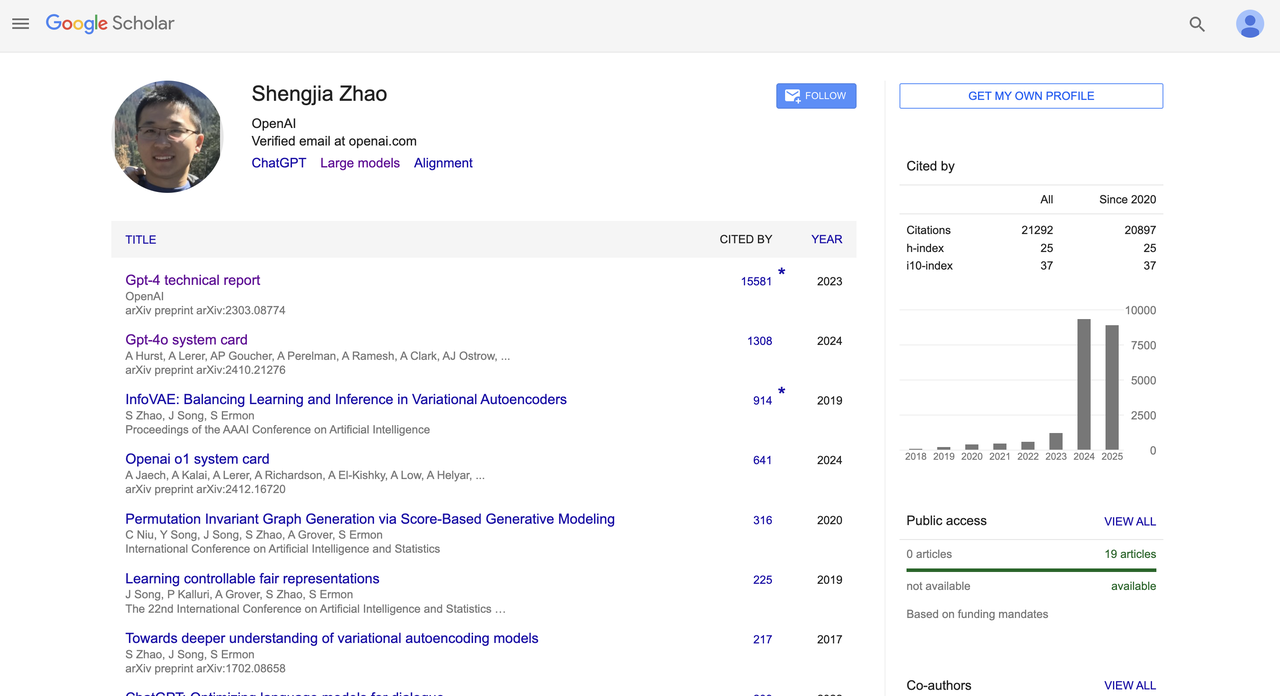

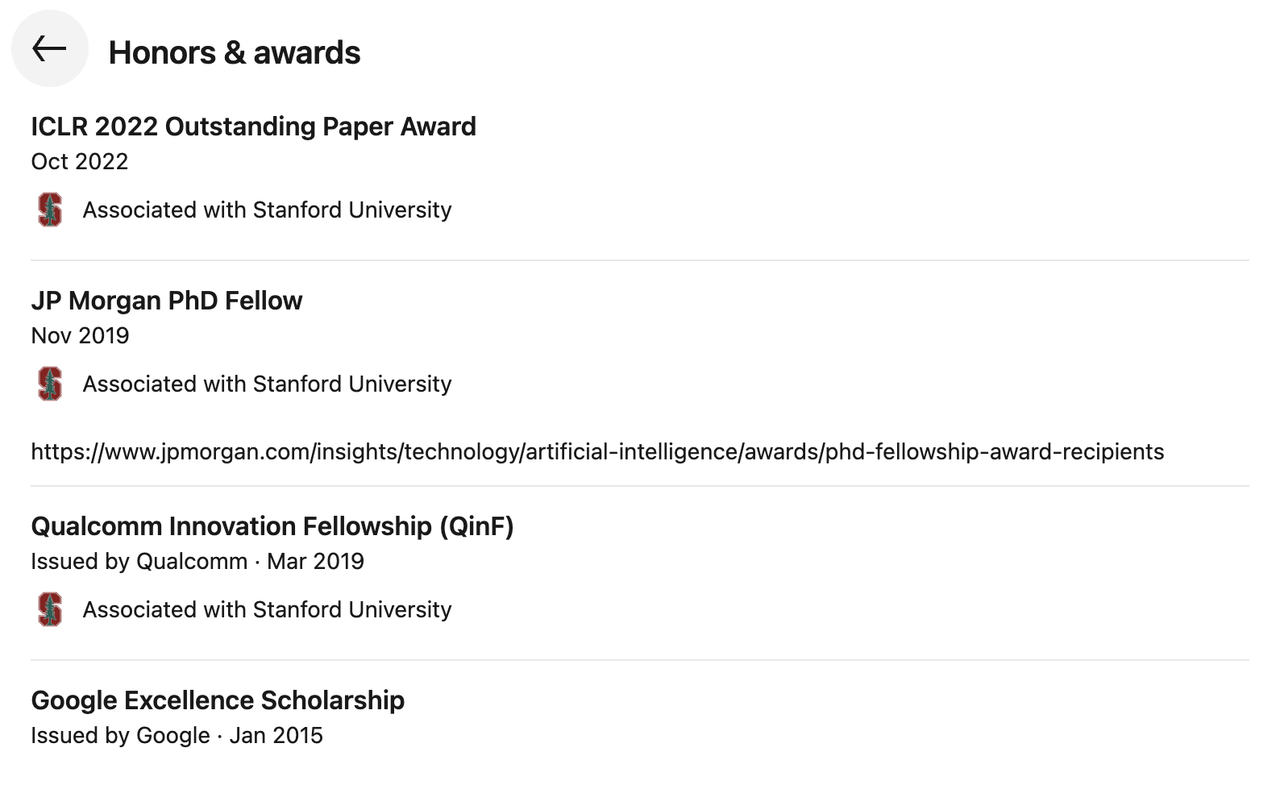

Shengjia Zhao

Shengjia Zhao schloss sein Informatikstudium an der Tsinghua-Universität ab. Er war Austauschstudent an der Rice University in den USA und promovierte später in Informatik an der Stanford University. Seine Forschungsschwerpunkte waren große Modellarchitekturen, multimodales Denken und Alignment.

Im Jahr 2022 trat er OpenAI als zentrales Forschungs- und Entwicklungsmitglied bei und war maßgeblich am Systemdesign von GPT-4 und GPT-4o beteiligt. Er leitete die Forschung und Entwicklung von ChatGPT, GPT-4, allen Minimodellen, 4.1 und o3 und leitete außerdem das OpenAI-Team für synthetische Daten.

Er ist Mitautor des „GPT-4 Technical Report“ (mehr als 15.000-mal zitiert) und der „GPT-4o System Card“ (mehr als 1.300-mal zitiert) und war an der Erstellung mehrerer Systemkarten (wie OpenAI o1) beteiligt. Er ist einer der wichtigsten Mitwirkenden an der Standardisierung und Offenheit der Basismodelle von OpenAI.

Was seine akademischen Leistungen angeht, verfügt er über insgesamt mehr als 21.000 Google Scholar-Zitate und einen h-Index von 25. Er hat viele Auszeichnungen gewonnen, darunter den ICLR 2022 Outstanding Paper Award, den JP Morgan PhD Fellow, das Qualcomm Innovation Fellowship (QinF) und das Google Excellence Scholarship.

Google → Meta

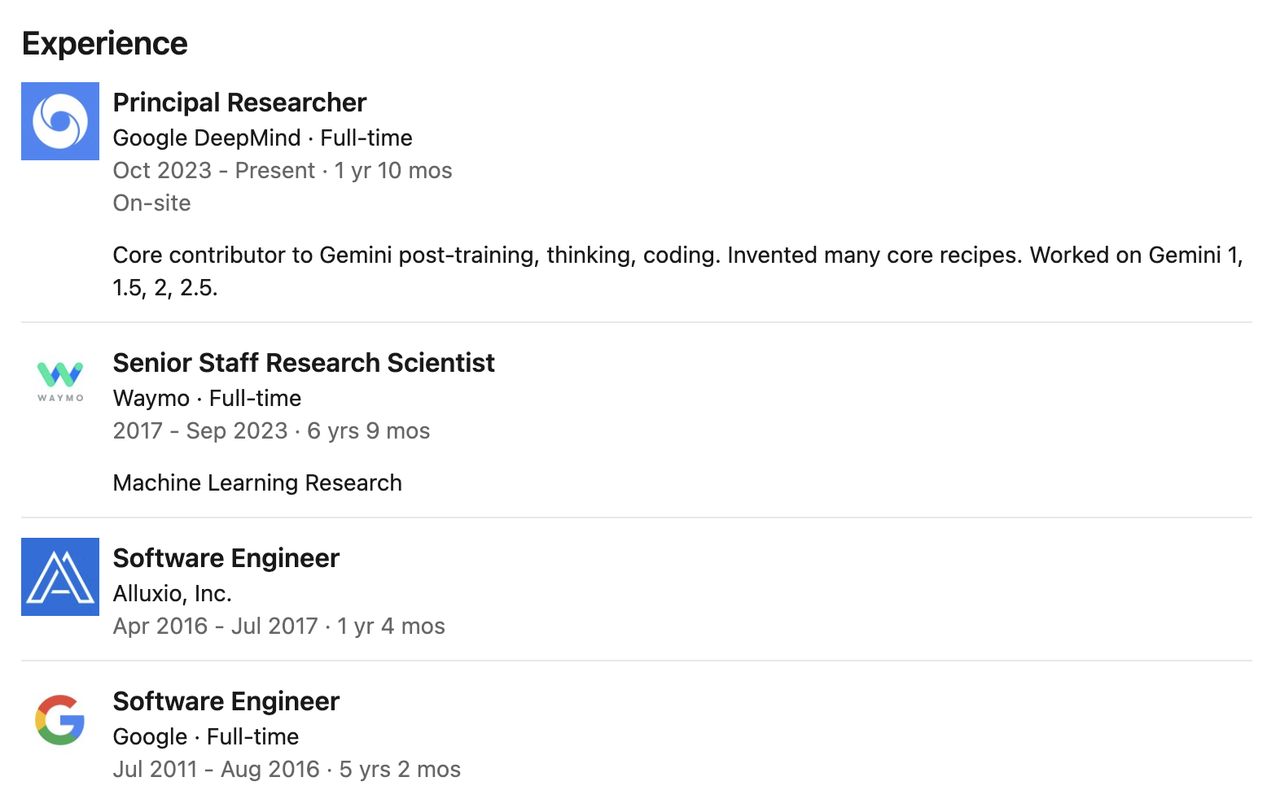

Pei Sun

Im Jahr 2009 erhielt Pei Sun ihren Bachelor-Abschluss von der Tsinghua-Universität und ging anschließend an die Carnegie Mellon University, um dort ihren Master- und Doktortitel zu erwerben. Sie schloss ihr Masterstudium erfolgreich ab und entschied sich, das Studium während der Promotionsphase abzubrechen.

Er war leitender Forscher bei Google DeepMind, wo er sich auf das Post-Training, die Programmierung und das Reasoning des Gemini-Modells konzentrierte. Er ist einer der Hauptverantwortlichen für das Post-Training, die Entwicklung von Denkmechanismen und die Code-Implementierung der Gemini-Modellreihe (einschließlich Gemini 1, 1.5, 2 und 2.5).

Bevor er zu DeepMind kam, arbeitete Pei fast sieben Jahre lang als leitender Forschungswissenschaftler bei Waymo, wo er die Entwicklung von zwei Generationen der zentralen Wahrnehmungsmodelle von Waymo leitete und eine Schlüsselrolle bei der Entwicklung autonomer Fahrwahrnehmungssysteme spielte.

Zuvor war er mehr als fünf Jahre lang als Softwareentwickler bei Google tätig und wechselte dann für mehr als ein Jahr als Ingenieur zum Unternehmen für verteilte Speicherung Alluxio, wo er an der Forschung und Entwicklung im Bereich Systemarchitektur mitwirkte.

Nexusflow → NVIDIA

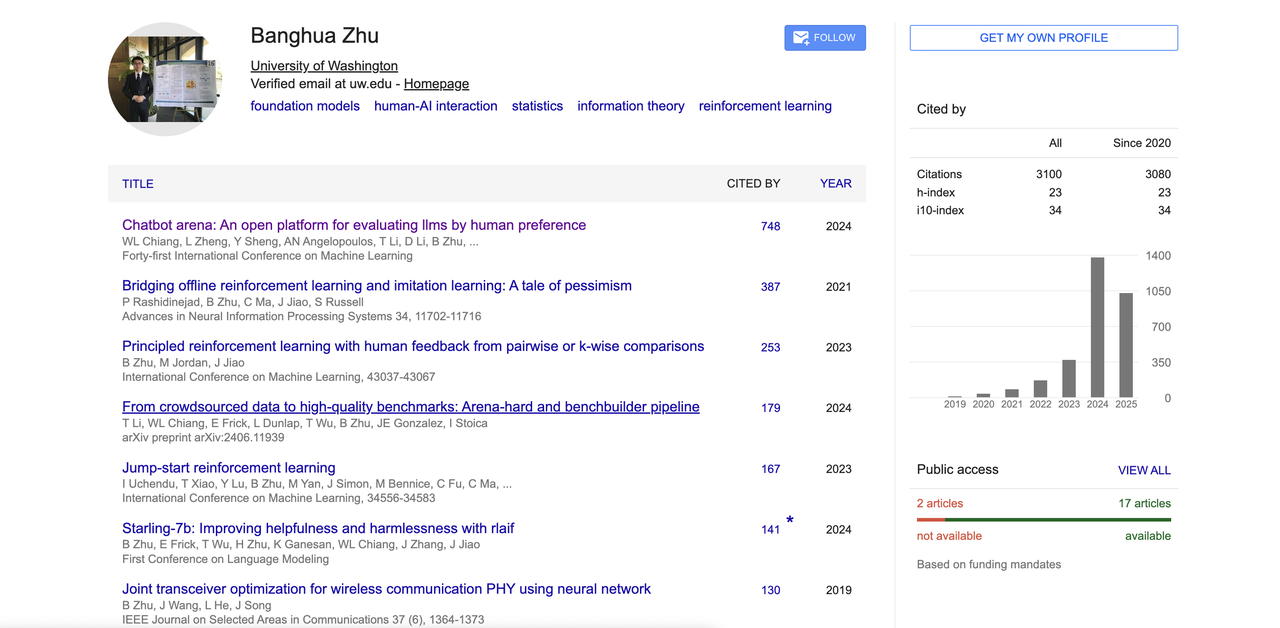

Banghua Zhu

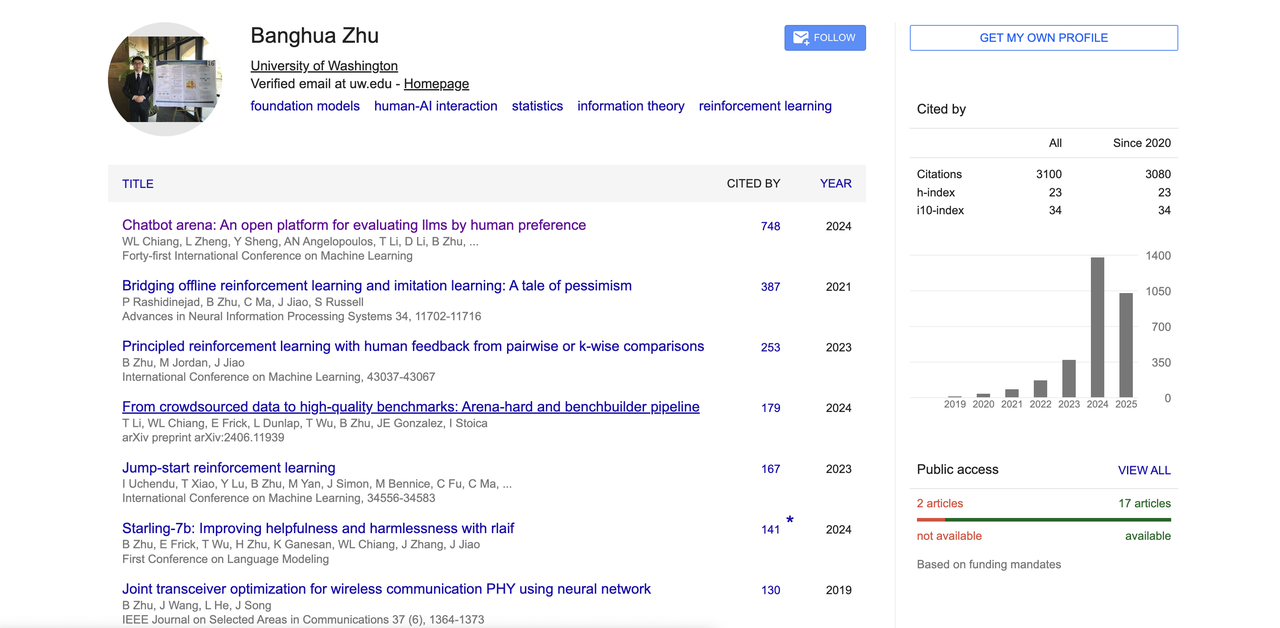

Banghua Zhu schloss sein Studium an der Fakultät für Elektrotechnik der Tsinghua-Universität ab und ging anschließend an die University of California in Berkeley, um dort unter der Anleitung der berühmten Wissenschaftler Michael I. Jordan und Jiantao Jiao in Elektrotechnik und Informatik zu promovieren.

Seine Forschung konzentriert sich auf die Verbesserung der Effizienz und Sicherheit grundlegender Modelle, die Integration statistischer Methoden in die Theorie des maschinellen Lernens und die Entwicklung von Open-Source-Datensätzen und öffentlich zugänglichen Tools. Zu seinen Interessen zählen außerdem Spieltheorie, bestärkendes Lernen, Mensch-Computer-Interaktion und die Entwicklung von Systemen für maschinelles Lernen.

In seinem repräsentativen Artikel „Chatbot Arena“ schlug er eine große, auf menschlichen Präferenzen basierende Modellbewertungsplattform vor, die zu einem der wichtigsten Maßstäbe im LLM-Bereich wurde.

Darüber hinaus hat er auch Beiträge zu RLHF, menschlicher Feedback-Ausrichtung, Open-Source-Ausrichtungsmodellen usw. geleistet. Sein Google Scholar zeigt, dass die Gesamtzahl der Zitate 3.100 übersteigt und der h-Index 23 beträgt. Er ist auch einer der Hauptautoren vieler beliebter Open-Source-Projekte wie der großen Modellarena „Chatbot Arena“, „Benchbuilder“ und „Starling“.

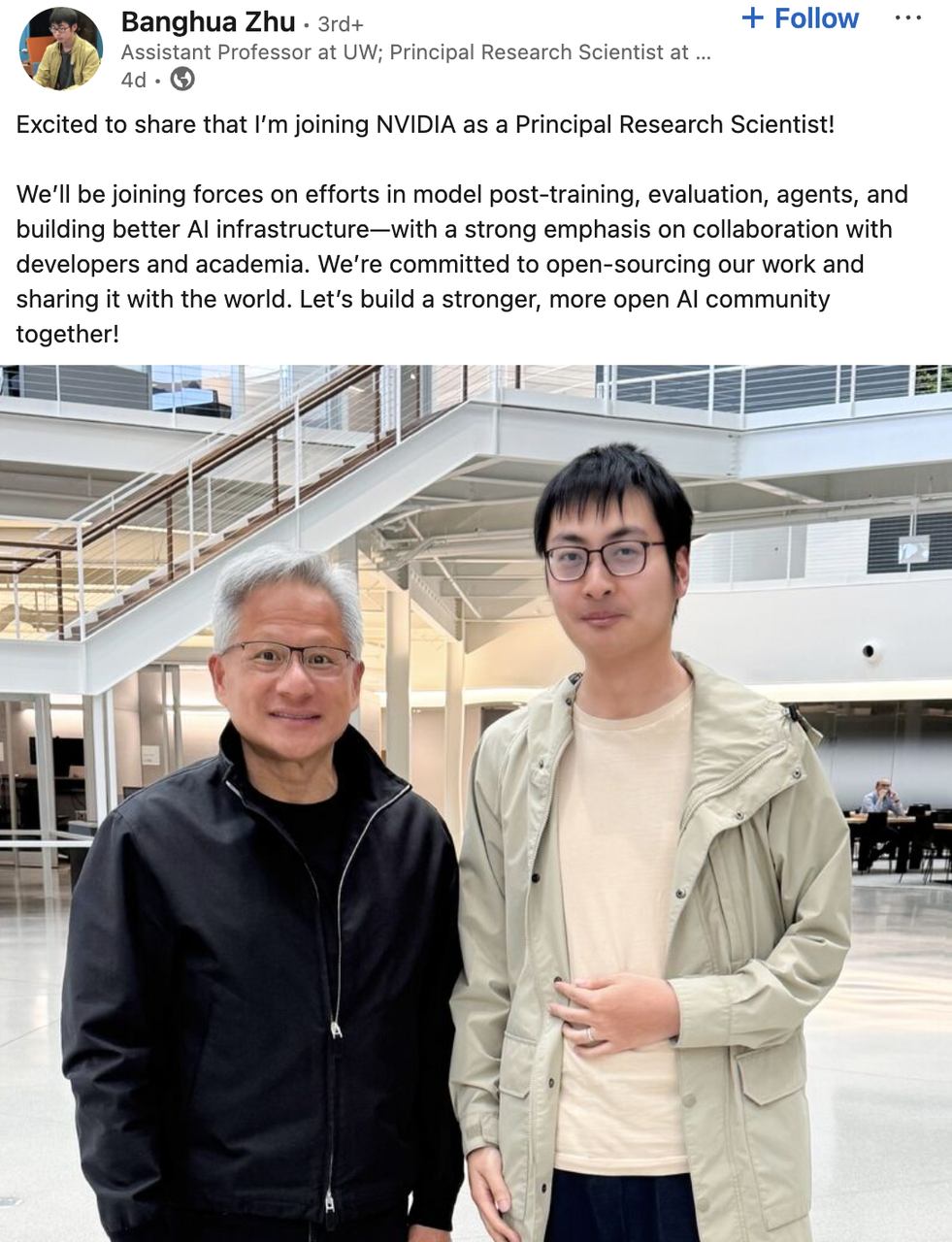

Er arbeitete als Forschungspraktikant bei Microsoft und als studentischer Mitarbeiter bei Google. Er ist Mitbegründer des KI-Startups Nexusflow. Im Juni dieses Jahres gab er bekannt, dass er dem Star Nemotron-Team von NVIDIA als leitender Forschungswissenschaftler beigetreten ist. Darüber hinaus wird er im Herbst dieses Jahres als Assistenzprofessor an die University of Washington wechseln.

Der Pressemitteilung zufolge wird er an Projekten wie Post-Model-Training, Evaluierung, KI-Infrastruktur und der Entwicklung intelligenter Agenten bei NVIDIA teilnehmen, wobei er Wert auf eine enge Zusammenarbeit mit Entwicklern und der Wissenschaft legt und plant, entsprechende Ergebnisse als Open Source zu veröffentlichen.

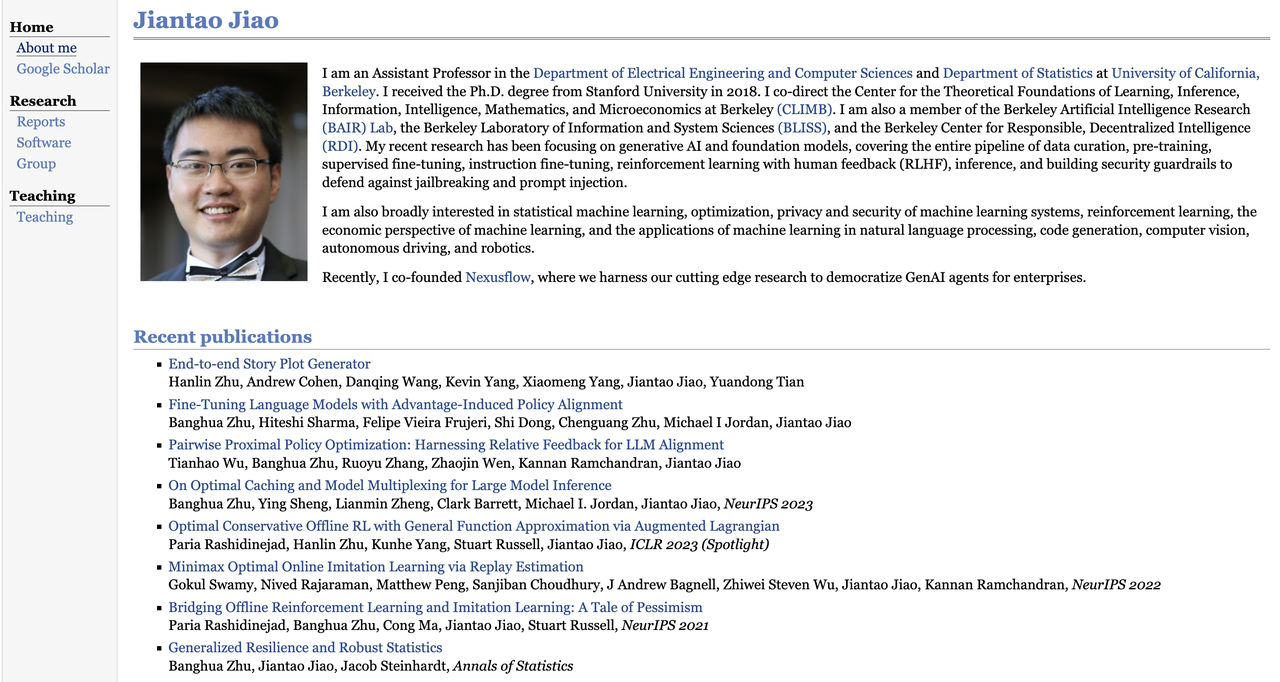

Jiantao Jiao

Jiantao Jiao ist Assistenzprofessor in den Abteilungen für Elektrotechnik, Informatik und Statistik an der University of California, Berkeley.

Er erhielt 2018 seinen Doktortitel in Elektrotechnik von der Stanford University und ist derzeit Co-Direktor oder Mitglied mehrerer Forschungszentren, darunter das Berkeley Center for Theoretical Learning (CLIMB), das Berkeley Artificial Intelligence Research Center (BAIR Lab), das Laboratory for Information and Systems Science (BLISS) und das Center for Decentralized Intelligence (RDI).

Seine Forschung konzentriert sich auf generative KI und grundlegende Modelle. Darüber hinaus interessiert er sich für statistisches maschinelles Lernen, Optimierungstheorie, Datenschutz und Sicherheit von Reinforcement-Learning-Systemen, die Entwicklung ökonomischer Mechanismen, natürliche Sprachverarbeitung, Codegenerierung, Computer Vision, autonomes Fahren und Robotik.

Wie Banghua Zhu ist auch er einer der Mitbegründer von Nexusflow und ist nun offiziell als Forschungsleiter und angesehener Wissenschaftler zu NVIDIA gekommen.

Jiao verfügt über insgesamt 7.259 Zitierungen und einen h-Index von 34. Zu seinen repräsentativen Arbeiten zählen „Theoretically principled trade-off between robustness and accuracy“ und „Bridging Offline Reinforcement Learning and Imitation Learning: A Tale of Pessimism“, die er gemeinsam mit Banghua Zhu et al. verfasste und die beide auf hochrangigen Konferenzen wie NeurIPS veröffentlicht wurden.

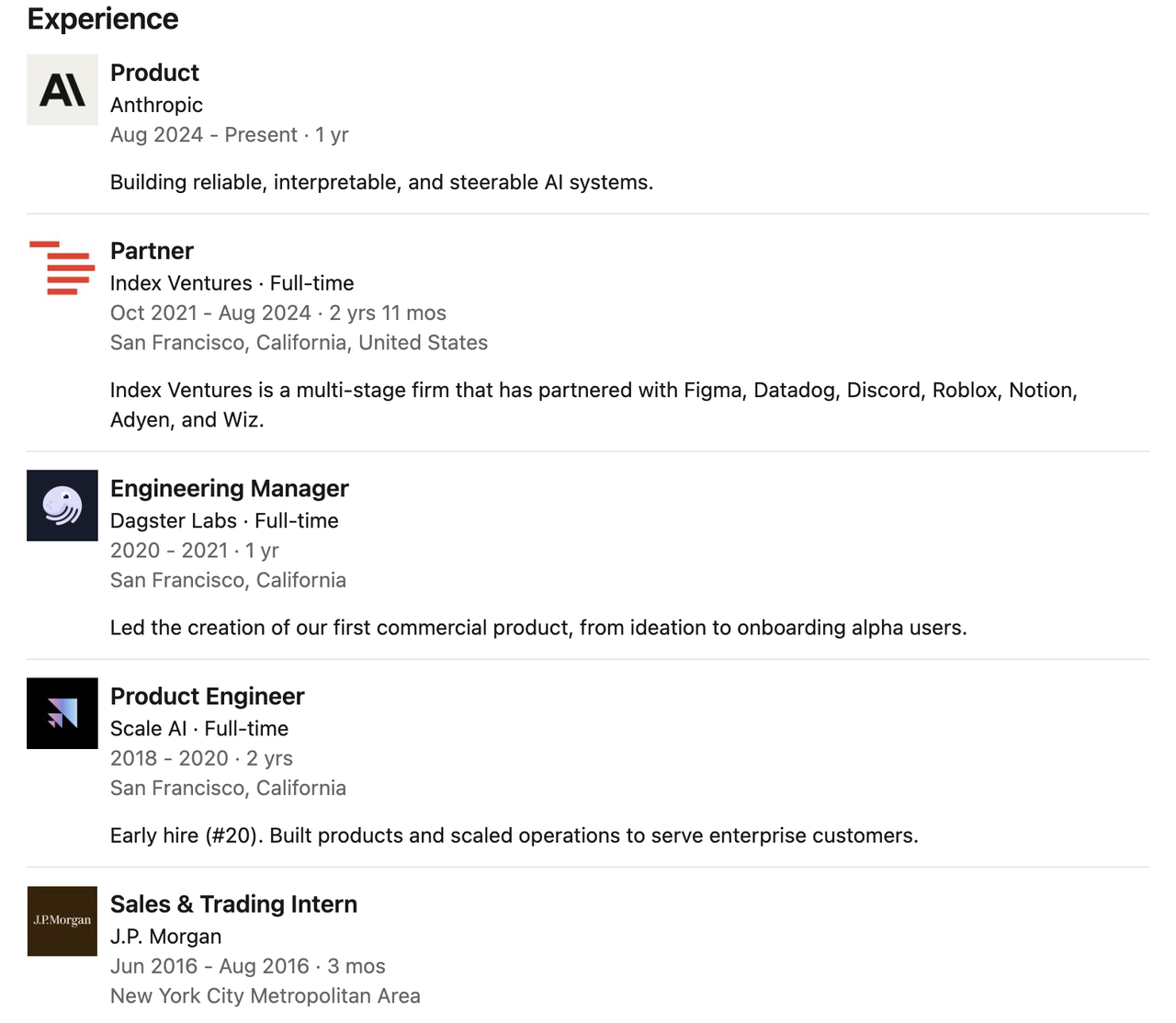

Claude → Cursor

Catherine Wu

Catherine Wu arbeitete als Produktmanagerin für Claude Code bei Anthropic und konzentrierte sich auf die Entwicklung zuverlässiger, erklärbarer und kontrollierbarer KI-Systeme. Laut The Information wurde Catherine Wu von Cursor, einem KI-Programmier-Startup, als Produktmanagerin abgeworben.

Bevor sie zu Anthropic kam, war sie fast drei Jahre lang Partnerin bei der bekannten Risikokapitalgesellschaft Index Ventures. Während dieser Zeit war sie stark in Frühphaseninvestitionen und strategische Unterstützung für viele Top-Startups involviert.

Ihre Karriere begann nicht im Investmentbereich, sondern war in technischen Positionen an vorderster Front verwurzelt.

Zuvor arbeitete sie als Engineering Manager bei Dagster Labs und leitete dort die Entwicklung des ersten kommerziellen Produkts des Unternehmens. Außerdem war sie als Early Product Engineer bei Scale AI tätig und war an der Konstruktion und dem operativen Ausbau mehrerer wichtiger Produkte beteiligt.

Zuvor absolvierte sie ein Praktikum bei JPMorgan Chase und schloss ihr Studium an der Princeton University mit einem Bachelor in Informatik ab. Während ihres Studiums absolvierte sie außerdem ein Austauschstudium an der Eidgenössischen Technischen Hochschule Zürich.

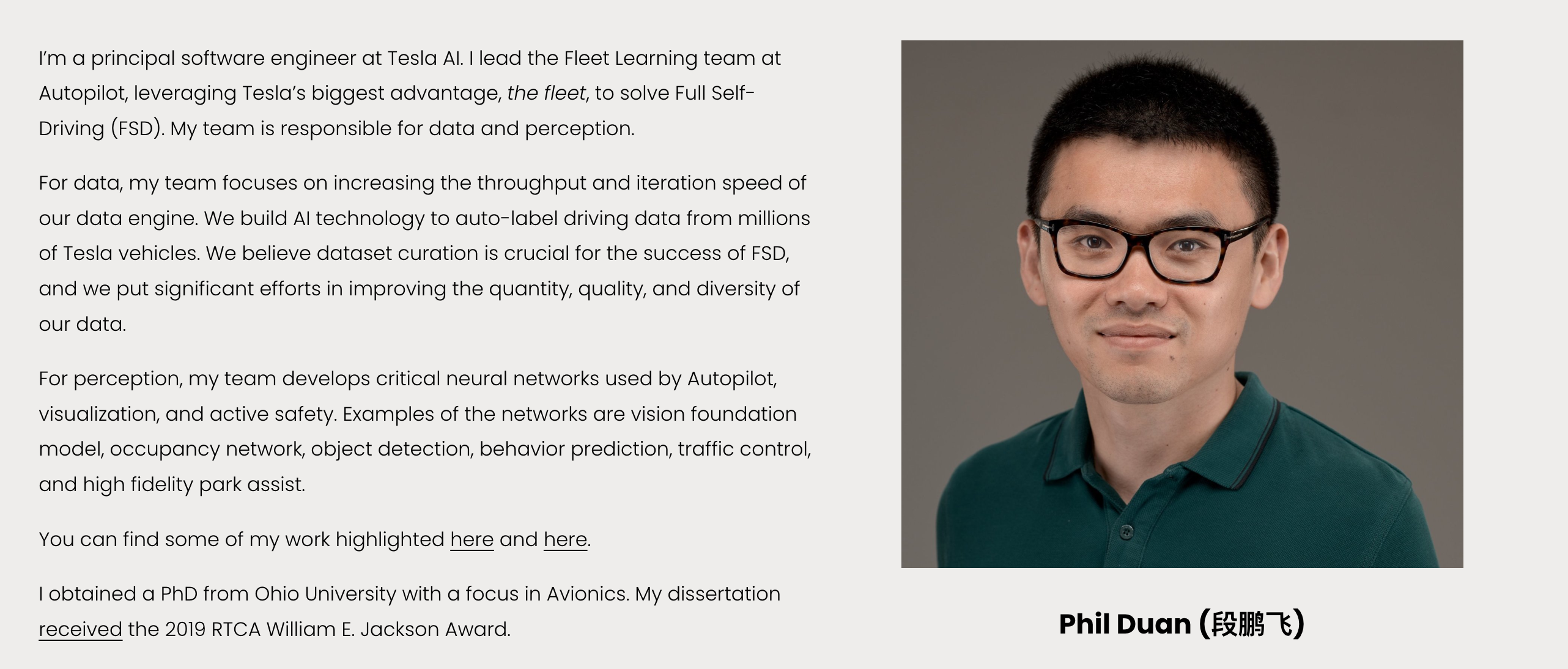

Tesla | Phil Duan

Phil Duan ist der Chef-Softwareentwickler von Tesla AI. Er leitet derzeit das Fleet Learning-Team unter Autopilot und engagiert sich für den Aufbau des Kernmoduls „Daten + Wahrnehmung“ in Teslas autonomem Fahrsystem (FSD).

Er leitete das Tesla-Team bei der Entwicklung einer hochdurchsatzstarken, schnell iterativen Daten-Engine, die Fahrdaten von Millionen von Fahrzeugen sammelt, verarbeitet und automatisch kommentiert. Dabei legte er Wert auf die koordinierte Optimierung von Datenqualität, -quantität und -vielfalt. Im Bereich der Wahrnehmung leitete er den Aufbau einer Reihe wichtiger neuronaler Netzwerke, darunter grundlegende visuelle Modelle, Zielerkennung, Verhaltensvorhersage, Belegungsnetzwerke, Verkehrssteuerung und hochpräzise Parkassistenzsysteme. Außerdem ist er einer der Hauptentwickler des Autopilot-Wahrnehmungssystems.

Er schloss sein Studium an der Technischen Universität Wuhan mit einem Bachelor in optischer Informationswissenschaft und -technologie ab und promovierte anschließend an der Ohio University in Elektrotechnik mit Schwerpunkt Avionik und absolvierte einen Master-Abschluss. Für seine Doktorarbeit erhielt er 2019 den RTCA William E. Jackson Award, eine der höchsten Auszeichnungen für Doktoranden im Bereich Avionik und Telekommunikation in den USA.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von iFanr: iFanr (WeChat-ID: ifanr), wo Ihnen so bald wie möglich weitere spannende Inhalte präsentiert werden.