Es kommt eine Ära von Kameras, die am ganzen Körper hängen|Harte Philosophie

iFanr konzentriert sich auf die „Produkte von morgen“ und versucht in seiner Kolumne zur harten Philosophie, die äußere Schicht aus Technologie und Parametern abzutragen und den Ursprung der Menschheit im Produktdesign zu erforschen.

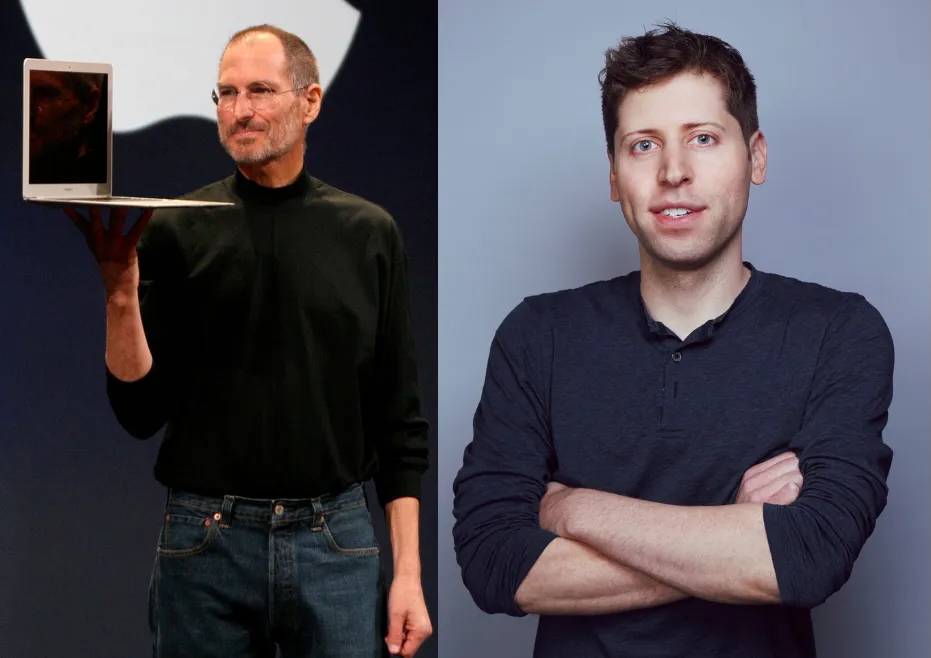

OpenAI sorgt in aller Stille für große Neuigkeiten, von denen derzeit vielleicht nur drei Menschen auf der Welt wissen: OpenAI-CEO Sam Altman, der ehemalige Apple-Chefdesigner Jonathan Ive und Steve Jobs‘ Witwe Laurene Powell Jobs.

Kurz nach dem Ende der Eröffnungszeremonie der Google I/O 2025 folgten zwei weitere bahnbrechende Neuigkeiten: Zunächst plant Apple, im nächsten Jahr eine Smart Glasses herauszubringen und das Uhrenprojekt mit eingebauter Kamera einzustellen. Dann kündigte OpenAI die Übernahme von io Products an, einem Unternehmen, das vom ehemaligen iPhone-Designer Jonathan Ive gegründet wurde. Das Unternehmen beabsichtigt, in Zukunft KI-bezogene Hardwareprodukte auf den Markt zu bringen. Man geht davon aus, dass Laurene Powell Jobs von dieser neuen Hardware sehr angetan ist.

Apple, Google und OpenAI, drei Technologiegiganten, haben abwechselnd und wie in Abstimmung die strategische Ausrichtung ihrer KI-Produkte bekannt gegeben oder angekündigt, was diesen verregneten Sommer noch turbulenter machte.

Apple: Kontinuierlicher Ansatz und kontinuierlicher Ausbau des AR + AI-Ökosystems

Laut Bloomberg-Reporter Mark Gurman haben mit der Angelegenheit vertraute Personen verraten, dass Apple im Jahr 2026 die Markteinführung einer Smart Glasses-App „mit Kamera, Lautsprecher und Mikrofon“ plant. Nutzer können über die Smart Glasses mit Siri interagieren und Befehle erteilen, um die Umgebung zu analysieren, Anrufe zu tätigen, Musik zu steuern, die Kartennavigation zu nutzen und Echtzeitübersetzungen durchzuführen.

Es wird angenommen, dass Apples Smart Glasses mit Apples eigenen Chips wie Vision Pro ausgestattet sein werden. Die endgültige Hardware könnte den zuvor von Meta und Ray-Ban eingeführten Smart Glasses ähneln, jedoch über eine bessere Technologie verfügen. Darüber hinaus wird auch dieses Smart Glasses-Produkt von Apples Vision Products Group entwickelt und befindet sich auf dem gleichen Entwicklungspfad wie die günstigere und leichtere verbesserte Version Vision Pro.

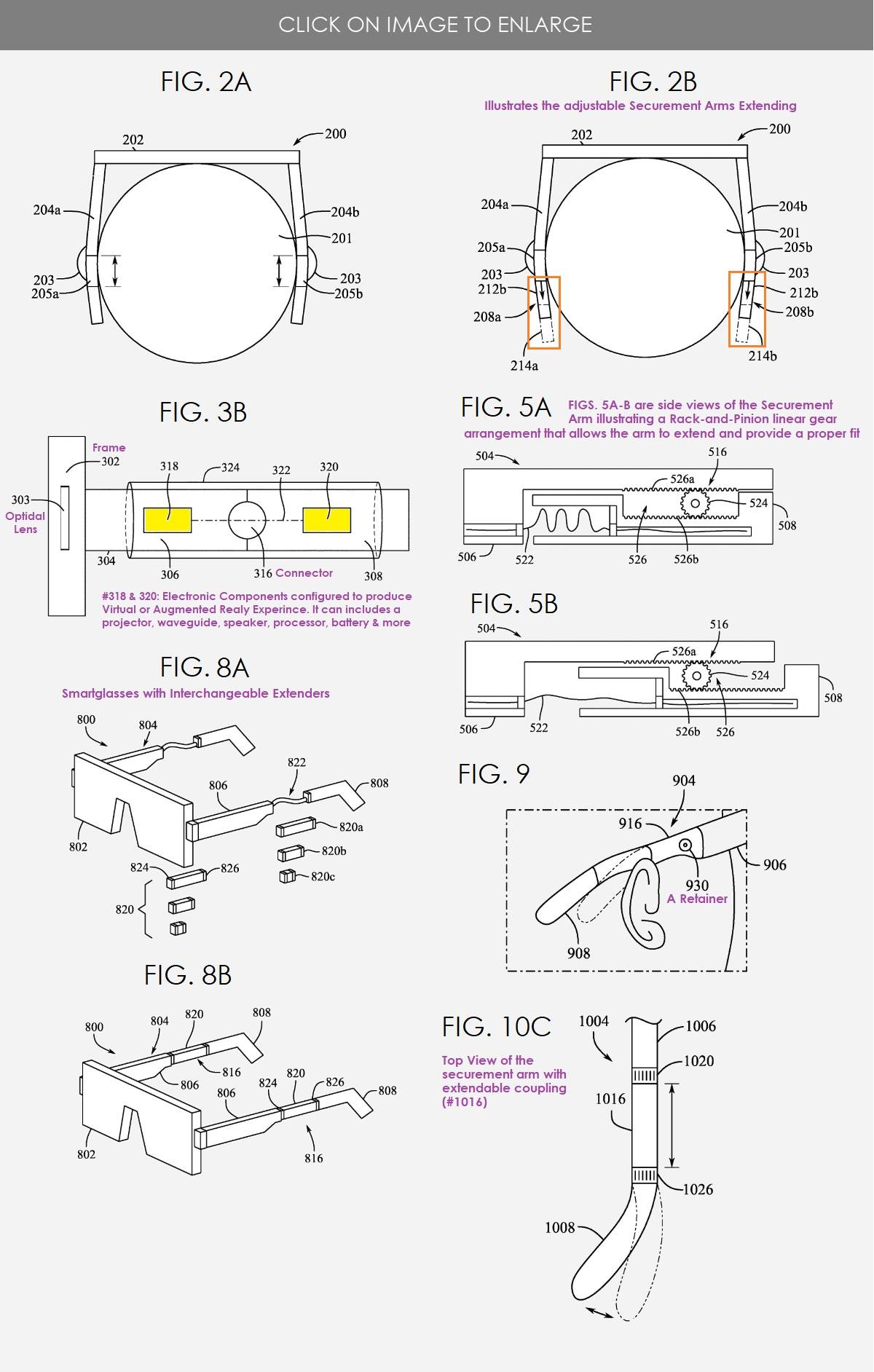

Basierend auf den durchgesickerten Informationen und einigen sporadischen Patentinformationen seit 2024 können wir einige Formen der Smart Glasses von Apple grob erraten.

Laut Patentdokumenten hat Apple beispielsweise eine Brille mit einer doppelteiligen Scharnierstruktur entwickelt, die sich beim Tragen besser an den Kopf anpasst und so Sicherheit, Komfort und Lautsprechereffekt verbessert. Einige Analysten glauben sogar, dass die verstellbare Größe der hinteren Brille dazu beitragen kann, dass Apple-Brillen die Funktion „Gradverstellung“ erreichen, was zweifellos eine gute Nachricht für Benutzer ist, die bereits medizinische Brillen tragen.

Bild: patentlyapple.com

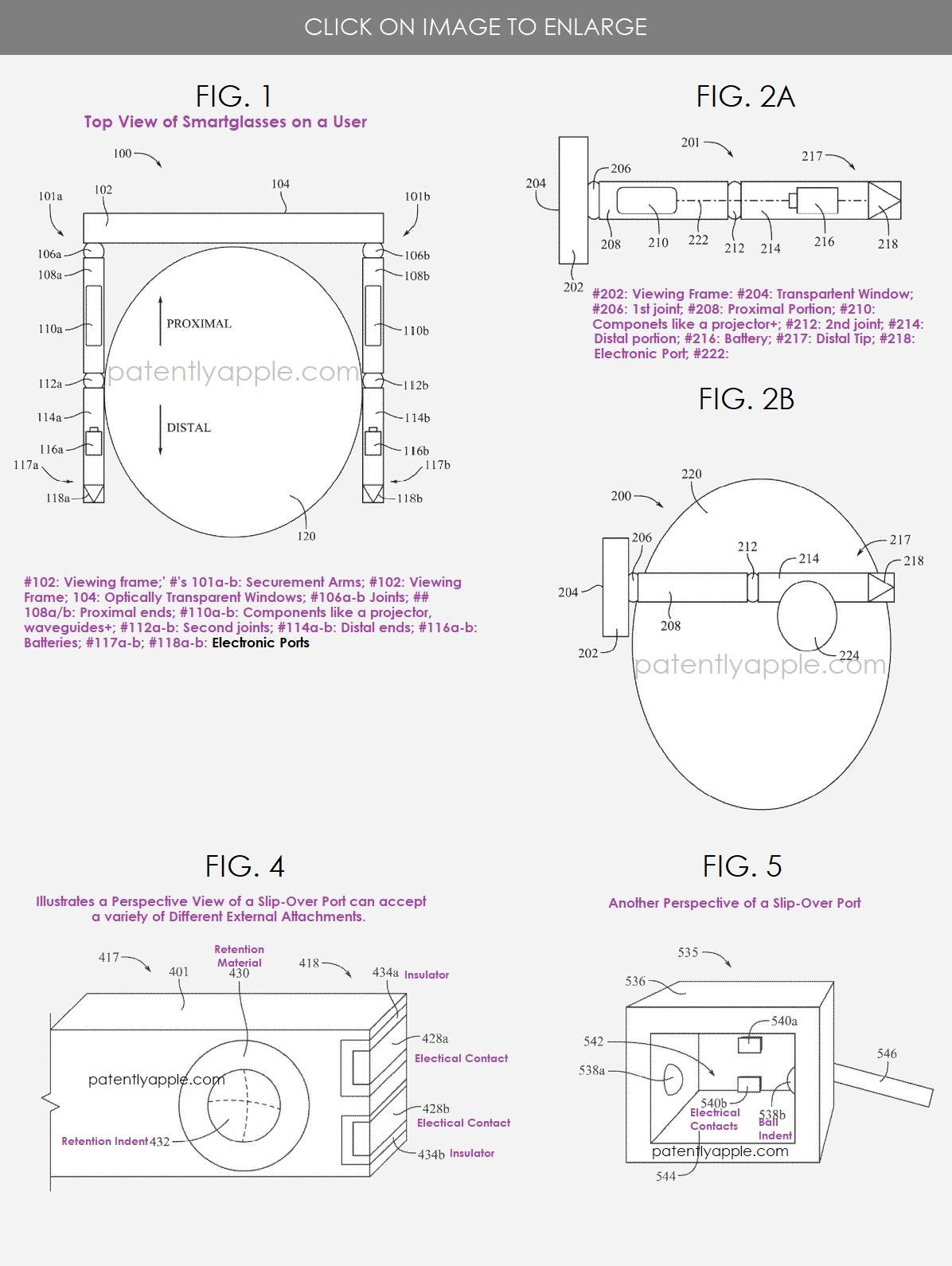

In einem weiteren Patent hat Apple die ungefähre Verteilung der Komponenten an den Bügeln angegeben. Dank des Doppelscharniers befindet sich der Akku der Brille hinten, während die vordere Hälfte hauptsächlich für das Display reserviert ist. Wenn wir anhand der Angaben in diesem Patent spekulieren, könnte die Anzeigemethode der Apple Smart Glasses eine reflektierende Projektion, eine optische Wellenleiteroptik oder sogar eine Kombination aus beidem sein.

Bild: patentlyapple.com

Interessanterweise erwähnt Apple in der zweiten Hälfte des Patents die an den Enden der Brillenbügel angebrachte Übertragungsschnittstelle, die zum „Anschließen verschiedener externer Komponenten“ verwendet werden kann. Dem Design der Schnittstelle mit Verriegelungsstruktur und freiliegenden Kontakten nach zu urteilen, könnten Apples Smart Glasses während des Tragens die Kommunikation mit einem iPhone oder Mac in Form einer kabelgebundenen Verbindung unterstützen, was in Szenarien genutzt werden kann, die Latenz erfordern, wie etwa bei Spielen oder qualitativ hochwertigen Videos.

Im Zusammenhang mit der Entwicklung von Smart Glasses wiesen interne Quellen darauf hin, dass Apple die ursprünglich geplanten Apple Watch-Modelle mit Kameras gestrichen und nur noch die AirPods mit Kameras angeboten habe, um mehr Ressourcen in Smart Glasses zu investieren. Laut Mark Gurmans Enthüllung im März dieses Jahres plante Apple, Kameras unter dem Bildschirm und in der Smart Crown der zukünftigen Apple Watch und Apple Watch Ultra für visuelle Intelligenzfunktionen zur Umgebungserkennung einzubauen.

Trotz der Möglichkeit, eigene Chips zu verwenden, wird die Augmented Reality (AR)-Funktion, die Apple zuvor bei Vision Pro betonte, bei dieser durchgesickerten Smart Glasses möglicherweise nicht realisiert. Bloomberg geht davon aus, dass Apple noch mehrere Jahre brauchen wird, um den angestrebten AR-Effekt zu realisieren.

Bloomberg wies außerdem darauf hin, dass der Apple-Aktienkurs in diesem Jahr um rund 19 % gefallen war, bevor der Insider die Smart Glasses bekannt gab. Dies zeige, dass Apples Leistung im KI-Bereich, der derzeit im Fokus der Technologiebranche steht, kaum Beachtung findet. Daher ist davon auszugehen, dass Apple auf der WWDC nächste Woche einige der zuvor gemunkelten Smart-Produkte offiziell bekannt geben wird. Möglicherweise handelt es sich noch nicht um ein fertiges Produkt, das vorgeführt werden kann, aber es besteht eine hohe Wahrscheinlichkeit, dass es einen konkreten Zeitplan geben wird.

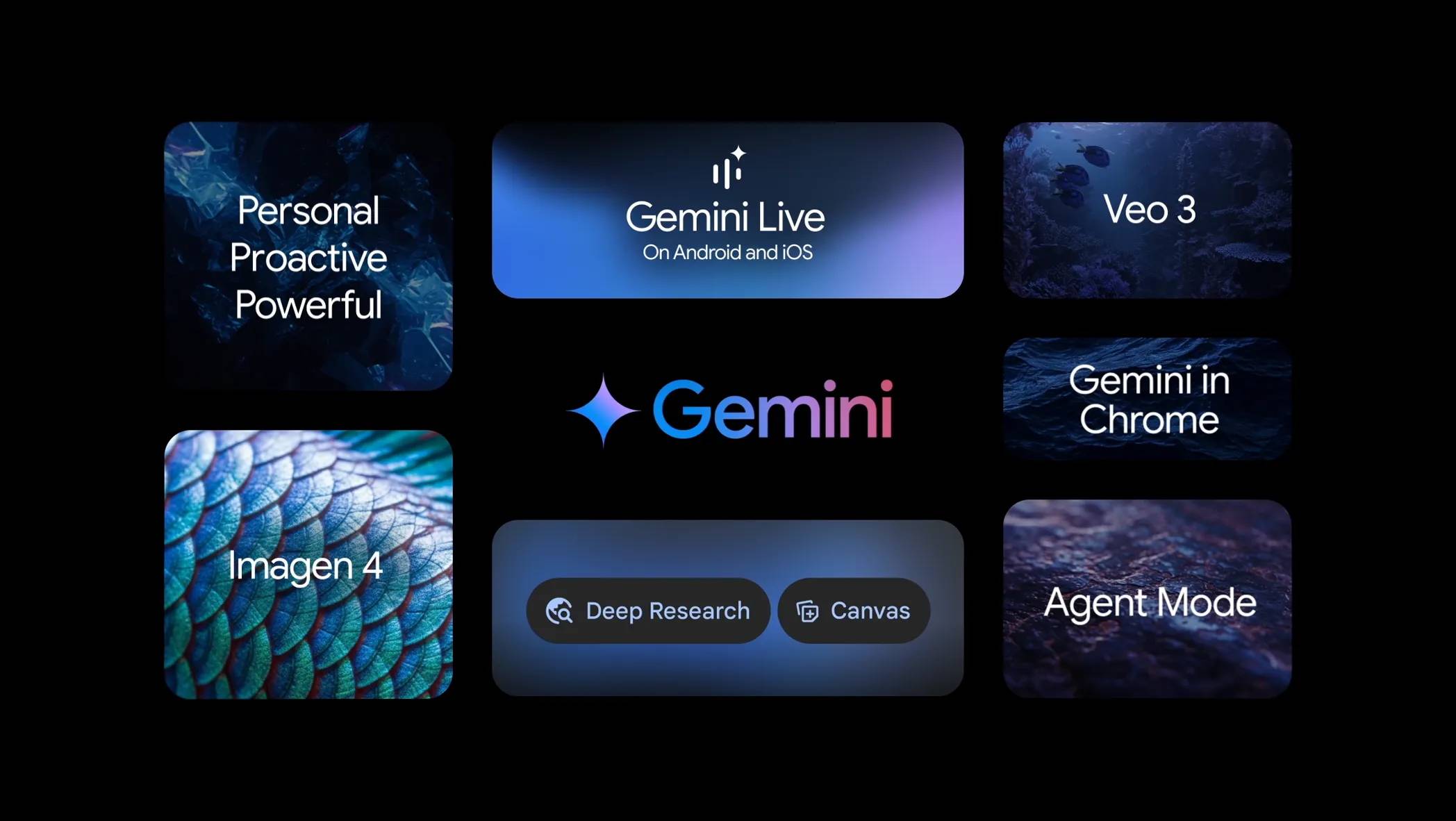

Google: Gemini greift auf symbiotische Weise vollständig in die Produktlinie von Google ein

Google, ein weiterer Gigant, der später in den KI-Wettbewerb eingestiegen ist, hat sich seit 2025 besonders gut entwickelt. Sein Gemini-Modell konnte zunächst kaum mit ChatGPT mithalten, knüpfte dann aber langsam an das Produkt-Ökosystem von Google an und ist nun der einzige Hersteller auf dem Markt, der seine eigenen Produktlinien abdecken und umfassende KI-Dienste anbieten kann. Die Geschwindigkeit seines Fortschritts ist für alle Wettbewerber kaum zu ignorieren.

Es ist keine Übertreibung zu sagen, dass Googles aktuelle Fähigkeiten zur Integration von KI-Dienstsoftware und -hardware die von Apple weit übertroffen haben. Auf der gerade zu Ende gegangenen Google I/O-Konferenz präsentierte Google neben dem Update des Gemini-Modells selbst auch ein hybrides Ökosystemprodukt auf Basis der Android XR-Plattform in Zusammenarbeit mit dem inländischen Unternehmen Xreal – Project Aura.

Projekt Aura erinnert stark an Google Glasses von vor zehn Jahren. Im Gegensatz zu Google Glasses, das bereits nach zwei Jahren eingestellt wurde, ist Googles Behauptung „Android XR ist die Android-Plattform der Gemini-Ära“ jedoch keine Übertreibung, wenn die auf der I/O-Konferenz vorgestellten Funktionen vollständig in Massenprodukten implementiert werden können. Android XR wird höchstwahrscheinlich zum Maßstab für alle zukünftigen Extended-Reality-Produkte (Extended Reality, einschließlich Virtual Reality VR, Augmented Reality AR und Mixed Reality MR) werden, genau wie Android für Mobiltelefone.

Seit der Eröffnungsfeier der Google I/O hatten immer mehr Medien die Möglichkeit, Project Aura kennenzulernen, und die Umrisse des gesamten Produkts wurden allmählich deutlicher. Anders als bei Apple Vision Pro ist die Brille bei Project Aura lediglich ein Medium zur Interaktion mit dem Nutzer. Die Berechnung und Vernetzung des Gemini Live-Modells erfolgt weiterhin auf dem Mobiltelefon, was in gewissem Maße viel Raum für zukünftige Modell- und Funktionserweiterungen lässt.

Darüber hinaus gibt es noch eine weitere gute Nachricht: Mit Android XR führt Google die bewährte Tradition der Nexus-Smartphones fort und ist offen für die Zusammenarbeit mit zahlreichen Drittanbietern. So sind beispielsweise alle Project Aura-Brillen, die aktuell für Technologiedemonstrationen verwendet werden, das Ergebnis einer Kooperation zwischen Google und Xreal. Später kündigte Google eine Zusammenarbeit mit Gentle Monster, einer Jugendmodemarke von Essilor, und Warby Parker, einer weiteren aufstrebenden Brillenmarke mit Fokus auf dem O2O-Konzept, an, um Android XR als Modeprodukt auf den Markt zu bringen.

Gemessen an der Bilanz, dass sich Meta Rayban im Jahr 2024 in einem Jahr über eine Million Mal verkauft hat, ist Googles Weg, „den Fluss zu überqueren, indem man sich mit Meta vortastet“, zweifellos sehr vielversprechend.

OpenAI: Auf dem Weg der Erkundung: KI-Schmuck in den Alltag integrieren

Noch faszinierender ist, dass kurz bevor Insider die Neuigkeit verbreiteten, Apple werde Smart Glasses auf den Markt bringen, Sam Altman, CEO von OpenAI, dem Riesen für künstliche Intelligenz hinter ChatGPT, gerade die Übernahme eines Startups namens io Products für 6,5 Milliarden Dollar bekannt gab – das Unternehmen, das Altman gemeinsam mit Jonathan Ive, dem iPhone-Designer, der Apple verlassen hatte, gegründet hatte.

Auf der offiziellen Website von OpenAI gaben Altman und Ive in einem gemeinsamen Brief bekannt, dass nach der Übernahme von io Products mehrere Mitbegründer und Ingenieure von io in OpenAI integriert werden. Ive und das zuvor von ihm gegründete Designunternehmen LoveFrom werden weiterhin unabhängig voneinander arbeiten, aber „die tiefgreifende Design- und Kreativarbeit von OpenAI und io übernehmen“.

OpenAI war bisher jedoch ein reines Softwareunternehmen. Warum investierte Altman so viel Geld, um Ive zum Beitritt zu bewegen? Laut Ming-Chi Kuo, einem renommierten Analysten bei Tianfeng International, besteht der Zweck der Kooperation zwischen OpenAI und Ive darin, eine „neue Form von KI-Hardware“ für KI-Software bereitzustellen. Diese Hardware, die KI unterstützt, unterscheidet sich vom herkömmlichen Konzept. Es handelt sich nicht um ein Gerät wie die uns bekannten Mobiltelefone oder Lautsprecher, sondern „das Design ist so klein und elegant wie ein iPod Shuffle“.

Guo Mingchi spekuliert, dass die OpenAI-Hardware mit einer Kamera und einem Mikrofon zur Umgebungswahrnehmung ausgestattet sein wird, jedoch keine Anzeigefunktion besitzt. Zudem muss sie möglicherweise an Geräte wie Mobiltelefone oder PCs angeschlossen werden, um die Anzeigefunktion und Rechenleistung von Mobiltelefonen oder Computern zu nutzen. Guo Mingchi spekuliert, dass dieses Produkt mit neuem Formfaktor unter anderem um den Hals getragen werden könnte, ähnlich wie das von Limitless (ehemals Rewind) eingeführte KI-Aufzeichnungsgerät Pendant:

Eine Möglichkeit, den Limitless-Anhänger zu tragen

Dies ist eine sehr interessante Produktform. Bei genauerem Hinsehen stellt man fest, dass es viele intelligente Geräte gibt, die wir täglich am Körper tragen, wie Uhren, Armbänder, Kopfhörer und sogar Ringe. Halsketten sind jedoch ein Bereich, in dem sich nur wenige Hersteller engagieren. Dem aktuellen Trend nach zu urteilen, ist das ultimative Ziel aller KI-Produkte die Interaktion mit der realen Welt. Heute mag es sich um ein traditionelles tragbares Gerät wie eine Uhr oder Brille handeln, doch in Zukunft könnte es ein Anhänger sein, den man nie mehr ablegen kann.

Ähnliche Konzepte sind nicht neu. Vor etwas mehr als einem Jahr erlebte der Markt für brandneue „tragbare KI-Geräte“ eine kurze Blütezeit. Damals erhielten Humane AI Pin, Rabbit R1 und Limitless Pendant viel Aufmerksamkeit und Ressourcen. Das Produktkonzept, Hardware speziell für KI zu entwickeln, wurde am Markt allgemein anerkannt:

Die Realität sieht jedoch düster aus. Intelligente Modelle, die den Anforderungen des täglichen Gebrauchs gerecht werden, lassen sich derzeit nur schwer in Geräte integrieren, die kleiner als Mobiltelefone sind. Unabhängig von der Produktform benötigt jedes Gerät Mikrofone, Lautsprecher, Kameras und weitere Hardware, um mit der realen Welt zu interagieren. Auch das neue Gerät, das OpenAI dieses Mal entwickeln möchte, bleibt dem Prinzip treu, für Berechnungen eine Verbindung zu einem vorhandenen Gerät herstellen zu müssen. Man kann kaum vom legendären „iPhone-Moment der KI-Produkte“ sprechen.

Bisher verfügen wir über unzählige Fenster, durch die wir mit KI interagieren können: intelligente Assistenten auf Mobiltelefonen, intelligente Brillen, Suchmaschinen, intelligente Lautsprecher, tragbare Geräte, unabhängige KI-Anhänger und der von OpenAI erdachte „KI-Schmuck“ – die künstliche Intelligenz, die ursprünglich nur eine Codefolge auf der Festplatte war, erhält Stück für Stück einen physischen Körper und die Verbindung zwischen dem Code und der Realität wird immer enger.

Obwohl die Produkte in unterschiedlichen Formen erhältlich sind, bleibt eines konstant: Die Hersteller arbeiten hart daran, immer mehr Sensoren am Körper anzubringen. Dies ist auch eine Frage, über die wir in dieser „Vor-KI-Ära“ nachdenken müssen: Wie können wir mit künstlicher Intelligenz koexistieren?

Egal, welche dieser bizarren Produktformen Sie bevorzugen, die Privatsphäre wird in Zukunft wertvoller sein als je zuvor.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von iFanr: iFanr (WeChat-ID: ifanr), wo Ihnen so bald wie möglich weitere spannende Inhalte präsentiert werden.