Intels Core Ultra der ersten Generation wird offiziell veröffentlicht. Er bildet die Grundlage für KI-PCs und ist in der Lage, große KI-Modelle ohne Netzwerk auszuführen

Wenn wir KI-Tools verwenden, die von großen Sprachmodellen wie ChatGPT, Wenxinyiyan und Tongyi Qianwen unterstützt werden, gibt es eine notwendige Bedingung: Das Internet muss verbunden sein.

Denn die Berechnung von KI-Tools erfolgt in der Cloud und nicht lokal auf dem Computer. Aus Sicht der vorgelagerten Chiphersteller und Terminalhersteller sind große Modelle in einer vernetzten Umgebung jedoch leistungsstark, müssen aber auch durch große endseitige Modelle ergänzt werden, die ohne Netzwerk laufen können. Die Kombination aus Ende und Cloud ist die perfekte Lösung.

Bei der offiziellen Einführungsveranstaltung der ersten Core Ultra-Generation von Intel am 15. Dezember sahen wir, dass das große Modell von Alibaba Cloud Tongyi Qianwen erfolgreich an die Intel Core Ultra-Plattform angepasst wurde und in Zukunft auf PCs und anderen Geräten eingesetzt werden kann.

Dank der Core Ultra-Plattform der ersten Generation (Codename Meteor Lake) verfügt Intel über die bedeutendste Änderung der Prozessorarchitektur seit 40 Jahren, nämlich eine separate Modularchitektur und die erste integrierte neuronale Netzwerkverarbeitungseinheit (NPU), die auf Intel Core eingesetzt wird Ultra-Plattform-Geräte Das große Tongyi Qianwen-Modell im Internet kann die Reaktionszeit der Modellinferenz mit einer durchschnittlichen Beschleunigung um das Dreifache erheblich verkürzen.

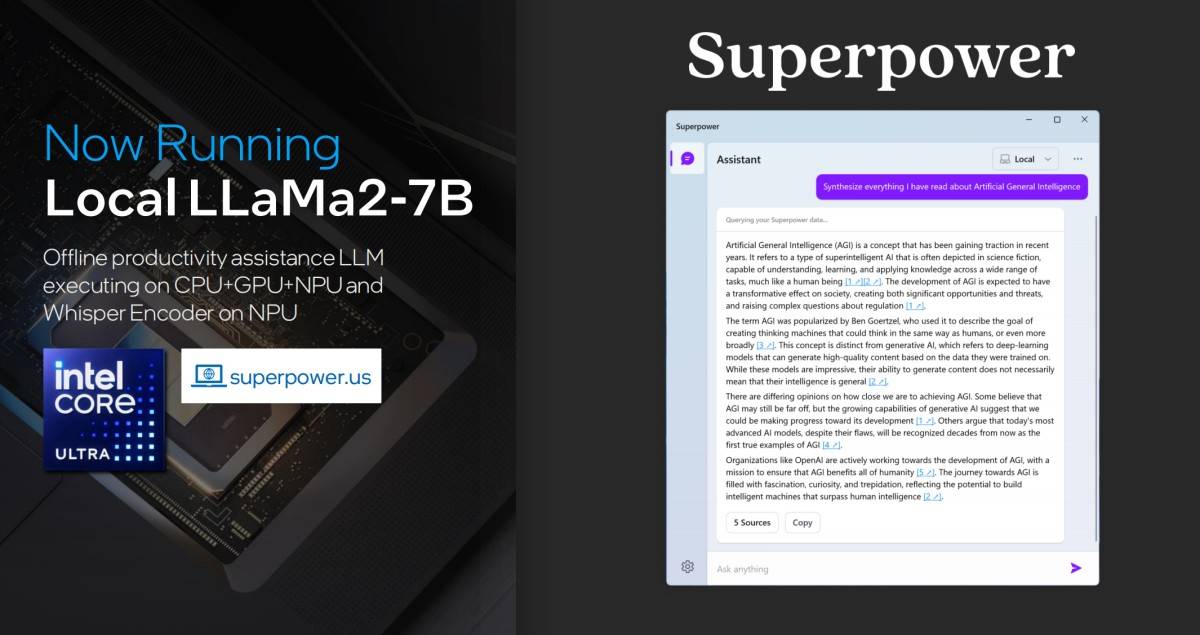

Darüber hinaus hat Intel zuvor auch die gute Leistung des großen Modells LLaMa2-7B von Meta im geräteseitigen Betrieb ohne Netzwerk getestet. Durch die schrittweise Implementierung des großen Modells auf der Geräteseite ist das Konzept des AI-PCs klar geworden .

Seit der Veröffentlichung von ChatGPT Ende letzten Jahres haben AIGC-Anwendungen, die von der Technologie großer Sprachmodelle unterstützt werden, eine große Entwicklung erreicht. Die Hauptposition dieser KI-Welle liegt auf dem PC, da der PC in Bezug auf Interaktion und Präsentation für die meisten Benutzer besser geeignet ist . AIGC-Anwendungen, egal ob ChatGPT oder MidJourney, müssen mit dem Internet verbunden sein. Sobald kein Netzwerk vorhanden ist, werden wir von AI getrennt.

Wenn sich ein PC also wirklich zu einem KI-PC entwickeln möchte, müssen nicht nur AIGC-Anwendungen problemlos darauf ausgeführt werden können, sondern er selbst muss auch über leistungsstarke KI-Verarbeitungsfunktionen verfügen.

Daher hat die Nachricht, dass das große Modell Qwen-7B von Alibaba Cloud Tongyi Qianwen erfolgreich an die Intel Core Ultra-Plattform angepasst wurde und in Zukunft auf PCs und anderen Terminals eingesetzt werden kann, zwei Bedeutungen und eine symbolische Bedeutung.

Die erste Bedeutungsebene lautet: Worauf verlässt sich Intel, wenn es den AI-PC-Slogan ruft?

Auf der Technology Innovation Conference im September dieses Jahres im Silicon Valley stellte Intel-CEO Pat Gelsinger das revolutionäre Konzept des PC-AI-PCs vor.

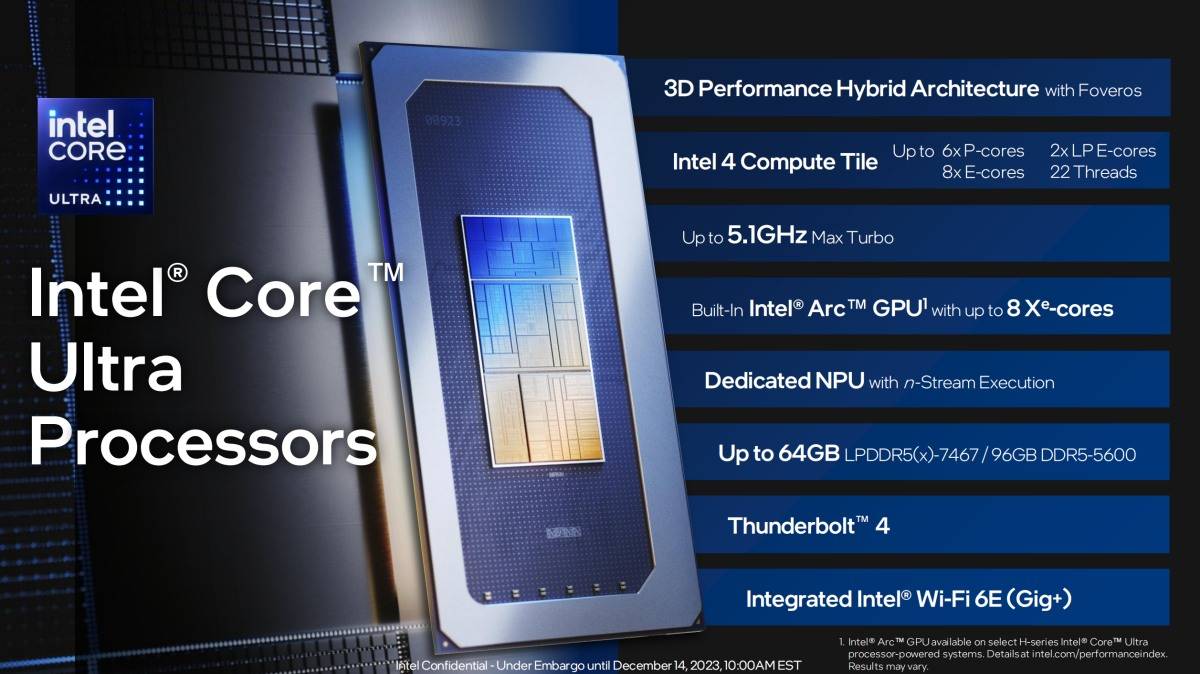

Wenn Sie KI-Berechnungen effizient durchführen und KI-Anwendungen auf einem PC ausführen möchten, ist die herkömmliche CPU+GPU-Architektur nicht die optimale Lösung. Daher hat Intel auf der Core-Ultra-Plattform der ersten Generation innovativ eine getrennte Modularchitektur eingeführt, was auch der Fall ist Die Geschichte von Intel ist die größte Prozessorstrukturänderung der Welt. Der Prozessor wird aus vier unabhängigen Modulen bestehen: Rechenmodul, SoC-Modul, Grafikmodul und E/A-Modul, und über die 3D-Verpackungstechnologie von Foveros verbunden:

Rechenmodul (Compute Tile): übernimmt die neueste Generation der Energieeffizienz-Kern- und Leistungskern-Mikroarchitektur sowie erweiterte Funktionen. Dieses Modul nutzt die Intel 4-Prozesstechnologie der neuen Generation und hat erhebliche Fortschritte beim Energieverbrauchsverhältnis erzielt.

SoC-Modul (SoC Tile): Das innovative Inseldesign mit geringem Stromverbrauch (Low Power Island) integriert eine neuronale Netzwerkverarbeitungseinheit (NPU), bringt energieeffiziente KI-Funktionsleistung auf den PC und ist mit standardisierten Programmschnittstellen wie OpenVINO kompatibel. Erleichtern die Entwicklung und Popularisierung von KI-Anwendungen. Der neue stromsparende Energieeffizienzkern optimiert das Gleichgewicht zwischen Energieeinsparung und Leistung weiter. Das SoC-Modul integriert außerdem einen Speichercontroller, eine Medien-Codec-Verarbeitung und eine Anzeigeeinheit und unterstützt 8K HDR- und AV1-Codecs sowie die Standards HDMI 2.1 und Display Port 2.1. Auch Wi-Fi und Bluetooth werden unterstützt, darunter Wi-Fi 6E.

Grafikmodul (GPU Tile): Dieser Prozessor integriert die Intel Sharp-Grafikarchitektur, die in der integrierten Grafikkarte unabhängige Leistung auf Grafikkartenebene bereitstellen kann und Raytracing und Intel XeSS unterstützt. Mit einem Sprung in den Grafikfunktionen und einer verbesserten Energieeffizienz liefert Meteor Lake eine hervorragende Leistung pro Watt.

IO-Modul (IO Tile): Bietet hervorragende Konnektivität und integriert Thunderbolt 4 und PCIe Gen 5.0.

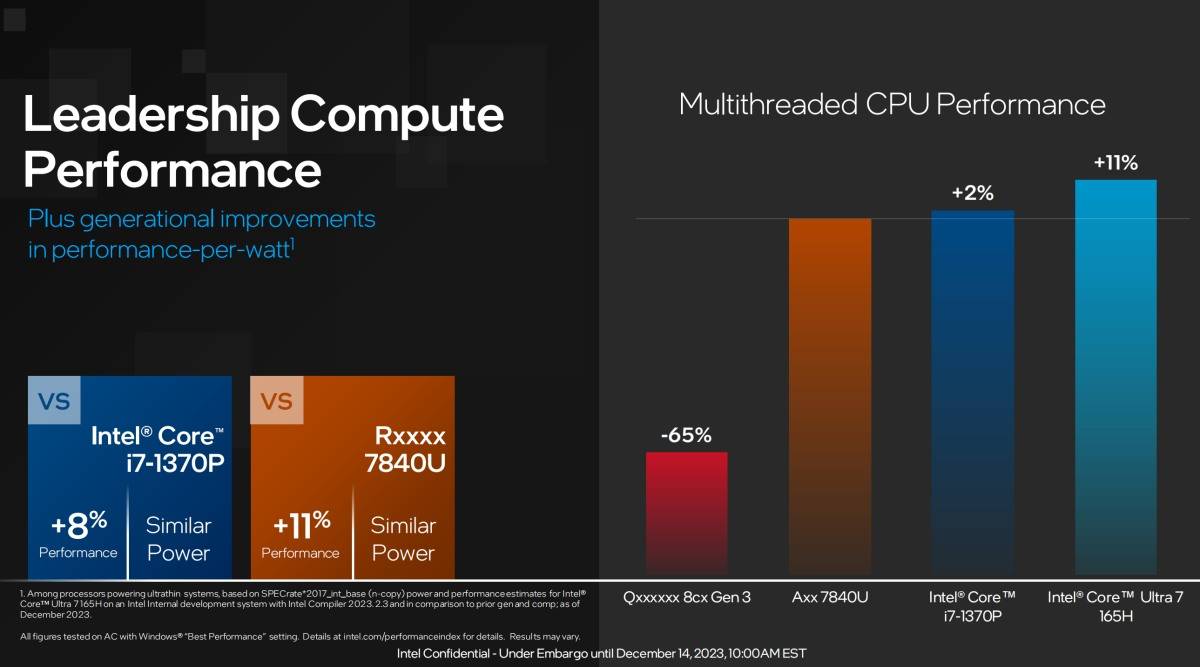

Am Beispiel des Core Ultra 7 165H-Prozessors (TDP 28 W) gab Intel an, dass seine Multi-Thread-Leistung mehr als dreimal so hoch ist wie die des Qualcomm Snapdragon 8cx Gen 3 und 1,11-mal so hoch wie die seines direkten Konkurrenten AMD 7840U.

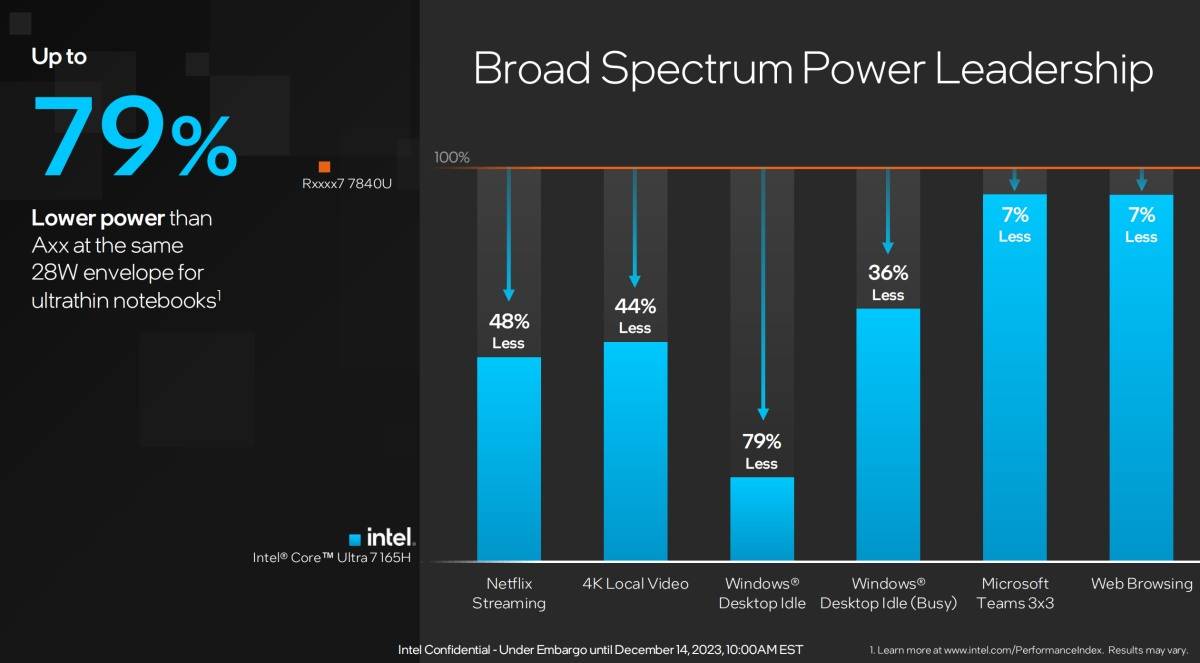

Gleichzeitig sagte Intel, dass bei besserer Multi-Threading-Leistung auch die Energieeffizienz des Core Ultra 7 165H in verschiedenen Szenarien besser sei als die des AMD 7840U.

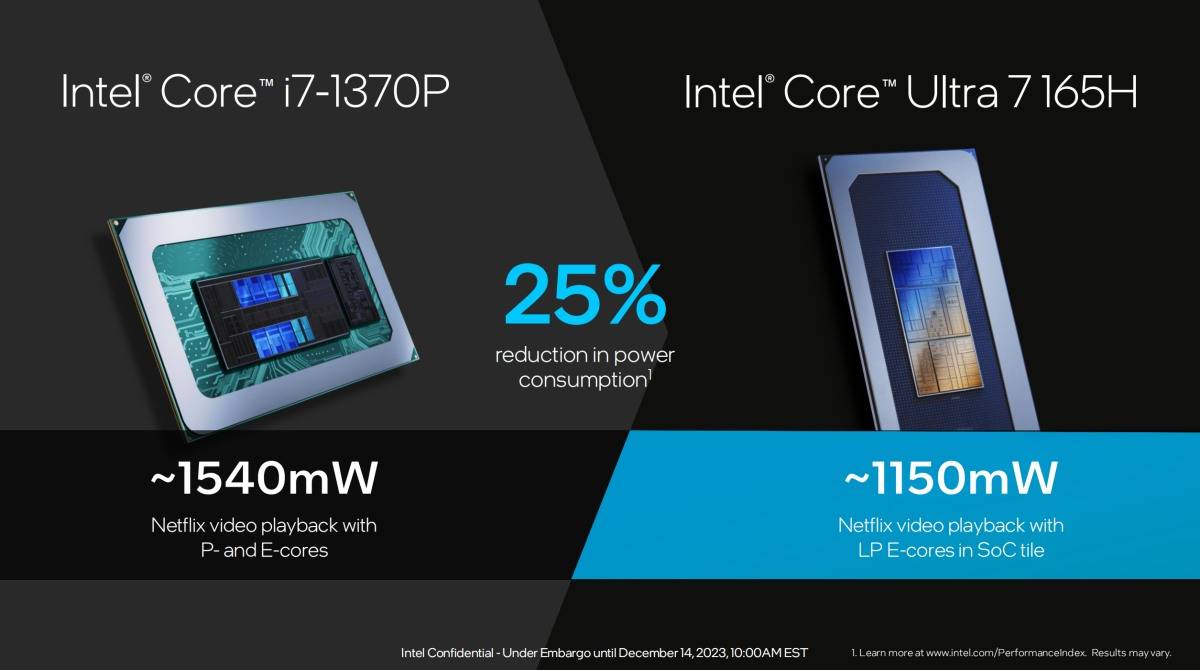

Darüber hinaus stellt die Insel mit geringem Stromverbrauch ein sehr interessantes Design dar. Sie verfügt über zwei LPE-Cores-Kerne mit extrem geringem Stromverbrauch, die Aufgaben ausführen können, die keine Reaktionsgeschwindigkeit erfordern, wie z. B. Online-Wiedergabe usw., wodurch der Stromverbrauch weiter gesenkt wird . Das Interessante an diesem Design ist, dass sich diese beiden Ultra-Low-Power-Kerne im SoC-Modul und nicht im Rechenmodul befinden.

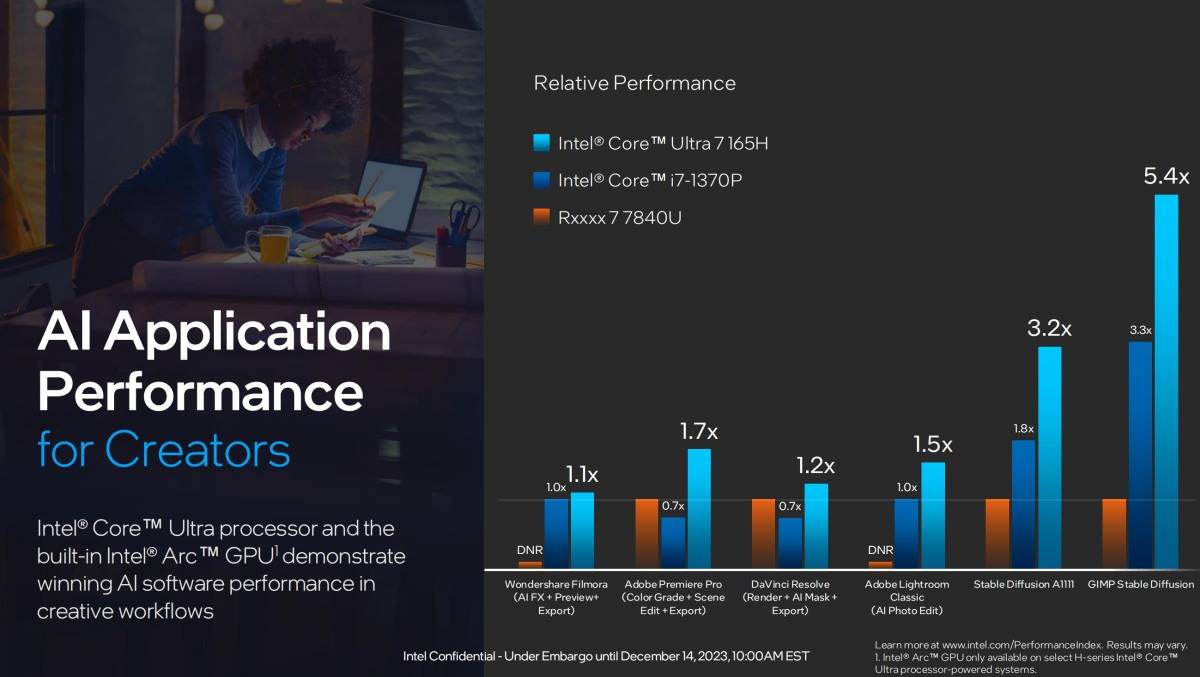

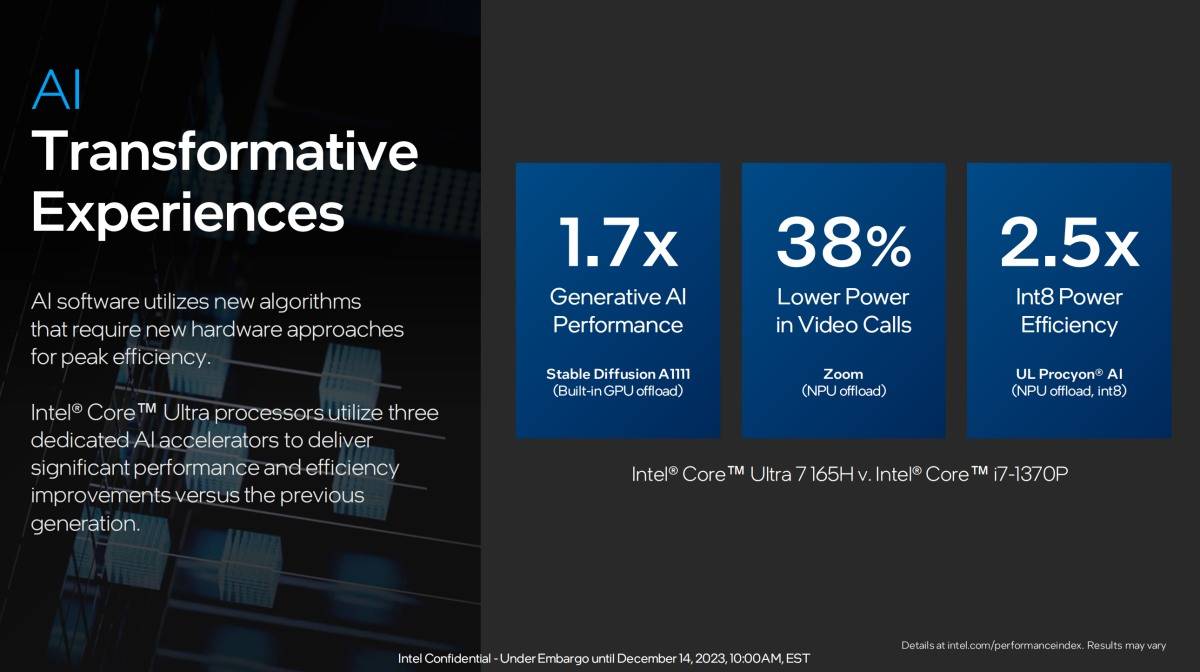

Das wichtigste und bedeutendste Update ist natürlich, dass das neue NPU-Modul hauptsächlich für die KI-Berechnung verantwortlich sein wird. Da es sich um eine spezielle Recheneinheit zur Beschleunigung der künstlichen Intelligenz handelt, liegt der Vorteil von NPU-Modellen bei der KI-Berechnung in hoher Leistung und geringem Stromverbrauch . Darüber hinaus werden CPUs mit geringer Latenz und hoher Reaktionsfähigkeit sowie leistungsstarke GPUs mit hohem Durchsatz auch die Nachfrage nach KI-Rechenleistung tragen. Die Zusammenarbeit der drei bildet eine leistungsstarke KI-Rechenleistung auf dem Terminal.

Immer noch im Vergleich zum benachbarten AMD 7840U-Prozessor sagte Intel, dass die gesamte KI-Rechenleistung des Core Ultra 7 165H nicht nur sein Produkt der vorherigen Generation, den Core i7-1370P, übertrifft, sondern auch den AMD 7840U übertrifft.

Um ein Beispiel für die praktische Anwendung zu geben: Intel und das Videobearbeitungstool Jianying von ByteDance arbeiteten zusammen, um die von Benutzern häufig verwendete „Smart Keying“-Funktion zu optimieren, und stellten die Rechenanforderungen dieser Funktion auf die Core Ultra-Produkte der ersten Generation um. Nach NPU Wir haben festgestellt, dass die Verarbeitung von Videomaterial nicht nur weniger Zeit in Anspruch nimmt, sondern auch den Stromverbrauch senkt. Zu diesem Zeitpunkt kann die freie CPU- und GPU-Rechenleistung für andere Bearbeitungsanforderungen genutzt werden.

Daher kann der sogenannte KI-PC nicht nur KI-Funktionen besser ausführen, sondern auch die Effizienz verbessern und den Stromverbrauch senken.

Die zweite Bedeutung ist: Was kann ein großes Model wie Tongyi Qianwen leisten?

Jetzt können wir eine Vielzahl von KI-Operationen auf dem PC ausführen, einschließlich, aber nicht beschränkt auf Wenshengwen, Wenshengtu, Wenshengmusic, sowie KI-Ausschnitt, Gestenerkennung, Bewegungserfassung und im Detail KI-Synchronisation und Sprachänderung sowie Videokonferenzen. Augenkorrektur usw.

Bei einigen davon handelt es sich um völlig neue Erlebnisse, die auf großen Sprachmodellen basieren, und bei anderen handelt es sich bereits seit langem um PCs. Beispielsweise war der Core der 10. Generation der erste, der KI-Leistungsunterstützung einführte, die eine automatische Bildverbesserung und Videoverbesserung ermöglichen kann Auflösungsverbesserung für PCs, intelligente Rauschunterdrückung und andere KI-Funktionen.

Die Technologie großer Sprachmodelle gilt als Weg zur allgemeinen künstlichen Intelligenz (AGI, Artificial General Intelligence). AGI bezieht sich auf ein künstliches Intelligenzsystem mit einem breiten Spektrum an Intelligenzniveaus und Fähigkeiten, die denen des Menschen ähneln. Im Vergleich dazu sind derzeit große Sprachmodelle am meisten KI-Systeme konzentrieren sich auf eine bestimmte Aufgabe oder Domäne.

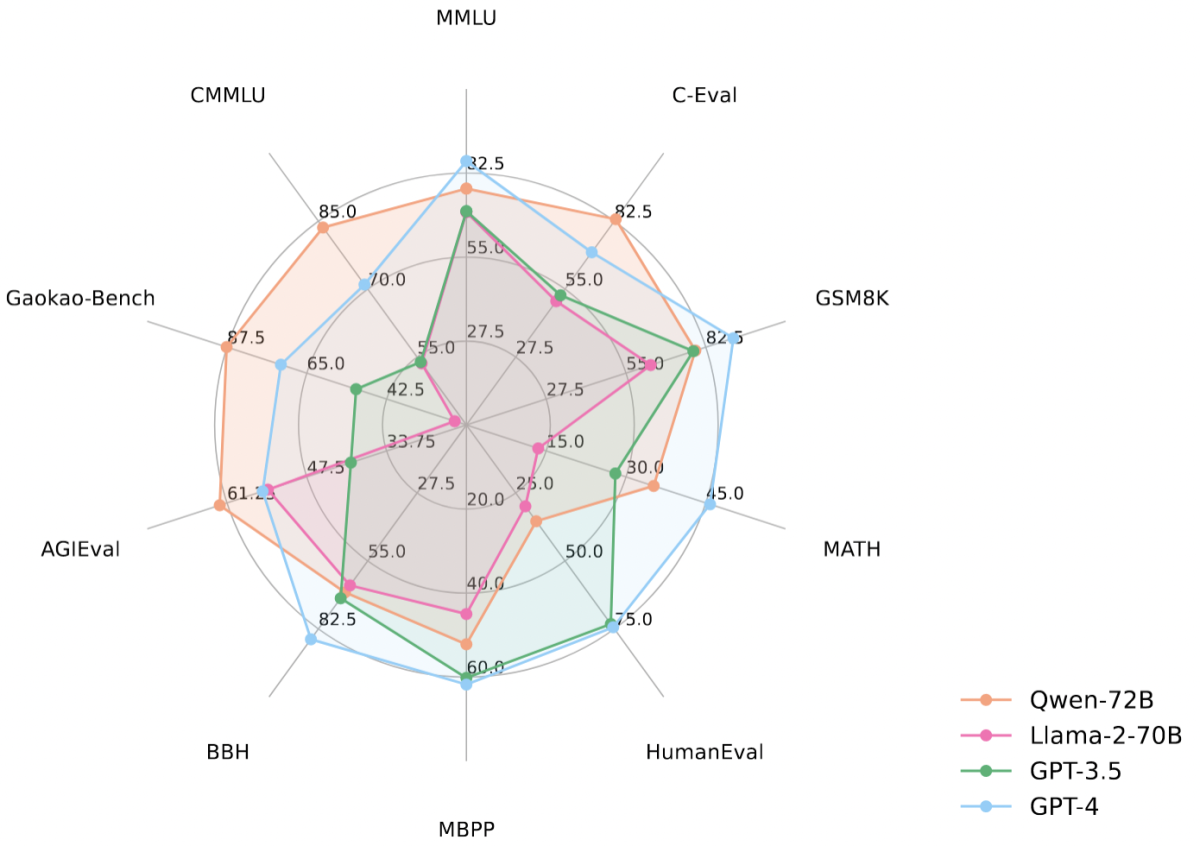

Unter dieser Prämisse kann das neue Open-Source-Modell Tongyi Qianwen mit 72 Milliarden Parametern (Qwen-72B) von Alibaba Cloud derzeit als das leistungsstärkste Open-Source-Großmodell bezeichnet werden. Qwen-72B hat in 10 maßgeblichen Benchmark-Bewertungen die besten Ergebnisse unter den Open-Source-Modellen erzielt Die Leistung übertrifft den Open-Source-Benchmark Llama 2-70B und die meisten kommerziellen Closed-Source-Modelle und verfügt bereits über bestimmte allgemeine Fähigkeiten.

Basierend auf den Open-Source-Modellen Qwen-72B, Qwen-14B, Qwen-7B und Qwen-1.8B von Alibaba Cloud sowie dem großen visuellen Verständnismodell Qwen-VL und dem großen Audioverständnismodell Qwen-Audio, Alibaba Cloud hat „volle Größe, volle Modalität“ als Open Source erreicht.

Dies bedeutet, dass Entwickler aus allen Gesellschaftsschichten bei diesen Open-Source-Großmodellen aus einer Vielzahl von Paketen wählen können, darunter PCs, Mobiltelefone und sogar IoT-Geräte, die mit den Geräten nicht vertraut sind.

Das große Modell von Tongyi Qianwen wird auf der Intel Core Ultra-Plattform eingesetzt und ist eine der Möglichkeiten, dass es in Zukunft auf Terminals wie PCs eingesetzt werden kann.

Darüber hinaus hat das XD Lab-Team der East China University of Science and Technology eine Reihe großer Branchenmodelle entwickelt, die auf den Open-Source-Modellen Qwen-7B und Qwen-14B von Tongyi Qianwen basieren, darunter das große Modell für psychische Gesundheit MindChat (Man Tan). , das große medizinische Gesundheitsmodell Sunsimiao (Sun Simiao) und das Bildungsmodell /Exam großes Modell GradChat (Koi) und so weiter.

Zhejiang University and Higher Education Press hat das vertikale Bildungsmodell Zhihai-Sanle auf Basis von Qwen-7B entwickelt. Es wurde an 12 Universitäten im ganzen Land angewendet und kann intelligente Fragen und Antworten, Testfragengenerierung, Lernnavigation, Lehrbewertung und andere Funktionen bereitstellen . Das Modell wurde in Alibaba verwendet. Die Yunlingji-Plattform bietet externe Dienste, die mit einer Codezeile aufgerufen werden können.

Zhejiang Youlu Robot Technology Co., Ltd. hat sich von der Bit-Welt gelöst und Qwen-7B in die reale Welt in den Straßenreinigungsroboter integriert, sodass der Roboter in Echtzeit mit Benutzern in natürlicher Sprache interagieren und die gestellten Anforderungen verstehen kann Weiterleiten durch Benutzer und Ausführen der übergeordneten Anweisungen des Benutzers. Analysieren und demontieren, logische Analyse und Aufgabenplanung auf hoher Ebene durchführen und Reinigungsaufgaben abschließen.

Kurz gesagt: In der KI-Phase geht es nicht nur um PCs, und bei PCs geht es nicht nur um KI-Anwendungen, sondern es beginnen sich große Überschneidungen zu ergeben, die zu Szenarien führen, die unsere PC-Nutzungsgewohnheiten verändern werden.

Sollten Sie beim Zeichnen ein digitales Tablet und einen druckempfindlichen Stift verwenden oder eine vinzentinische Zeichnung verwenden?

Benutzen Sie beim Schreiben eine Tastatur, um Wörter einzeln einzugeben, oder schreiben Sie auf Chinesisch?

Diese Probleme sind bereits aufgetreten und jeder Benutzer mit einem KI-PC wird nach und nach mit veränderten Auswahlmöglichkeiten und Nutzungsgewohnheiten konfrontiert sein.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner: aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo