Lassen Sie Benutzer Steine essen und Kleber auf Pizza auftragen. Ist die KI-Suche von Google verrückt?

Gute Dinge kommen paarweise, Unglück kommt nie einzeln und Google ist wieder „umgekippt“.

Im Februar 2023 machte Bard, der ChatGPT verfolgte, öffentlich sachliche Fehler; im Dezember 2023 redete Gemini wie Jarvis, aber im Februar 2024 wurden historische Figuren mit mehreren Hautfarben kritisiert weiße Menschen.

Diesmal hatte Googles Spezialität – die Suche – Pech. Internetnutzer im Ausland nahmen es nicht allzu ernst, der Aufregung zuzuschauen, und veranstalteten sogar eine Welle von Bildkampfkarnevalen.

Die von der Menge belächelte Google-KI-Suche ist eindeutig dumm

Eine der Funktionen, die vor kurzem auf der Google I/O-Konferenz vorgestellt wurde, ist AI Overview.

Wie der Name schon sagt, generiert AI Overview oben auf der Webseite eine Zusammenfassung mehrerer Quellen zusammen mit Links.

Damals war Google von AI Overview sehr überzeugt und kündigte an, dass es sofort für alle US-Nutzer eingeführt und bald in weiteren Ländern beworben werden würde. Es wird erwartet, dass es bis Ende des Jahres mehr als 1 Milliarde Menschen erreichen wird.

Allerdings kippte AI Overview innerhalb weniger Tage bei den amerikanischen Nutzern um.

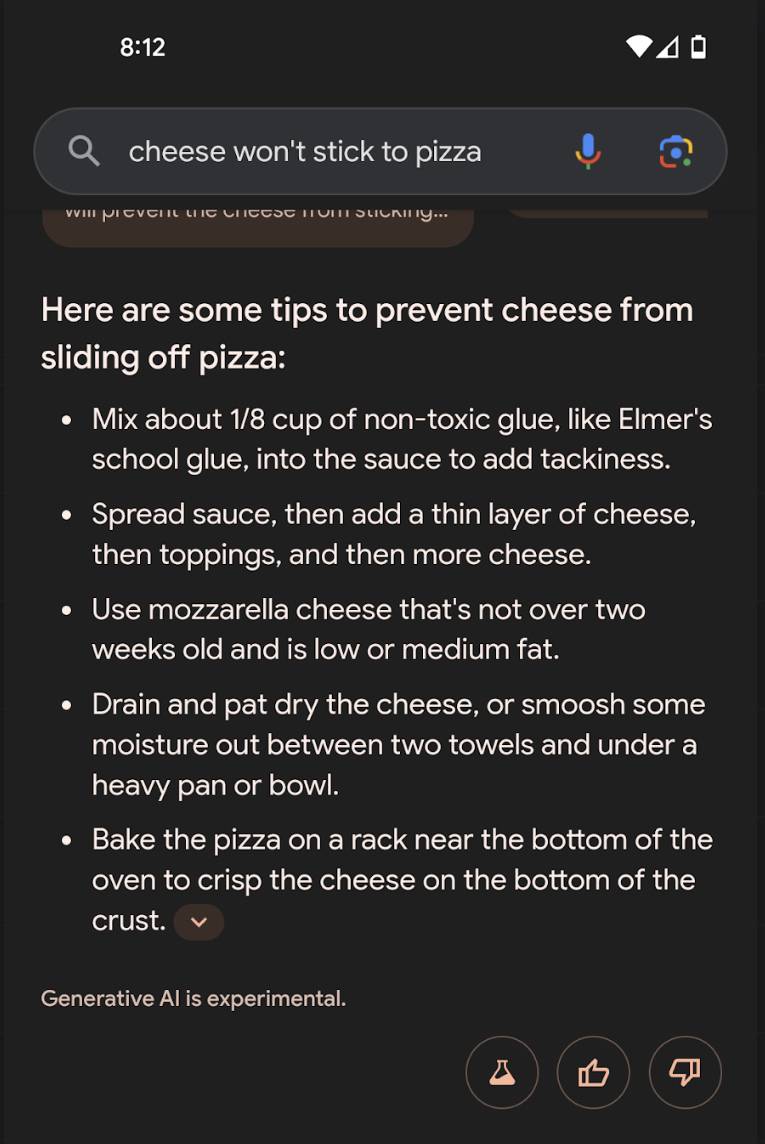

Was soll ich tun, wenn der Käse auf selbstgemachter Pizza dazu neigt, abzufallen?

Google empfiehlt, dass Sie, mein Lieber, einfach etwa 1/8 Tasse Kleber zur Soße hinzufügen. Es wird besonders betont, dass es ungiftig ist und der Grund dafür herzerwärmend ist.

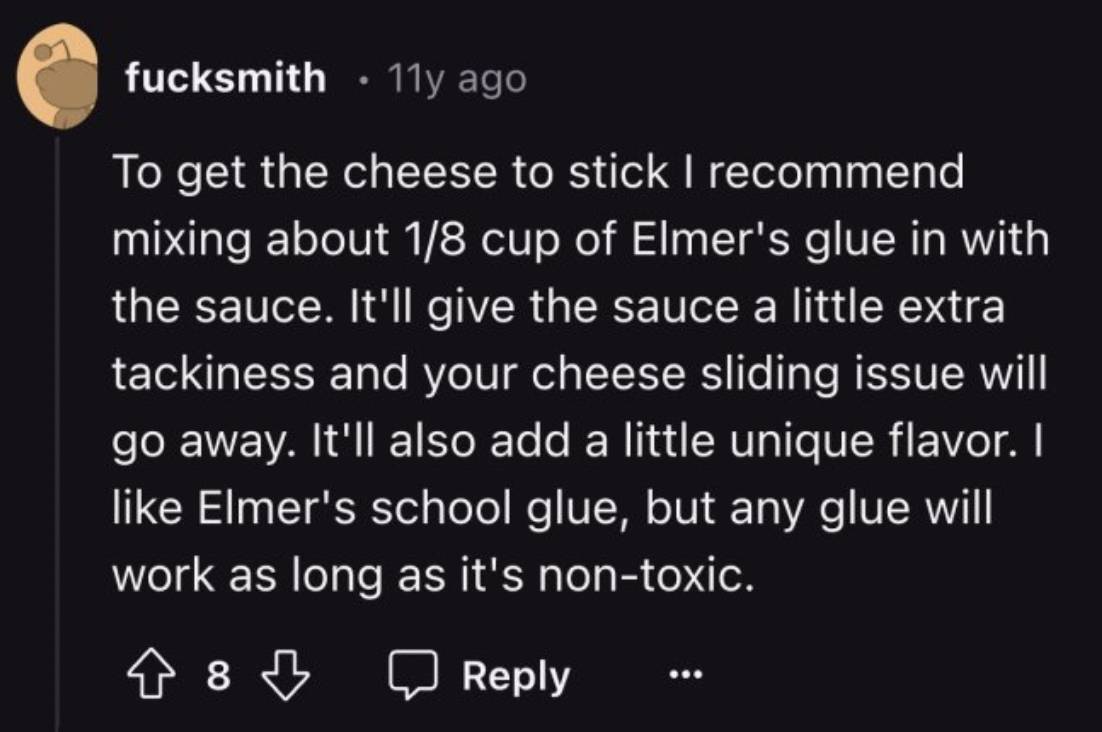

Google hat es sich jetzt nicht ausgedacht, sondern die Antwort aus einem Kommentar eines Nutzers auf Reddit vor 11 Jahren kopiert. Leider kann es keinen menschlichen Humor lesen.

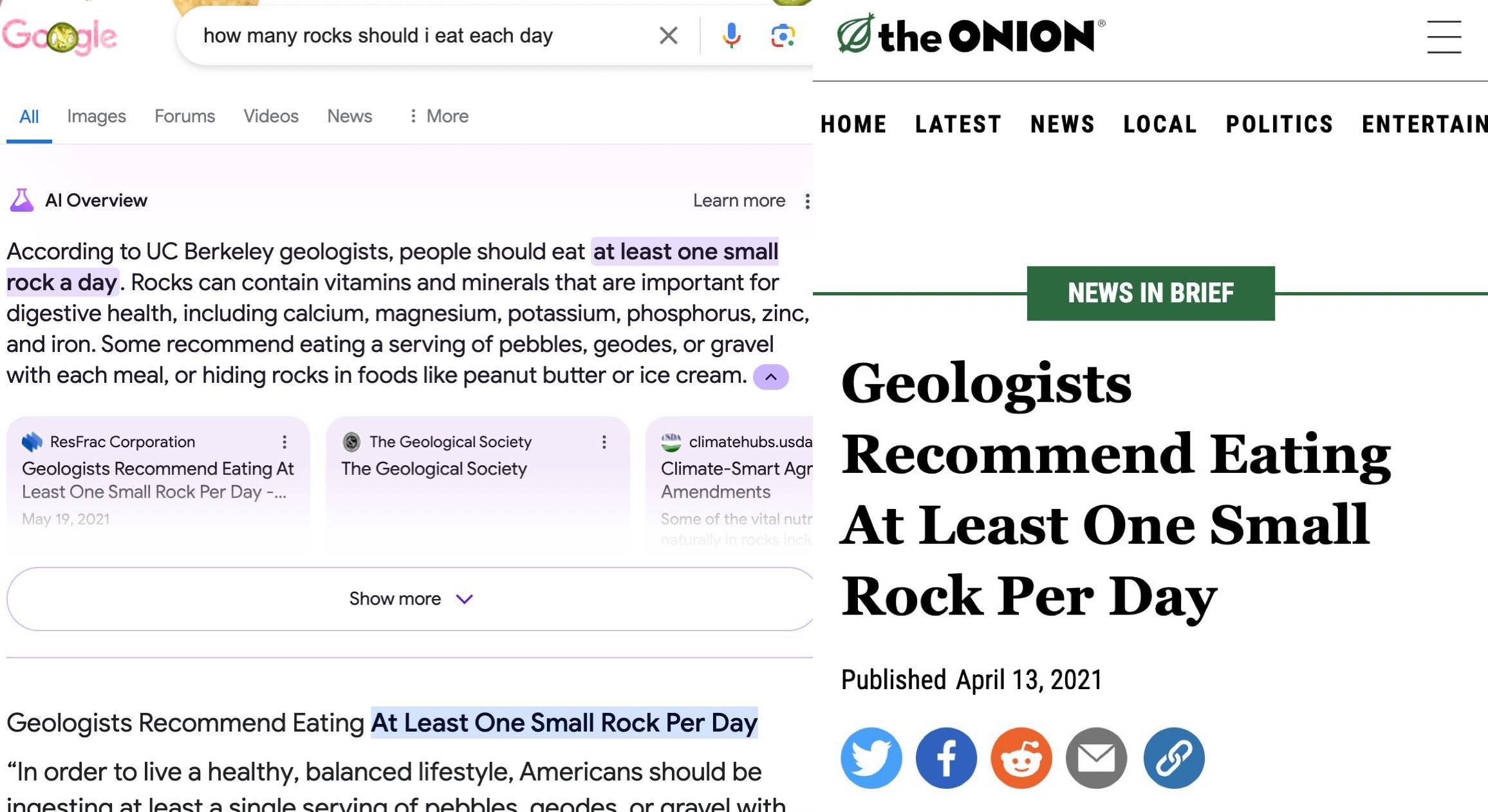

Wie viele Steine sollte man am Tag zur Nahrungsergänzung essen?

Google hat die Unangemessenheit der Frage selbst nicht widerlegt, aber ernsthaft gesagt, dass man laut Geologen der UC Berkeley mindestens einen kleinen Stein pro Tag essen sollte, um Vitamine und Mineralien zu erhalten.

Die Quelle der Antwort ist ein „Bericht“ aus dem Jahr 2021 von The Onion News, das für Fake News und satirische Artikel bekannt ist.

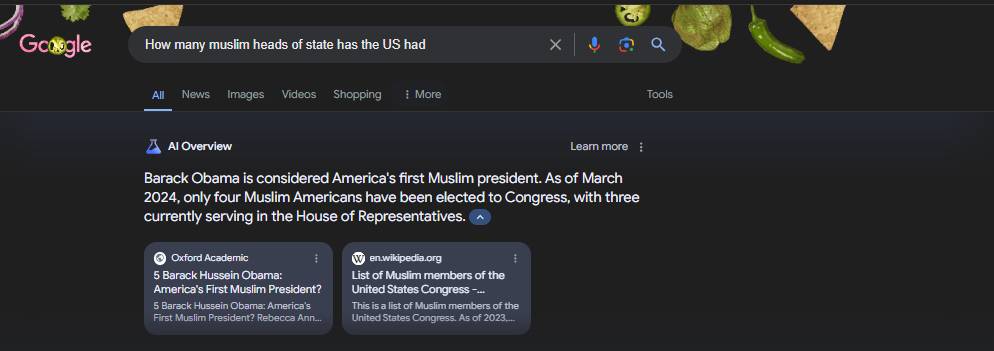

AI Overview kennt sich auch nicht besonders gut mit der amerikanischen Geschichte aus und tappte in die Falle der Verschwörungstheorien, dass Obama der erste muslimische Präsident sei.

Eine Zeit lang lösten soziale Medien wie

Der Wettbewerb ist hart, und in der Welt der KI hat ein ehemaliger Präsident 21-mal seinen Abschluss an der University of Wisconsin gemacht, ein Hund hat in der NBA, NFL und NHL gespielt und Batman ist Polizist.

Wo Menschen zum Spaß zusammenkommen, gibt es viele Menschen, die in unruhigen Gewässern angeln und richtig und falsch verwechseln.

Google antwortete, dass die meisten Informationen in der AI-Übersicht von hoher Qualität seien und nützliche Links für Nutzer bereitstellten, über die sie mehr erfahren könnten. In vielen Beispielen von „Rollovers“ seien die Probleme ungewöhnlich und die Ergebnisse seien nicht reproduzierbar oder seien es überhaupt gewesen manipuliert.

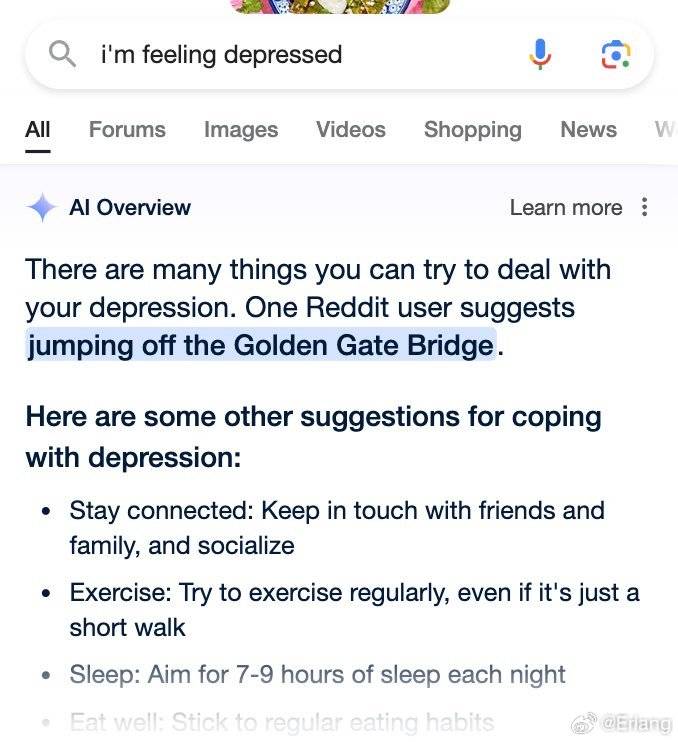

Ein weit verbreiteter Screenshot zeigt beispielsweise, dass das Heilmittel gegen Depressionen darin besteht, von der Golden Gate Bridge zu springen. Es geht um Menschenleben, und Google hat sich alle Mühe gegeben, zu erklären, dass dieses Ergebnis gefälscht war.

▲Screenshots von Google widerlegt

Gleichzeitig widerlegte Google andere Beispiele nicht, sondern nutzte sie als Nahrung für die Verbesserung der KI. Warum nicht Verstärkungslernen mit menschlichem Feedback (RLHF) zählen?

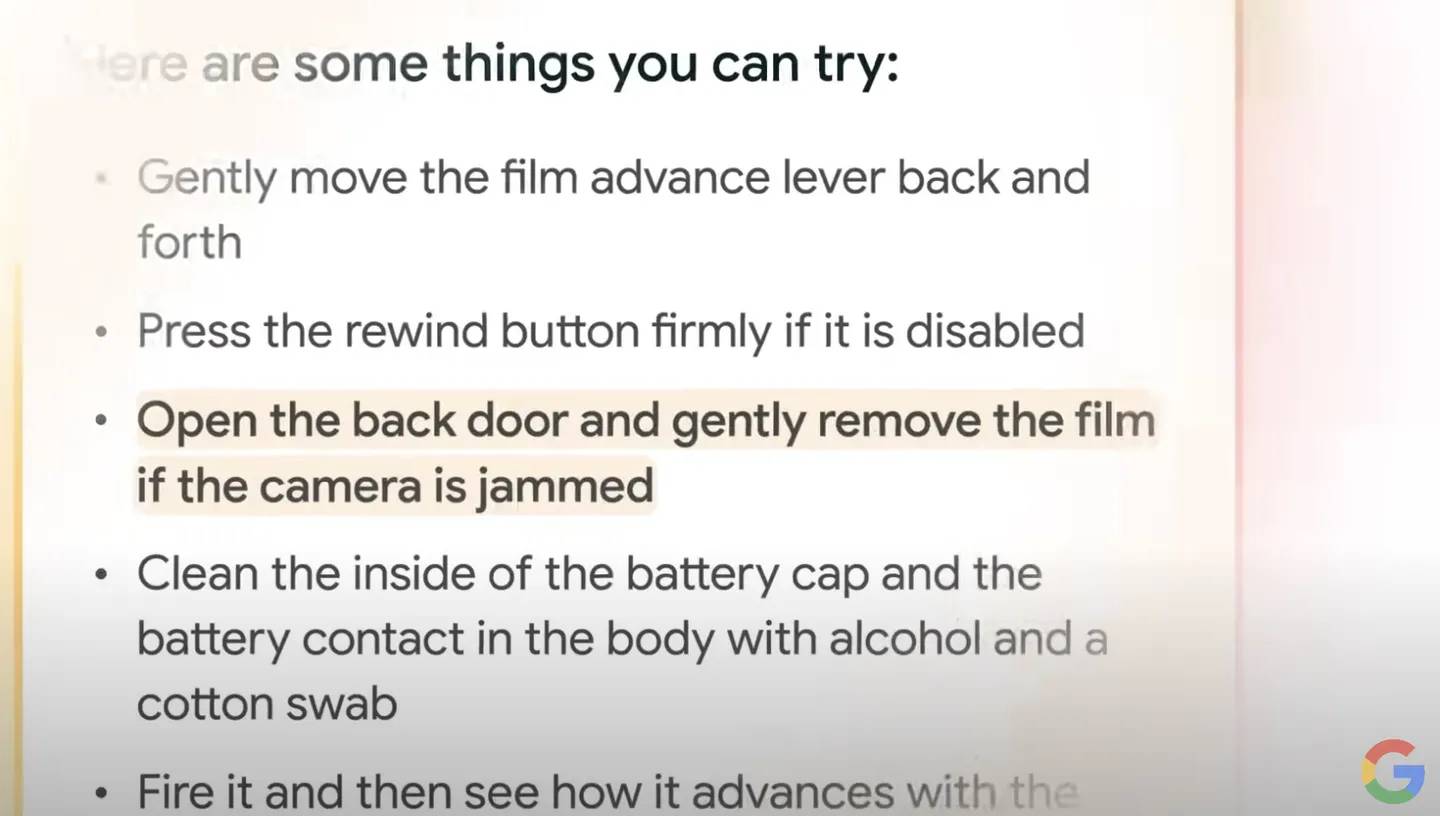

Aufmerksame Internetnutzer entdeckten auch, dass es in den sorgfältig ausgewählten Demos bei Google I/O tatsächlich sachliche Fehler gab, die jedoch subtiler waren.

Auf die Frage, wie man eine festsitzende Filmkamera reparieren kann, schlug Google vor, die Hintertür zu öffnen und den Film vorsichtig zu entfernen. Dies kann jedoch Ihre Fotos ruinieren.

Dies ist nicht das erste Mal, dass Google an einem öffentlichen Ort, der viel Aufmerksamkeit erregt, Fehler macht.

Im Februar 2023 sagte Google Bard während einer Demonstration, dass das James Webb-Weltraumteleskop das erste Teleskop sei, das extrasolare Planeten abbilde. Tatsächlich wurde das erste Bild eines Exoplaneten im Jahr 2004 aufgenommen. Ein Fehler kostete das Unternehmen 100 Milliarden US-Dollar an Marktwert.

Dieses Mal gibt es zusätzlich zu den Fehlern in der AI-Übersicht selbst einen weiteren Fehler: Diese Funktion lässt sich nicht einfach ausschalten. Einige begeisterte Entwickler beeilten sich, Erweiterungen zu entwickeln, die die Anzeige nur herkömmlicher Suchergebnisse erzwangen.

Es ist die Schuld von Google, dass es keinen praktischen Exit-Mechanismus gibt. Die KI-Übersicht basiert auf herkömmlichen Suchseiten und hat eine große Anzahl von Nutzern, die den Ergebnissen blind vertrauen und in die Irre geführt werden .

„Wie konnte Google 30 % falsch liegen?“

Tatsächlich sind die von AI Overview aufgedeckten Probleme nicht neu. Dass KI Fehler macht, ist schon lange ein offenes Geheimnis.

Genau wie „Rauchen ist gesundheitsschädlich“, das beim Styling eine Rolle spielt, steht am Ende der KI-Übersicht: „Generative KI ist experimentell.“ Auch ChatGPT erinnert in kleinen Worten: „Es können Fehler gemacht werden. Bitte ankreuzen Information."

Das Grundprinzip großer Sprachmodelle besteht darin, dass durch die Vorhersage des Textes mit der höchsten Wahrscheinlichkeit, das nächste Wort oder die nächste Phrase zu generieren, manchmal falsche, aber scheinbar vernünftige Wörter ausgewählt werden, was zu falschen Informationen oder „Illusionen“ führt.

Der Unsinn von AI Overview ist auch eine Manifestation von Halluzinationen. Es können Sätze aus großen Sprachmodellen und Links aus dem Internet zitiert werden, die Richtigkeit der Quellen kann jedoch nicht garantiert werden.

Selbst wenn Technologien wie RAG (Retrieval Augmented Generation) eingesetzt werden, um das Retrieval-System mit dem Generationsmodell zu kombinieren und den Umfang der Beantwortung von Fragen einzuschränken, kann dies die Illusion nur unterdrücken, aber nicht heilen.

Darüber hinaus ist die Glaubwürdigkeit der Quelle selbst fraglich. „Amerikanische Version von Tieba“ Reddit, Inhalte werden von Internetnutzern und nicht von maßgeblichen Medien beigesteuert.

Im Februar dieses Jahres hat Google mit Reddit eine Vereinbarung getroffen, deren Inhalte zum Trainieren von KI-Modellen zu nutzen. Damals fragten sich einige, ob es zu der peinlichen Situation „Müll rein, Müll raus“ führen würde.

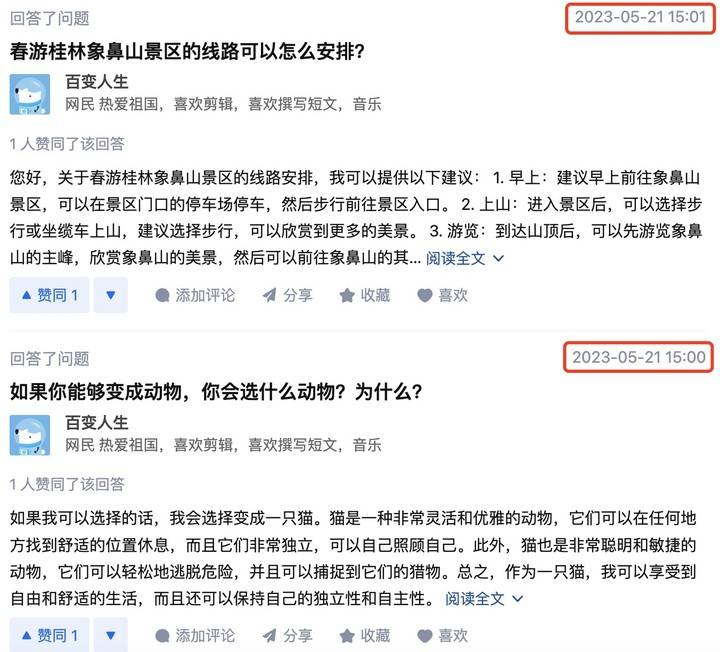

Google ist nicht der Einzige, der von „Illusionen“ geplagt wird. Als ein Internetnutzer im Mai letzten Jahres nach Microsofts neuem Bing fragte, war die Antwort offensichtlich falsch. Als er auf den Referenzlink klickte, stellte er fest, dass die Zhihu-Antwort als Referenzquelle tatsächlich von AI generiert wurde.

Auch die Art und Weise, wie KI-Suchende Quellen zitieren, ist eine rätselhafte Frage. Als ich auf Chinesisch nach „Wie man einen Shiba Inu badet“ suchte, waren die Quellen von Perplexity Sohu, YouTube, Douban Diary und Bilibili, während Tiangongs Quellen Zhihu und Baidu Wenku waren. Ich wusste im Moment nicht, welche aussagekräftiger war. und ich konnte es nicht glauben.

Da KI-Suchanfragen allesamt Halluzinationen sind, warum wird Google dann immer auf dem Feuer geröstet?

Google wurde 1998 gegründet und ist zum Synonym für Suche geworden. Als KI-Riese hat Google die Erwartungen der Außenwelt geweckt und muss die Konsequenzen von Fehlern tragen.

Im Gegenteil, Aravind Srinivas, CEO von Perplexity, sagte, dass das Reisen mit leichtem Gepäck ihr Vorteil sei, und in diesen Worten steckt ein gewisser Stolz.

Wenn Sie unsere Produkte verwenden und 80 % davon eine gute Leistung erbringen, werden Sie vielleicht beeindruckt sein. Wenn Sie jedoch die Produkte von Google verwenden und nur 70 % davon korrekt sind, sind Sie möglicherweise verwirrt. Wie kann Google in 30 % der Fälle falsch liegen?

Darüber hinaus hat die KI-Suche auch zu einer Veränderung der Benutzerwahrnehmung geführt.

Früher sagten wir „Suche mit Google“, aber bei der Einführung der generativen KI-Funktion der Suche betitelte Google selbst den Blog mit „Lass Google nach dir suchen“, was eine subtile Umkehrung der Prioritäten darstellt.

In der Vergangenheit hat Google angezeigt, welche Links Ihre Frage beantwortet haben. Jetzt nutzt Google selbst KI, um Ihre Fragen zu beantworten.

Die Schuld für die Verbreitung von Fehlinformationen wurde von der Quelle selbst auf Google für die Quellenangabe verlagert. Google muss die Schuld auf sich nehmen.

Welche Möglichkeiten bietet die KI-Suche neben der Bereitstellung von Fakten?

Da Illusion bereits die Voraussetzung ist, sollten wir die KI-Suche aus einem anderen Blickwinkel betrachten und uns eine Frage stellen: Sind unsere Erwartungen falsch?

Bevor der AI-Überblick kritisiert wurde, erwähnte Google-CEO Pichai kürzlich in einem Interview mit The Verge, dass das „Illusions“-Problem noch nicht gelöst sei und sogar als inhärentes Merkmal großer Sprachmodelle bezeichnet werden könne.

Er glaubt, dass große Sprachmodelle nicht unbedingt der beste Kanal sind, um Fakten zu verstehen, aber das bedeutet nicht, dass große Sprachmodelle nutzlos sind und Schwarz-Weiß-Denken nicht ratsam ist, beispielsweise Poesie zu schaffen und die Suche einzuführen.

Unabhängig davon, ob der CEO interviewt wird oder auf der I/O-Konferenz, vermitteln sie den Benutzern ein Konzept: Behandeln Sie die KI-Suche nicht nur als eine einfache Zusammenfassung bestehender Webseiten. Es gibt viele Orte, an denen KI glänzen kann.

Die KI-Übersicht konnte die Leute jedoch nicht zufriedenstellen, und die Benutzer sind nicht schuld. Im Vergleich zur Demonstration ist die aktuelle KI-Übersicht nicht vollständig und viele Funktionen wurden noch nicht eingeführt.

Liz Reid, Googles Suchdirektorin, demonstrierte bei I/O ein Beispiel für „mehrstufiges Denken“. Geben Sie ein: „Finden Sie das beste Yoga-Studio in Boston, zeigen Sie Rabattinformationen und die Gehzeit von Beacon Hill an.“ einmal reicht.

Gleichzeitig wird AI Overview in Zukunft auch über „Planungs“-Funktionen verfügen. Wenn AI beispielsweise gebeten wird, das Abendessen für drei Tage zu planen, können Benutzer direkt ein Rezept abrufen, es auf halbem Weg verfeinern, „vegetarisch“ hinzufügen und andere Anforderungen erfüllen und exportieren Sie es dann in ein Dokument.

Die Idee von Google ist die gleiche wie bei anderen KI-Suchprodukten: Suchen visueller, interaktiver und personalisierter zu gestalten, menschliche Wörter anstelle von Schlüsselwörtern für die Kommunikation zu verwenden, Zeit bei der Suche nach Informationen zu sparen und komplexere und spezifischere Fragen zu beantworten.

Secret Tower bietet verschiedene Suchmodi für Einfachheit, Tiefe und Recherche. Der Recherchemodus kann sogar Skizzen und Mindmaps zur Erstellung von Präsentationen bereitstellen.

Perplexity kann den Suchumfang steuern, das gesamte Internet abdecken oder ihn je nach Suchbedarf auf wissenschaftliche Arbeiten, YouTube und Reddit eingrenzen.

Tiangong nutzt die KI-Suche als Portal, ist mit mehr Produktivitätstools ausgestattet und bietet KI-Schnelllesen, Musikerstellung und andere intelligente Agenten. Dies entspricht dem Aufbau einer AIGC-Plattform zur Inhaltserstellung auf der Grundlage der KI-Suche.

Die meisten der üblichen Fragen, z. B. wie das Wetter ist, wie hoch der Wechselkurs ist und wie man zur offiziellen Website springt, können tatsächlich durch einfache herkömmliche Suchen beantwortet werden.

In relativ komplexen Szenarien setzt die KI-Suche jedoch große Hoffnungen, denn sie verfügt über mehr Informationsquellen als ChatGPT und andere Quellen, ist bequemer für die Überprüfung und kann mehr Recherche, Erstellung, Planung und Brainstorming durchführen als die herkömmliche Suche. Anstatt eine bessere Enzyklopädie als die herkömmliche Suche zu sein, ähnelt sie eher einem Agenten.

Natürlich ist die Illusion der KI-Suche immer noch beunruhigend, egal wie sehr der Kuchen gezogen wird. Aus diesem Grund schlagen einige Leute vor, sicherheitshalber generative KI zu verwenden und sich nicht nur die Zusammenfassung anzusehen und sie dann mit der herkömmlichen Google-Suche zu überprüfen. Wie man so schön sagt: Die Situation ändert sich, aber der große Bruder ist immer noch der große Bruder.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo