Lei Juns KI-Voice-Over-Fluch ging auf Douyin viral. Ich war wütend und wachsam gegenüber der neuen Ära der Verbreitung von Deepfakes.

Entschuldigung, ich hatte einen 7-tägigen Urlaub und wurde 6 Tage lang von AI mit Lei Juns Stimme beschimpft.

Lei Jun selbst wurde unschuldig erschossen, und die Internetnutzer waren kurz davor, gegen das Gesetz zu verstoßen, und kehrten dann fassungslos und unfähig, das Gesetz zurückzunehmen, zu ihren Arbeitsplätzen zurück 40-Meter-Machete in ihren Händen.

Das Klonen von Stimmen ist eigentlich nichts Neues, aber die Folgen seiner Verbreitung zeichnen sich gerade erst ab.

Es ist nicht nur ein Scherz, dieses Mal hat die KI das Endergebnis ein wenig durchbrochen

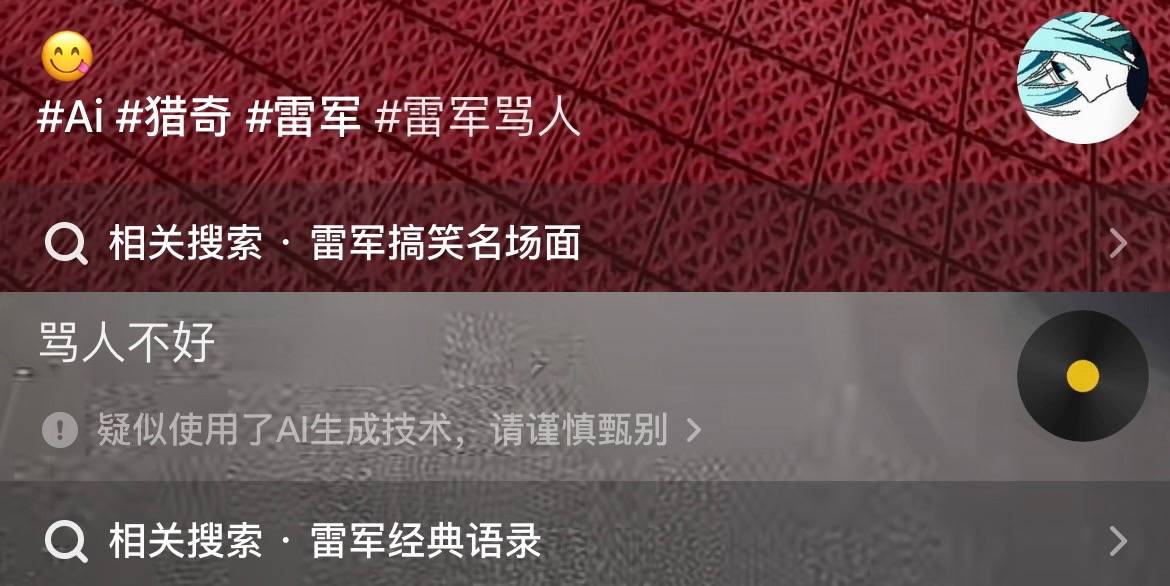

In letzter Zeit gab es viele Videos von „Lei Jun fluchen“ auf Douyin und Bilibili. Tatsächlich verwendeten Internetnutzer KI, um Lei Juns Stimme zu klonen, und auch die Copywriting-Routinen sind sich alle sehr ähnlich.

▲ Das ist eine Parodie

Zu Beginn drückte er seine Gefühle direkt aus und gab seine Identität bekannt: „Hallo zusammen, ich bin Lei Jun.“

▲Das ist ein Streich

Es gibt keine Tabuthemen, wenn es um Basketball, Mahjong und Spiele geht. Sie alle nutzen AI Lei Jun, um sich zu beschweren und zu kritisieren Markenimage, wie etwa das Ansehen pornografischer Filme auf Xiaomi-Handys.

▲Dies ist eine Parodie. Verwandte Suchanfragen sind sehr interessant.

Er hat einen sanften Ton, aber ständige Schimpfwörter, was im Gegensatz zu Lei Jun selbst steht. Er spricht über mich als einen alten Mann und ein Biest, begrüßt die Mütter anderer Leute und macht sogar Gerüchte und Drohungen, indem er behauptet, Xiaomi-Handys fernzusteuern sich selbst zu zerstören und Menschen mit Xiaomi Su7 zu schlagen.

▲ Das ist eine Parodie

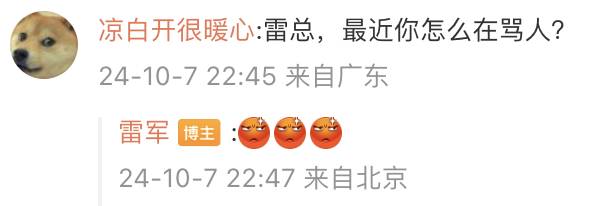

Es gibt auch einige Internetnutzer mit erstaunlichen Ideen, die KI verwendet haben, um Lei Juns Antwort zu fälschen. Der bisherige Malstil ist normal, er klärt die Fakten, lobt das Talent des Internetnutzers und fordert alle auf, sorgfältig zu unterscheiden, genau wie Lei Jun sagen würde: Die Wendung in der zweiten Hälfte ist auf dem Bild kaum zu erkennen, weiter Der Duft kommt aus dem Mund und überrascht die Leute.

Lei Jun selbst wusste bereits, dass ihm die KI Streiche gespielt hatte. Auf die Frage von Internetnutzern im Weibo-Kommentarbereich des Xiaomi su7-Sperrauftrags antwortete er mit drei Emojis mit starken emotionalen Farben.

Lei Juns Image war schon immer relativ zugänglich, und es macht ihm nichts aus, sich über sich selbst lustig zu machen. Als er zu Station B kam, sang er sogar Peripheriegeräte mit den Händen, aber die Natur dieser Zeit ist offensichtlich zu gleich.

Es ist nicht ratsam, sich über Witze lustig zu machen, zu vulgär zu sein oder gar böswillig zu sein.

Diese Videos betonen nicht nur nicht, dass es sich um KI handelt, sondern geben auch an, dass sie echte Fotos für die Bilder verwenden. Sie stehen tatsächlich kurz davor, Reputationsrechte und Porträtrechte im Vergleich zu KI zu verletzen Sun verletzt, ist klarer.

Die Rechtsabteilung von Xiaomi hat ihre Arbeit erledigt. Bei der Suche nach „Lei Jun AI Dubbing“ gibt es derzeit keine Schimpfwörter, Gerüchte oder Beschimpfungen mehr.

KI-Verstöße sind immer noch eine neue Sache, aber es gibt Lehren aus der Vergangenheit.

Im April dieses Jahres wurde das erstinstanzliche Urteil im ersten „KI-Stimmverletzungsfall“ des Landes verkündet, in dem der Umfang des Schutzes der Rechte und Interessen der Stimmen natürlicher Personen unter der Voraussetzung der Identifizierbarkeit klar festgelegt wurde. Zugänglich für KI-generierte Sounds.

Hier gibt es ein Schlüsselkonzept: Was ist Erkennbarkeit? Neben der Verwendung von Ton wurde in diesem Vertragsverletzungsverfahren auch ein bodenständiges Kriterium erwähnt: ob normale Zuhörer in dem betreffenden Bereich ihn erkennen können.

Auch wenn der Inhalt vieler Videos auf den ersten Blick nicht nach dem Stil von Lei Jun klingt, ähneln die Stimmen tatsächlich denen von Lei Jun.

Kurz gesagt, das Internet ist kein Ort außerhalb des Gesetzes und die KI kann sich der Macht von Skynet nicht entziehen. Sprechen Sie nicht über Technologieneutralität. Es sind die Menschen, die die Werkzeuge nutzen, die die Verantwortung tragen sollten.

Fälschungen sind einfach, aber haben Sie schon einmal darüber nachgedacht, wie Sie das Problem beheben können?

Die weitreichende Verbreitung der Stimme von AI Lei Jun verdeutlicht auch die Tatsache, dass das Klonen von Stimmen immer einfacher wird. Obwohl das Rechtsschutzteam Maßnahmen ergriffen hat, herrscht in den sozialen Medien seit einiger Zeit Aufregung.

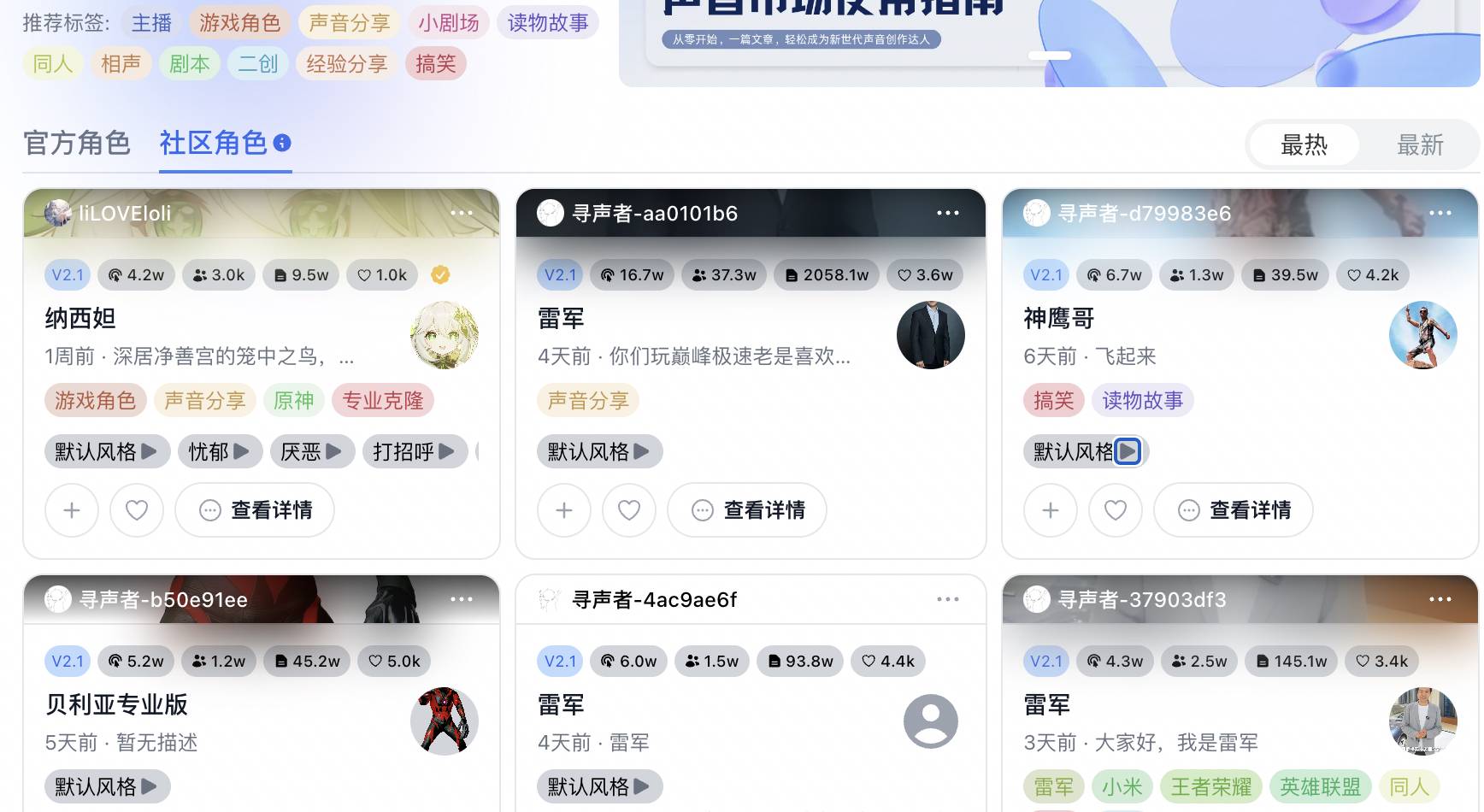

Anders als damals, als die KI Stefanie Sun gebeten wurde, zu singen, war das SoVITS-Trainingsmodell erforderlich, das etwas professionell war und die Leistung der Ausrüstung testete. Wenn Sie nun jemanden bitten, etwas zu sagen, kann es direkt generiert werden nahezu in Echtzeit auf der Website angezeigt.

▲Auf der Website zum Klonen von Stimmen gibt es viele KI-Charaktere, die von Benutzern selbst hochgeladen wurden.

Vor einiger Zeit war Three Sheep, das führende Live-Übertragungsunternehmen, noch nicht aus dem „Mooncake Gate“ herausgekommen und in das „Recording Gate“ gefallen. Nach der Fertigstellung des Sarges war auch die KI schuld.

Der Inhalt einer Aufnahme, bei der es sich vermutlich um einen Three Sheep-Manager handelte, wurde offengelegt. Der Inhalt senkte die Grenze und betraf viele Führungskräfte und Moderatoren. Nach polizeilichen Ermittlungen war der Audioinhalt jedoch falsch und wurde mithilfe von KI gefälscht. Eine Zeit lang konnten die Leute nicht glauben, dass KI so mächtig war, dass sie betrunkene Bemerkungen machen und sich in die juristische Kolumne schicken konnte.

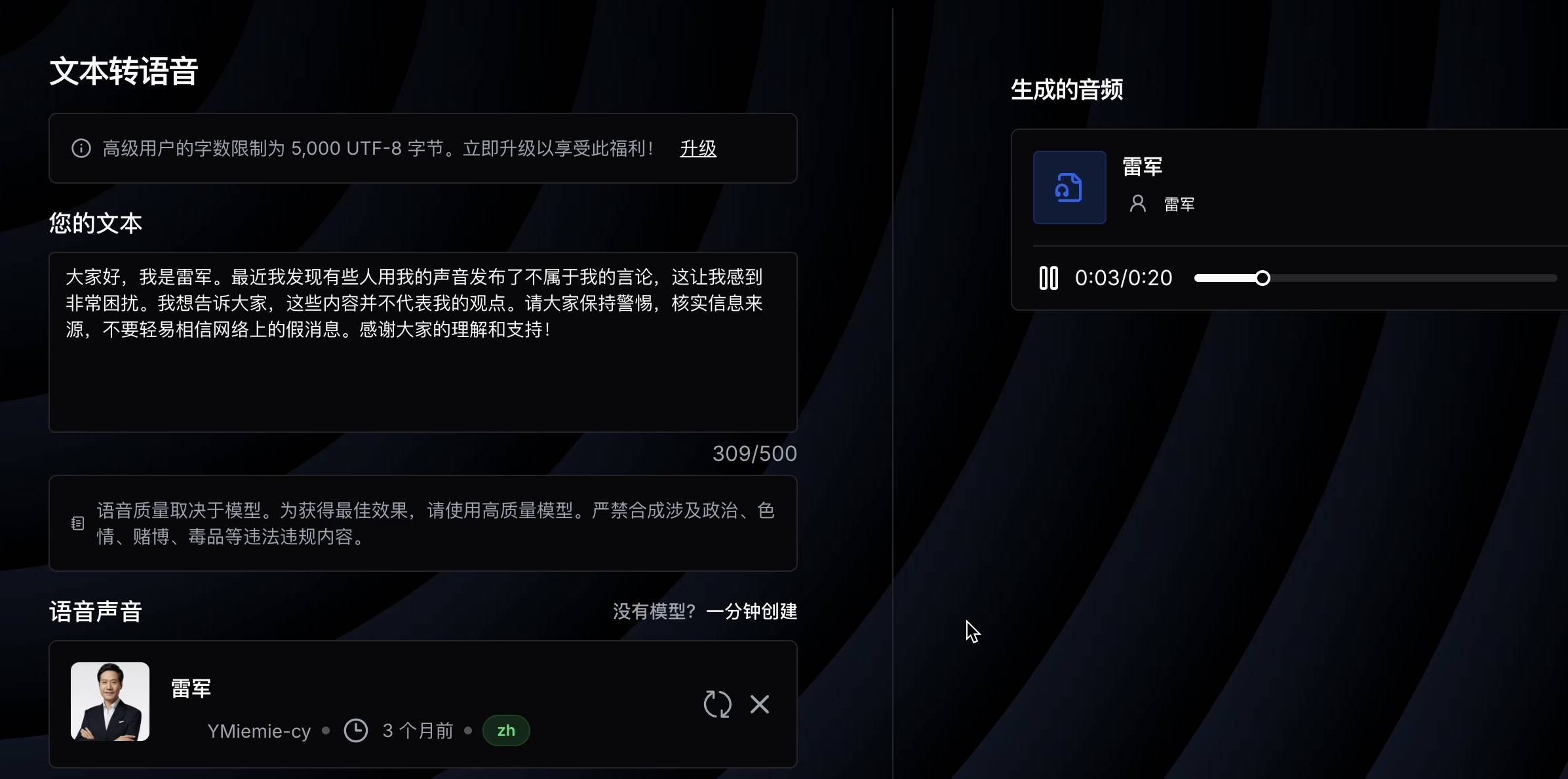

Wenn Sie es nicht glauben, habe ich einfach eine Website zum Klonen von Stimmen ausprobiert. Sie können sie verwenden, indem Sie Ihre E-Mail-Adresse registrieren. Lei Jun AI Voice ist eine der beliebtesten Optionen.

Obwohl der erzeugte Effekt einige Mängel aufweist, einschließlich Rauschen und Verschlucken, und die Klangqualität der des anderen Endes des Telefons ähnelt, wird er fast in Echtzeit erzeugt, ist innerhalb von 500 Wörtern frei und der Ton und die Intonation sind relativ natürlich . Was braucht man sonst noch für ein Fahrrad?

▲Eine weitere Website zum Klonen von Stimmen

Dr. Chen Peng, Ruilai Intelligent Algorithm Scientist, sagte gegenüber APPSO, dass es früher mehrere Minuten oder Dutzende von Minuten gedauert habe, unsere Stimmabdruckinformationen zu erfassen, aber jetzt könne sie ungefähr in einer halben Minute oder Dutzenden von Sekunden erfasst werden. Wenn wir noch ein paar belästigende Anrufe erhalten, kann es sein, dass unsere Stimmen durchsickern.

Wenn Sie jedoch genauer klonen und den Tonfall und andere Sprechstile kopieren möchten, z. B. Guo Degang Englisch sprechen lassen und Swift Swift Chinesisch sprechen lassen möchten, ist noch mehr Korpus erforderlich.

Aber wenn es um Korpus geht, mangelt es nicht an Prominenten. Auch im Ausland kam es zu Vorfällen mit KI-Sprachbetrug, und die Idee wurde sogar gegen den Präsidenten gerichtet.

Anfang dieses Jahres erhielten Einwohner von New Hampshire einen automatisierten Sprachanruf von Biden und wurden aufgefordert, nicht an den Vorwahlen des Bundesstaates teilzunehmen. Tatsächlich wurde der Ton mit dem KI-Tool ElevenLabs gefälscht, um die Wahl zu stören.

Wenige Tage nach dem Vorfall sperrte ElevenLabs das Konto des Initiators. Der Benutzer gab zu, dass er weniger als 20 Minuten und 1 Dollar brauchte, um Bidens Stimme zu klonen.

ElevenLabs hat hierfür auch einige vorbeugende Maßnahmen ergriffen, darunter „No-Go Voices“, das es Benutzern verbietet, die Stimmen bestimmter Prominenter und Politiker hochzuladen oder zu klonen.

Allerdings ist es nicht monolithisch. Im März dieses Jahres entdeckte ein Reporter von 404 Media, dass es möglich war, die Regeln zu umgehen und die Stimmen von Trump und Biden zu klonen, indem man einfach eine Schweigeminute am Anfang der hochgeladenen Datei einfügte.

Sie können Magie auch nutzen, um Magie zu besiegen, aber KI-Erkennungssoftware hat oft Probleme mit KI-generiertem Audio.

NPR-Reporter testeten drei Erkennungssoftware und die Ergebnisse waren nicht optimistisch. Es wurden 84 Proben eingereicht. Die Software mit der besten Leistung beantwortete drei Fragen falsch, die andere hatte eine Genauigkeitsrate von nur etwa 50 %. .

Es gibt ein weiteres sehr interessantes Phänomen im Sprachvorfall von AI Lei Jun: Einige Internetnutzer riefen nicht nur die Rechtsabteilung online an, sondern fragten sich auch: Wie kommt es, dass die Plattform zulässt, dass diese Art von Inhalten populär wird, obwohl sie sie nicht kontrolliert?

In den im September von der Cyberspace Administration of China herausgegebenen „Maßnahmen zur Kennzeichnung synthetischer Inhalte, die durch künstliche Intelligenz generiert werden (Entwurf für Kommentare)“ wurde vorgeschlagen, synthetischen Inhalten, die durch KI generiert werden, explizite und implizite Kennzeichnungen hinzuzufügen. während letzteres zur Metadatenmitte hinzugefügt wird.

▲Benutzer fügt unabhängige Aussage hinzu

Welche Verantwortung sollte die Plattform, die Inhalte verbreitet, unter anderem tragen?

Die erste besteht darin, zu überprüfen, ob die Metadaten eine implizite Kennung haben. Wenn dies der Fall ist, sollte eine auffällige Erinnerung hinzugefügt werden. Die zweite besteht darin, dass die implizite Kennung nicht überprüft wird, der Benutzer jedoch angibt, dass es sich um KI-Inhalte handelt hinzugefügt; der dritte ist, dass es keine implizite Kennung gibt. Der Benutzer hat auch nicht erklärt, dass die Plattform Spuren von KI erkannt hat und eine Erinnerung hinzufügen muss.

Diese Farce ist ein Beispiel. Der Benutzer hat keine Selbsterklärung abgegeben, und die Erkennung der Plattform war nicht vorhanden einige wurden nicht erkannt.

▲Oben nicht markiert, aber unten markiert

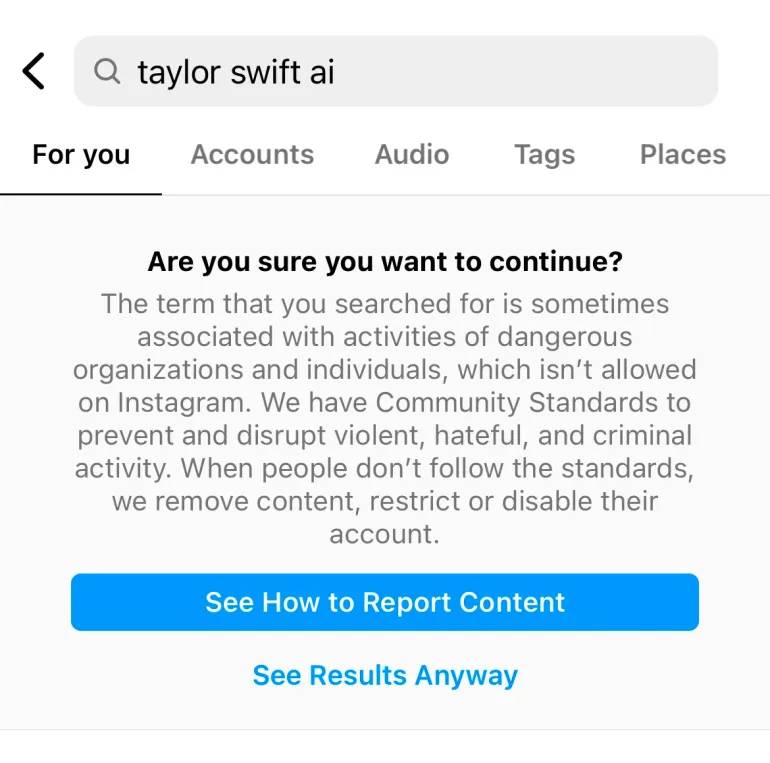

Zu Beginn dieses Jahres war das Fälschen pornografischer Bilder von Taylor Swift durch KI ein typischer Vorfall, bei dem Prominente durch KI geschädigt wurden, was auch die Verzögerung bei Abhilfemaßnahmen widerspiegelte.

Eines der Bilder überlebte auf X 17 Stunden und wurde 47 Millionen Mal angesehen, bevor es gelöscht wurde.

Soziale Medien wie X und Instagram erlaubten nicht nur das Löschen von Fotos, sondern erlaubten früher auch keine Suche nach Swift oder gaben bei der Suche Warnungen aus. Fans hassen die Tatsache, dass Eisen nicht zu Stahl werden kann, deshalb „schlachten sie spontan den Platz ab“ und verwenden echte Fotos, um ihre Idole zu schützen.

▲ Instagram-Suchwarnung für Taylor Swift

Je weiter die KI-Technologie zum Einsatz kommt, desto schwieriger wird es, Missbrauch zu verhindern.

Der „Modepapst“, der eine Daunenjacke trug und mit Midjourney generiert wurde, ließ Bilder und Fakten der Vergangenheit angehören. Das Gleiche gilt für Töne, Videos und Szenen.

Das Erschreckendste, woran man denken muss, ist, dass KI mit fortschreitender Technologie Individuen mit bestimmten biologischen Merkmalen „reproduzieren“ kann, die der Realität immer näher kommen.

Unsere Gesichter und persönlichen Daten werden durchgesickert. Gleichzeitig wurden Malstil und Klang, diese scheinbar einzigartigen Dinge und Techniken, die einst eine Schwelle hatten, auch von der KI nachgeahmt, was ausreicht, um normale Menschen zu täuschen.

Heute müssen wir neben dem Einsatz technischer und rechtlicher Mittel möglicherweise darüber nachdenken, ob es einen moralischen Konsens geben sollte. Ein Gentleman hat etwas zu tun und etwas nicht. Tue anderen nicht das an, was du nicht willst, dass andere es dir antun.

Wenn wir online gehen, ist es am besten, nicht davon auszugehen, dass alles wahr ist, geschweige denn, der Initiator einer Grenzüberschreitung zu sein. Wir starren nicht nur vom Ufer aus auf das Wasser, wir sind auch ein kleines Boot darüber.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo