Nach der Benennung durch OpenAI hat Zhipu gerade ein neues Open-Source-Modell veröffentlicht: die vielseitigste inländische Suchmaschine, ein Satz zum Erstellen einer Suchmaschine

Die Open Source-Entwicklung inländischer Großmodellhersteller nimmt immer noch Fahrt auf.

Gerade hat Zhipu offiziell sein neuestes Flaggschiff-Modell GLM-4.5 vorgestellt. Laut der offiziellen Erklärung von Zhipu handelt es sich dabei um ein „Basismodell, das speziell für Agent-Anwendungen entwickelt wurde“.

Dieses Modell wurde konsequent dem Open-Source-Prinzip folgend gleichzeitig auf den Plattformen Hugging Face und ModelScope als Open Source veröffentlicht. Die Modellgewichtung folgt der MIT-Lizenz und kann kommerziell genutzt werden.

Durchflusssparende Version:

- GLM-4.5 hat hinsichtlich Argumentation, Code und umfassender Agentenfunktionen das SOTA-Niveau von Open-Source-Modellen erreicht.

- GLM-4.5 verwendet eine Mischung aus Expertenarchitektur (MoE), einschließlich GLM-4.5: Gesamtparameter sind 355 Milliarden, Aktivierungsparameter sind 32 Milliarden; GLM-4.5-Air: Gesamtparameter sind 106 Milliarden, Aktivierungsparameter sind 12 Milliarden;

- Beide Versionen sind vollständig Open Source und unterstützen die MIT-Lizenz.

- Sowohl GLM-4.5 als auch GLM-4.5-Air unterstützen einen hybriden Denkmodus und bieten zwei Modi: einen Denkmodus für komplexes Denken und die Verwendung von Werkzeugen und einen Nicht-Denkmodus für sofortige Reaktionen.

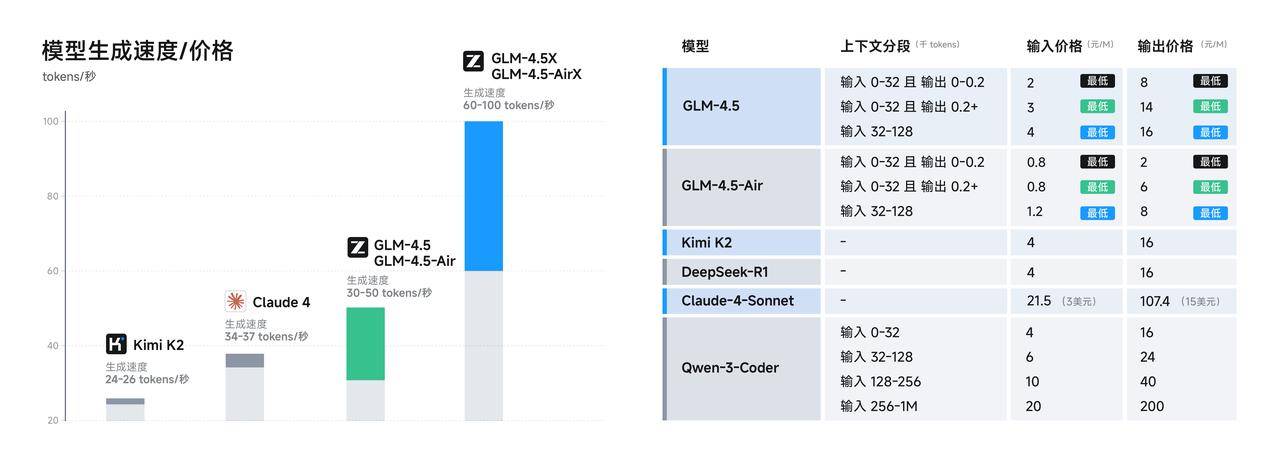

- Der API-Aufrufpreis beträgt nur 0,8 Yuan/Million Token für die Eingabe und 2 Yuan/Million Token für die Ausgabe; die Hochgeschwindigkeitsversion kann bis zu 100 Token/Sekunde erreichen.

Das wichtigste technische Verkaufsargument von GLM-4.5 ist die erstmalige native Integration von Argumentations-, Kodierungs- und Agentenfunktionen in einem einzigen Modell. Während andere Modelle entweder in Argumentations-, Kodierungs- oder Assistenzfunktionen brillieren, bietet GLM-4.5 alle Funktionen.

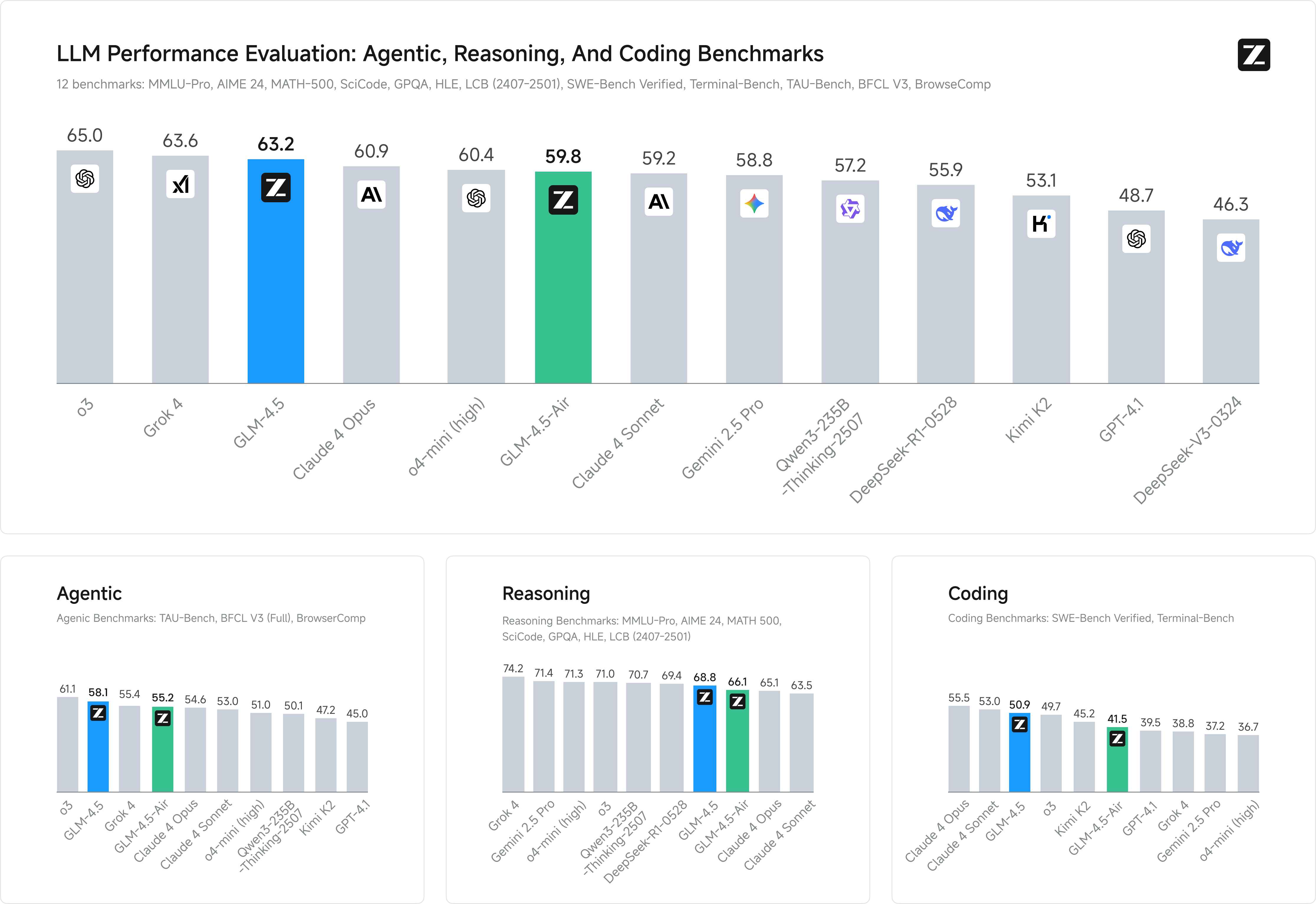

Werfen wir wie gewohnt zunächst einen Blick auf den „Running Score“ des neuen Modells.

Zhipu hat 12 der repräsentativsten Benchmarks ausgewählt, um „seine Stärken zu zeigen“, darunter MMLU Pro, AIME 24, MATH 500, SciCode, GPQA, HLE usw., die auch unsere „alten Bekannten“ sind. Die umfassende Durchschnittspunktzahl zeigte, dass GLM-4.5 unter den globalen Modellen den zweiten Platz, unter den inländischen Modellen den ersten Platz und unter den Open-Source-Modellen den ersten Platz belegte.

Natürlich sind Laufergebnisse allein nutzlos und praktischere Tests sind überzeugender.

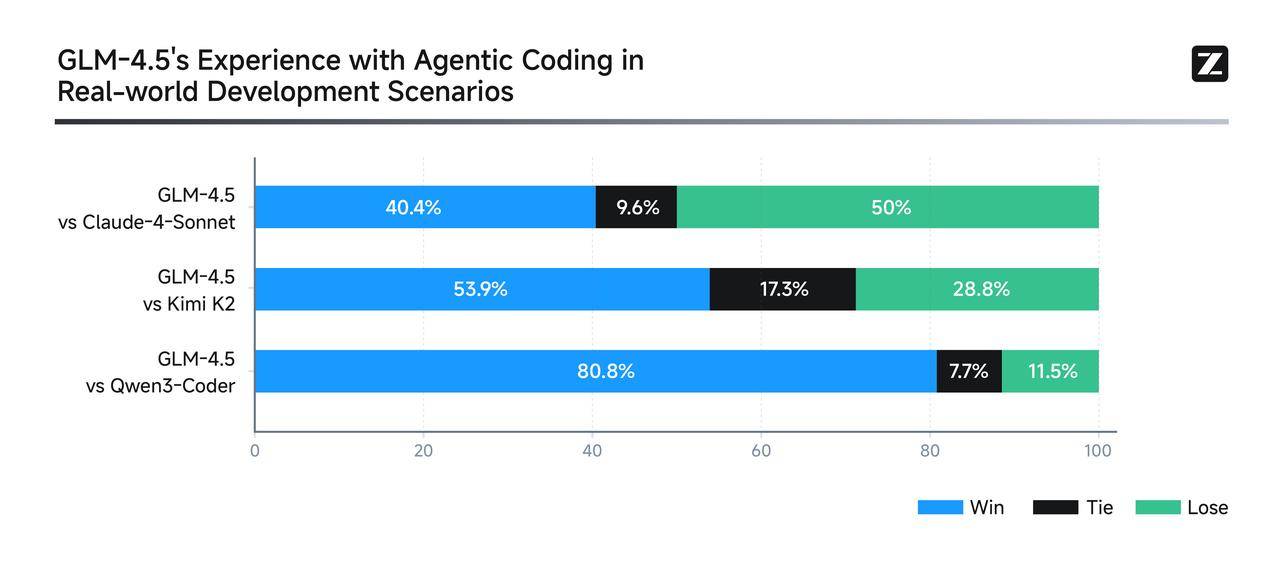

Um die Stärke von GLM-4.5 in realen Agent-Coding-Szenarien zu demonstrieren, hat Zhipu es direkt in Claude Code integriert, um mit Modellen wie Claude-4-Sonnet, Kimi-K2 und Qwen3-Coder zu konkurrieren.

Der Testplan ist ziemlich anspruchsvoll: insgesamt 52 Programmierentwicklungsaufgaben, die sechs Hauptentwicklungsbereiche abdecken, alle in einer unabhängigen Containerumgebung für mehrere Runden interaktiver Tests. Der Schwerpunkt liegt auf der realen Umsetzung. Die Ergebnisse zeigen, dass GLM-4.5 im Vergleich zu Claude-4-Sonnet zwar noch viel Raum für Verbesserungen besteht, in Bezug auf die Zuverlässigkeit der Tool-Aufrufe und die Aufgabenerledigung jedoch immer noch recht gut abschneidet.

Zhipu hat sogar alle Testfragen und Agententrajektorien öffentlich gemacht (https://huggingface.co/datasets/zai-org/CC-Bench-trajectories), was mir das Gefühl gab, dass sie Kollegen willkommen heißen, um „Fälschungen zu bekämpfen“.

Schauen wir uns einige weitere überzeugende Demos an, die ebenfalls sehr wertvoll sind.

Geben Sie einfach die Eingabeaufforderung „Erstellen Sie eine Google-Suchwebsite“ auf der offiziellen Website von z.ai ein, und GLM-4.5 generiert in nur einem Satz tatsächlich eine echte, nutzbare Suchmaschine.

Die von GLM-4.5 erstellte Quantenfunktionsbox ist voll funktionsfähig und demonstriert die umfassenden Fähigkeiten des Modells.

Für ein komplexeres Erlebnis können Sie damit auch eine anklickbare und zoombare 3D-Globusseite erstellen. Benutzer können auf einen Ort klicken, um Details anzuzeigen, begleitet von einer sanften Zoomanimation.

▲Tipps: Erstellen Sie mit Three.js und JavaScript eine Webseite, die eine 3D-Welt mit den von mir besuchten Orten basierend auf einem Array erstellt. Durch Klicken auf Markierungen auf dem 3D-Globus wird ein Zoomeffekt animiert und detaillierte Reiseinformationen mit Fotos geöffnet.

Im Gegensatz zu herkömmlichen KI-PPT-Tools, die Vorlagen zum Einfügen von Informationen verwenden, sucht GLM-4.5 selbstständig nach Materialien und Bildern und schreibt Bilder und Texte basierend auf den tatsächlichen Materialien direkt im HTML-Format. Neben dem herkömmlichen Seitenverhältnis von 16:9 unterstützt es auch flexibel Social-Media-Cover, lange Bilder, Xiaohongshu-Karten und sogar persönliche Lebensläufe.

Auch inländische Hersteller haben begonnen, das „Rollup“ zu erlernen, was die Entwicklererfahrung angeht. Beispielsweise ist GLM-4.5 mit gängigen Code-Intelligence-Organisationen wie Claude Code, Cline und Roo Code kompatibel. Die vollständige Bedienungsanleitung finden Sie hier:

- Inländische Benutzer: https://docs.bigmodel.cn/cn/guide/develop/claude

- Benutzer im Ausland: https://docs.z.ai/scenario-example/develop-tools/claude

Wenn das oben Genannte nur die „Oberfläche“ ist, dann ist der technische Kern das wahre „Innere“ von GLM-4.5.

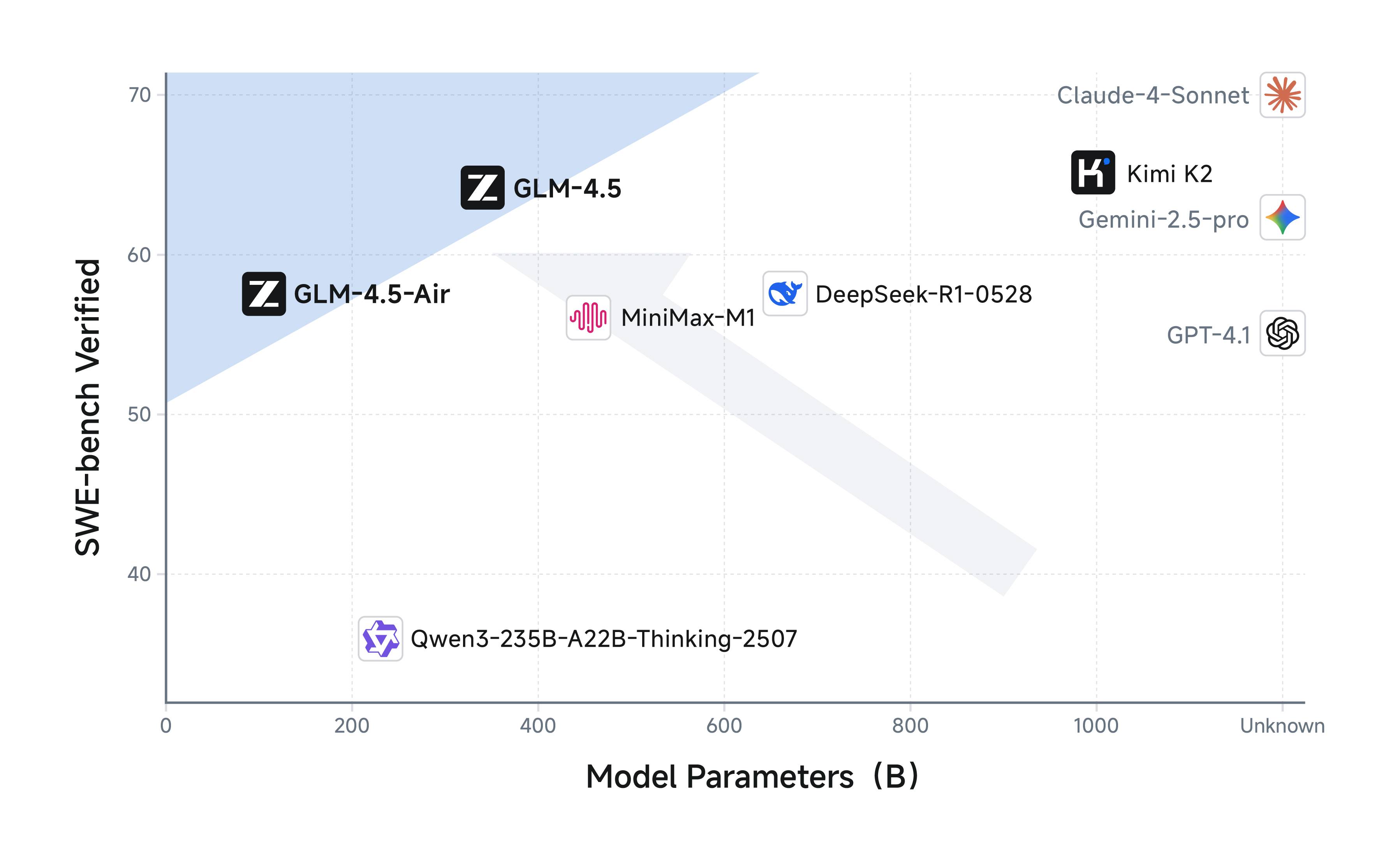

Wenig bekannte Tatsache: Die Anzahl der Parameter von GLM-4.5 beträgt nur die Hälfte von DeepSeek-R1 und ein Drittel von Kimi-K2, aber die Leistung wird dadurch nicht beeinträchtigt, und dies liegt an der höheren Parametereffizienz des GLM-Modells.

Insbesondere GLM-4.5-Air mit 106 Milliarden Gesamtparametern/12 Milliarden Aktivierungsparametern hat sich bei der Inferenzbewertung bereits an Gemini 2.5 Flash und Claude 4 Sonnet angenähert. Auf der SWE-Bench-Verifizierungsliste liegt es zudem an der Pareto-Grenze des Leistungs-/Parameterverhältnisses – mit anderen Worten: Es hat bei geringerem Volumen eine bessere Kosteneffizienz erreicht.

Die Leistungssteigerung ist auf die „Wunderwirkung“ des Trainingsprozesses zurückzuführen.

GLM-4.5 und GLM-4.5-Air verwenden einen ähnlichen Trainingsprozess: Zunächst trainieren sie mit 15 Billionen Token an allgemeinen Daten. Anschließend führen sie gezieltes Training mit 8 Billionen Token an Daten in Bereichen wie Code, Argumentation und Agenten durch. Abschließend wird Reinforcement Learning eingesetzt, um die Argumentations-, Code- und Agentenfähigkeiten des Modells weiter zu verbessern. Mit Geld und Ressourcen kann man wirklich alles machen, was man will.

Darüber hinaus könnten die bahnbrechenden Kosten- und Effizienzvorteile von GLM-4.5 noch schwerwiegender sein. Der API-Aufrufpreis beträgt lediglich 0,8 Yuan pro Million Token für die Eingabe und 2 Yuan pro Million Token für die Ausgabe. Gleichzeitig kann die Hochgeschwindigkeitsversion in praktischen Tests bis zu 100 Token pro Sekunde generieren und unterstützt damit die tatsächlichen Bereitstellungsanforderungen hinsichtlich geringer Latenz und hoher Parallelität. Ein echter Preiskiller.

Derzeit wurde die API auf der offenen Plattform BigModel.cn gestartet, die mit einem Klick mit dem Claude Code-Framework kompatibel ist. Normale Benutzer können die Vollversion von GLM-4.5 auch auf Zhipu Qingyan (chatglm.cn) und Z.ai ausprobieren.

Erwähnenswert ist, dass OpenAI im vergangenen Monat in einem auf seinem Global Affairs-Konto veröffentlichten Bericht Zhipu direkt namentlich erwähnte und erklärte, das Unternehmen habe im globalen KI-Wettbewerb erhebliche Fortschritte erzielt. Der Ton war ungewöhnlich direkt.

Rückblickend ist Zhipu ein Unternehmen mit relativ stabiler Wachstumsdynamik. Es hält Schritt, hält mit der Modelliteration Schritt, öffnet sich für ein breiteres Spektrum an Open Source und verfolgt eine klare Richtung. Vor diesem Hintergrund überrascht es nicht, dass es als erstes der „Sechs kleinen Drachen der KI“ einen Börsengang durchführt.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von iFanr: iFanr (WeChat-ID: ifanr), wo Ihnen so bald wie möglich weitere spannende Inhalte präsentiert werden.