Nachdem ich diese spirituelle Fortsetzung von Google Camera verwendet habe, habe ich das Gefühl, dass Handyfotografie so sein sollte

Vor sechs Jahren begann meine Reise als Fotograf, als ich mit meiner Sony-Kamera in der Hand einen Airbus 320 von IndiGo nach Indien bestieg.

Heute, sechs Jahre später, erobert die Mobiltelefonfotografie mit außergewöhnlicher Geschwindigkeit den Bereich der traditionellen Bildgebung und die Produktpalette des Kameramarktes verengt sich allmählich zu praktischen Werkzeugen im professionellen Bereich oder zu Modeartikeln.

Zu dieser Zeit erregte ein anderes „Indigo“ meine Aufmerksamkeit – Adobes Project Indigo, eine völlig andere Bildbearbeitungs-App.

Es bringt das gefeierte rechnergestützte Fotografie-Erlebnis von Google Camera in seiner ursprünglichen Form auf das iPhone und ermöglicht mir einen Einblick in die Leistungsfähigkeit der rechnergestützten Fotografie.

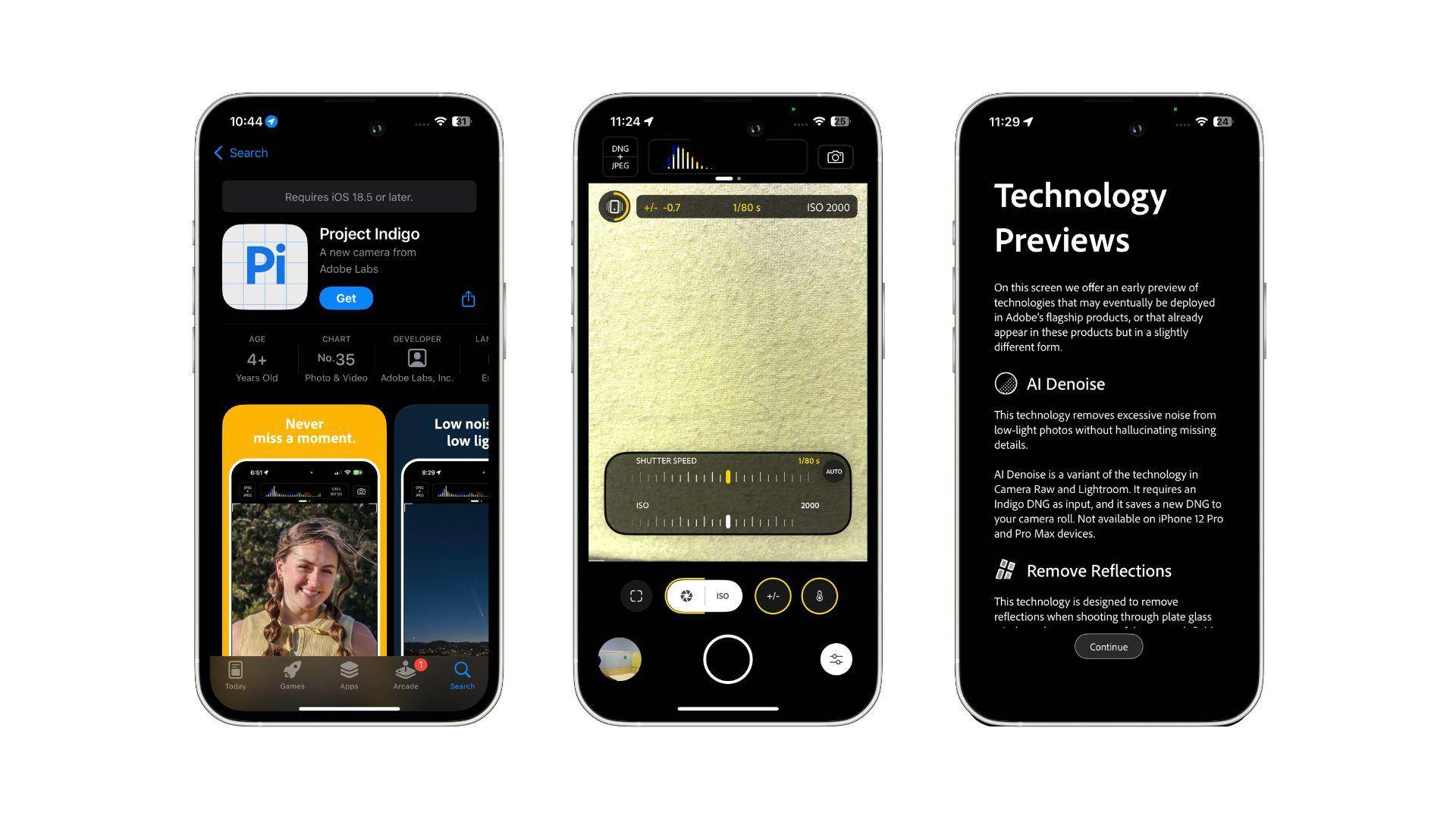

Eine zukunftssichere Kamera-App, aber eine Vorschau

Auf den ersten Blick ist möglicherweise kaum zu erkennen, dass es sich um eine Bildbearbeitungs-App handelt.

Das Anwendungssymbol von Project Indigo enthält keinerlei grafische Elemente. Stattdessen folgt es dem üblichen Designschema von Adobe: Die Anfangsbuchstaben der beiden Wörter des Namens werden auf dem Symbol platziert. Das Grundbild ist ein 16-Quadrate-Raster mit blauen Linien.

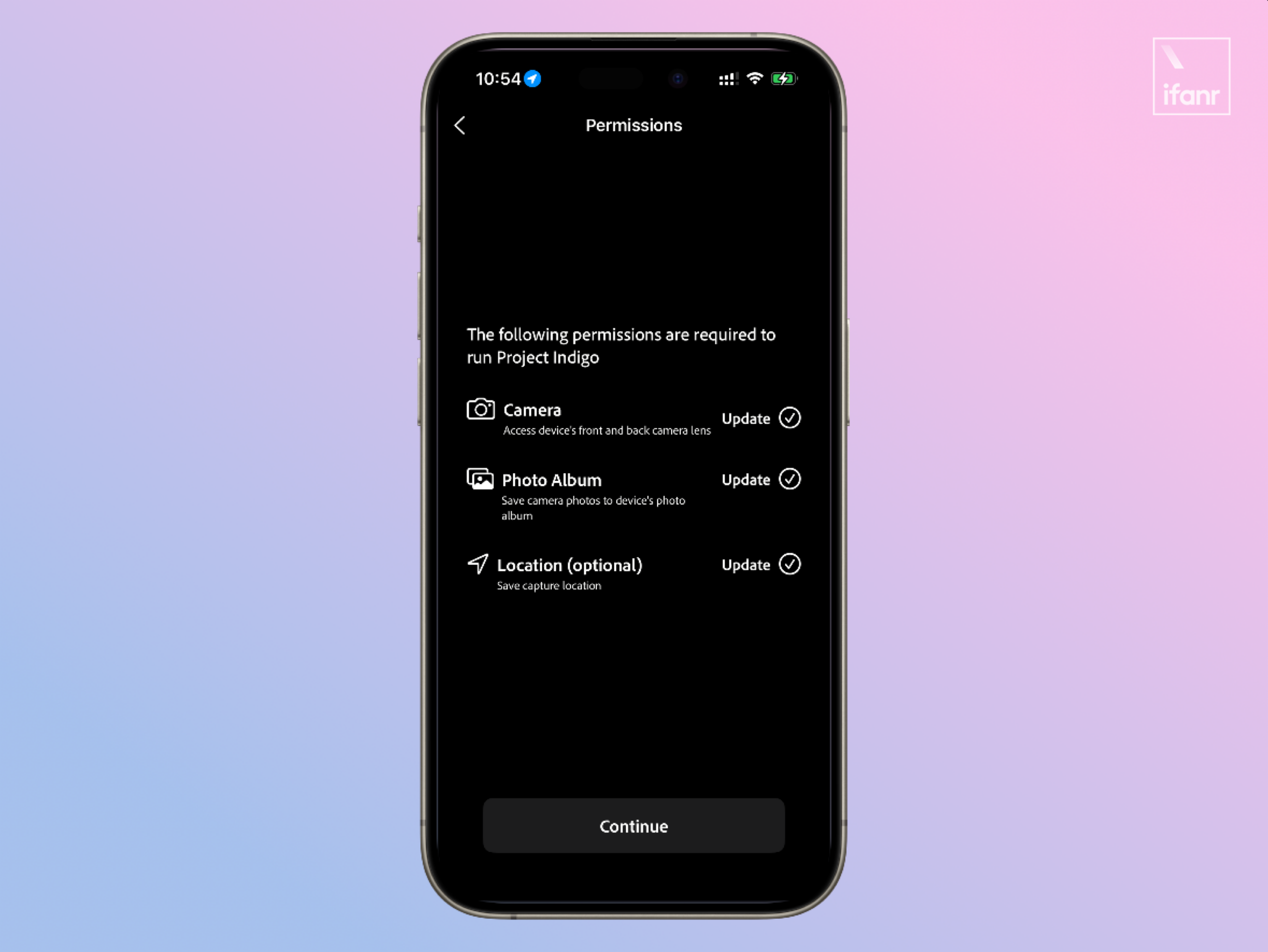

Beim Aufrufen von Project Indigo (im Folgenden Indigo genannt) erscheint als Erstes die vertraute Benutzeroberfläche zur Berechtigungsabfrage. Diese Bildbearbeitungs-App erfordert insgesamt drei Berechtigungen:

- Berechtigungen zur Kamerasteuerung

- Albumzugriffsberechtigungen

- Berechtigungen für Standortinformationen

Das Fehlen von Mikrofon-Zugriffsrechten deutet darauf hin, dass es sich bei Project Indigo um eine App handelt, die ausschließlich statische Bilder bereitstellt und nicht auf die eher dem Internettrend entsprechenden Videoaufnahmen fokussiert ist.

Nachdem der Berechtigungsantrag abgeschlossen ist, zeigt Ihnen Indigo die Hauptbenutzeroberfläche und die Funktionen dieser Bildbearbeitungs-App. Wir überspringen diese schnell und gehen direkt zur Hauptoberfläche der Anwendung.

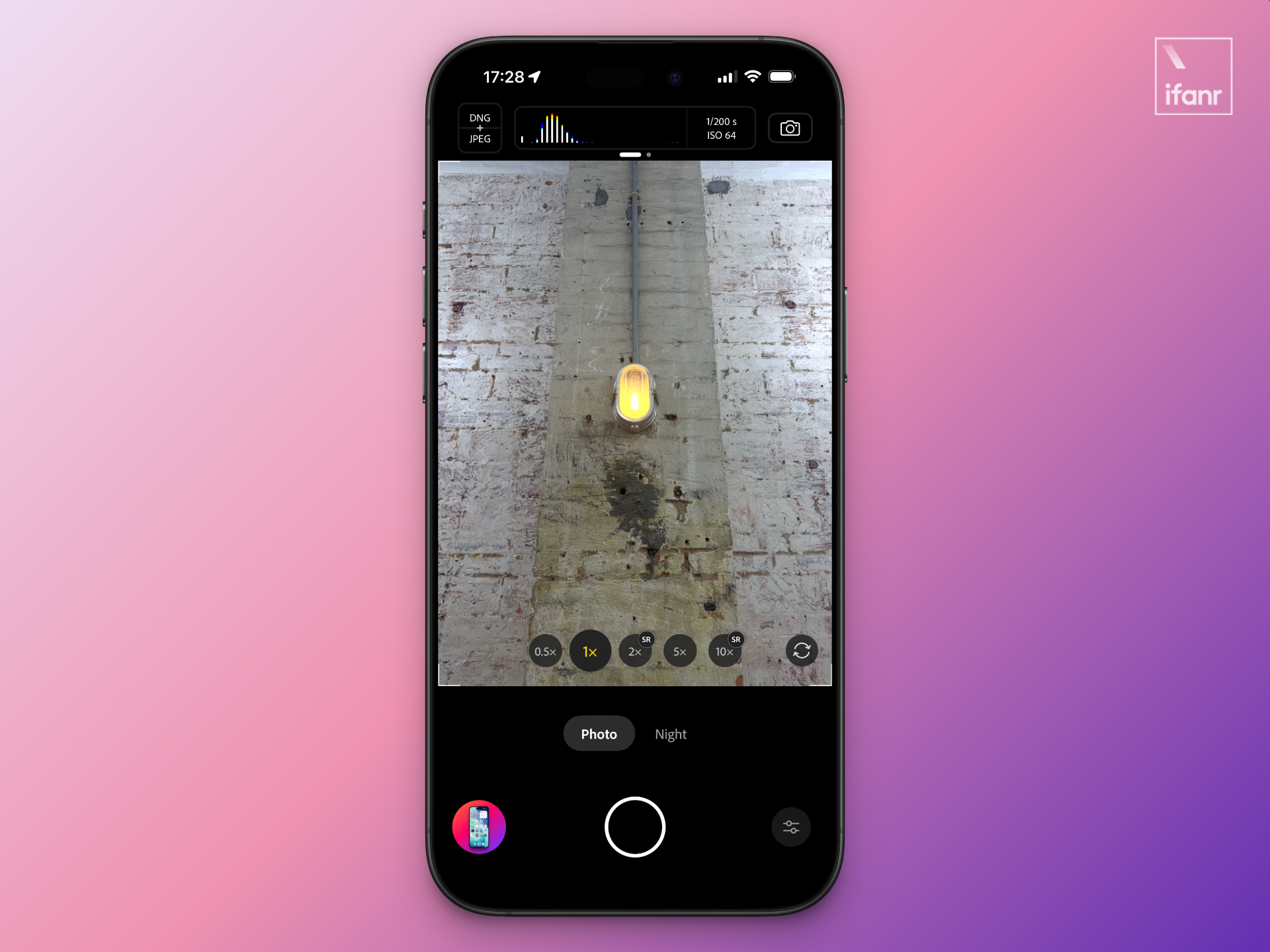

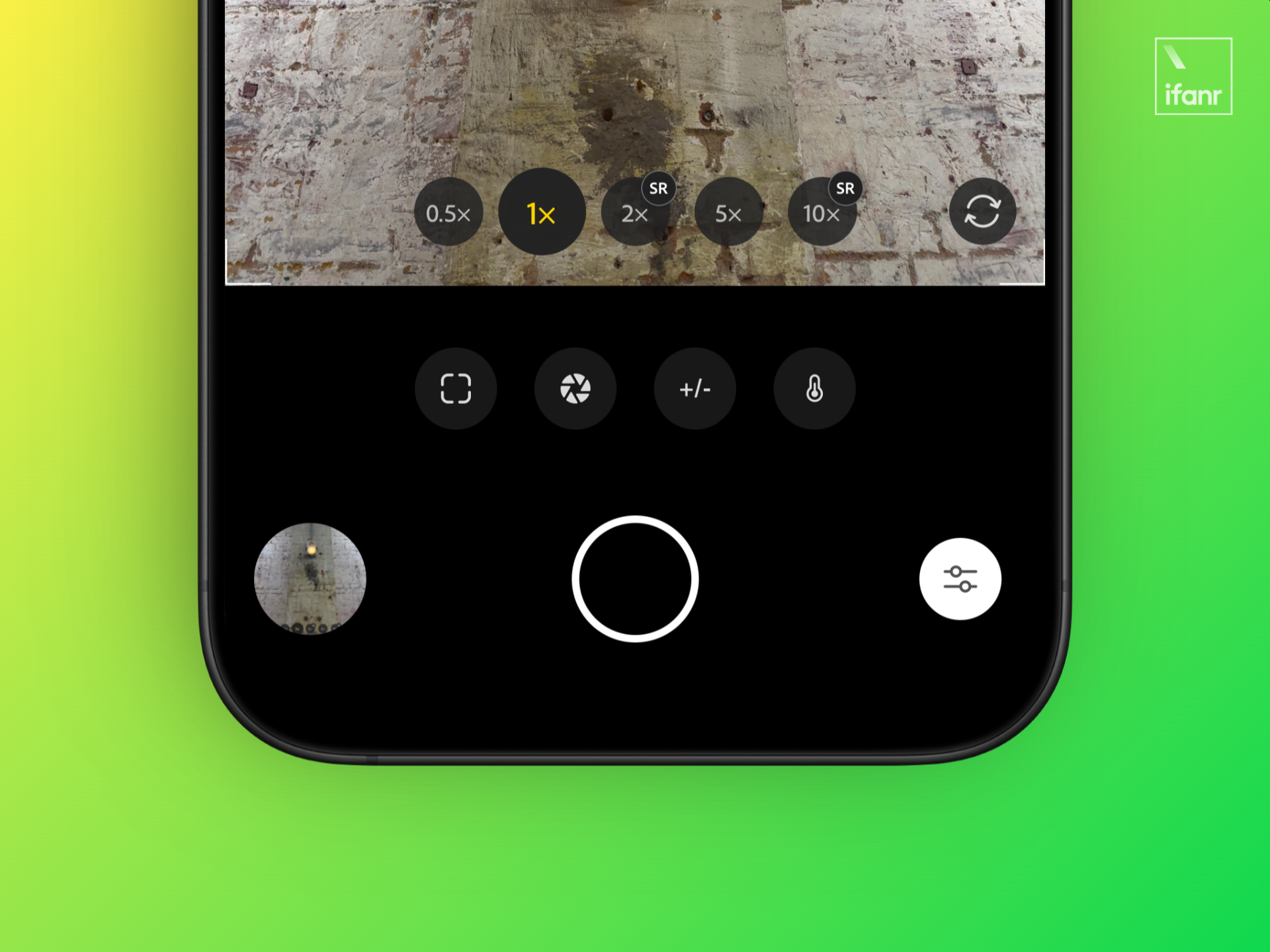

Die Hauptaufnahmeoberfläche von Project Indigo folgt nicht dem Design von iOS 26, bietet jedoch so viele Informationen und Steuerelemente wie möglich, sodass die Bediener maximale Kontrolle über ihre Fotoeffekte haben.

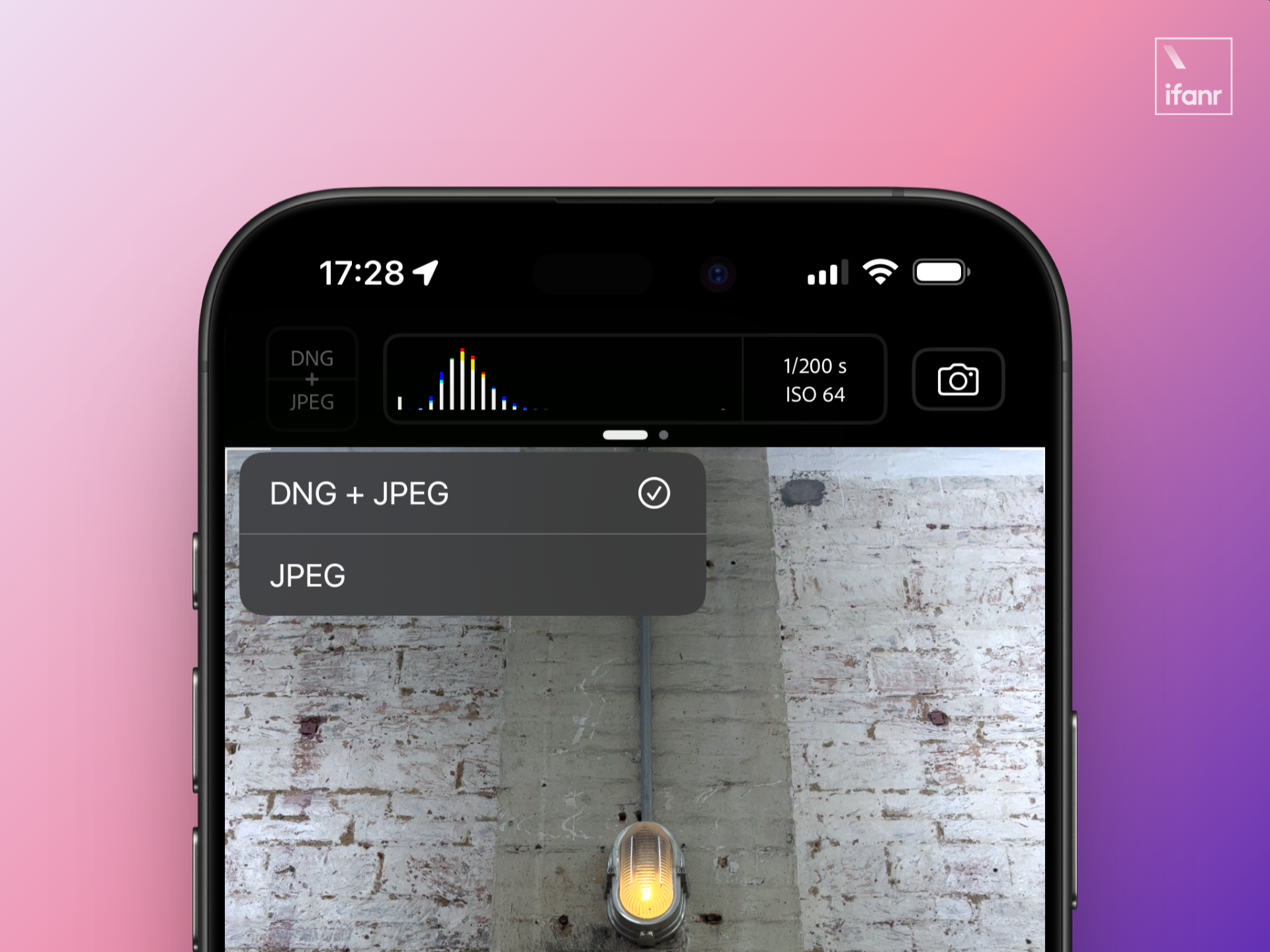

Von oben beginnend ist es in drei Teile unterteilt: Bildformat, Histogramm- und Belichtungsparameter sowie Aufnahmemodus. Beim Bildformat können Sie wählen, ob Sie Fotos im JPEG-Format oder im DNG+JPEG-Format aufnehmen möchten.

Das JPEG-Format ist ein gängiges Verbreitungsformat, das sich für die direkte Veröffentlichung im Internet oder in sozialen Medien nach der Aufnahme eignet, während es sich bei Letzterem um ein Foto im RAW-Format handelt, das detaillierte Bildinformationen aufzeichnet, was einen enormen Nachbearbeitungsspielraum bieten kann und nicht für die direkte Verbreitung geeignet ist.

Das Histogramm und die Belichtungsparameter im oberen mittleren Bereich zeigen deutlich die aktuelle Belichtung im Sucher sowie die Kombination aus Verschlusszeit und Empfindlichkeit an. Dieser Bereich lässt sich auch verschieben, um das sekundäre Menü zu öffnen. In diesem Menü können Sie einige zusätzliche Bildausschnitt- und Aufnahmefunktionen steuern, wie z. B. Countdown-Aufnahme, Sucherraster, Tonwertkorrektur oder die Anzeige für Überbelichtung in Spitzlichtern. Von hier aus können Sie auch alle Indigo-Anwendungseinstellungen aufrufen.

Rechts ist der aktuelle Aufnahmemodus. Die Moduseinstellungen von Indigo sind nicht kompliziert und in nur zwei Modi unterteilt: Foto und Nachtszene.

Wenn Sie Ihren Blick auf die untere Hälfte des Bildschirms richten, finden Sie unten im Sucher die bekannte Brennweitenauswahlleiste. Am Beispiel meines iPhone 16 Pro bietet Indigo fünf Optionen: 0,5×, 1×, 2×, 5× und 10×.

Auffällig ist die Bezeichnung „SR“ auf den beiden Brennweiten 2× und 10×. Aus der offiziellen Bedienungsanleitung geht hervor, dass SR die vollständige Bezeichnung „Multi-Frame Super-Resolution“ ist. Die 2×-Brennweite basiert auf der 1×-Hauptkamera, die 10×-Brennweite auf der 5×-Hauptkamera und erreicht mit dieser Technologie eine Schärfe, die mit optischen Brennweiten vergleichbar ist.

Wie der Name schon sagt, besteht das technische Prinzip hinter der Multi-Frame-Super-Resolution-Technologie darin, dass das Telefon nach dem Drücken des Auslösers sofort eine beträchtliche Anzahl von Fotos aufnimmt und dann mithilfe eines bestimmten Algorithmus Dutzende von Fotos zusammenfügt, um Fotos mit vielen Details und geringem Rauschen zu erstellen.

▲ Das ist sehr peinlich, das Bild stammt von Xiaohongshu @KERICH誠

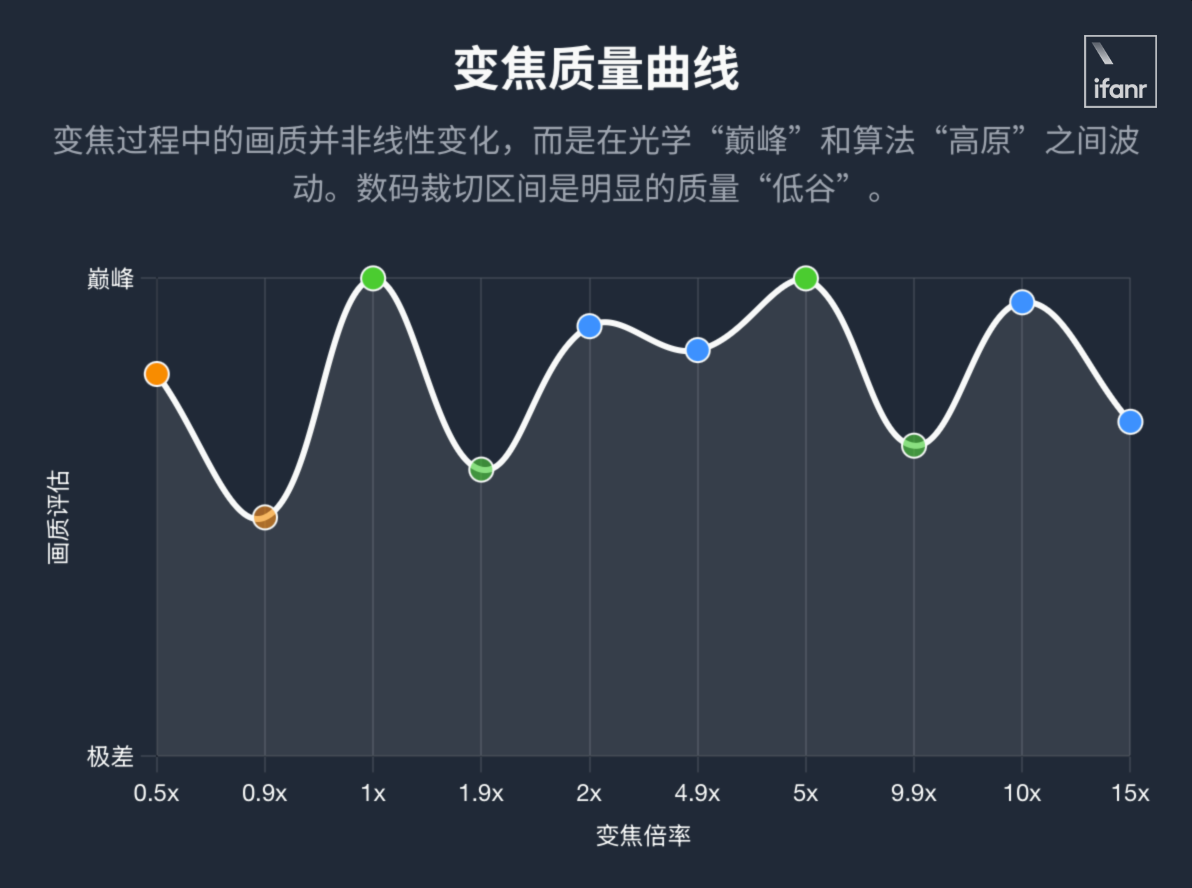

Bei tatsächlichen Tests habe ich festgestellt, dass die Multi-Frame-Super-Resolution-Technologie von 2× bis 4,9× funktioniert, und das Gleiche gilt für 10× und höher.

Das heißt, im Projekt Indigo werden die Abbildungsaufgaben jeder Brennweite weiter unterteilt:

- 0,5×–1×: Digitales Zuschneiden basierend auf nativem Ultraweitwinkelobjektiv;

- 1×-1,9×: digitales Zuschneiden basierend auf der nativen Hauptkamera;

- 2×-4,9×: Optisches Zuschneiden basierend auf Multi-Frame-Super-Resolution-Technologie;

- 5×-9,9×: digitaler Zuschnitt basierend auf nativem 5×-Teleobjektiv;

- 10× und höher: Quasi-optisches Zuschneiden basierend auf Multi-Frame-Super-Resolution-Technologie.

Nachdem wir uns die beeindruckende Brennweitenverteilung angesehen haben, wenden wir uns der Unterseite zu. Die Foto- und Nachtszenenmodi sind horizontal zwischen der Brennweitenverteilung und dem Auslöser angeordnet. Hier lässt sich schnell zwischen den beiden Modi wechseln, um unterschiedliche Aufnahmesituationen zu meistern. Allerdings gibt es hier eine Duplizierung mit dem Modusschalter oben rechts, was etwas Platzverschwendung in der Benutzeroberfläche darstellt.

Weiter unten befindet sich der wichtigste Auslöser. Links daneben befindet sich das Album, in dem die aufgenommenen Fotos für die spätere Zusammenführung abgelegt werden. Hier sieht man, wie im Hintergrund mehrere Fotos zusammengeführt werden. Von hier aus kann man auch zu Lightroom springen, um die Fotos weiter zu bearbeiten.

Die rechte Seite ist der professionellere manuelle Modus, in dem Sie Parameter anpassen können, die sich direkt auf das endgültige Bild auswirken, wie Farbtemperatur, Fokusentfernung, Verschlussgeschwindigkeit und Empfindlichkeit.

Nachdem ich den Seitenaufbau gelesen hatte, war ich sehr neugierig auf die tatsächliche Aufnahmeleistung von Project Indigo und darauf, welches andere Verständnis dieses alteingesessene, auf den Bildgebungsbereich spezialisierte Unternehmen für die mobile Bildgebung hat.

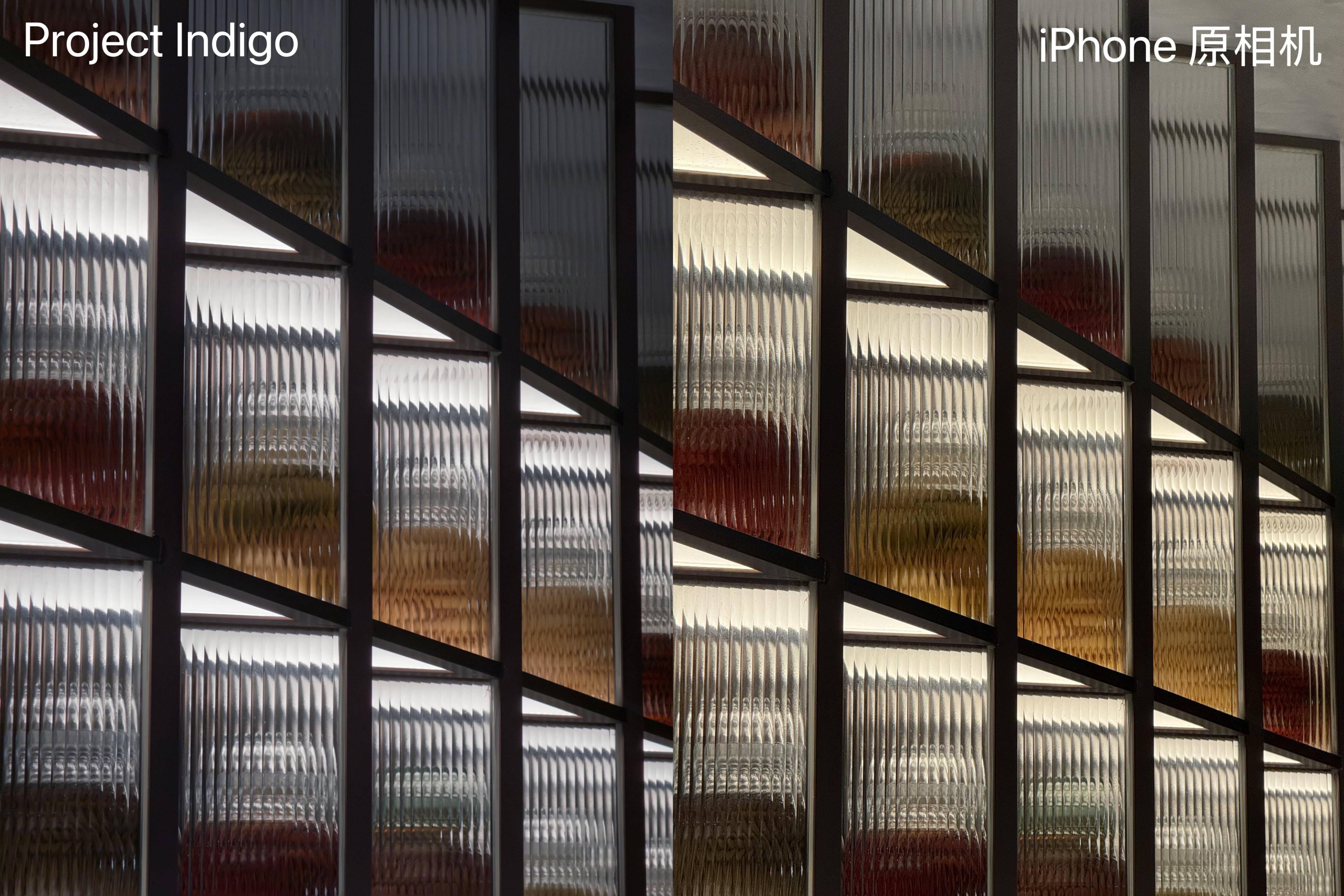

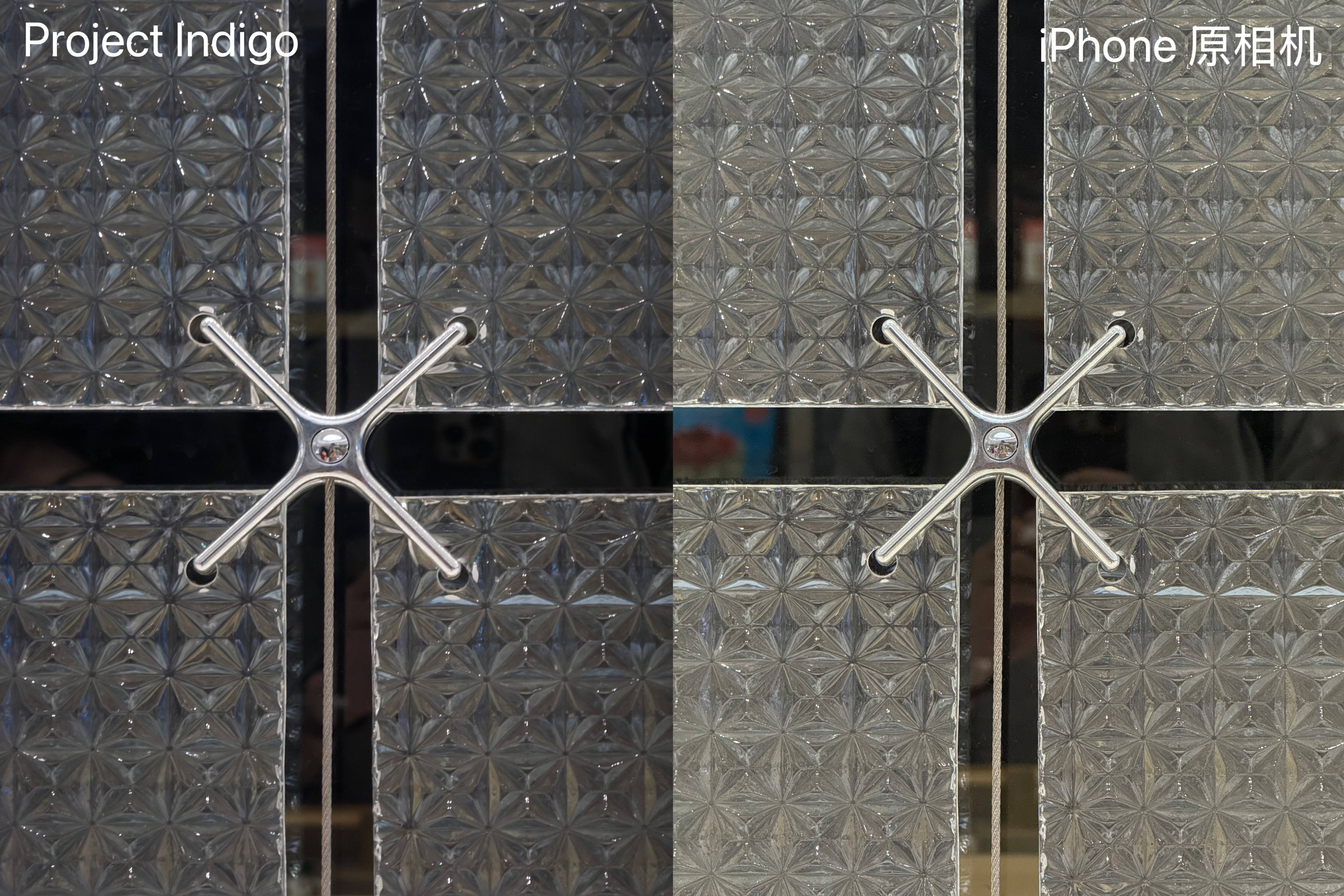

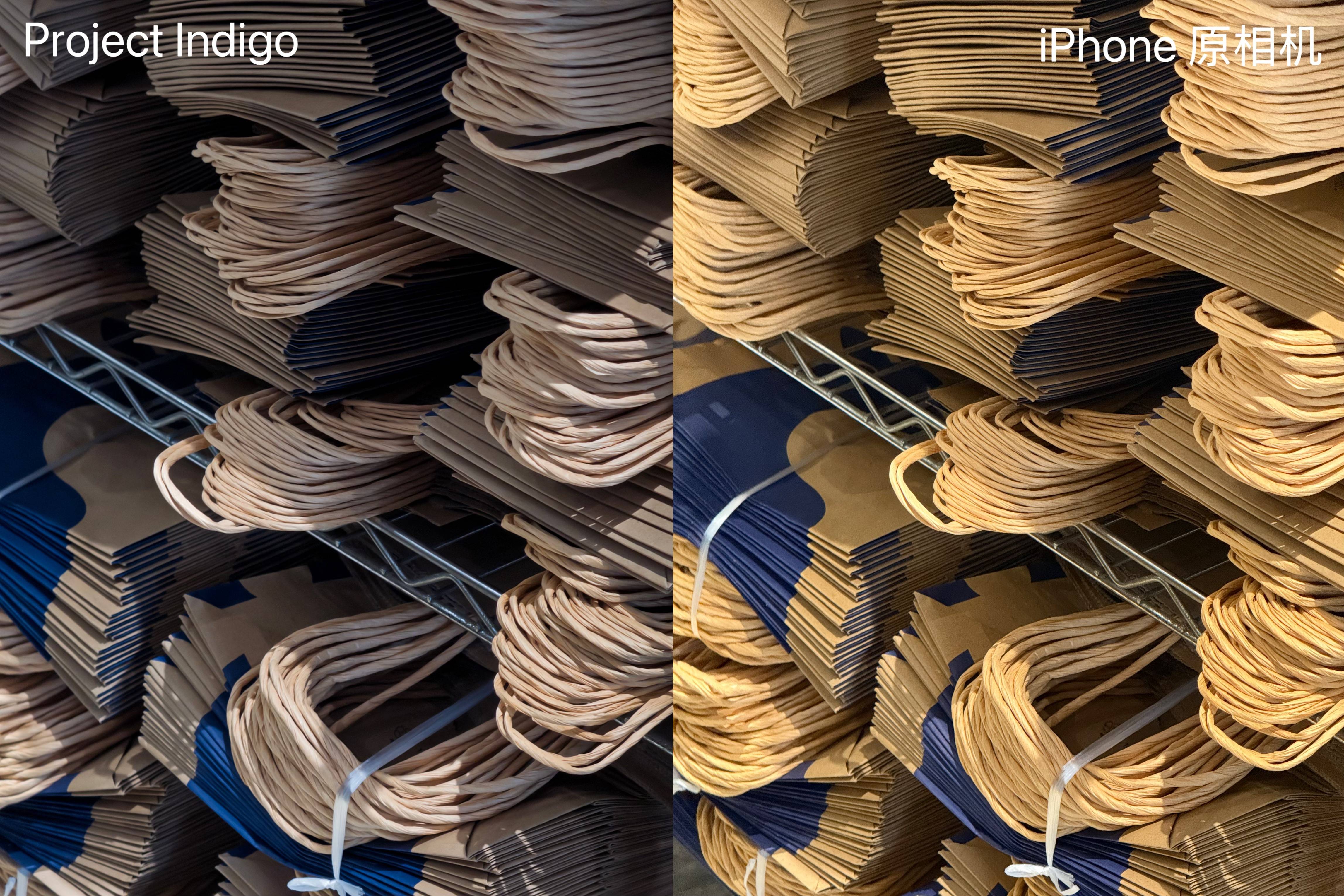

Lassen Sie mich zunächst mein Fazit ziehen. Project Indigo unterscheidet sich in zwei wesentlichen Punkten grundlegend von der nativen Kamera des iPhones. Basierend auf der gleichen Hardware ist der Bildeffekt von Project Indigo ansprechender, und der Übergang zwischen Hell und Dunkel entspricht eher dem, was das bloße Auge sieht, ohne das skurrile Helligkeitsgefühl des iPhones.

Dem Histogramm zufolge konzentrieren sich die Pixel von Project Indigo stärker in der linken Hälfte und die Abbildung ist tendenziell dunkler, was eher der Komfortzone des menschlichen Auges entspricht, die emotionale Resonanz des Menschen stärker anregt und eher mit tiefen Gewohnheiten des künstlerischen Ausdrucks übereinstimmt.

Ein weiterer Grund ist, dass die Bildgebung von Project Indigo weniger Schärfe und Fragmentierung aufweist, die Schärfe jedoch dank der Synthese einer beträchtlichen Anzahl mehrerer Einzelbilder nicht übermäßig abgeschwächt wird. Nach dem Heranzoomen bleiben die Kanten von Objekten und Text im Bild relativ klar und ein gewisses Maß an Lesbarkeit erhalten.

Während der Übergang von Licht und Schatten natürlicher wird und das Problem scharfer Kanten gelöst wird, verfügt Project Indigo auch über eine Optimierung, die nicht leicht zu erkennen ist: Das Originalbild der iPhone-Kamera kann nach dem Heranzoomen leicht subtiles und dichtes Rauschen aufweisen, aber Project Indigo bewältigt dieses Hintergrundrauschen sehr gut und das Bild kann beim Heranzoomen immer noch rein bleiben.

Insgesamt zeichnet sich Project Indigo durch hervorragende Bilddetails, Schärfe, Rauschunterdrückung und Farbleistung aus, zeigt eine natürlichere und harmonischere ästhetische Tendenz und gibt genauer wieder, was das bloße Auge sieht.

Man kann sagen, dass das Debüt von Project Indigo alle Probleme gelöst hat, die derzeit am iPhone kritisiert werden, wie z. B. Überschärfung, unnatürliche Helligkeitskurve und Bilddetails voller Hintergrundrauschen. Es hat sogar die verfügbaren Grenzen der Brennweite des iPhones erweitert, aber ich empfehle nicht, es sofort auszuprobieren.

Der Grund dafür ist, dass diese App noch viele Probleme hat: Beispielsweise erscheinen gelegentlich schwarze Ränder am unteren Rand der Fotos, und die aufgenommenen Fotos verfärben sich violett-rot, sobald sie im Album bearbeitet werden. Gleichzeitig sind die Wärmeentwicklung und der Stromverbrauch während des gesamten Aufnahmevorgangs deutlich höher als bei der systemeigenen Kamera.

Laut Feedback der Entwickler von Project Indigo in den sozialen Medien sind die Probleme mit schwarzen Rändern und Farbstichen hauptsächlich auf die unvollständige Systemanpassung zurückzuführen, was ein typischer Fehler in der Betaphase ist.

Die Gründe für die Wärmeentwicklung und den Energieverbrauch liegen tiefer. Indigo verwendet eine völlig andere Bildverarbeitungs-Pipeline als das iPhone und kann daher nicht auf Apples nativen ISP zugreifen. Sämtliche Multi-Frame-Berechnungen und Bildfusionsaufgaben werden fast direkt auf den Prozessor selbst verlagert, was naturgemäß eine höhere Hardwarelast mit sich bringt.

Tatsächlich hat Adobe Sie bereits an all dies erinnert, bevor Sie die Software öffnen – erinnern Sie sich an das Symbol mit dem weißen Hintergrund und dem blauen Drahtgitter?

Dieses Design, das einer technischen Blaupause ähnelt, weist direkt darauf hin, dass sich Project Indigo immer noch auf die zugrunde liegenden Algorithmen und Frameworks der rechnergestützten Fotografie konzentriert und eher ein technologiegetriebenes Experiment ist als ein voll funktionsfähiges, fertiges und zur Verteilung geeignetes Produkt.

Gleichzeitig zeigt der Ursprung von Project Indigo auch, dass die Benutzererfahrung definitiv nicht gut genug ist. Dabei handelt es sich um ein Projekt, das vom Nextcam-Team im Rahmen von Adobe Labs gestartet wurde. Adobe Labs ist Adobes Testfeld und Inkubator für zukünftige Technologien und konzentriert sich eher auf das Aufwerfen von Fragen und Überprüfen von Ideen als auf die Bereitstellung von Endpunkten.

▲ Die meisten Anwendungen hier werden von Adobe Labs inkubiert

Ursprung und Zukunft der Computerfotografie

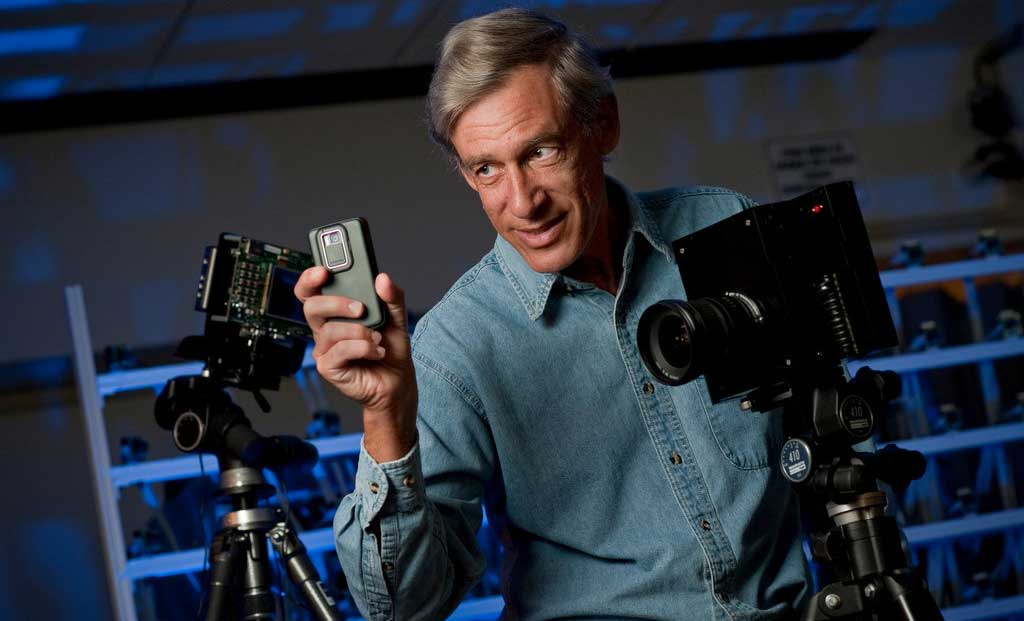

Obwohl der Start von Project Indigo Adobe zugeschrieben wird, einem Unternehmen, das schon lange im Bildgebungsbereich tätig ist, gibt es im Nextcam-Team, das Indigo auf den Markt gebracht hat, einen bemerkenswerten Namen: Marc Levoy.

Wenn Sie die Ära miterlebt haben, als die heimische Android-Bildgebung noch nicht auf dem Markt war und Google Camera populär war, dann ist Ihnen der Name Marc Levoy vielleicht nicht geläufig – das frühe Pixel und die für ihre Algorithmen berühmte Google Camera sind beides Meisterwerke, die von ihm entwickelt wurden.

▲Marc Levoy

Levoys Philosophie wurzelt in seinem akademischen Hintergrund, einer Welt, die sich stark von der traditionellen optischen Fotografie unterscheidet: der Computergrafik.

Bereits während seiner Doktorarbeit legte er mit der von ihm entwickelten Volume-Rendering-Technologie den Grundstein für die Kernlogik seiner späteren Arbeit: Durch Berechnungen rekonstruierte er eine Reihe zweidimensionaler Datenscheiben (z. B. CT-Scans) zu einem dreidimensionalen Ganzen. Dies war der Prototyp der Kernlogik der Multi-Frame-Synthese und Bildrekonstruktion, die er später in der mobilen Fotografie anwandte.

Während seiner Lehrtätigkeit an der Stanford University legte Levoy außerdem ein solides theoretisches Fundament für die Computerfotografie. In dem gemeinsam mit seinen Kollegen verfassten Aufsatz „Light Field Rendering“ vertrat er die Ansicht, dass Kameras nicht nur die Intensität des Lichts, sondern auch dessen Richtung aufzeichnen sollten, um revolutionäre Vorgänge wie die Neufokussierung nach der Aufnahme zu ermöglichen.

Kommt Ihnen das bekannt vor? Die Lytro-Kamera, die mittlerweile der Vergangenheit angehört, ist ein treuer Begleiter auf diesem Weg.

Im Jahr 2004 definierte Levoy den Begriff „Computerfotografie“ in einem Stanford-Kurs neu und machte ihn populär, indem er die breitere Konnotation des Wortes aus einer anderen Perspektive interpretierte:

Bei der rechnergestützten Fotografie handelt es sich um eine Technik, die darauf abzielt, die Möglichkeiten der digitalen Fotografie zu verbessern oder zu erweitern und so ein gewöhnliches Foto zu erzeugen, das mit einer herkömmlichen Kamera nicht möglich wäre.

Zehn Jahre später wechselte Levoy offiziell zu Google und führte das Team dazu, sich auf die mobile Fotografie zu konzentrieren. Seine frühen Ideen wurden hier endlich umgesetzt: Durch Hochgeschwindigkeits-Serienaufnahmen wird eine Gruppe von Einzelbildern mit extrem kurzer Belichtungszeit erstellt. Anschließend werden Algorithmen zum Ausrichten, Zusammenfügen und zur Rauschreduzierung eingesetzt. Schließlich entsteht ein Foto mit einer reinen Qualität und einem großen Dynamikumfang, der die Qualität jedes einzelnen Bildes bei weitem übertrifft.

Eine Theorie, die enorme Rechenleistung erfordert und etwas zu idealistisch ist, wurde nach ihrer Zusammenfassung und Verfeinerung mit der Rechenleistung herkömmlicher Geräte implementiert und gelangte schließlich in die Hände von Hunderten Millionen Nutzern. Der Aufschrei von vor zehn Jahren hat endlich ein Echo gefunden.

▲ Marc Levoy hält Pixel 3

Die Protagonisten sind danach das bekannte Pixel und seine bekannten Funktionen. Allen voran HDR+, das die Bildleistung von Mobiltelefonen unter komplexen Lichtbedingungen grundlegend verändert. Durch die Multi-Frame-Synthese-Technologie bleiben helle Details erhalten und dunkle Bereiche werden gleichzeitig klar dargestellt.

Als nächstes folgt der Porträtmodus, der mithilfe eines Algorithmus einen Hintergrundunschärfeeffekt erzeugt, der mit dem einer Spiegelreflexkamera vergleichbar ist. Dies ist die perfekte Verkörperung des Konzepts der Dimensionsreduzierung; und der Nachtszenenmodus treibt diese Idee auf die Spitze. Er kann bis zu 15 Bilder mit jeweils bis zu 16 Sekunden Belichtungszeit zu einem hellen und klaren Nachtfoto kombinieren. Sein Effekt war damals im Bereich der mobilen Bildgebung beispiellos.

Diese auf der Multi-Frame-Synthese-Technologie basierenden Funktionen ermöglichten es dem Pixel mit Einzelkamera nicht nur, Handys mit Doppelkamera wie das iPhone und Samsung zu übertreffen und zahlreiche Auszeichnungen wie beispielsweise die Auszeichnung als bestes Kamerahandy des Jahres zu erhalten, sondern machten auch den Begriff „Computational Photography“ zu einem Erfolgsrezept für die mobile Bildgebung.

Als Levoy, der bereits bei Adobe angefangen hatte, viele Jahre später nach der Beziehung zwischen Computerfotografie und künstlerischem Schaffen gefragt wurde, war seine Philosophie klar und entschieden:

Es gibt keine „direkte Fotografie“. Der Dynamikumfang des Lichts in der realen Welt übersteigt bei weitem die Grenzen dessen, was ein Sensor erfassen kann. Auch das menschliche Auge selbst ist ein adaptiver Lichtempfindlichkeitsmotor. Die wahrgenommenen Szenen werden vom Gehirn subjektiv verarbeitet, daher muss jedes digitale Bildgebungssystem die aufgenommenen Farben und Töne anpassen, und diese Anpassungen sind zwangsläufig subjektiv.

Levoy ist nicht schüchtern, was das Produkt angeht, und ist sogar überraschend ehrlich. Er gibt an, dass Pixelbilder seit mehreren Jahren gemäß seiner Philosophie und Ästhetik erstellt werden:

Ich liebe die Gemälde von Caravaggio, daher ist der Bildstil von Pixel 2 bis Pixel 4 eher dunkel und kontrastreich.

▲ Caravaggios Werk „Abendessen in Emmaus“

Diese Philosophie prägte Levoys gesamte Karriere, bis er Google verließ und zu Adobe wechselte. Dieser dunkle Stil ist auch bei Project Indigo zu sehen und unterscheidet sich grundlegend von der Bildstrategie der Originalkamera des iPhones, die sich auf Mitteltöne und Lichter konzentrierte.

Dies ist einerseits natürlich eine ästhetische Präferenz und andererseits untrennbar mit den Anforderungen des Algorithmus verbunden. Die aktuelle Lösung von Project Indigo besteht darin, mehrere leicht unterbelichtete Fotos aufzunehmen, um Details und Farben in den Lichtern zu erhalten, und anschließend das Dunkelrauschen durch Multi-Frame-Synthese zu reduzieren. Die nach dieser Logik synthetisierten Fotos sind tendenziell dunkler.

An dieser Stelle können Interessierte bereits ein sehr langfristiges Easter Egg entdecken: Sowohl ästhetisch als auch technisch kann Project Indigo als spirituelle Fortsetzung von Pixel angesehen werden. Interessanter ist, dass diese großartige App derzeit nur als iOS-Version verfügbar ist.

Ist das nicht eine Art Google-Orthodoxie bei Apple?

Überlassen Sie nicht den Algorithmen die Anerkennung für Fotos

Veränderung ist die einzige Konstante; Glück währt nie ewig.

Die Computerfotografie, ein Begriff, der in ihren Anfängen einst für Technologie und Fortschritt stand, erlebte in der Folgezeit einen Abwärtstrend.

Nach der Veröffentlichung von Pixel wurde Google Camera zur nativen Kamera von Pixel und verschwand allmählich aus der eigenständigen App. Der Anpassungsaufwand nahm stark zu. Darüber hinaus erregte die kontinuierliche Verbesserung inländischer Mobiltelefone allmählich die Aufmerksamkeit aller und erlangte Anerkennung, was wiederum die Aufmerksamkeit der Nutzer von Google Camera ablenkte.

![]()

▲ Beginnend mit der klassischen „Laseraugen“-Pixel-8-Serie begann Pixel Camera mit der Systemintegration

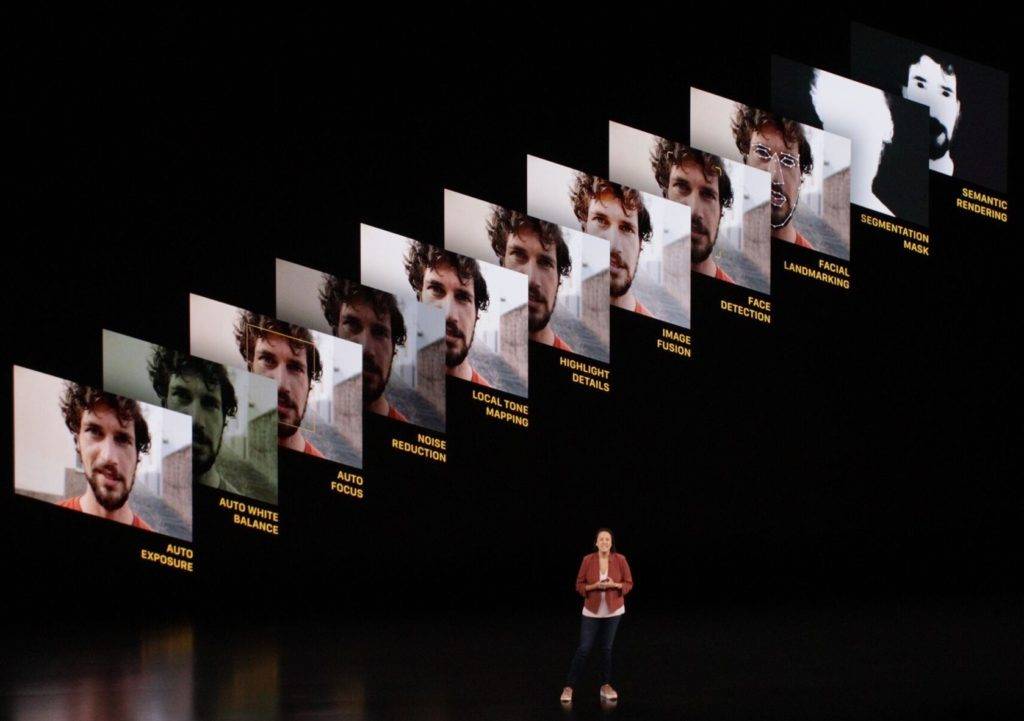

Auf der anderen Seite hat Apple, das die Hälfte des Mobiltelefon-Ökosystems einnimmt, die Deep Fusion-Technologie in der iPhone 11-Serie vollständig eingeführt. Es verwendet auch die Multi-Frame-Stacking-Technologie, hat jedoch gemischte Kritiken erhalten.

Beim iPhone ohne Deep Fusion ist der Effekt zwar natürlich, die Bildqualität leidet jedoch darunter und wurde schließlich bei späteren Prozessor-Upgrades schrittweise eliminiert.

▲ Das bekannte Deep Fusion ist da

Seitdem ist der Begriff „Computerfotografie“ zunehmend mit negativen Assoziationen behaftet – die Fotos sind stark verwischt, überschärft und wirken stark fragmentiert. Diese unangenehmen visuellen Adjektive sind allmählich zu stereotypen Bezeichnungen für die Fotografie geworden.

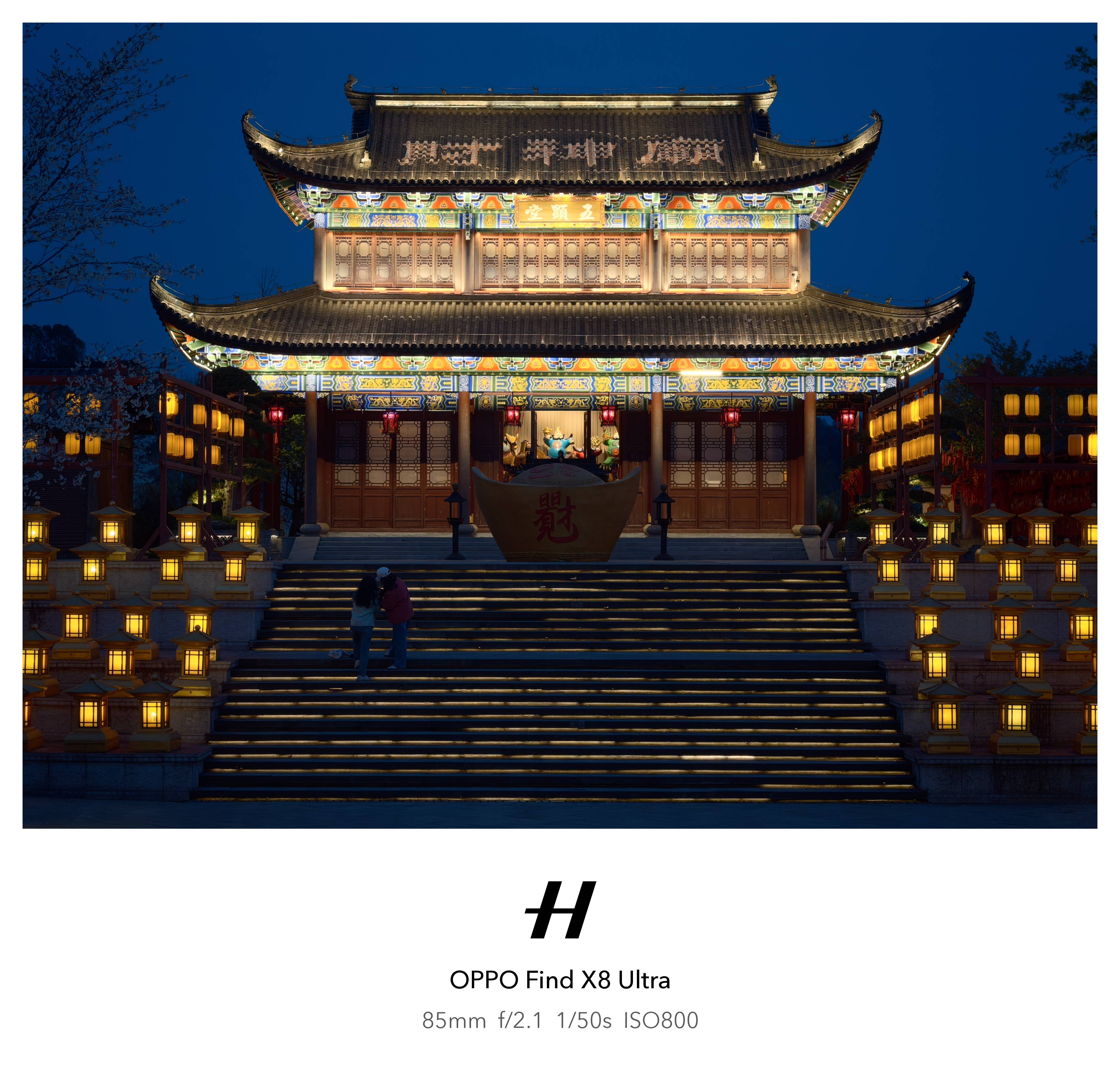

Dieses Jahr hat sich einiges geändert. Das OPPO Find X8 Ultra verfügt über einen „Master-Modus“, der angeblich speziell für Fotografen entwickelt wurde. Sein Bildstil ist zurückhaltender und weicher als bei herkömmlicher Computerfotografie: Er unterdrückt effektiv das durch digitale Schärfung verursachte Fragmentierungsgefühl und bietet gleichzeitig eine natürlichere Helligkeitskurve.

Es ist jedoch etwas bedauerlich, dass trotz der Bemühungen um Optik, Haptik und Weichheit die Schärfe des Master-Modus nicht erhalten bleibt, die Klarheit der Objektränder abnimmt und der Bildqualität etwas Festigkeit fehlt.

Der Ansatz von Project Indigo ist radikaler. Es verfolgt den Algorithmus, die Leistung bis zum Äußersten zu steigern und Dutzende von Fotos in einem Durchgang zu synthetisieren, wobei die negativen Auswirkungen der Berechnungen auf den fertigen Film vollständig eliminiert werden und die Berechnung nur im Prozess erfolgt. Das Endergebnis ist ein Foto mit natürlicher Optik, linearer Helligkeit und Online-Schärfe.

Man kann sagen, dass dies die beste Bildbearbeitungs-App ist, die ich bisher gesehen habe, die Algorithmen von fertigen Produkten trennt.

Letztlich rühren unsere Zweifel an der Computerfotografie tatsächlich von unserem Ekel vor den offensichtlichen „Bearbeitungsspuren“ in den Fotos her.

Ja, Algorithmen sind tatsächlich wichtig und sie arbeiten sehr hart, aber was die Leute wollen, ist einfach nur ein ganz normales gutes Foto, wie Marc Levoy sagte, für das man keine professionelle Ausrüstung braucht, sondern das allein durch Berechnung unerwartete Ergebnisse hervorbringen kann.

Anstatt ein Stück Papier mit einem darauf geschriebenen Algorithmus, der die Anerkennung beansprucht.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von iFanr: iFanr (WeChat-ID: ifanr), wo Ihnen so bald wie möglich weitere spannende Inhalte präsentiert werden.