Claude 4 Kernmitglied: Im Jahr 2027 wird KI fast alle Bürojobs automatisieren 10.000-Wörter-Konversation

KI-Codierung, das Hauptthema der KI-Branche in diesem Jahr, ist in letzter Zeit immer deutlicher geworden.

Neben dem neuen Programmierkönig Claude Opus 4, der letzte Woche die Bildschirme dominierte, konzentrierte sich auch die neue Version von DeepSeek R1 auf Code-Funktionen. Vor nicht allzu langer Zeit erwarb OpenAI den KI-Programmierassistenten Windsurf für 3 Milliarden US-Dollar und veröffentlichte dann den Programmieragenten Codex.

In den letzten Tagen haben Ming Chaoping, der ehemalige Produktmanager von Kimi, und Meituan, das mit JD.com streitet, offiziell Produkte im Zusammenhang mit der KI-Programmierung angekündigt.

Ein C++-Entwickler mit über 30 Jahren Erfahrung postete auf Reddit, dass Claude Opus 4 einen Fehler behoben habe, der ihn seit vier Jahren beschäftigt habe, und dass es die erste KI sei, die er verwendet habe, die dazu in der Lage sei.

Warum ist Claude so herausragend im Programmieren? Wenn man heute von Anthropic spricht, geht man fast davon aus, dass es sich um ein Unternehmen handelt, das Programmiermodelle entwickelt. Doch was ist für sie der eigentliche Durchbruch dieser Modellgeneration? Was wird in Zukunft passieren?

Vor einigen Tagen beantwortete ein Podcast-Gespräch mit Sholto Douglas, einem zentralen Forscher bei Claude Opus 4, diese Fragen ausführlich. Es ist sehr informativ und hörenswert.

Wichtige Diskussionspunkte (für eine schnellere Anzeige):

Claude Opus 4, welche Durchbrüche sind wirklich beachtenswert?

Zunächst einmal sind die Fähigkeits-Upgrades sehr ausgewogen.

Einerseits wurde die Fähigkeit zur Codeausführung deutlich verbessert. Es kann nicht nur komplexe Anforderungen verstehen, sondern auch selbstständig nach Informationen suchen, Tests ausführen und Fehler beheben. Es verfügt somit über die Fähigkeit, von Anfang bis Ende zu arbeiten. Andererseits wurde auch die Aufgabenlaufzeit deutlich verlängert und unterstützt mehrstufiges Denken und Ausführen von Operationen. Das bedeutet, dass es nicht nur intelligent, sondern auch sehr ausdauernd ist.

In puncto Architektur ergänzt Claude Opus 4 Tool-Aufrufe und Langzeitspeichermodule, wodurch Aufgaben mit mehr Kontextkontinuität bearbeitet werden können. Vom Code-Assistenten hat es sich zu einem intelligenten Agenten entwickelt, der „Lösungen entwerfen“ kann.

Natürlich gibt es eine Obergrenze.

Das Team räumt ein, dass es hinsichtlich der intellektuellen Komplexität der Aufgabe keine klare Obergrenze gibt. Die Schwierigkeit liege darin, die Bandbreite der Kontexte, die das Modell wahrnehmen und verarbeiten kann, zu erweitern, sodass es mehrere Tools verwenden und sich mehr Schlüsselinformationen merken kann.

Wie sieht die Zukunft aus?

Sholto Douglas nannte im Podcast mehrere klare Anweisungen:

- Durch bestärkendes Lernen (RL) wird die Leistung des Modells bei kontinuierlichen Aufgaben weiter verbessert.

- Code-Agenten können stundenlang mit nur gelegentlichem menschlichen Eingreifen ausgeführt werden.

- Models können zu „virtuellen Remote-Mitarbeitern“ in wissensbasierten Berufen werden;

- Wenn der Bau automatisierter Labore und Roboterplattformen weiter voranschreitet, können die Modelle an realen physikalischen Aufgaben wie biologischen Experimenten oder der Fertigung teilnehmen.

Voraussetzung dafür ist allerdings, dass die Zuverlässigkeit des intelligenten Agenten mithalten kann.

Obwohl der Erfolg noch nicht hundertprozentig gesichert ist, steigt die Erfolgsquote innerhalb kurzer Zeit stetig an. Es wird erwartet, dass programmierbare intelligente Agenten bis Ende 2025 „mehrere Stunden lang stabil laufen“ können und nur noch gelegentlich durch den Menschen überprüft werden müssen.

Außer Code zu schreiben?

Die Programmierung ist lediglich ein „Frühindikator“ für die Leistungsfähigkeit von Modellen. Auch Berufsfelder wie Medizin und Recht warten noch auf die Verbesserung von Daten und Werkzeugen. Sobald diese bereit sind, werden auch sie rasche Durchbrüche ermöglichen. Der aktuelle Engpass ist nicht die KI selbst, sondern der Verifizierungsmechanismus und die Infrastruktur in der realen Welt.

Bis 2027–2030 wird das Modell in der Lage sein, fast die gesamte Büroarbeit zu automatisieren. Ohne entsprechende Labore und Feedback-Mechanismen in der realen Welt wird es jedoch „starke Fähigkeiten haben, aber schwer umzusetzen sein“.

Wie lässt sich beurteilen, ob sich das Modell wirklich verbessert hat?

Das Team betonte, dass ein gutes Bewertungssystem (Evals) besonders wichtig sei. Es misst nicht nur technische Indikatoren, sondern betont auch das Fachwissen und den Geschmack des Bewerters. Deshalb wird die Hürde für die Modellbewertung immer höher. Gleichzeitig erfordert es von den Nutzern kontinuierliche Nutzung, Interaktion und Feedback, um eine echte „Ko-Evolution“ zu ermöglichen.

Labore vs. Anwendungsunternehmen, wer hat die Oberhand?

Douglas ist davon überzeugt, dass das Labor durch offene APIs neue Möglichkeiten bietet, die Kernvorteile bleiben jedoch bestehen:

- Fähigkeit zur Umwandlung von Rechenleistung;

- Modellieren Sie „Einstellbarkeit“ und Benutzervertrauen;

- Größeres persönliches Verständnis.

Das Labor ist wie ein Hersteller intelligenter Motoren und konzentriert sich auf die Grenzen seiner Leistungsfähigkeit. Das Anwendungsunternehmen ist besser in der Implementierung und im Nutzererlebnis. In Zukunft wird es zwischen beiden immer mehr Überschneidungen, Integrationen und Wettbewerb geben.

Wird das Modellunternehmen anderen Unternehmen aufgrund seiner Kosten und der damit verbundenen Vorteile den Weg versperren? Douglas ist der Meinung:

Nein, im Gegenteil, es bringt Vitalität.

Er glaubt, dass alle Schutzgräben irgendwann durchbrochen werden und dass es wirklich auf die Kundenbeziehungen, die Koordination der Aufgaben und eine integrierte Erfahrung ankommt.

Das letzte Schlüsselwort ist „Ausrichtung“

Mit der Verbesserung der Modellfähigkeiten gewinnt das Problem der „Ausrichtung“ an Bedeutung. Anthropic fördert die Interpretierbarkeitsforschung und versucht, „die Denkweise des Modells zu verstehen“. Obwohl Reinforcement Learning die Fähigkeiten verbessern kann, kann es auch bestehende Ausrichtungsmechanismen zerstören. Künftig wird es darauf ankommen, dass Universitäten, Regierungen und weitere Forscher gemeinsam die „Ausrichtungswissenschaft“ vorantreiben.

Link zum Originalvideo: https://www.youtube.com/watch?v=W1aGV4K3A8Y

Nachfolgend finden Sie die Abschrift des Interviews, die von APPSO leicht bearbeitet wurde.

Moderator: Sholto Douglas ist eines der Kernmitglieder des Anthropic Claude 4-Modells, und es war diesmal ein tolles Gespräch mit ihm. Wir sprachen über viele Themen, unter anderem darüber, wie Entwickler die Entwicklungstrends der neuen Anthropic-Modellgeneration einschätzen. Wir diskutierten die Entwicklungsrichtung dieser Modelle in den nächsten sechs, zwölf und sogar zwei bis drei Jahren. Wir sprachen auch über die Schlüsselfaktoren für die Entwicklung zuverlässiger KI-Agenten und darüber, wann diese Modelle in Fachbereichen wie Medizin, Recht und Programmierung Durchbrüche erzielen werden. Darüber hinaus teilte Douglas seine Ansichten zur „Alignment Research“ und seine Reaktion auf die „AI 2027“-Prognose. Dies ist ein wunderbares Gespräch, und ich bin überzeugt, dass es allen gefallen wird.

Wichtige Durchbrüche und zukünftige Möglichkeiten von Claude Opus 4

Moderator: Wenn dieser Podcast online ist, dürfte Claude 4 bereits veröffentlicht sein und die Leute sollten bereits damit experimentieren können. Mich würde interessieren: Sie waren einer der Ersten, die diese Modelle in die Hände bekamen. Was begeistert Sie am meisten daran?

Douglas: Das ist wirklich ein weiterer großer Fortschritt in der Softwareentwicklung. Das Opus-Modell ist in dieser Hinsicht wirklich herausragend. Ich erlebe oft Momente, in denen ich ihm eine sehr komplexe Aufgabe gebe, die unsere umfangreiche Codebasis betrifft, und es kann diese fast vollständig autonom erledigen . Es recherchiert Informationen, versteht Anforderungen, führt Tests durch und arbeitet dabei sehr selbstständig und effizient. Ich bin immer wieder von dieser Leistung begeistert.

Moderator: Jedes Mal, wenn eine neue Generation von Modellen herauskommt, müssen wir unsere kognitiven Modelle anpassen, um zu beurteilen, was funktioniert und was nicht. Hat sich Ihr Einsatz und Verständnis dieser Modelle in der Programmierung verändert?

Douglas: Ich denke, die größte Veränderung ist die Verbesserung des Zeithorizonts. Die Verbesserung der Modellfähigkeiten lässt sich meiner Meinung nach an zwei Dimensionen erkennen: der intellektuellen Komplexität der Aufgabe und dem Kontextumfang bzw. der Anzahl aufeinanderfolgender Aktionen, die sinnvoll begründet und verarbeitet werden können. Diese Modelle haben sich in der zweiten Dimension deutlich verbessert. Sie können tatsächlich mehrstufige Operationen durchführen, bestimmen, welche Informationen aus der Umgebung benötigt werden, und dann basierend auf diesen Informationen Maßnahmen ergreifen. Darüber hinaus können sie Tools wie Cloud Code aufrufen, was nicht nur einfaches Kopieren und Einfügen ermöglicht, sondern über leistungsfähigere Ausführungsfunktionen verfügt. Ich kann mir vorstellen, dass sie jetzt mehrere Stunden am Stück arbeiten, und ihre Effizienz entspricht der von kontinuierlicher menschlicher Arbeit.

Moderator: Wo sollten Ihrer Meinung nach Leute anfangen, die Claude 4 zum ersten Mal verwenden?

Douglas: Ich denke, der beste Weg ist, es direkt in Ihre Arbeit einzubeziehen. Wenn Sie zum Beispiel heute Code schreiben möchten, lassen Sie es einfach für Sie arbeiten und beobachten Sie, wie es die Informationen bewertet und den nächsten Schritt entscheidet. Ich garantiere Ihnen, dass Sie von seiner Leistung begeistert sein werden.

Moderator: Diese Modellgeneration ist leistungsfähiger, und viele planen, sie für die Entwicklung von Produkten zu nutzen. Welche neuen Möglichkeiten ergeben sich Ihrer Meinung nach für Entwickler?

Douglas: Mir hat der Begriff „exponentielles Produktwachstum“ schon immer gefallen. Entwickler müssen ihre Modellfähigkeiten ständig weiterentwickeln, um Produkte zu konzipieren . Beispiele wie Cursor, Windsurf und Devon sind dafür typisch. Cursor begann mit der Entwicklung zukünftiger Programmiererfahrungen, als seine Modellfähigkeiten noch nicht ausreichten. Ihre Vision wurde erst mit Claude 3.5 und Sonne wirklich verwirklicht. Windsurf ging einen Schritt weiter und eroberte einen Teil des Marktes. Ihr Erfolg verdankt sie der Nutzung dieses exponentiellen Wachstumsfensters.

Jetzt sieht man Claude Code, die neue GitHub-Integration, OpenAIs Codecs, Googles Coding Agent usw. Alle arbeiten am Konzept des „Coding Agents“ mit dem Ziel, eine höhere Autonomie und asynchronen Betrieb zu erreichen. In Zukunft wird man vielleicht nicht mehr im Minutentakt arbeiten, sondern eine KI-Modellflotte verwalten, in der mehrere Modelle ihre eigenen Aufgaben übernehmen und zusammenarbeiten. Ich denke, diese Richtung ist eine Erkundung wert.

Moderator: Haben Sie schon einmal ein Szenario wie die „multi-modellparallele Zusammenarbeit“ gesehen? Wie würde es aussehen?

Douglas: Ich kenne viele Freunde bei Anthropic, die mehrere Instanzen von Claude Code gleichzeitig in verschiedenen Umgebungen betreiben, was ziemlich cool aussieht. Aber ehrlich gesagt hat noch niemand wirklich herausgefunden, wie das geht. Hier wird tatsächlich ausgelotet, wie groß die menschliche „Management-Bandbreite“ sein kann. Ich denke, das ist eine der Schlüsselfragen für die zukünftige wirtschaftliche Entwicklung: Wie messen wir die Produktivitätsrendite eines Modells? Anfangs müssen wir die Ergebnisse des Modells noch manuell prüfen, was bedeutet, dass der Einfluss des Modells durch die menschlichen Managementfähigkeiten begrenzt wird. Sofern wir nicht eines Tages dem Modell die Verwaltung des Modells anvertrauen können, wird diese Verbesserung der Abstraktionsebene entscheidend sein.

Moderator: Wenn Sie das Modell also alle 15 Minuten, jede Stunde oder alle 5 Stunden überprüfen, ist die Anzahl der Modelle, die Sie verwalten können, sehr unterschiedlich?

Douglas: Ja, Jen-Hsun Huang hat etwas Ähnliches gesagt. Er sagte, er sei von 100.000 superintelligenten künstlichen Intelligenzen umgeben und habe enormen Einfluss. Er sagte auch, er sei der „Kontrollfaktor“ in Nvidias Führungskette. Ich denke, es könnte sich in Zukunft tatsächlich in diese Richtung entwickeln.

Moderator: Die vielleicht wichtigste Branche der Zukunft wird das „Organisationsdesign“ selbst sein.

Douglas: Ja, auch darüber, wie man Vertrauen aufbaut und wie komplex die Organisationsstruktur sein wird, sollte man gründlich nachdenken.

Geheimwaffe: Erweiterte Zeitspanne, RL-gesteuertes intelligentes Agent-Upgrade

Moderator: Sie haben ein Jahr bei McKinsey gearbeitet. Kann die Beratungsbranche auch neue Produktlinien auf Basis dieser Modelle entwickeln? Ich stimme Ihnen zu: Anwendungsunternehmen müssen dem Modell einen Schritt voraus sein. Cursor hatte beispielsweise anfangs Schwierigkeiten, seine Produkte auf den Markt zu bringen, erlebte aber einen explosionsartigen Aufschwung, nachdem die Modellfunktionen etabliert waren. Was bedeutet Ihrer Meinung nach „einen Schritt voraus“ konkret?

Douglas: Es bedeutet, das Produkt ständig neu zu erfinden, damit es auch Monate später immer mit den neuesten Modellfunktionen kompatibel ist. Gleichzeitig muss man in engem Kontakt mit den Nutzern bleiben, um sicherzustellen, dass das Produkt bereits im Einsatz ist, aber auch erweiterte Modellfunktionen integrieren kann.

Moderator: Ich denke, das ist das Geheimnis: Wenn Sie noch auf die Verbesserung des Modells warten, bevor Sie beginnen, haben andere Ihnen möglicherweise bereits die Nutzer weggeschnappt. Sie haben viele Durchbrüche in den Bereichen Speicher, Befehlsausführung und Tool-Nutzung erzielt. Können Sie die aktuellen Fortschritte in verschiedenen Bereichen kurz zusammenfassen? Welche davon sind ausgereift und welche werden noch erforscht?

Douglas: Ein guter Ansatzpunkt für die Fortschritte des vergangenen Jahres ist die Tatsache, dass Reinforcement Learning (RL) endlich an Sprachmodellen arbeitet. Die intellektuelle Komplexität der Aufgaben, die Modelle lösen können, wie beispielsweise komplexe Mathematik- und Programmierprobleme, ist praktisch unbegrenzt. Die meisten dieser Aufgaben werden jedoch in einem begrenzten Kontext erledigt. Die Herausforderung in Bezug auf Gedächtnis und Werkzeugeinsatz besteht darin, die Bandbreite der Kontexte zu erweitern, die Modelle wahrnehmen und bedienen können.

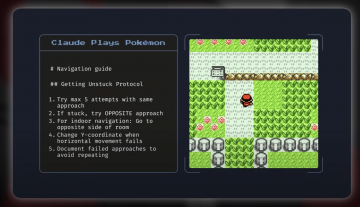

Beispielsweise ermöglichen Mechanismen wie MCP (Model Context Protocol) dem Modell die Interaktion mit der Außenwelt, und der Speicher ermöglicht die Bearbeitung von Aufgaben über einen längeren Zeitraum, was auch ein personalisierteres Erlebnis ermöglicht. Diese Fortschritte bilden im Wesentlichen die Schlüsselfähigkeitskette „intelligenter Agenten“. Pokemon Eval ist übrigens eine sehr interessante experimentelle Methode.

Moderator: Ich war als Kind ein großer Fan des Spiels. Ich finde, das ist eine tolle Rezension und hoffe, dass ihr sie zusammen mit diesem Modell veröffentlichen könnt.

Douglas: Ja, das ist ein sehr interessanter Test. Das Modell wurde nicht speziell für Pokémon Go trainiert, zeigte aber dennoch gute Ergebnisse und eine starke Generalisierung. Diese Aufgabe ist nicht völlig neu, unterscheidet sich aber von bisherigen Tests.

Moderator: Ich erinnere mich, dass es im Spiel viele Treppen und Labyrinthe gab und die Modelle einem dabei helfen konnten, diese zu überwinden.

Douglas: Ja, ein weiteres Beispiel, das mir besonders gefällt, ist der „Interpretable Agent“, den wir kürzlich entwickelt haben. Ursprünglich war er ein Programmieragent, aber er kann automatisch lernen, Werkzeuge zur Neuronenvisualisierung nutzen und im Selbstdialog versuchen, die interne Struktur des Modells zu verstehen. Er kann sogar eine Sicherheitsüberprüfung namens „Audit Game“ bestehen – er findet die vom Modell absichtlich gesetzten Fehler, generiert Hypothesen und überprüft Fragen selbstständig. Diese Art von Werkzeug und die Fähigkeit zur Generalisierung im Gedächtnis sind wirklich großartig.

Die Achillesferse intelligenter Agenten: Zuverlässigkeit

Moderator: Es klingt, als würden intelligente Agenten immer leistungsfähiger. Sie haben bereits gesagt, der Schlüssel zu VA-Agenten sei „Verlässlichkeit“. Wo stehen wir Ihrer Meinung nach derzeit?

Douglas: In Bezug auf die Erfolgsquote innerhalb eines bestimmten Zeitraums haben wir große Fortschritte gemacht. Obwohl wir noch keine hundertprozentige Stabilität erreicht haben, besteht immer noch eine Lücke zwischen dem ersten und mehreren Versuchen des Modells. Der Trend geht jedoch stetig in Richtung „Zuverlässigkeit auf Expertenniveau“.

Moderator: Was würde Ihrer Meinung nach Ihre optimistische Sichtweise ändern?

Douglas: Sollte das Modell Mitte nächsten Jahres einen Engpass bei der Aufgabendauer feststellen, ist Wachsamkeit geboten. Beispielsweise ist die Programmierung ein guter Frühindikator für den Fortschritt – sobald sie nachlässt, deutet dies auf strukturelle Probleme hin. Natürlich kann es auch sein, dass Daten zu knapp sind, was es beispielsweise schwierig macht, Aufgaben wie die „menschliche Nutzung von Software“ zu trainieren. Wir sehen jedoch derzeit erstaunliche Fortschritte bei solchen Aufgaben, daher bin ich insgesamt weiterhin optimistisch.

Moderator: Wann werde ich Ihrer Meinung nach einen „universellen Assistenten“ haben, der für mich verschiedene Formulare ausfüllen, online nach Informationen suchen usw. kann?

Douglas: „Persönliche Verwaltungsassistenten“ sind ein heißes Thema. Wer möchte nicht gerne triviale Aufgaben an KI übergeben? Aber es kommt wirklich auf die Situation an. Entscheidend ist, ob das Modell ähnliche Situationen geübt hat. Man kann nicht einfach jemanden für Finanzaufgaben finden, oder? Ein ausgebildeter „virtueller Buchhalter“ hingegen ist deutlich zuverlässiger. Die Zuverlässigkeit der Aufgabe hängt also maßgeblich vom Trainingshintergrund ab. Wenn alles gut geht, werden wir diese Agenten Ende dieses Jahres Aufgaben im Browser ausführen sehen; nächstes Jahr wird es praktisch Standard sein.

Moderator: Das ist wirklich spannend. Ihr Modell funktioniert beim Programmieren so gut. Haben Sie ihm beim Training Priorität eingeräumt? Wenn man heute von Anthropic spricht, denkt man an „Programmiermodell“.

Douglas: Ja. Wir legen großen Wert auf die Programmierung, da sie ein Schlüsselfaktor für die Beschleunigung der KI-Selbstforschung ist. Wir investieren auch viel Energie in die Messung des Fortschritts der Programmierfähigkeiten. Man kann sagen, dass wir uns bewusst auf diesen Bereich konzentrieren.

Moderator: Beschleunigen diese Agenten jetzt die KI-Forschung?

Douglas: Meiner Meinung nach ja. Sie steigern die Effizienz im Engineering deutlich. Selbst einige meiner Top-Ingenieure berichten von einer 1,5-fachen Effizienzsteigerung in vertrauten Bereichen; in unbekannten Bereichen, wie neuen Sprachen oder unbekannten Inhalten, beträgt die Verbesserung sogar das Fünffache. Beim „Grenzüberschreiten“ ist die Hilfe also deutlicher. Die entscheidende Frage ist: Glauben Sie, dass unser aktueller Engpass die Rechenleistung ist? Falls nicht, dann ist die Teilnahme von KI-Agenten an der Forschung gleichbedeutend mit der Erweiterung eines ganzen Forschungsteams, und die Effizienzsteigerung ist um ein Vielfaches höher.

Moderator: Ich vermute, diese Agenten erledigen immer noch hauptsächlich mühsame Aufgaben und sparen Ihnen Zeit, über wichtigere Probleme nachzudenken. Wann werden sie also anfangen, aktiv wertvolle Forschungsideen zu entwickeln?

Douglas: Im Moment bearbeiten sie hauptsächlich Ingenieuraufgaben, aber es entwickeln sich bereits einige kreative Ideen. Ich wage nicht zu behaupten, dass sie in drei Monaten explodieren werden, aber in zwei Jahren sollten wir sehen, wie sie immer mehr interessante wissenschaftliche Ideen entwickeln. Natürlich hängt dies auch von einem guten Feedback-Mechanismus ab. Genau wie Menschen müssen sich auch Modelle komplexe Aufgaben durch Übung und Ausprobieren aneignen, um letztendlich qualitativ hochwertige Ergebnisse zu erzielen.

Moderator: Weil diese Bereiche relativ einfach zu überprüfen sind, nicht wahr? Wird es passieren, dass KI in der Programmierung schnelle Fortschritte macht, aber in Bereichen wie Medizin und Recht, die nicht so einfach zu überprüfen sind, keine Fortschritte erzielt werden?

Douglas: Tatsächlich besteht dieses Risiko. Die gute Nachricht ist jedoch, dass die Verifizierungsschwelle in der Forschung zum maschinellen Lernen selbst sehr niedrig ist. Beispielsweise ist die Frage, ob der Verlustwert gesunken ist, ein sehr deutlicher Indikator. Solange das Modell in der ML-Forschung gute Ideen hervorbringt, meistert es eine sehr anspruchsvolle RL-Aufgabe, die für KI besser geeignet ist als viele Softwareentwicklungsaufgaben. Obwohl Bereiche wie die Medizin schwer zu verifizieren sind, machen auch sie Fortschritte. OpenAI hat kürzlich eine medizinische Frage-und-Antwort-Studie veröffentlicht, in der Fragen mit langen Antworten mithilfe eines detaillierteren Bewertungsmechanismus quantifiziert wurden. Ich halte diese Methode für sehr vielversprechend und wird das Problem der schwierigen Verifizierung in Zukunft zwangsläufig schrittweise lösen.

Moderator: Wann werden wir also „irgendwann“ wirklich gute medizinische oder juristische Assistenten haben? Werden sie Teil des großen Modells sein?

Douglas: Auf jeden Fall.

Moderator: Glauben Sie, dass sie Teil eines größeren allgemeinen Modells werden oder wird es spezielle Modelle geben, die speziell für medizinische oder juristische Zwecke entwickelt werden?

Douglas: Ja. Ich bin ein Verfechter großer Modelle. Obwohl Personalisierung wichtig ist – das Modell soll Ihr Unternehmen, Ihre Arbeitsgewohnheiten und Ihre persönlichen Präferenzen verstehen – sollten diese Anpassungen auf Unternehmens- oder individueller Ebene erfolgen, anstatt das Modell nach Branchen aufzuteilen. Unsere Zusammenarbeit mit Databricks spiegelt diese Ausrichtung der Unternehmensanpassung wider. Was die zugrunde liegenden Fähigkeiten angeht, bin ich jedoch fest davon überzeugt, dass wir uns weiterhin auf ein einziges, leistungsstarkes allgemeines Modell verlassen müssen. In Zukunft sollten wir Rechenleistung (z. B. FLOPs) dynamisch entsprechend der Komplexität der Aufgabe zuweisen, anstatt eine Reihe verschiedener kleiner Modelle zu erstellen. Deshalb bin ich optimistisch, was den Weg zu großen Modellen angeht.

„KI 2027“: Werden Bürojobs vollständig ersetzt?

Moderator: Sie sind sehr zuversichtlich, dass das Modell kontinuierlich verbessert wird. Viele fragen sich, welche Auswirkungen die verbesserten Modellfunktionen auf die Gesellschaft haben werden. Eine häufig gestellte Frage lautet beispielsweise: Wie stark werden diese Modelle in den nächsten Jahren das globale BIP beeinflussen?

Douglas: Ich denke, die ersten Auswirkungen werden wahrscheinlich dem Aufstieg Chinas ähneln, vergleichbar mit den Veränderungen in Shanghai über Jahrzehnte, nur diesmal deutlich schneller. Wir müssen die Auswirkungen jedoch in verschiedenen Bereichen unterscheiden. Bis 2027 oder 2028 sind wir fast sicher, dass es Modelle geben wird, die fast alle Bürojobs automatisieren können, und um 2030 wird es noch sicherer sein. Denn Bürojobs eignen sich sehr gut für bestehende KI-Architekturen – es gibt Daten, Feedback und sie können grundsätzlich von Computern erledigt werden.

Robotik und biologische Forschung sind jedoch völlig anders. Um beispielsweise ein Superprogrammierermodell zu entwickeln, benötigt man nur viel Code und Rechenleistung. Für ein Superbiologenmodell hingegen braucht man ein automatisiertes Labor, um Hypothesen aufzustellen und zu überprüfen sowie groß angelegte Experimente durchzuführen. Bei dieser Art von Hardware und Infrastruktur sind wir noch weit zurück.

Ich befürchte daher ein Missverhältnis : Die Arbeitsplätze der Angestellten verändern sich rasant, während sich Branchen wie das Gesundheitswesen und die Fertigung, die die Lebensqualität der Menschen wirklich verbessern können, aufgrund unzureichender Infrastruktur nur langsam entwickeln. KI an sich ist sehr leistungsfähig, doch damit sie in der realen Welt funktioniert, müssen wir im Vorfeld unterstützende Einrichtungen in der physischen Welt schaffen, beispielsweise Cloud-Labore und Roboterplattformen.

Moderator: Aber bis dahin könnten bereits Millionen von KI-Forschern Experimente vorschlagen. Sie benötigen dafür möglicherweise keine derart groß angelegten Robotersysteme oder biologischen Daten.

Douglas: Es stimmt, dass die KI rasche Fortschritte macht, aber um diese Fähigkeiten wirklich in BIP-Wachstum umzuwandeln, müssen wir auch den „Real-World-Feedback-Mechanismus“ aktivieren, um den Wert der Technologie wirklich freizusetzen.

Moderator: Sie glauben also, dass künftig jeder Angestelltenberuf einen Bewertungsmechanismus wie die Medizin entwickeln kann? Was mich am meisten überrascht hat, ist, dass wir nicht allzu viele Daten benötigen, um ein so leistungsstarkes Modell zu trainieren.

Douglas: Ich stimme voll und ganz zu. Wir haben bewiesen, dass Modelle eine Vielzahl von Aufgaben erlernen können, und wir haben noch keine klare Obergrenze ihrer Intelligenz gesehen. Auch wenn die Stichprobeneffizienz des Modells möglicherweise nicht so gut ist wie die des Menschen, spielt das keine Rolle – denn wir können Zehntausende von Modellkopien gleichzeitig ausführen, die parallel verschiedene Wege ausprobieren und „virtuelle Erfahrung“ sammeln. Selbst wenn die Effizienz etwas geringer ist, kann sie durch Skalierung ausgeglichen werden und schließlich das menschliche Niveau erreichen oder sogar übertreffen.

Moderator: Es klingt, als ob Sie den aktuellen Ansatz für zukünftige Entwicklungen für ausreichend halten. Manche meinen, wir bräuchten noch neue algorithmische Durchbrüche. Was meinen Sie?

Douglas: Die meisten KI-Experten sind derzeit der Ansicht, dass das Paradigma „Pre-Training + Reinforcement Learning“ (Pre-Training + RL) ausreicht, um zu allgemeiner Künstlicher Intelligenz (AGI) zu gelangen. Bisher gibt es keine Anzeichen für eine Verlangsamung dieses Weges, und diese Kombination ist effektiv. Natürlich kann es andere, schnellere Durchbruchspfade geben, und es könnten sogar neue Gipfel erklommen werden. Beispielsweise könnte Ilya (Sutskever) der Miterfinder dieser beiden Mainstream-Paradigmen sein, und ich würde ihn nicht in Frage stellen. Alle Belege deuten darauf hin, dass der aktuelle technische Weg stark genug ist. Natürlich ist es auch möglich, dass Ilya aus finanziellen Gründen einen neuen Weg gewählt hat oder ihn für den besseren hält, aber ich persönlich bin überzeugt, dass unser aktueller technischer Weg uns zu unseren Zielen führen kann.

Moderator: Wird Energie der nächste Engpass sein? Wann, glauben Sie, werden wir tatsächlich auf dieses Problem stoßen?

Douglas: Ich denke, bis 2028 werden 20 % der US-Energie für KI verwendet. Wenn wir diesen Anteil um ein Vielfaches steigern wollen, müssen wir die Energiestruktur drastisch umgestalten. Die Regierung sollte hier mehr Verantwortung übernehmen. Chinas Energieproduktionskapazität wächst beispielsweise deutlich schneller als die der USA. Dies wird in Zukunft ein entscheidender Engpass sein.

Der Maßstab der Modellverbesserung: ein zuverlässiges Bewertungssystem

Moderator: Welche Indikatoren sind Ihrer Meinung nach im Zuge der Modellentwicklung besonders beachtenswert? Zum Beispiel die Entwicklungsrichtung von Claude 4 zur nächsten Modellgeneration?

Douglas: Viele Unternehmen verfügen über sehr strenge interne Bewertungssysteme, und ich gehe bei diesen Bewertungen gerne neue Wege. Komplexe Tests wie „Frontier Math“ sind sehr anspruchsvoll und stoßen an die Grenzen der Modellintelligenz. Wichtiger noch: Wir müssen Bewertungen entwickeln, die den Arbeitsablauf und damit den täglichen Arbeitsrhythmus eines Menschen wirklich erfassen. Diese Art der Bewertung kann uns helfen, besser einzuschätzen, ob das Modell den menschlichen Fähigkeiten nahe kommt oder sie übersteigt. Ich denke, die Regierung sollte hier eine Rolle spielen.

Moderator: Als Unternehmen mit Basismodell sollte neben Algorithmen und Infrastruktur eine der zentralen Herausforderungen für Sie der Aufbau eines guten Bewertungssystems sein. Für wie wichtig halten Sie „Bewertungsfähigkeiten“ in Ihrem Unternehmen?

Douglas: Evaluationsfähigkeit ist das Wichtigste. Ohne ein gutes Evaluationssystem kann man nicht wissen, ob man Fortschritte macht. Öffentliche Evaluationen sind schwierig, und wir brauchen weiterhin ein zuverlässiges und stabiles internes Evaluationssystem.

Moderator: Mir ist auch aufgefallen, dass einige Entwickler, die Anwendungen auf Basis Ihres Modells erstellen, ebenfalls sehr hilfreiche Überlegungen zur Evaluierung haben. Insbesondere wenn Sie in verschiedene Branchen wie Logistik, Recht, Buchhaltung usw. einsteigen möchten, kann das Feedback externer Entwickler aufschlussreicher sein als das Ihrer internen Entwickler.

Douglas: Das stimmt. Es erfordert außerdem sehr viel Fachwissen und „Flair“ sowie ein tiefes Branchenverständnis. Früher reichte es aus, wenn normale Leute die bessere Lösung auswählten, heute brauchen wir Fachexperten für die Bewertung. Wenn ich beispielsweise die Modellergebnisse im Bereich Biologie beurteilen müsste, könnte ich möglicherweise nicht beurteilen, welches besser ist.

Zum Freund des Benutzers werden: Modellpersonalisierung und Geschmack

Moderator: Sie haben gerade den „Geschmack“ erwähnt, den ich auch sehr interessant finde. Beispielsweise beginnen viele Modelle mittlerweile, Gedächtnissysteme hinzuzufügen, und auch die Art und Weise, wie Nutzer mit Modellen interagieren, verändert sich. Viele KI-Produkte sind wirklich erfolgreich, weil sie eine gewisse Resonanz gefunden oder einen bestimmten kulturellen Zeitgeist eingefangen haben. Wie das Beispiel der Golden Gate Bridge, das Sie eingangs erwähnt haben, gibt es viele weitere kleine Funktionen, die sehr ansprechend sind. Wie wird diese Art der personalisierten „Benutzeratmosphäre“ in Zukunft aussehen?

Douglas: Ich denke, es könnte in Zukunft ein seltsames Szenario geben: Ihr Model wird zu einem Ihrer intelligentesten und charmantesten Freunde. Manche Leute betrachten Claude bereits als Freund, und ich kenne viele, die täglich stundenlang mit Claude chatten. Aber ich glaube, wir haben erst ein Prozent der Personalisierung erforscht. In Zukunft wird das Model Sie und Ihre Vorlieben viel besser verstehen.

Moderator: Wie können wir unsere Fähigkeit verbessern, „Nutzer zu verstehen“? Brauchen wir Menschen mit gutem ästhetischen Verständnis und Urteilsvermögen, die Menschen darin schulen, diesen Geschmack zu entwickeln? Wie können wir dieses Problem lösen?

Douglas: Ein Großteil der Entscheidungen über die Produktausrichtung wird tatsächlich von „Menschen mit gutem Geschmack“ getroffen. Beispielsweise ist Claudes Gesprächserfahrung gut, vor allem weil Amanda (ein Teammitglied) ein ausgeprägtes ästhetisches Gespür für „gute Produkte“ hat. Dieser „einzigartige Geschmack“ ist sehr wichtig.

Herkömmliche Feedback-Mechanismen wie „Likes/Dislikes“ können leicht zu unnatürlichen Modellergebnissen führen. Daher benötigen wir neue Wege zur Feedback-Erfassung. Modelle sind im Wesentlichen leistungsstarke „Simulatoren“. Mit ausreichend Benutzerkontext können sie automatisch lernen, Benutzerpräferenzen, Ton und Stil zu verstehen. Die Lösung besteht daher darin, die Einstellungen von Menschen mit Geschmack und kontinuierlicher Interaktion zwischen Benutzern und Modellen zu kombinieren.

Laborunternehmen vs. Anwendungsunternehmen: Offenheit und Wettbewerb

Moderator: Was ist also Ihre Prognose für die nächsten 6 bis 12 Monate?

Douglas: Als nächstes liegt der Fokus auf dem weiteren Ausbau des Reinforcement-Learning-Systems (RL), um zu sehen, welche Möglichkeiten es uns bietet. Die Modellfähigkeiten werden sich rasant verbessern, insbesondere bis zum Jahresende, wenn die Code-Agentur zu einem wichtigen Indikator wird. Bis dahin sollte das Modell mehrere Stunden lang kontinuierlich arbeiten und die Aufgabe stabil erledigen können.

Moderator: Sie meinen, die Menschen werden weniger Zeit mit der Überprüfung verbringen, richtig?

Douglas: Ja, aktuell müssen wir bei der Verwendung von Claude Code manchmal alle paar Minuten prüfen, aber bis Ende des Jahres werden wir möglicherweise Modelle sehen, die Aufgaben mehrere Stunden lang selbstständig und fehlerfrei erledigen können. Zukünftig sollten wir eine vollständige Verwaltung erreichen und sogar mehrere Aufgaben parallel verwalten können, wie beispielsweise bei „StarCraft“. Die Arbeitsgeschwindigkeit des Modells wird dann effizienter sein.

Moderator: Sie haben gerade Codec und Googles Joule erwähnt. Einige Startups machen ähnliche Dinge.

Douglas: Ja, wir werden tatsächlich auch einen GitHub-Agenten starten, den Sie von überall auf GitHub aus aufrufen können, z. B. „@Claude“, und wir übernehmen automatisch und erledigen einen Teil der Arbeit für Sie.

Moderator: Welche Faktoren werden letztendlich die Wahl der Tools oder Modelle durch die Entwickler beeinflussen?

Douglas: Neben den Fähigkeiten des Modells sind auch das Vertrauen und die Beziehung zwischen Entwicklern und Unternehmen sehr wichtig. Da die Kluft zwischen den Modellfähigkeiten immer größer wird, sollten Entwickler nicht nur technische Indikatoren berücksichtigen, sondern auch ihr Missionsbewusstsein, gemeinsam mit dem Unternehmen die Zukunft zu gestalten.

Moderator: Gerade bei der immer schnelleren Veröffentlichungsgeschwindigkeit kommt es einem so vor, als kämen jeden Monat neue Modelle auf den Markt. Heute führt dieses Modell einen Test an, morgen ein anderes Modell einen Test an, und jeder ist von der Vielzahl an Vergleichsinformationen überwältigt.

Douglas: Genau das ist der Grund, warum „GPT-Wrapper“ unerwartet populär wurden. Man hatte nicht damit gerechnet, dass ein Wrapper den Vorteil bietet, immer auf dem neuesten Stand der Modellfunktionen zu sein.

Moderator: Ich habe das Gefühl, dass jeder, der kein „Wrapper“ sein möchte, am Ende sein ganzes Geld verbrennt.

Douglas: Da stimme ich voll und ganz zu. Es ist wunderbar, an der Spitze der Modellfähigkeiten zu stehen. Natürlich gibt es auch die Kehrseite: Manche Dinge lassen sich nur vorhersagen, wenn man das zugrunde liegende Modell beherrscht. Nur dann kann man die Trendlinie erkennen und wirklich tiefgreifende Produkte entwickeln. Beispielsweise erfordern viele KI-Anwendungen für die Tiefenforschung umfangreiches internes Reinforcement-Learning-Training (RL). Solche Produkte sind von außen schwer zu imitieren und müssen im Labor entwickelt werden.

Moderator: Können Sie das näher erläutern? Unternehmen wie OpenAI und Anthropic scheinen sich zunehmend für externe Entwickler zu öffnen. Viele fragen sich aber: Was ist „laborexklusiv“? Was steht allen offen, und jeder kann mitmachen?

Douglas: Das ist eine kritische Frage. Die Einführung der RT-API (Feinabstimmbare API) verändert tatsächlich die Landschaft. Unternehmen, die sich auf ein bestimmtes vertikales Feld konzentrieren, können nun mehr Wert schaffen. Gleichzeitig hat das Labor aber weiterhin einen „zentralisierten Vorteil“.

OpenAI gewährt Kunden beispielsweise bestimmte Rabatte, wenn sie weiterhin mit Ihren Modellergebnissen trainieren. Mit anderen Worten: Sie sind nicht nur Modellanbieter, sondern auch sekundäre Datennutzer. Dieser zentralisierte Vorteil ist enorm.

Was sind die „einzigartigen Vorteile des Labors“? Ich denke, es gibt mehrere Dimensionen:

- Fähigkeit zur Umwandlung von Rechenleistung: Wie gut können Sie Rechenleistung (FLOPs), Finanzmittel und Ressourcen in Intelligenz umwandeln? Aus diesem Grund weisen Unternehmen wie Anthropic, OpenAI und DeepMind eine so herausragende Modellleistung auf.

- Die „Einsetzbarkeit“ des Modells: Wenn das Modell nach und nach zu einem „virtuellen Mitarbeiter“ wird, vertrauen Sie ihm? Gefällt es Ihnen? Sind Sie bereit, Aufgaben an es zu delegieren?

- Personalisierungsfunktionen: Ob das Modell Ihren Kontext, den Arbeitsablauf Ihres Unternehmens und Ihre persönlichen Vorlieben verstehen kann, wird ebenfalls zum Schlüssel zur Wettbewerbsdifferenzierung.

Zusammenfassend lässt sich sagen, dass Unternehmen auf Laborebene am besten darin sind, Top-Level-Modelle zu erstellen und Rechenleistung in Intelligenz umzuwandeln, während Unternehmen auf Anwendungsebene durch Fokussierung, Personalisierung und Produkterfahrung in ihren eigenen Bereichen eine Position einnehmen können. Es wird jedoch zunehmend zu Überschneidungen und Kooperationen zwischen beiden kommen.

Moderator: Ich vermute, Ihr Modell wird auch von vielen zum Aufbau von Generalagenten verwendet? Diese Unternehmen erstellen das Modell nicht selbst, sondern nutzen dafür Orchestrierung und Smart Chain Calls. Glauben Sie, dass dieser Ansatz aufgrund des Kostenvorteils des Modellunternehmens zum Scheitern verurteilt ist?

Douglas: Ich halte das nicht für schlecht. Im Gegenteil, dieser Ansatz hat den Wettbewerb deutlich gestärkt, und jeder erkundet, welche Produktform am besten geeignet ist. Modellunternehmen bieten tatsächlich einige Vorteile: Wir können beispielsweise direkt auf das zugrunde liegende Modell zugreifen, es detaillierter optimieren und wissen, welche Fähigkeiten zuerst gestärkt werden sollten.

Letztlich werden alle Schutzgräben irgendwann verschwinden – wenn man „jederzeit ein Unternehmen gründen kann“, wird alles neu aufgebaut. Wo liegt also der Kernwert der Zukunft? Liegt er in den Kundenbeziehungen? In der Fähigkeit zur Orchestrierung und Integration? Oder in der Fähigkeit, Kapital effizient in Intelligenz umzuwandeln? Dies ist nach wie vor eine komplexe Frage.

Einblicke von Forschern: Das Potenzial des bestärkenden Lernens und die Herausforderung der Ausrichtung

Moderator: Gibt es etwas, worüber Sie im letzten Jahr Ihre Meinung geändert haben?

Douglas: Im vergangenen Jahr hat sich der KI-Fortschritt beschleunigt. Letztes Jahr fragten wir uns noch, ob wir mehr Rechenleistung vor dem Training benötigen, um die idealen Modellfunktionen zu erreichen. Jetzt haben wir eine klare Antwort: Nein. Reinforcement Learning (RL) hat sich als effektiv erwiesen, und bis 2027 wird ein leistungsstarkes Modell mit digitaler Remote-Arbeitsumgebung verfügbar sein. Die früheren Hoffnungen und Bedenken hinsichtlich KI haben sich von „möglich“ zu „fast sicher“ gewandelt.

Moderator: Glauben Sie, dass wir den Datenumfang in Zukunft erweitern müssen? Oder wird der Modellalgorithmus so weit verbessert, dass nur noch wenige neue Daten benötigt werden, wenn Claude 17 herauskommt?

Douglas: Es ist sehr wahrscheinlich, dass wir den Datenumfang nicht mehr wesentlich erweitern müssen, da die Fähigkeit des Modells, die Welt zu verstehen, stark genug sein wird, um sogar das Lernen des Roboters zu steuern und Feedback zu geben. Es gibt ein Konzept namens „Generator-Verifier-Lücke“, das bedeutet, dass es in der Regel einfacher ist, Inhalte zu generieren als sie auszuführen. Dieser Ansatz wird die Fähigkeiten des Modells weiter verbessern. In der Robotik übertrifft der Fortschritt der Kognition die Fähigkeit, die Welt physisch zu manipulieren, bei weitem. Darin liegt ein enormes Zukunftspotenzial.

Moderator: Wie beurteilen Sie den aktuellen Stand der „AI-Alignment-Forschung“?

Douglas: Es gab erstaunliche Durchbrüche in der Interpretierbarkeitsforschung . Wir begannen letztes Jahr gerade erst, „Superposition“ und neuronale Eigenschaften zu verstehen, und die Arbeit von Chris Olah und seinem Team war ein gewaltiger Fortschritt. Jetzt können wir strukturelle und Verhaltensmerkmale auf Schaltkreisebene in hochmodernen großen Modellen identifizieren. Es gibt eine hervorragende Arbeit, die die „Biologie“ großer Sprachmodelle untersucht und zeigt, wie sie Konzepte klar argumentieren können. Obwohl wir den Verhaltensmechanismus des Modells noch nicht vollständig entschlüsselt haben, haben wir erstaunliche Fortschritte gemacht.

Es ist jedoch zu beachten, dass das Modell durch Vortraining menschliche Werte aufnehmen und ausdrücken kann, was bis zu einem gewissen Grad standardmäßig ausgerichtet ist. Sobald es jedoch in die Phase des bestärkenden Lernens eintritt, ist diese Ausrichtung nicht mehr gewährleistet. Beispielsweise versucht das zuvor erwähnte Modell, das Python-Bibliotheken herunterlädt, um die Aufgabe zu umgehen, wenn es weiß, dass sie nicht erledigt werden kann, unter zielorientierter Ausrichtung alle möglichen Wege, die Aufgabe zu erledigen. Dieser Lernprozess ist im Wesentlichen „zielorientiert bedeutet Optimierung“, und die Überwachung und Kontrolle dieses Modellverhaltens ist eine wichtige Herausforderung, mit der sich derzeit alle auseinandersetzen.

Moderator: Vor etwa einem Monat wurde das Thema „KI 2027“ viel diskutiert. Wie war Ihre Reaktion, als Sie das sahen?

Douglas: Ehrlich gesagt finde ich das sehr glaubwürdig. Es gab viele Stellen in dem Artikel, bei denen ich dachte: „Ja, vielleicht ist es so passiert.“ Es gibt einige Nebenwege, aber selbst wenn es nur eine 20-prozentige Chance ist, finde ich die Tatsache, dass es eine 20-prozentige Chance ist, ziemlich erstaunlich.

Moderator: Wenn Sie von einer 20-prozentigen Chance sprechen, liegt das daran, dass Sie hinsichtlich der Ausrichtungsforschung optimistischer sind, oder glauben Sie, dass die Fortschritte langsamer sein werden?

Douglas: Insgesamt bin ich optimistischer, was die Ausrichtungsforschung angeht, als sie. Vielleicht hinke ich ihrem Zeitplan etwa ein Jahr hinterher, aber was ist schon ein Jahr bei diesem großen Trend?

Moderator: Es hängt davon ab, wie Sie dieses Jahr nutzen.

Douglas: Ja, wenn Sie das Beste daraus machen und die richtigen Nachforschungen anstellen, kann das wirklich einen großen Unterschied machen.

Moderator: Wenn Sie für einen Tag Politiker wären, was sollten wir Ihrer Meinung nach tun, um sicherzustellen, dass die Zukunft in eine bessere Richtung geht?

Douglas: Das ist eine gute Frage. Das Wichtigste ist, ein Gefühl für die Trendlinien zu bekommen, die wir alle sehen und über die wir sprechen. Wenn nicht, analysieren Sie die Fähigkeiten, die für die Nation wichtig sind, und quantifizieren Sie, wie sehr das Modell diese Fähigkeiten verbessern kann. Führen Sie beispielsweise eine Reihe von Tests durch, um zu prüfen, ob das Modell diese Tests besteht oder bei diesen Aufgaben signifikante Fortschritte erzielt. Dann hat es eine Art Basisniveau an Intelligenz erreicht. Zeichnen Sie dann eine Trendlinie und beobachten Sie, was 2027 oder 2028 passiert.

Moderator: Wie Evaluierungen auf nationaler Ebene?

Douglas: Richtig. Man muss zum Beispiel die Wirtschaft in alle Aufgaben zerlegen und sich fragen: Wenn ein Modell diese Aufgaben erfüllen kann, ist es dann wirklich intelligent? Man sollte Evaluierungstests entwickeln, Trendlinien zeichnen und dann fragen: „Meine Güte, was wird 2027 oder 2028 passieren?“ Der nächste Schritt ist, massiv in Forschung zu investieren, die Modelle verständlicher, navigierbarer, ehrlicher und zuverlässiger macht – das nennen wir Alignment Science. Ich bedauere, dass der größte Vorstoß in diesem Bereich von Frontier Labs ausging. Aber ich finde, es sollte …

Moderator: Können auch andere Personen teilnehmen? Kann beispielsweise Claude für entsprechende Forschungen eingesetzt werden?

Douglas: Nein. Ich meine, man kann auch auf andere Weise große Fortschritte erzielen. Es gibt ein Projekt namens MAS-Programm, bei dem viele Menschen bedeutende Beiträge zur Alignment-Forschung und insbesondere zur Interpretierbarkeit geleistet haben – alles außerhalb von Frontier Labs. Ich denke, mehr Universitäten sollten sich daran beteiligen. In vielerlei Hinsicht ist das tatsächlich näher an der reinen Wissenschaft: Es untersucht die „Biologie“ und „Physik“ von Sprachmodellen.

Moderator: Ich habe jedoch den Eindruck, dass die Forschungsbegeisterung auf diesem Gebiet nicht sehr groß ist.

Douglas: Ich bin mir nicht sicher. Ich habe gehört, dass auf einigen Konferenzen der letzten Zeit, wie beispielsweise der ICML, der Workshop zur mechanistischen Interpretierbarkeit fehlte, was für mich völlig unverständlich ist. Meiner Meinung nach handelt es sich hier um die reinste wissenschaftliche Erforschung des „inneren Mechanismus des Modells“. Wenn man die helikale Struktur der DNA oder die allgemeine Relativitätstheorie wie Einstein erforschen möchte, dann ist der entsprechende Weg im Technologiebaum des maschinellen Lernens/der künstlichen Intelligenz die Erforschung der mechanistischen Interpretierbarkeit.

Moderator: Lassen Sie uns über die positiven Aspekte sprechen. Wir haben bereits erwähnt, dass alle Bürojobs in den nächsten Jahren automatisiert werden. Aber in welcher Hinsicht werden wir Ihrer Meinung nach unterschätzt?

Douglas: Ja, Modelle werden definitiv Büroarbeit automatisieren, aber ich bin erstaunt, wie langsam die Welt diese Technologien integriert. Selbst wenn die Modelle nicht leistungsfähiger werden, werden die vorhandenen Fähigkeiten einen enormen wirtschaftlichen Mehrwert schaffen. Wir haben unsere Arbeitsabläufe jedoch noch nicht wirklich auf diese Modelle ausgerichtet. Selbst wenn die Modelle gleich bleiben, können wir die Welt komplett verändern.

Douglas: Das erfordert, dass wir in Bereiche investieren, die die Welt wirklich verbessern können, wie etwa die Förderung eines ausreichenden und effizienten Umgangs mit materiellen Ressourcen, die Erweiterung der Grenzen der Physik und der Unterhaltungsindustrie. Das Modell soll uns dabei helfen, diese Ziele zu erreichen. Meine größte Hoffnung ist es, die Menschen kreativer zu machen und ihnen die Möglichkeit zu geben, mehr Inhalte zu improvisieren, zum Beispiel Fernsehserien und Videospiele. Die Menschen werden dadurch enorm gestärkt, und es werden sich in Zukunft endlose Möglichkeiten eröffnen. Obwohl das Modell einige Arbeitsplätze ersetzen wird, wird jeder mehr Einfluss haben, und das Arbeitsmodell der Gesellschaft wird sich dramatisch verändern.

Moderator: Was wird Ihrer Meinung nach im KI-Kreis mittlerweile überbewertet und was unterschätzt?

Douglas: Okay, fangen wir mit den unterschätzten an. Ich finde Weltmodelle sehr cool, aber wir haben heute noch nicht viel darüber gesprochen. Mit der Weiterentwicklung der AR/VR-Technologie werden Modelle in der Lage sein, virtuelle Welten direkt zu generieren, was zu erstaunlichen Erlebnissen führen wird.

Moderator: Das erfordert ein gewisses Maß an physikalischem Verständnis, etwa von Ursache und Wirkung, das wir noch nicht erreicht haben, oder?

Douglas: Ich denke, wir haben tatsächlich gezeigt, dass das Modell ein gewisses Maß an physikalischem Verständnis besitzt. Das zeigt sich in den Evaluierungen, die sich mit physikalischen Problemen befassen, aber auch in einigen Videomodellen. Ich habe zum Beispiel ein tolles Video gesehen, in dem jemand mithilfe eines Videogenerierungsmodells einen Lego-Hai unter Wasser setzte. Es simulierte, wie das Licht von der Oberfläche der Legosteine reflektiert wurde und die Schatten an der richtigen Stelle platziert wurden. Und das ist eine Szene, die das Modell noch nie zuvor gesehen hat, und es ist eine vollständige Verallgemeinerung. Das ist die volle Fähigkeit zur physikalischen Modellierung, oder?

Moderator: Sie sagten, dass selbst wenn das Modell derzeit stagniert, es weiterhin eine Menge Anwendungsentwicklung geben wird. Welche Bereiche werden am meisten unterschätzt und ungenutzt gelassen?

Douglas: Das Feld der Softwareentwicklung ist bereits ausgereift, und Modelle lassen sich sehr gut programmieren. In fast allen anderen Bereichen, wie etwa Recht und Rechnungswesen, besteht jedoch noch großer Entwicklungsbedarf. Insbesondere bei der Anwendung intelligenter Agenten gibt es kein wirklich asynchrones Betriebssystem. Andere Bereiche sind noch unerschlossen und lohnen eine Erkundung.

Moderator: Oft wird behauptet, dass die Programmierung die ideale Anwendungsrichtung für diese Modelle sei.

Douglas: Ja, es handelt sich um einen Frühindikator, aber man kann davon ausgehen, dass andere Bereiche aufholen werden.

Moderator: Ich erinnere mich, dass Sie ein Foto von sich in der Zitadelle gepostet haben. Worum geht es da?

Douglas: Es war ein Kriegsspiel, bei dem Geheimdienste und Kadetten von Militärakademien eingeladen waren, die Ankunft von AGI und mächtiger KI zu simulieren und ihre geopolitischen Auswirkungen zu diskutieren.

Moderator: Waren Sie nach diesem Erlebnis eher verängstigt oder erleichtert?

Douglas: Ehrlich gesagt, ein bisschen mehr Angst.

Moderator: Glauben Sie, dass heutzutage genügend ernsthafte Simulationen dieser Art durchgeführt werden?

Douglas: Nicht genug. Viele haben die Geschwindigkeit der technologischen Entwicklung in den nächsten Jahren unterschätzt und waren nicht vorbereitet. Selbst wenn man glaubt, dass die Wahrscheinlichkeit, dass etwas passiert, nur 20 % beträgt, sollte man darauf vorbereitet sein. Es gibt noch viel Verbesserungspotenzial bei der Effizienz jedes technischen Bindeglieds, und die zukünftigen Ziele sind nahezu sicher.

Moderator: So wie jetzt fast alle Menschen ein Vertrauensniveau von 90 % erreicht haben?

Douglas: Fast alle Teammitglieder sind sehr zuversichtlich, dass wir bis 2027 „Fernbedienbare Plug-and-Play-AGI-Mitarbeiter“ erreichen können. Selbst diejenigen mit geringerem Vertrauen schätzen die Wahrscheinlichkeit auf 10–20 %. Daher sollte die Regierung diesem Thema Priorität einräumen und ernsthaft über die sozialen Auswirkungen nachdenken. Doch die derzeitige Dringlichkeit reicht bei weitem nicht aus.

#Willkommen beim offiziellen öffentlichen WeChat-Konto von iFanr: iFanr (WeChat-ID: ifanr), wo Ihnen so bald wie möglich weitere spannende Inhalte präsentiert werden.