xAI erhält 6 Milliarden US-Dollar Finanzierung, Musk plant außerdem den Bau einer „Super-Computing-Power-Fabrik“

Erst kürzlich gab xAI offiziell bekannt, dass es eine Serie-B-Finanzierung in Höhe von 6 Milliarden US-Dollar erhalten hat, und seine Bewertung ist ebenfalls auf rund 18 Milliarden US-Dollar gestiegen.

Zu den Hauptinvestoren dieser Finanzierungsrunde gehören Valor Equity Partners unter der Leitung von Antonio Gracias, der erste Investor in Tesla und SpaceX, die Investmentgesellschaft Vy Capital aus Dubai, das private US-Risikokapital Andreessen Horowitz, Sequoia Capital, die Risikokapitalinvestitionsgesellschaft Fidelity Management & Research Company, und Kingdom Holding, eine saudi-arabische Holdinggesellschaft usw.

Das derzeit bekannteste Produkt von xAI ist der Chatbot Grok. Seit Grok im November 2023 offiziell veröffentlicht wurde, hat es aufgeholt und versucht, das Tempo von OpenAI zu übertreffen.

Im vergangenen Jahr ist Grok sprunghaft gewachsen. Im März dieses Jahres kündigte Musk die Open Source des 314-Milliarden-Parameter-Hybrid-Expertenmodells Grok-1 an. Ende März brachte xAI das 128.000 lange Textmodell Grok-1.5 heraus Grok-1,5V.

Derzeit verwendet xAI 20.000 GPUs, um Grok 2.0 zu trainieren. Die neueste Version von Grok kann Text und Grafiken verarbeiten und reale Objekte erkennen, und zukünftige Grok-Modelle können auch Audio und Video erkennen.

Musk hat außerdem öffentlich erklärt, dass xAI bis zu 100.000 GPUs verwenden wird, um seine nächste Version von Grok zu trainieren und auszuführen.

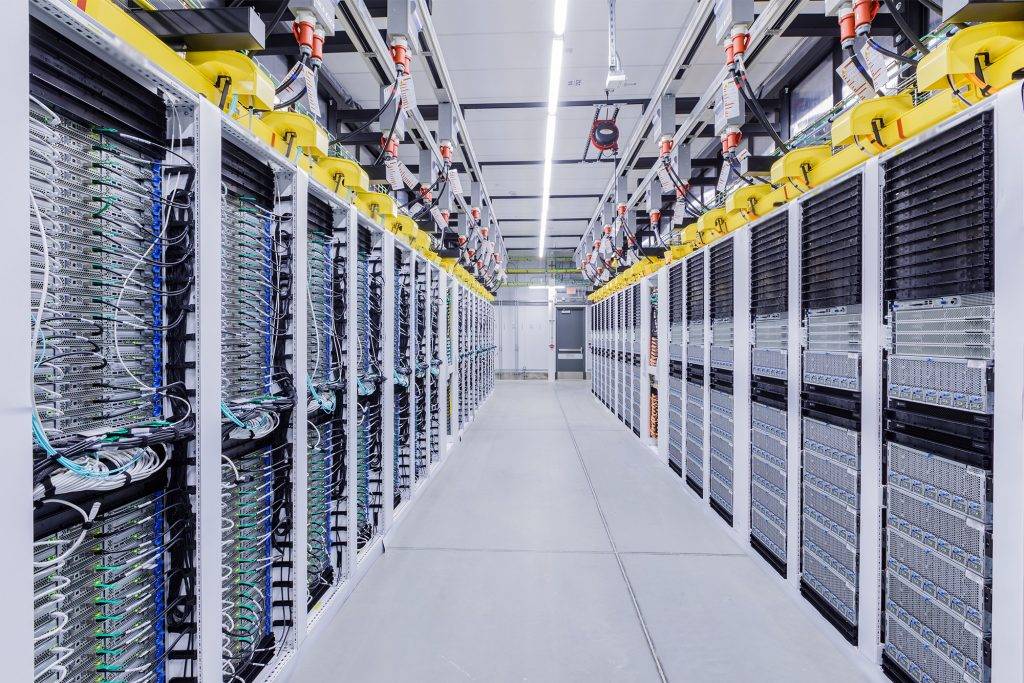

Laut dem neuesten Bericht von The Information enthüllte Musk in einer Präsentation vor Investoren im Mai, dass xAI den Bau einer „Gigafactory of Compute“ plant, um Rechenleistungsunterstützung für die nächste Version von Grok bereitzustellen.

Die neue „Super Computing Factory“ von xAI ist im Wesentlichen ein Supercomputer, ähnlich dem GPU-Cluster Meta, der für das Training von KI-Modellen entwickelt wurde. Unter einem Cluster versteht man zahlreiche Serverchips, die über Kabel innerhalb eines einzigen Rechenzentrums verbunden sind, sodass komplexe Berechnungen gleichzeitig und effizient ausgeführt werden können. Im Allgemeinen bedeutet ein Cluster mit mehr Chips und stärkerer Rechenleistung, dass er eine leistungsfähigere KI bringen kann.

xAI plant die Anbindung von 100.000 H100-GPUs an die „Super Computing Factory“ und kooperiert möglicherweise mit Oracle. Mitte dieses Monats wurde berichtet, dass xAI mit Oracle-Führungskräften über Probleme im Zusammenhang mit Cloud-Servern diskutierte und xAI plante, in den nächsten Jahren 10 Milliarden US-Dollar für die Anmietung von Oracle-Servern auszugeben.

Derzeit hat xAI rund 16.000 H100-Chipserver von Oracle gemietet und ist zum größten GPU-Kunden von Oracle geworden.

Neben der Rechenleistung ist die Stromversorgung ein weiterer wichtiger Faktor bei der Standortbestimmung eines KI-Rechenzentrums. Es wurde berechnet, dass ein Rechenzentrum mit 100.000 GPUs möglicherweise 100 Megawatt dedizierte Leistung benötigt.

Das Büro von xAI befindet sich in der San Francisco Bay Area, aber auch die Elektrizität wird ein wichtiger Faktor sein, der bei der Auswahl des Standorts der neuen „Super-Computing-Fabrik“ berücksichtigt werden muss.

Musk teilte den Anlegern mit, dass xAI zum jetzigen Zeitpunkt immer noch hinter der Konkurrenz zurückbleibe. Quellen zufolge könnten OpenAI und Microsoft bis Ende dieses Jahres oder Anfang nächsten Jahres über Cluster in der von Musk geplanten Größe verfügen.

OpenAI und Microsoft diskutieren außerdem über die Entwicklung eines 100-Milliarden-Dollar-Supercomputers mit Millionen von NVIDIA-GPUs, der um ein Vielfaches so groß wäre wie xAI.

Im März dieses Jahres erklärte Musk in einer Pressemitteilung von Nvidia öffentlich, dass Nvidias Hardware für künstliche Intelligenz „die beste“ sei.

Musk sagte bei einem Investorengespräch im April auch, dass Tesla über 35.000 Nvidia H100 verfügt, um sein autonomes Fahren zu trainieren, und plant, diese Zahl bis Ende des Jahres mehr als zu verdoppeln.

NVIDIAs CFO Colette Kress hat xAI in die Kundenliste aufgenommen. In Zukunft wird xAI mit OpenAI, Amazon, Google und anderen Unternehmen zusammenarbeiten, um der Nutzung von NVIDIAs Flaggschiff-KI-Architektur Blackwell der nächsten Generation Priorität einzuräumen.

Obwohl die „Rechenleistungs-Superfabrik“ Schlange steht, um NVIDIA-Chips zu kaufen, entwickelt xAI immer noch seinen eigenen Dojo-Supercomputer.

Beim Tesla AI Day im Jahr 2022 stellte das Unternehmen seine selbst entwickelte Dojo-Computing-Plattform vor. Dojo besteht intern aus „Training Tiles“. Jede „Tile“ enthält 25 D1-Chips, die letztendlich zu 54P Rechenleistung und einer Halbierungsbandbreite von 13,4 TB/s zusammengefasst werden.

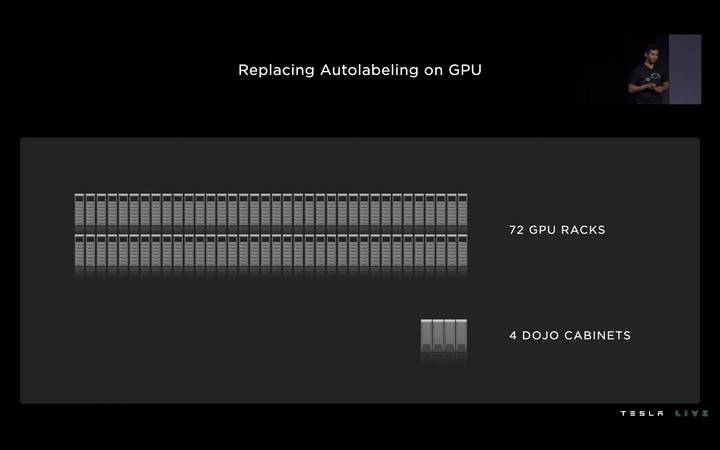

Dojo kann auch in Form eines Schrankes präsentiert werden. Unter dem leistungsstarken Hardware-Stack kann ein Dojo-Schrank eine Rechenleistung von 1,1 E, 13 TB Speicher mit hoher Bandbreite und 1,3 TB Hochgeschwindigkeitsspeicher bereitstellen. Vier Dojos können die Rechenleistung bereitstellen, die 72 GPU-Racks entspricht.

Da jedoch zu diesem Zeitpunkt die Stabilität und Leistung von Dojo nicht garantiert sind, kann xAI immer noch nur NVIDIA-GPUs zum Trainieren von KI auswählen.

Die neu erhaltene Serie-B-Finanzierung hat xAI dabei geholfen, seine finanzielle Belastung bis zu einem gewissen Grad zu lösen. Aber Musk selbst hat zugegeben, dass er jedes Jahr mindestens mehrere Milliarden Dollar ausgeben muss, wenn er im KI-Bereich konkurrenzfähig sein will.

Ob Neuralink, das Mikrochips in das menschliche Gehirn implantiert, Optimus, ein humanoider Roboter, oder der intelligente KI-Assistent Grok – diese aktiv geförderten Projekte von Musk deuten vage auf das ultimative Ziel hin: künstliche allgemeine Intelligenz (AGI).

xAI hat noch einen langen Weg vor sich und arbeitet hart daran, das Spiel zu verändern. Es scheint jedoch, dass Nvidia derzeit der größte Gewinner sein könnte.

# Willkommen beim offiziellen öffentlichen WeChat-Konto von aifaner (WeChat-ID: ifanr). Weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner |. Ursprünglicher Link · Kommentare anzeigen · Sina Weibo