Ist die Person, die Sie interviewt, nicht? New York will “Interviewer” mit künstlicher Intelligenz einschränken

"Wir können keine konkrete Rückmeldung zu den Ergebnissen Ihres Interviews geben."

In den USA setzen immer mehr Arbeitgeber Künstliche Intelligenz (KI) ein, um den Rekrutierungsprozess zu beschleunigen. Arbeitssuchende wissen jedoch selten, warum KI-Rekrutierungstools ihre Lebensläufe ablehnen oder ihre Videointerviews analysieren. Wenn sie die Wahl verlieren, können sie oft nur eine so kalte E-Mail erhalten, ohne zu wissen, warum sie die Wahl verloren haben.

▲ Bild von: unsplash

Das ist beunruhigend: Welche Entscheidungsmacht spielt KI in unserer Karriere?

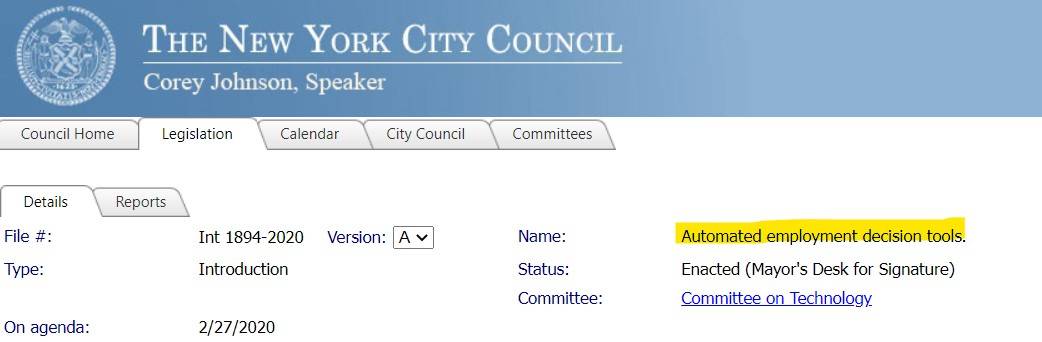

Die Associated Press berichtete, dass der New Yorker Stadtrat Anfang November einen Gesetzentwurf mit 38 zu 4 Stimmen verabschiedet habe : Wenn das KI-Rekrutierungssystem die jährliche Prüfung nicht besteht, wird es verboten. Das jährliche Audit wird das KI-Rekrutierungssystem auf Rassen- oder Geschlechtsdiskriminierung überprüfen, sodass Bewerber Alternativen wie die manuelle Überprüfung wählen können, und KI-Entwickler müssen mehr Details offenlegen, die in der Vergangenheit nicht transparent waren.

Interessanterweise sind es die KI-Entwickler, die für das jährliche Audit verantwortlich sind, aber der Arbeitgeber wird bestraft: Wenn sie ein KI-Rekrutierungssystem verwenden, das das jährliche Audit nicht besteht, beträgt die Höchststrafe für jeden Verstoß 1.500 US-Dollar.

Befürworter glauben, dass der Gesetzentwurf ein Fenster zu komplexen Algorithmen öffnen wird. Algorithmen ordnen Fähigkeiten und Persönlichkeiten oft nach dem Sprechen oder Schreiben von Bewerbern ein, aber ob die Maschine Persönlichkeitsmerkmale und emotionale Signale richtig und gerecht einschätzen kann, ist fraglich – dieser Prozess wird in Zukunft transparenter sein.

Zumindest ist es sinnvoll zu wissen, dass „der Algorithmus abgelehnt wird, weil er voreingenommen ist.“ Sandra Wachter, Professorin für technisches Recht an der Universität Oxford, sagte einmal:

Das Antidiskriminierungsgesetz wird hauptsächlich von Beschwerden getrieben: Wenn sie nicht wissen, was mit ihnen passiert ist, kann sich niemand darüber beschweren, dass ihnen eine Arbeitsmöglichkeit verweigert wird.

Auch das Start-up-Unternehmen Pymetrics unterstützt diesen Gesetzentwurf sehr: Sie befürworten den Einsatz von KI, um Interviews durch Spiele und andere Methoden zu führen, und glauben, dass dies den Anforderungen der Fairness entspricht. Gleichzeitig werden veraltete KI-Interviewprogramme in den Müll geschwemmt. HireVue, ein Anbieter von KI-Rekrutierungssystemen, hat Anfang dieses Jahres damit begonnen , sein Gesichts-Scanning-Tool , das von der Wissenschaft als "Pseudowissenschaft" bezeichnet wird, auslaufen zu lassen, was an die phrenologische Theorie des Rassismus erinnert.

Die Mehrheit der Opposition gegen das Gesetz basiert auf "das ist bei weitem nicht genug". Alexandra Givens, Vorsitzende des Center for Democracy and Technology, wies darauf hin, dass der Vorschlag eigentlich nur von Arbeitgebern verlangt, die bestehenden Anforderungen des US-Bürgerrechtsgesetzes zu erfüllen, das Rekrutierungen verbietet, die sich aufgrund von Rasse, ethnischer Zugehörigkeit oder Geschlecht unterscheiden. ignoriert jedoch Vorurteile gegenüber Behinderung oder Alter.

▲ Bild von: unsplash

Und einige Experten für künstliche Intelligenz und Aktivisten für digitale Rechte befürchten, dass der Gesetzentwurf KI-Entwicklern nur erlaubt, sich selbst zu zertifizieren, dass sie die grundlegenden Anforderungen erfüllt haben, und dass er nur schwache Standards für Bundesaufsichtsbehörden und Gesetzgeber setzt vage.

Es ist erwähnenswert, dass Verzerrungen in Vorstellungsgesprächen keine Seltenheit sind.Das Hauptproblem liegt im Stichproben-Zuführungsalgorithmus, aber sie werden oft in einer "Black Box" platziert, die für normale Arbeitssuchende schwer zu erkennen ist.

Vor einigen Jahren hat Amazon sein Tool zum Scannen von Lebensläufen eingestellt, weil es Männer in technischen Positionen bevorzugt. Das liegt unter anderem daran, dass er die Arbeitsbedingungen von Arbeitssuchenden mit den männlichen Fachkräften im Unternehmen vergleicht; ebenso, wenn der Algorithmus seine Nahrung aus Branchen bezieht, in denen Rassen- und Geschlechterunterschiede bereits verbreitet sind, dann verfestigt er nur Vorurteile.

Dieses Vorurteil betrifft nicht nur die Einstellung. Im April dieses Jahres hat eine neue Studie der University of Southern California gezeigt, dass Facebook Anzeigen auf eine Weise zeigt, die möglicherweise gegen das Antidiskriminierungsgesetz verstößt. Männer sehen häufiger Anzeigen zur Einstellung von Pizzalieferanten, während Frauen dies eher sehen siehe einkaufen. werben.

▲ Bild von: unsplash

Im Wesentlichen wird KI-Diskriminierung von der menschlichen Gesellschaft kultiviert, und individuelles voreingenommenes Verhalten ist sogar unbewusst, und wir sind uns dessen möglicherweise selbst nicht bewusst. Vergleicht man ein Unternehmen mit weniger Vorurteilen mit einem Unternehmen mit schwerwiegenden Vorurteilen, gibt es in der Regel zwei Gründe: Ersteres ist besser darin, Vorurteile bewusst abzubauen, und letzteres ist besser darin, unvernünftigen Status quo zu sammeln und aufrechtzuerhalten.

Daher ist die neutrale Meinung der Ansicht, dass der beste Teil des New Yorker Vorschlags darin besteht, dass die Menschen wissen, dass sie von KI bewertet werden, wie sie von KI bewertet werden und wohin ihre Daten gehen.

▲ Referenzmaterialien:

1.https://apnews.com/article/technology-business-race-and-ethnicity-racial-injustice-artificial-intelligence-2fe8d3ef7008d299d9d810f0c0f7905d

2.https://apnews.com/article/job-seekers-artificial-intelligence-hiring-decisions-784ccec7ac6175aadc573465ab604fb9

#Willkommen, um dem offiziellen WeChat-Account von Aifaner zu folgen: Aifaner (WeChat-ID: ifanr), weitere spannende Inhalte werden Ihnen so schnell wie möglich zur Verfügung gestellt.

Ai Faner | Ursprünglicher Link · Kommentare anzeigen · Sina Weibo